了解聊天机器人中的“人类参与环节”:用人类专业知识提升人工智能

探索在人工智能聊天机器人中“人类参与环节”(HITL)的重要性与应用,了解人类专业知识如何提升AI系统的准确性、道德标准和用户满意度,适用于各行各业。...

高级管理人员现在需要高度关注人工智能治理。随着 AI 代理越来越多地承担公司核心活动,最高层领导必须对监管机构、利益相关方及市场负责。他们需确保 AI 系统安全运行、遵循伦理标准,并保持可审查性。鉴于行政命令、行业规定及全球法律变化,负责任的 AI 治理已成为董事会议题。

Human-in-the-loop(简称 HITL)是负责任 AI 的基石。在 AI 过程关键阶段引入人工检查,能帮助组织降低风险、解决伦理问题并牢牢掌控结果。HITL 不只是技术控制,更是将 AI 决策直接关联到高管责任和企业价值观的桥梁。

实施 HITL 能让您的 AI 系统保持可审查和灵活调整。这一点十分重要,因为像欧盟 AI 法案和美国行政命令等法律要求企业具备透明度、人工控制权以及自动化决策中的风险管理能力。对高管而言,HITL 是强有力的 AI 治理核心,使企业能够持续创新,同时赢得客户、投资者和监管方的信任。

Human-in-the-Loop(HITL)AI 指的是在机器学习过程中有人类参与的人工智能系统。在这些系统中,您或其他人员会在数据标注、验证、决策审批、异常处理等关键节点介入,指导、纠正或否决自动系统的行为。研究表明,这类人工参与能让 AI 输出更准确、适应性更强且更具伦理性,尤其适用于复杂或高风险场景。

对于董事会或管理团队成员来说,HITL AI 不只是技术问题,更是组织战略的关键组成。将人类专业知识融入 AI 系统,能让企业智慧、伦理价值和洞察力直接作用于 AI 决策环节。此举把算法优势与高管监督相结合,从而保障企业对业务结果的实际影响力。

Gartner、艾伦·图灵研究院等权威机构建议使用 HITL 实现负责任的 AI 管理。MIT Sloan Management Review 2023 年调查显示,63% 的高管认为在人类监督下的 AI 项目更值得信赖且效果更好。

Human-in-the-Loop AI 让您在充分利用 AI 力量的同时,对关键决策保持掌控,有助于企业技术与业务目标一致,实现长期、负责任的增长。

将 Human-in-the-Loop(HITL)流程引入 AI 代理系统后,企业投资回报率显著提升。EY 的 Pulse 调查数据显示,在 AI 治理以人为本且负责任 AI 预算占 IT 总支出 5% 以上的公司,在生产力、创新和风险调整表现方面均有更好结果。重视 HITL 的领导者能够更快实现价值,避免算法失误或声誉受损等问题。

HITL 框架让组织在激烈市场中脱颖而出,确保 AI 代理在明确伦理框架下运行。行业研究表明,加入人工判断的决策流程,能维护利益相关方信任并遵守监管要求,这在关注 AI 代理伦理的行业尤为重要。近期调查显示,61% 的高管已加大对负责任 AI(包括 HITL 系统)的投入,以应对客户需求和法规变化。

若忽视 HITL,公司可能因 AI 输出失误或偏见积累技术债务。Business and Artificial Intelligence 期刊的研究指出,人机协作能带来更准确、实用的结果,同时减少返工和危机处理成本。HITL 支持持续学习,让 AI 代理根据实际反馈优化,提升组织敏捷性和持续改进能力。

作为 C 位高管,应将 HITL 纳入 AI 代理战略核心。这有助于最大化投资回报、保持竞争力,并在数字化转型中注入伦理韧性。行业指导强调,负责任 AI 需真正落地——确保人类始终参与监督与干预过程,使每一次 AI 决策都契合企业目标与社会标准。

参考文献:

– EY Pulse 调查:“AI 投资提升 ROI,但领导者面临新风险。”

– Business and Artificial Intelligence 期刊:“AI 增强冷启动外呼案例研究。”

– Agility at Scale:“证明 ROI——衡量企业级 AI 的业务价值。”

随着 AI 代理越来越复杂和自主,组织更需强化风险管理。Human-in-the-Loop(HITL)框架通过直接人工监督实现这一目标。HITL 能及早发现、评估并应对自动系统可能遗漏的风险。行业报告和监管指南(如美国能源部 2024 年 AI 风险摘要)指出,人工监督有助于预防故障、伦理问题和声誉损害。

AI 代理(尤其是机器学习)可能产生偏见、出现数据漂移、遭受对抗攻击或行为不可预测。若无人监管,这些系统会大规模重复错误。HITL 方法让企业领导者可以及时介入、审查结果、快速处理问题或异常。2024 年 SAGE 期刊研究显示,采用人工监督的组织假警报、合规问题和意外结果显著少于仅靠自动系统的企业。

将 HITL 纳入 AI 代理流程带来显著好处。例如,在金融和关键基础设施领域,监管机构已建议或要求采用 HITL 实现强有力的风险管理。数据显示,采用人工监督的组织重大事故(如 AI 错误分类、欺诈、安全漏洞)减少至多 40%(DOE CESER,2024)。风险降低意味着资金节省、法律风险减少及运营更稳定。

作为高管,应将 HITL 作为 AI 治理的标准。需建立明确的监督流程、定期审计和问责机制。在重要或不确定情境下保留人工判断,保障 AI 决策可控。将人工监督纳入企业战略,向监管方、合作伙伴和公众证明 AI 风险获得直接、负责任的管理。

参考文献:

– 美国能源部 CESER. (2024). 人工智能在关键基础设施中的潜在益处与风险。

– SAGE 期刊. Human Near the Loop: Implications for Artificial Intelligence in Complex Systems.

– Guidepost Solutions. AI 治理——终极 Human-in-the-Loop。

AI 信任已成为企业高管关注的首要问题。全球最新调查显示,超过 70% 的高管认为信任是 AI 广泛应用的最大障碍(哈佛商业评论,2024)。投资者、客户、监管者等各方都期望企业公开透明、表现一致,并对 AI 决策承担明确责任。失去信任将导致声誉受损、运营效率下降、股东价值缩水,也会阻碍创新与增长。

将 Human-in-the-Loop(HITL)系统嵌入 AI 流程,能直接解决信任难题。科学研究和行业指南皆证实,人工监督提升了 AI 过程的可理解性和可追溯性。引入专家审查、批准或修正 AI 决策,确保 AI 行为符合组织价值观及伦理规范。此类人工监督防止偏见、错误和意外后果,在金融、医疗、法律等敏感领域尤为重要。

高管需对 AI 行为承担更直接责任。HITL 方法通过明确分工和可追溯的责任体系,构建强有力的治理规则。SAP 的 AI 伦理指南建议全程保留人工参与,确保伦理责任。这既满足监管要求,也让利益相关方确信企业对 AI 系统拥有有效管控。

公开展示人工监督 AI,能与企业生态内各方建立信任。HITL 结构有助于详细解释 AI 决策过程及纠错机制。这种透明度既是合规必需,也是赢得客户信任的基础。完善的 HITL 流程便于企业广泛应用 AI、创造可持续价值,并在技术变革中与利益相关方保持紧密联系。

参考文献:

– 哈佛商业评论. “AI 的信任难题。”

– HolisticAI. “Human in the Loop AI: 保持 AI 与人类价值观一致。”

– SAP. “什么是 AI 伦理?伦理在 AI 中的角色。”

欧盟 AI 法案、GDPR 等法规对 AI 部署设定了严格标准,尤其强调人工监督和透明度。例如,欧盟 AI 法案要求高风险 AI 系统“应有适当的人工监督”,即需建立机制识别、阻止和管理风险。北美和亚太等地也出台了类似规定,要求实施 Human-in-the-Loop(HITL)控制,确保 AI 使用权归于人类。

将 HITL 流程纳入 AI 系统,可直接满足法律要求。人工监督便于快速干预、纠错及形成完善的审计记录,若遇监管或外部审查,有据可查。HITL 让企业能证明具备风险管理、AI 可解释性及责任归属,这也是监管者和利益相关方所要求的合规水平。

不遵循 AI 法规,企业将面临高额罚款、法律诉讼和声誉受损。采用 HITL 框架可达标合规标准,降低受罚风险。HITL 便于监控和记录 AI 系统,实现全流程可追溯和可解释,这也是 GDPR 与 AI 法案合规的核心要求。

采用 HITL 不仅是最佳实践,更是法律要求,可保护企业并维护 AI 信任。

在高管层面负责 AI 战略时,需快速响应技术进步和监管新规。Human-in-the-Loop(HITL)框架可助力企业灵活应对业务及合规变化。人工全程参与 AI 模型生命周期,便于随时更新、重训或干预模型行为,确保 AI 保持相关性并符合法规(如欧盟 AI 法案和全球数据隐私法)。

HITL 营造专家持续反馈的环境,推动 AI 持续优化。研究表明,采用 HITL 能加速模型改进和业务场景适应。高管级 AI 应用研究指出,配置 HITL 的组织更快获得价值,能抓住新机遇而无需重建系统。

从 AI 获得长期价值,远不止风险规避。HITL 让领导者在新兴或不确定领域放心应用 AI,有人工判断兜底应对突发问题。此举让企业能根据战略需求灵活启动、扩展或退出 AI 工具,避免技术路径锁定。

战略敏捷性是持续获取 AI 回报的关键。将 HITL 融入高管 AI 战略,能够防范突发风险,助力企业在不确定性中稳健成长,使 AI 成为支持企业持续进化的灵活工具。

首先识别业务流程和 AI 应用中,对财务、法律、声誉或安全影响重大的决策节点,在这些环节重点引入 HITL。例如,在贷款审批、医疗诊断、客户投诉处理等流程设立人工复核,有助于风险管理和降低合规暴露(Marsh, 2024)。

构建有力的 HITL 治理体系,组建由合规、技术、风险及业务部门领导组成的跨职能团队,明确人工监督、决策流程和记录保存的责任分工。确保人工审核人员具备资质,能够随时介入或复核 AI 决策,满足新规(如欧盟 AI 法案)下的合规与可追溯性要求。

为人工审核人员提供必要的培训,让他们…

探索在人工智能聊天机器人中“人类参与环节”(HITL)的重要性与应用,了解人类专业知识如何提升AI系统的准确性、道德标准和用户满意度,适用于各行各业。...

探索为什么AI领导力对组织成功至关重要,强有力的领导者如何推动AI转型,以及FlowHunt的AI领导力工作坊如何帮助高管在人工智能时代自信引领。...

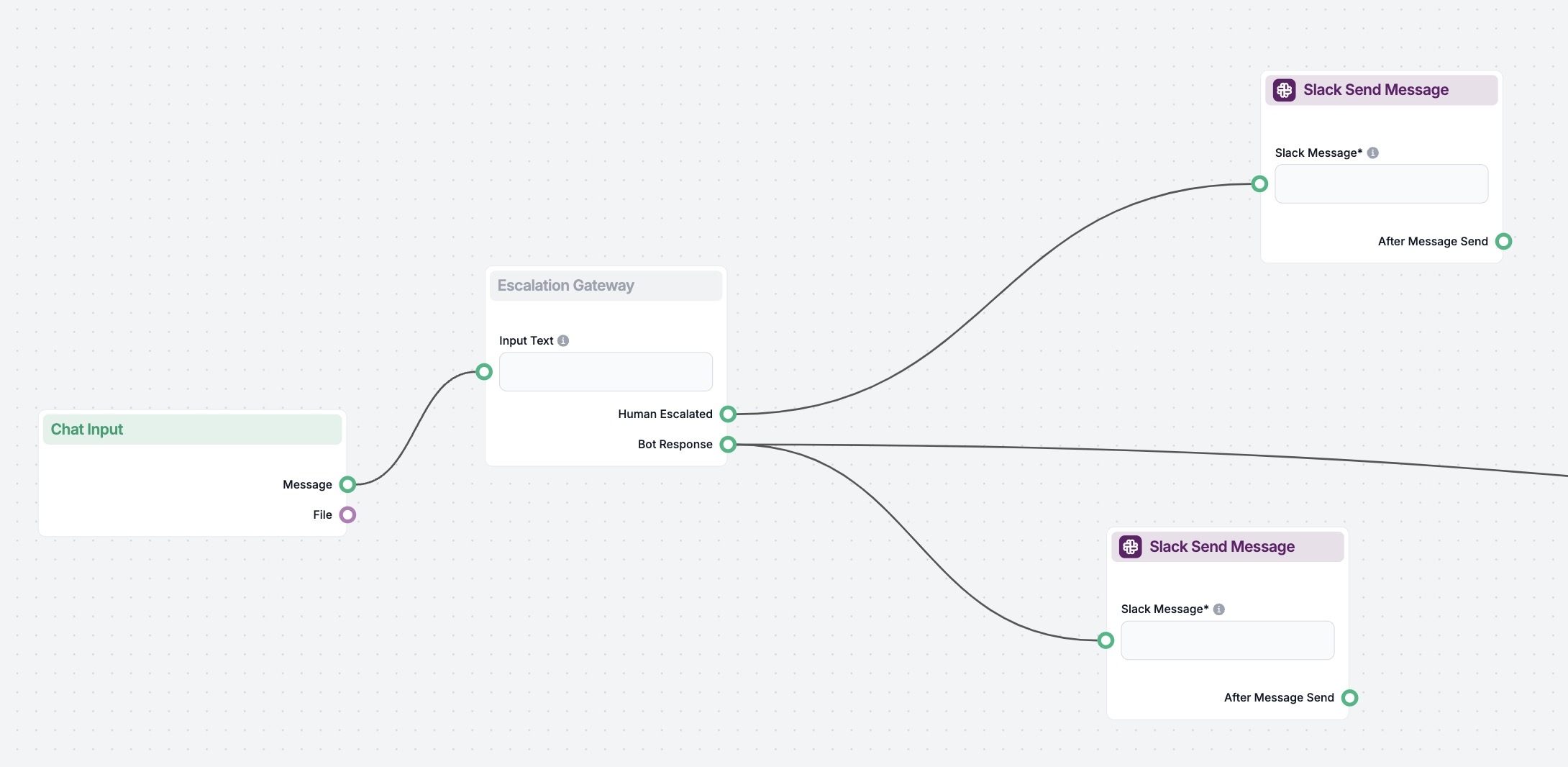

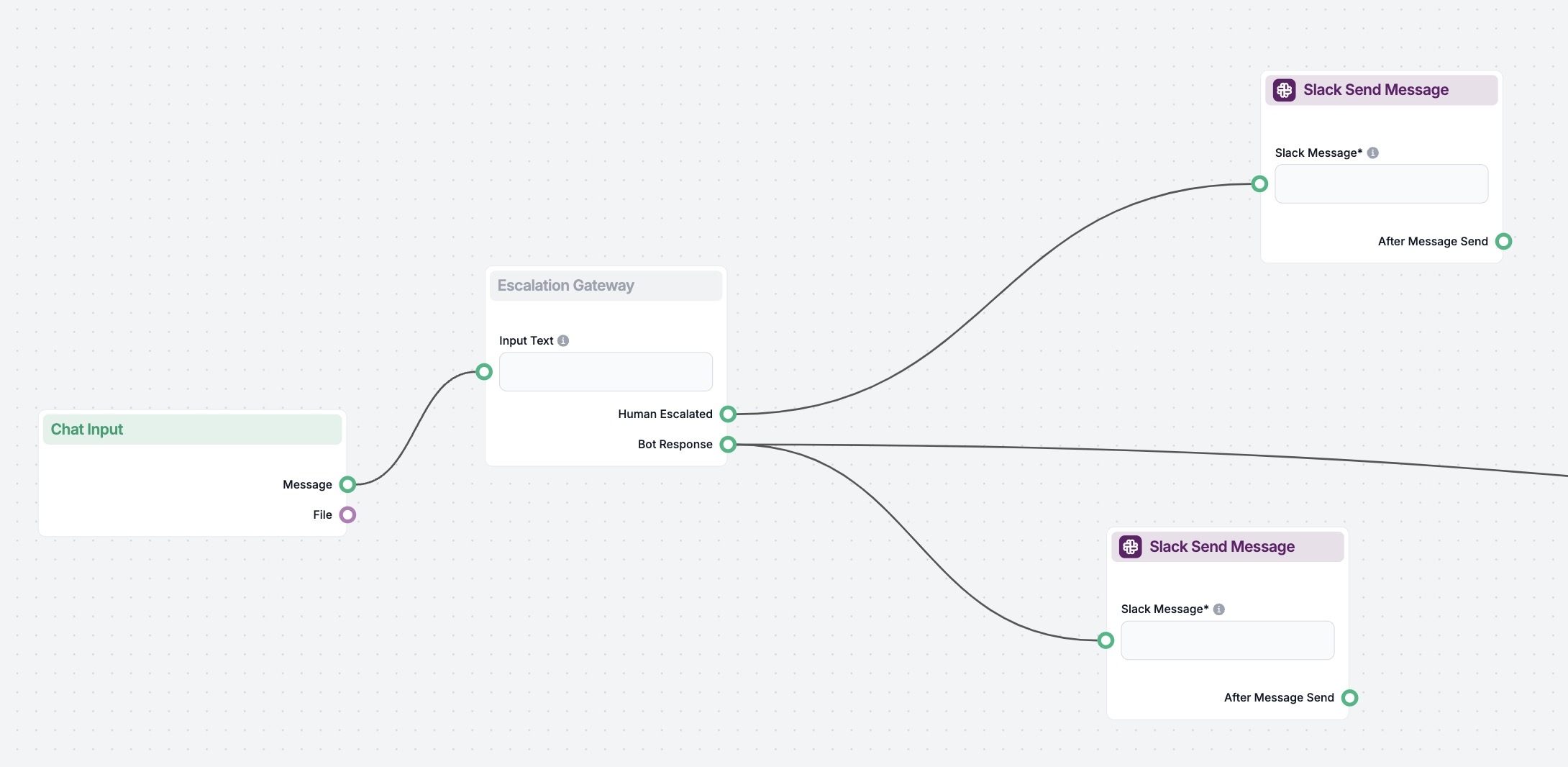

人类参与环节(HITL)是一种人工智能和机器学习的方法,将人类专业知识整合到AI系统的训练、调整和应用中,以提升准确性、减少错误并确保伦理合规。...