2026年最佳AI智能体构建平台:自主智能平台全指南

探索2026年顶级AI智能体构建平台,从零代码平台到企业级框架。了解哪些工具最适合你的用例,以及FlowHunt如何提升AI智能体工作流。...

多智能体AI系统是由协同解决问题的AI智能体组成的网络。但在2026年实际被部署的架构比这个流行词所暗示的更窄:单个orchestrator拥有完整的对话上下文,并派生短暂的隔离子智能体,后者仅返回压缩后的摘要。Anthropic、Cognition、OpenAI、AutoGen-via-Microsoft Agent Framework和LangChain都汇聚到了这一模式。peer collaboration的"GroupChat"设计——工作智能体彼此直接对话——已经悄然失势。

本文做三件事。第一,解释orchestrator + 子智能体模式以及行业为何汇聚于此。第二,剖析成本现实:Anthropic测得的约15倍token溢价,以及2026年的论文表明在同等token预算下单智能体能匹敌或胜过多智能体。第三,展示如何在FlowHunt中无需写代码即可构建这一共识模式。

实际上只有两种架构值得对比,而大多数营销材料把它们混为一谈。

**Peer collaboration。**多个智能体并发运行,通过共享总线通信。它们可以彼此提问、移交任务、互相唤醒。supervisor负责调解但并不独占上下文。AutoGen GroupChat、CrewAI hierarchical以及任何"流式智能体团队"设计都属于此类。代价是真实的:每次唤醒都要重新读取完整记录,系统提示在每次调用都携带冗长的协调协议,通信关系按O(n²)增长。

**Orchestrator + 隔离子智能体。**单个智能体拥有完整上下文。它派生短暂的子智能体来执行隔离的子任务。每个子智能体在自己的全新上下文窗口中运行,配有专属的系统提示,执行其任务,并返回单个摘要字符串。不存在peer-to-peer通道,也没有共享的可变状态。Anthropic的研究多智能体系统、Claude Code的Task工具、OpenAI的agents-as-tools,以及Cognition于2026年3月发布的Managed Devins都使用此模式。

第二种模式技术上仍属于多智能体,但其协调成本是有界的。没有peer总线,因此不存在二次方的通信爆炸,也没有记录回放的税负。

2025年的两极化辩论实际上已经平息。

Cognition的Don’t Build Multi-Agents(2025年6月)是反对多智能体设计的最强烈表态——只支持单线程,配以独立的压缩LLM做上下文管理。九个月后,2026年3月,Cognition发布了Devin can now Manage Devins :一个协调器,划定工作范围,将每个部分分配给运行在自己隔离VM中的managed Devin,然后整合结果。其理由——“上下文累积、焦点退化,每个子任务的质量都受影响”——正是Anthropic在2025年提出的隔离论证。文章并未指名撤回先前的那篇文章,但架构上的让步毫不含糊。

Anthropic的姿态在同一时期朝相反方向移动——转向解耦的"大脑/手"架构,而不是更宽的并行fan-out。2026年4月的Managed Agents 文章和用于全栈开发的三智能体harness强调role-scoped子智能体而非peer团队。

OpenAI于2026年4月15日的Agents SDK更新 将嵌套handoff历史默认改为opt-in——降低了跨智能体的上下文渗漏。AutoGen合并入Microsoft Agent Framework 1.0;peer GroupChat不再是旗舰。LangChain现在推荐supervisor-as-tool而非supervisor library。

五家厂商,一个方向。peer GroupChat正在式微。

来自Anthropic 2025年6月工程文章中被引用最多的数据:

“内部分析表明,智能体通常使用比聊天交互多约4倍的token,而多智能体系统使用比聊天多约15倍的token。”

以及那段诊断性的结语:

“仅token消耗本身就能解释BrowseComp性能80%的方差。”

2026年的学术文献把同样的结论推得更狠。Tran & Kiela(arXiv 2604.02460 ,2026年4月,Stanford / Contextual AI)测试了Qwen3、DeepSeek-R1-Distill-Llama和Gemini 2.5,并报告:*“在固定推理token预算和完美上下文利用的条件下,单智能体系统在信息效率上更高……当推理token保持恒定时,单智能体系统在多跳推理任务上始终匹敌或胜过多智能体系统。"*理论下界是数据处理不等式:信息经过更多智能体只会损失,永远不会增加。

Xu等人的OneFlow 论文(2026年1月)在七个基准上得出了相同结论,并引用KV-cache复用作为效率优势。

这并不意味着多智能体永远是错的。这意味着举证责任在多智能体一方,而非更简单的设计上。

2026年的证据汇聚到一组狭窄的情况上。

可并行的读密集型工作。Anthropic的2025年系统对独立的研究子查询fan-out子智能体。AORCHESTRA(arXiv 2602.03786

,2026年2月)将每个子智能体建模为一个4元组(INSTRUCTION, CONTEXT, TOOLS, MODEL),由orchestrator按需派生,并报告在GAIA、SWE-Bench和Terminal-Bench上使用Gemini-3-Flash相对最强基线提升+16.28%。AdaptOrch(2602.16873

)在使用相同底层模型的情况下报告比静态单拓扑基线高+12–23%——胜利来自拓扑路由,而非peer collaboration。

窄领域可靠性。Drammeh的事件响应论文(2511.15755 v2 ,2026年1月)进行了348次受控试验,并报告可执行推荐率100% vs 单智能体的1.7%,行动具体性提升80倍,解决方案正确性提升140倍,且*“所有试验中质量方差为零。"*领域窄、工作可并行;orchestrator模式以压倒性优势胜出。

不相交的工具或上下文领域,handoff充当安全边界——例如,账单智能体真不应该看到工程类工具。

对于顺序任务执行、触及共享状态的智能体,或任何看起来像"按顺序执行这些步骤并在中间做判断"的事情——这些条件不适用。文献推荐使用配以严格上下文管理的单智能体。

一旦你判定多智能体是正确选择,提示结构比大多数营销材料所暗示的更标准化。所考察的每一个主要实现——Claude Code、Anthropic Research、OpenAI Agents SDK、CrewAI、AutoGen、LangGraph、AOrchestra——都使用同一种模式,提示构建文献中称之为P2:为子智能体配备专属系统提示,加上以第一条用户消息形式提供的结构化任务brief。

Anthropic的2025年文章对brief应包含什么最为明确:

“每个子智能体需要一个目标、一个输出格式、关于要使用的工具和来源的指引,以及清晰的任务边界。”

他们对省略这一步的失败模式也直言不讳:

“我们一开始让lead智能体下达简短指令,比如’研究半导体短缺’,但发现这类指令往往含糊到子智能体要么误解任务,要么执行完全相同的搜索。”

从这份共识中浮现出三条规则:

第四条经常被忽视的规则:**当supervisor仅剩的工作是把工作智能体的输出送达用户时,直接转发即可。**LangChain 2025年的基准测得swarm-vs-supervisor性能增益的约50%来自这一项改动。“supervisor读取工作智能体输出,向用户转述,再把用户回复转述给下一个工作智能体"的往返完全是浪费。

这些在生产复盘、LangChain的基准以及Cogent的Multi-Agent Orchestration Failure Playbook for 2026中反复出现。这就是行业转向的原因。

| 失败模式 | 表现 |

|---|---|

| 每次唤醒重放完整记录 | 每个智能体在每一轮都重新摄入整段对话。线性增长于 轮数 × 智能体数。 |

| 协调协议导致的系统提示膨胀 | 每个智能体在每次调用都附带协议描述、角色清单和信号词表。 |

| supervisor"翻译"往返 | supervisor读取工作智能体输出、向用户转述、再把用户回复转述给下一个工作智能体。约50%的可避免成本。 |

| 隐含假设冲突 | 并行运行的工作智能体做出微妙的美学或架构决策,彼此无法调和。Cognition 2025年的核心观点。 |

| 协调边爆炸 | n个智能体通过O(n²)条边通信。增加第5个智能体会让消息图翻倍。 |

| HITL/挂起开销 | 暂停和恢复会重新计费整个挂起前的记录。 |

| 过早共识 / “羊群效应” | peer智能体收敛到一个自信但错误的答案,因为每个智能体的自信会抬高其他智能体的自信。2026年新发现(Tian等人,2025;2026年得到强化)。 |

一个有用的诊断方法:如果你在自己的部署上能数出这七项中的三项,那你就是在为文献不推荐的架构支付多智能体税。修复方案很少是"撤掉这个智能体团队”——而是压缩历史、缓存静态提示前缀、返回摘要而非完整记录、把工作智能体输出直接转发给用户。

2026年真正的新进展是基础设施层的协调原语,而非框架模式。

Agent2Agent (A2A) 协议在2025年12月加入Linux Foundation AI & Agents Foundation (AAIF),与MCP并列,由OpenAI、Anthropic、Google、Microsoft、AWS和Block作为创始支持方。A2A明确瞄准*“分布式多智能体工作流的智能体间通信、任务委派和协作编排。"*到2026年2月,MCP的SDK每月下载量已突破约9700万。

有两个研究阶段的原语值得关注。KVCOMM(NeurIPS 2025)在五智能体场景中通过共享KV状态而非token,展示了超过70%的KV-cache复用以及约7.8倍的加速。Phase-Scheduled Multi-Agent Systems (PSMAS, 2026年2月) 报告通过将智能体激活视为对共享注意力的连续控制而非离散RPC,实现了34.8%的token削减。

这些原语通过改变智能体之间"上下文"的含义,从而绕过了orchestrator-vs-peer的二分法。它们尚未成为可投入生产的构建块,但却是值得跟踪的方向——并且强化了总体趋势:成本将在基础设施层通过更聪明的协调来降低,而不是在框架层通过更精巧的peer设计来降低。

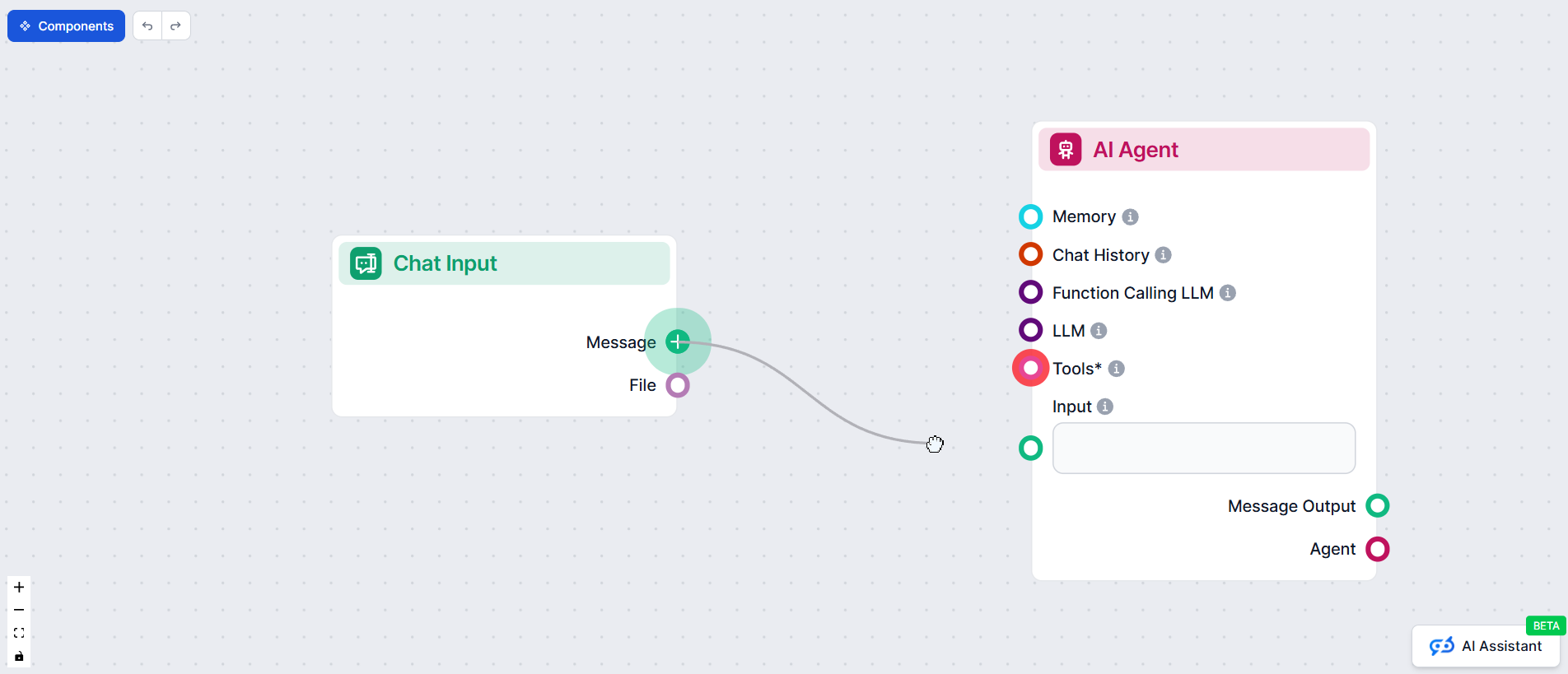

不需要是软件工程师就能构建orchestrator + 子智能体模式。FlowHunt的可视化构建器干净地映射到子智能体契约:orchestrator节点拥有对话,工作节点带着自己的系统提示运行,连接承载结构化brief传出和摘要传回。

下面是使用共识模式的内容研究流水线45分钟教程。

登录FlowHunt并点击Create New Workflow。命名为Content Research Pipeline。将触发器设为Manual。该工作流有三个角色:拥有用户请求的orchestrator、研究子智能体(可并行读取)和事实核查子智能体(可并行读取)。两个子智能体都返回摘要。

添加一个Google Search节点。将其配置为接收一个主题作为输入,返回前5个结果,排除广告,并输出URL、标题、摘要和日期。

下游添加一个OpenAI节点。这就是子智能体的"系统提示"槽位。给它一个专属的、聚焦的提示:

你是一个research subagent。给定搜索结果,

提取带有源URL和发布日期的事实陈述。

输出一个JSON list,元素为{claim, url, date}对象。

边界:不综合、不总结、不发表评论。

这就是P2模式:专属的子智能体提示,范围严格限定。连接Google Search → OpenAI Extraction。

添加一个Text Synthesis节点。它的工作是将研究子智能体的输出组织成结构化大纲——每个主题一节,每节由源陈述支撑。

添加一个OpenAI节点起草文章。给它一个聚焦的提示:大纲进,草稿出。连接Synthesis → OpenAI Generation。

添加一个配置为事实核查者的AI Agent节点。结构化brief按照Anthropic的配方——目标、格式、工具、边界:

目标:验证草稿文章中的每一个事实陈述。

输出格式:带注释的草稿,每条陈述附带验证状态

(verified | unverified | contradicted) 以及0–1的置信度分数。

工具:knowledge base lookup、web search。

边界:不要重写文章。只标注,不修改。

添加一个Markdown formatter作为最终输出节点。连接Fact-Checker → Markdown。

研究子智能体 → Synthesis → 事实核查子智能体 → 输出。每条连接都把上一步的输出作为下一步的结构化brief传递。

这是顺序而非fan-out,这里这样做是合适的——综合步骤需要研究的输出,事实核查需要综合的结果。如果你想扩展到十个并行的研究子查询,就用fan-out替换那个单一的研究节点:orchestrator并行派生N个子智能体,每个从结构化brief中拿一个子查询,每个返回自己的摘要,orchestrator在传递到综合步骤之前合并它们。

点击Run Workflow。提供一个主题,比如*“什么是量子计算?"*。预期端到端约45–60秒。在FlowHunt UI中观察各节点的输出,看每个子智能体收到了什么brief,以及返回了什么。

验证后,部署到webhook、计划任务或手动触发器。配置输出目的地(邮件、Slack、Google Drive、数据库)。启用按角色的日志——Anthropic关于"80%的方差是token消耗"的发现,使按角色的token遥测成为任何调优的前置条件。

2025–2026年文献明确反对的一些做法:

这些是orchestrator + 子智能体模式真正能挣回其溢价的使用场景。

研究子智能体查询API、学术数据库和内部文档,返回结构化的来源摘要。综合步骤将发现整理为大纲。事实核查子智能体用置信度分数验证陈述。生产团队报告事实核查时间减少约70%、内容产出增加40%——这些数字与可并行读取的最佳点一致。

数据富集子智能体从CRM、Clearbit/Apollo、LinkedIn和网站行为中拉取资料数据——这是真正来自独立来源的并行读取。评分子智能体与ICP对比并给出分数。路由子智能体根据区域和负载将高分线索映射到合适的销售代表。报告显示:转化率提升35%,线索处理时间减少50%。

一线子智能体提取工单类型和情绪,并尝试通过知识库解决。升级子智能体评估结果并路由到合适的专家。handoff子智能体为人工打包上下文。orchestrator模式在这里满足了不相交领域的标准:账单、技术支持和投诉拥有不同的工具和不同的数据访问权限。

并行的采集子智能体——新闻爬虫、金融智能体、社交情绪智能体、竞品网站监控——以真正的fan-out运行。分析子智能体接收四个摘要并识别趋势。报告子智能体起草执行摘要。这是与Anthropic 2025年研究多智能体系统最接近的类比,也是AORCHESTRA 2026年数据最强烈支持的使用场景。

AI的未来不是一个超级智能模型,也不是一个peer collaboration的群体。而是一个拥有上下文的协调器,配以一小组返回摘要的、有纪律的、隔离的工作者。这就是研究所支持的模式,也是FlowHunt致力于让其变得简单的模式。

{{ cta-dark-panel heading=“今天就构建您的第一个多智能体AI系统” description=“FlowHunt的无代码工作流构建器让您轻松创建、测试和部署orchestrator + 子智能体模式。从免费账户开始,在不到一小时内构建您的第一个3智能体流水线。” ctaPrimaryText=“免费试用FlowHunt” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“预约演示” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#3b82f6” gradientEndColor="#8b5cf6” gradientId=“multi-agent-cta” }}

Yasha 是一位才华横溢的软件开发者,专攻 Python、Java 以及机器学习。Yasha 撰写关于人工智能、提示工程和聊天机器人开发的技术文章。

探索2026年顶级AI智能体构建平台,从零代码平台到企业级框架。了解哪些工具最适合你的用例,以及FlowHunt如何提升AI智能体工作流。...

2025年最佳AI智能体构建平台综合指南,涵盖FlowHunt.io、OpenAI和Google Cloud。为开发者和企业用户呈现详细评测、排名与对比。...

随着AI模型的商品化和开源替代品拉平竞争门槛,OpenAI的5000亿美元估值正面临质疑。了解为什么Anthropic以企业为先的战略正在超越OpenAI,成为构建可持续AI商业护城河的赢家。...