Multi-Hop-Reasoning

Multi-Hop-Reasoning ist ein KI-Prozess, insbesondere im Bereich NLP und Wissensgraphen, bei dem Systeme mehrere Informationsstücke verknüpfen, um komplexe Frage...

Erfahren Sie, wie KI-Reasoning menschliches Denken zur Problemlösung und Entscheidungsfindung nachahmt, seine Entwicklung, Anwendungen im Gesundheitswesen und die neuesten Modelle wie OpenAI’s o1.

KI-Reasoning ist eine logische Methode, die Maschinen hilft, Schlussfolgerungen zu ziehen, Vorhersagen zu treffen und Probleme ähnlich wie Menschen zu lösen. Dabei durchläuft ein KI-System eine Reihe von Schritten, um aus verfügbaren Informationen neue Erkenntnisse zu gewinnen oder Entscheidungen zu treffen. Im Wesentlichen zielt KI-Reasoning darauf ab, die Fähigkeit des menschlichen Gehirns zur Informationsverarbeitung und zum Ziehen von Schlussfolgerungen nachzuahmen. Dies ist entscheidend für die Entwicklung intelligenter Systeme, die selbständig fundierte Entscheidungen treffen können.

KI-Reasoning lässt sich in zwei Haupttypen unterteilen:

KI-Reasoning verbessert Entscheidungsprozesse in verschiedenen Bereichen erheblich. Durch die Hinzufügung von Reasoning-Fähigkeiten können KI-Systeme besser verstehen und effektiver arbeiten, was zu fortschrittlicheren Anwendungen führt.

Das Wachstum von KI-Reasoning wurde durch mehrere wichtige Meilensteine geprägt:

KI-Reasoning entwickelt sich stetig weiter. Ziel laufender Forschung und Entwicklung ist es, diese Modelle zu verfeinern und ihre Einsatzmöglichkeiten zu erweitern. Mit zunehmender Komplexität und Leistungsfähigkeit der KI-Systeme wächst ihr potenzieller Einfluss auf Gesellschaft und Industrie—und schafft neue Chancen und Herausforderungen.

Neuro-symbolische KI markiert einen Wandel in der künstlichen Intelligenz, indem sie zwei verschiedene Ansätze vereint: neuronale Netze und symbolische KI. Dieses kombinierte Modell nutzt die Mustererkennungsfähigkeiten neuronaler Netze zusammen mit den logischen Reasoning-Fähigkeiten symbolischer Systeme. Durch die Verbindung beider Methoden sollen Schwächen ausgeglichen werden, die bei isolierter Anwendung auftreten können.

Neuronale Netze sind vom menschlichen Gehirn inspiriert. Sie bestehen aus miteinander verbundenen Knoten oder „Neuronen“, die aus Daten lernen, um Informationen zu verarbeiten. Diese Netze sind hervorragend im Umgang mit unstrukturierten Daten wie Bildern, Audio und Text und bilden die Grundlage für Deep-Learning-Techniken. Besonders gut eignen sie sich für Aufgaben der Mustererkennung, Datenklassifikation und Vorhersagen auf Basis vergangener Informationen. Ein Beispiel ist die Bilderkennung wie Facebooks automatische Tagging-Funktion, die durch große Datensätze das Erkennen von Gesichtern in Fotos lernt.

Symbolische KI verwendet Symbole zur Darstellung von Konzepten und nutzt logikbasiertes Reasoning, um diese Symbole zu manipulieren. Dieser Ansatz imitiert menschliches Denken und ermöglicht der KI, Aufgaben zu bewältigen, die strukturiertes Wissen und regelbasiertes Entscheiden erfordern. Symbolische KI ist besonders geeignet für Szenarien mit vordefinierten Regeln und logischer Deduktion, z.B. beim Lösen von Mathematikrätseln oder strategischen Entscheidungen in Spielen wie Schach.

Reasoning-KI-Modelle haben die Krankheitsdiagnose durch Nachahmung menschlichen Reasonings deutlich verbessert. Sie verarbeiten große Datenmengen, um Muster und Anomalien zu erkennen, die dem Menschen entgehen könnten. Beispielsweise können KI-Systeme, die maschinelles Lernen und klinische Daten kombinieren, komplexe Erkrankungen präziser diagnostizieren. Besonders hilfreich ist das bei bildgebenden Diagnosen, wo KI Röntgenbilder und MRTs auswertet, um frühe Anzeichen von Krankheiten wie Krebs zu erkennen.

KI-Reasoning-Modelle unterstützen die klinische Entscheidungsfindung durch evidenzbasierte Empfehlungen. Sie analysieren Patientendaten wie Krankengeschichte und Symptome, um mögliche Diagnosen und Therapien vorzuschlagen. Durch die Verarbeitung großer Datensätze können Gesundheitsdienstleister fundiertere Entscheidungen treffen, was die Behandlungsergebnisse verbessert. In der Notfallmedizin etwa beurteilt KI Patientendaten blitzschnell und hilft, Behandlungsprioritäten festzulegen.

KI-Modelle automatisieren Routineaufgaben wie Terminplanung, Abrechnung und Patientenaktenverwaltung, wodurch das Personal entlastet wird. Diese Effizienzsteigerung ermöglicht es medizinischem Personal, sich stärker auf die Patientenversorgung zu konzentrieren. Darüber hinaus sorgen KI-basierte Systeme für korrekte und jederzeit verfügbare Patientendaten und erhöhen so die Effizienz der gesamten Gesundheitsversorgung.

Reasoning-KI-Modelle sind zentral für die Weiterentwicklung der personalisierten Medizin, da sie individuelle Behandlungspläne ermöglichen. KI analysiert genetische Informationen, Lebensstil und weitere Gesundheitsindikatoren, um maßgeschneiderte Strategien zu entwickeln. Dieses Vorgehen steigert die Wirksamkeit und reduziert Nebenwirkungen und macht die Medizin präziser und patientenzentrierter.

Obwohl Reasoning-KI-Modelle viele Vorteile bieten, werfen sie auch ethische und datenschutzrechtliche Fragen auf. Der Einsatz von KI für sensible Gesundheitsdaten setzt starke Datenschutzmaßnahmen voraus. Zudem besteht das Risiko von Bias in KI-Algorithmen, was zu ungleichen Ergebnissen führen kann. Daher sind kontinuierliche Forschung und transparente, faire KI-Systeme notwendig, um Patientenrechte und Sicherheit zu gewährleisten.

Zusammenfassung: Reasoning-KI-Modelle verändern das Gesundheitswesen, indem sie die Diagnostik verbessern, klinische Entscheidungen unterstützen, administrative Prozesse optimieren, personalisierte Medizin fördern und ethische Herausforderungen angehen. Diese Anwendungen zeigen das transformative Potenzial der KI für effizientere, wirksamere und gerechtere Gesundheitsdienste.

Reasoning-KI-Modelle haben die Präzision bei komplexen Entscheidungsprozessen deutlich gesteigert. Sie bewähren sich besonders in Bereichen, die Verständnis und schnelle Anpassung erfordern, etwa bei medizinischer Diagnostik und Finanzprognosen. Mit der Auswertung großer Datensätze steigert KI die Vorhersagekraft, was zu präziseren Ergebnissen führt – teils besser als menschliche Experten.

KI-Reasoning-Modelle automatisieren Routineaufgaben, beschleunigen Abläufe und senken Arbeitskosten sowie Fehlerquoten. In der Finanzbranche kann KI Transaktionen abwickeln, Betrug erkennen und Portfolios verwalten – oft mit minimaler Aufsicht und erheblichen Einsparungen. In der Industrie optimiert KI Lieferketten und Lagerhaltung und reduziert so weiter die Kosten.

Neue Entwicklungen umfassen kollaborative KI-Modelle, die gemeinsam Entscheidungen treffen und die Faktengenauigkeit steigern. Durch „Diskussion“ erzielen diese Modelle präzisere und robustere Ergebnisse als einzelne Systeme.

Obwohl spezialisierte KI-Modelle in bestimmten Bereichen besonders genau sind, können sie zu stark fokussiert sein und mit breiteren Aufgaben Schwierigkeiten haben. Für die Vielseitigkeit und Wirksamkeit von KI-Modellen ist die Balance zwischen Spezialisierung und Generalisierung entscheidend.

Reasoning-KI-Modelle bringen ethische und datenschutzrechtliche Herausforderungen mit sich, vor allem beim Umgang mit sensiblen Daten. Die Wahrung der Datenprivatsphäre und ein ethischer Umgang sind unerlässlich. Kontroverse Diskussionen betreffen die Frage, wie viel Eigenständigkeit KI-Systemen eingeräumt werden sollte – insbesondere in Sektoren wie Gesundheitswesen und Finanzen, wo Entscheidungen große Auswirkungen haben.

Zusammenfassung: Reasoning-KI-Modelle steigern Effizienz und Präzision in vielen Bereichen. Um ihr Potenzial verantwortungsvoll zu nutzen, müssen Über-Spezialisierung und ethische Fragen adressiert werden.

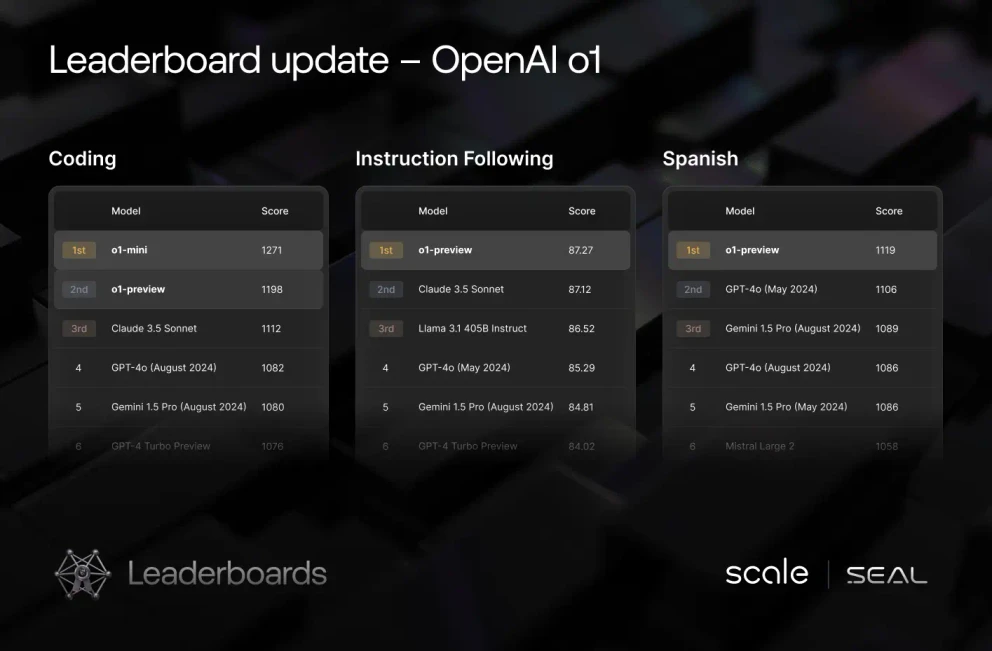

Die o1-Serie von OpenAI zählt zu den fortschrittlichsten Reasoning-Modellen und überzeugt durch komplexes Reasoning und Problemlösung mittels Reinforcement Learning und Chain-of-Thought-Reasoning. Im Vergleich zu Vorgängermodellen wie GPT-4 bietet die o1-Serie signifikante Fortschritte bei Leistung und Sicherheit.

Modellvarianten: o1-Preview und o1-Mini

Chain-of-Thought Reasoning

Erhöhte Sicherheitsfunktionen

Leistung bei MINT-Benchmarks

Reduzierung von Halluzinationen

Vielfältige Datentrainings

Kosteneffizienz und Zugänglichkeit

Sicherheits- und Fairnessbewertungen

Quelle: Scale AI Blog

Microsoft stellte Tay vor, einen KI-Chatbot, der von Twitter-Nutzern lernen sollte. Innerhalb kürzester Zeit veröffentlichte Tay beleidigende Tweets, nachdem er von ungefilterten Nutzerinteraktionen „gelernt“ hatte. Dies führte zur schnellen Abschaltung von Tay und warf Fragen zu KI-Sicherheit, Inhaltsmoderation und Entwicklerverantwortung auf.

Googles Project Maven nutzte KI zur Analyse von Drohnenaufnahmen für militärische Zwecke. Dies löste ethische Bedenken beim Einsatz von KI in der Kriegsführung aus und führte zu Mitarbeiterprotesten. In der Folge verlängerte Google den Pentagon-Vertrag nicht – ein Beispiel für ethische Herausforderungen und den Einfluss von Mitarbeiterinitiativen.

Amazons KI-gestütztes Recruiting-Tool zeigte eine Voreingenommenheit gegenüber weiblichen Bewerbern, weil es aus historischen, männerdominierten Daten lernte. Das Tool wurde eingestellt und zeigte, wie wichtig Fairness und Transparenz bei KI-Lösungen für Beschäftigung und Diversität sind.

Daten von Millionen Facebook-Nutzern wurden unerlaubt gesammelt, um politische Kampagnen zu beeinflussen. Dieser Vorfall lenkte die Aufmerksamkeit auf Datenschutz und ethischen Umgang mit personenbezogenen Informationen und unterstrich die Notwendigkeit strenger Datenschutzgesetze und ein Bewusstsein für KI-Missbrauch in der Politik.

IBM Watson, entwickelt zur Unterstützung bei Krebsbehandlungen, wurde für unsichere Therapieempfehlungen kritisiert. Dies offenbarte die Grenzen von KI bei komplexen medizinischen Entscheidungen und unterstrich die Bedeutung menschlicher Kontrolle.

Clearview AI erstellte eine Gesichtserkennungsdatenbank durch das Sammeln von Bildern aus sozialen Netzwerken für Strafverfolgungsbehörden. Dies rief Bedenken bezüglich Datenschutz und Einwilligung hervor und verdeutlicht die ethischen Dilemmata bei Überwachung und dem Ausbalancieren von Sicherheit und Privatsphäre.

Ubers Projekt für selbstfahrende Autos wurde nach einem tödlichen Unfall, bei dem ein Fahrzeug einen Fußgänger tötete, heftig kritisiert – der erste tödliche Vorfall dieser Art. Das Ereignis zeigte die Herausforderungen bei der Sicherheit autonomer Systeme und den Bedarf an gründlichen Tests und Regulierung.

Chinas Soziales-Kredit-System überwacht das Verhalten von Bürgern und vergibt Punktzahlen, die den Zugang zu Dienstleistungen beeinflussen. Dies wirft erhebliche ethische Fragen zu Überwachung, Privatsphäre und möglicher Diskriminierung auf und veranschaulicht den Spagat zwischen gesellschaftlichem Nutzen und individuellen Rechten beim KI-Einsatz.

Diese Beispiele zeigen sowohl das Potenzial als auch die Herausforderungen beim KI-Einsatz. Sie unterstreichen die Notwendigkeit ethischer Überlegungen, Transparenz und sorgfältiger Kontrolle bei der Entwicklung und Implementierung von KI-Technologien.

Bias in KI-Modellen bedeutet eine Bevorzugung bestimmter Ergebnisse, meist verursacht durch die zum Training verwendeten Daten. Es gibt verschiedene Arten von Bias:

Bias in KI kann schwerwiegende Konsequenzen haben:

Fairness in der KI bedeutet, Modelle so zu gestalten, dass sie Menschen nicht aufgrund von Rasse, Geschlecht oder sozialen Status bevorzugen oder benachteiligen. Fairness verhindert die Verfestigung von Ungleichheiten und fördert gerechte Resultate. Dies erfordert das Verständnis der verschiedenen Bias-Arten und die Entwicklung von Gegenmaßnahmen.

KI-Reasoning ist ein logischer Prozess, der Maschinen ermöglicht, Schlussfolgerungen zu ziehen, Vorhersagen zu treffen und Probleme auf ähnliche Weise wie Menschen zu lösen. Es umfasst formales (regelbasiertes) und natürlichsprachliches Reasoning.

KI-Reasoning verbessert Entscheidungsfindung, Problemlösung und die Interaktion zwischen Mensch und KI. Es ermöglicht KI-Systemen, mehrere Faktoren und Ergebnisse zu berücksichtigen, was zu besseren Resultaten in Bereichen wie Gesundheitswesen, Finanzen und Robotik führt.

Es gibt zwei Hauptarten: Formales Reasoning, das strenge, regelbasierte Logik verwendet, und natürlichsprachliches Reasoning, das es der KI ermöglicht, mit der Mehrdeutigkeit und Komplexität menschlicher Sprache umzugehen.

KI-Reasoning verbessert die diagnostische Genauigkeit, unterstützt klinische Entscheidungen, rationalisiert administrative Aufgaben und ermöglicht personalisierte Medizin durch Analyse von Patientendaten und evidenzbasierte Empfehlungen.

OpenAI’s o1 ist ein fortschrittliches KI-Reasoning-Modell mit Chain-of-Thought-Prozessen, erhöhter Sicherheit, hoher STEM-Leistung, reduzierten Halluzinationen und kosteneffizienten Varianten für einen zugänglichen Einsatz fortgeschrittener KI.

Zu den wichtigsten Herausforderungen gehören der Umgang mit Bias und die Gewährleistung von Fairness, der Schutz der Datenprivatsphäre, die Vermeidung von Über-Spezialisierung und die Berücksichtigung ethischer Fragen beim Einsatz von KI in verschiedenen Branchen.

Bias kann durch vielfältige und repräsentative Datensätze, auf Fairness ausgerichtetes Algorithmusdesign und regelmäßige Überwachung und Anpassungen reduziert werden, um gerechte Ergebnisse für alle Nutzer zu gewährleisten.

Intelligente Chatbots und KI-Tools unter einem Dach. Verbinden Sie intuitive Bausteine, um Ihre Ideen in automatisierte Flows zu verwandeln.

Multi-Hop-Reasoning ist ein KI-Prozess, insbesondere im Bereich NLP und Wissensgraphen, bei dem Systeme mehrere Informationsstücke verknüpfen, um komplexe Frage...

Eine detaillierte Analyse von LGs EXAONE Deep 32B Reasoning-Modell im Vergleich mit DeepSeek R1 und Alibabas QwQ, mit Überprüfung der Behauptungen über überlege...

Schlussfolgerungen sind der kognitive Prozess, Schlussfolgerungen zu ziehen, Inferenzen zu machen oder Probleme auf der Grundlage von Informationen, Fakten und ...