LLM Gemini

FlowHunt es compatible con docenas de modelos de IA, incluyendo Google Gemini. Aprende a usar Gemini en tus herramientas y chatbots de IA, alterna entre modelos...

LLM DeepSeek de FlowHunt te permite acceder y personalizar los mejores modelos de IA como DeepSeek R1 para la generación de texto e imágenes en tus chatbots y herramientas de IA, todo desde un solo panel.

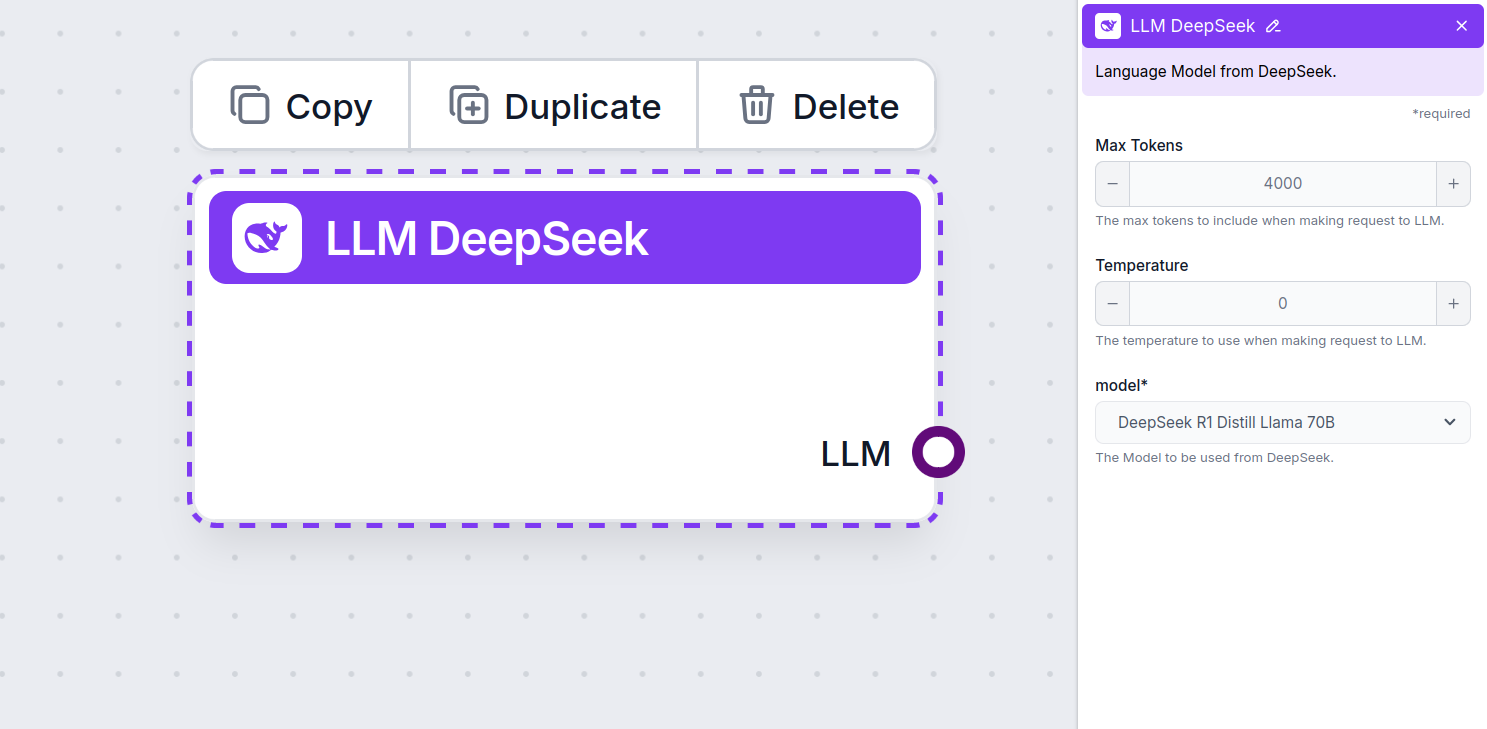

Descripción del componente

The LLM DeepSeek component connects the DeepSeek models to your Flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to swap and control the model used.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported DeepSeek models. We support all the latest Gemini models:

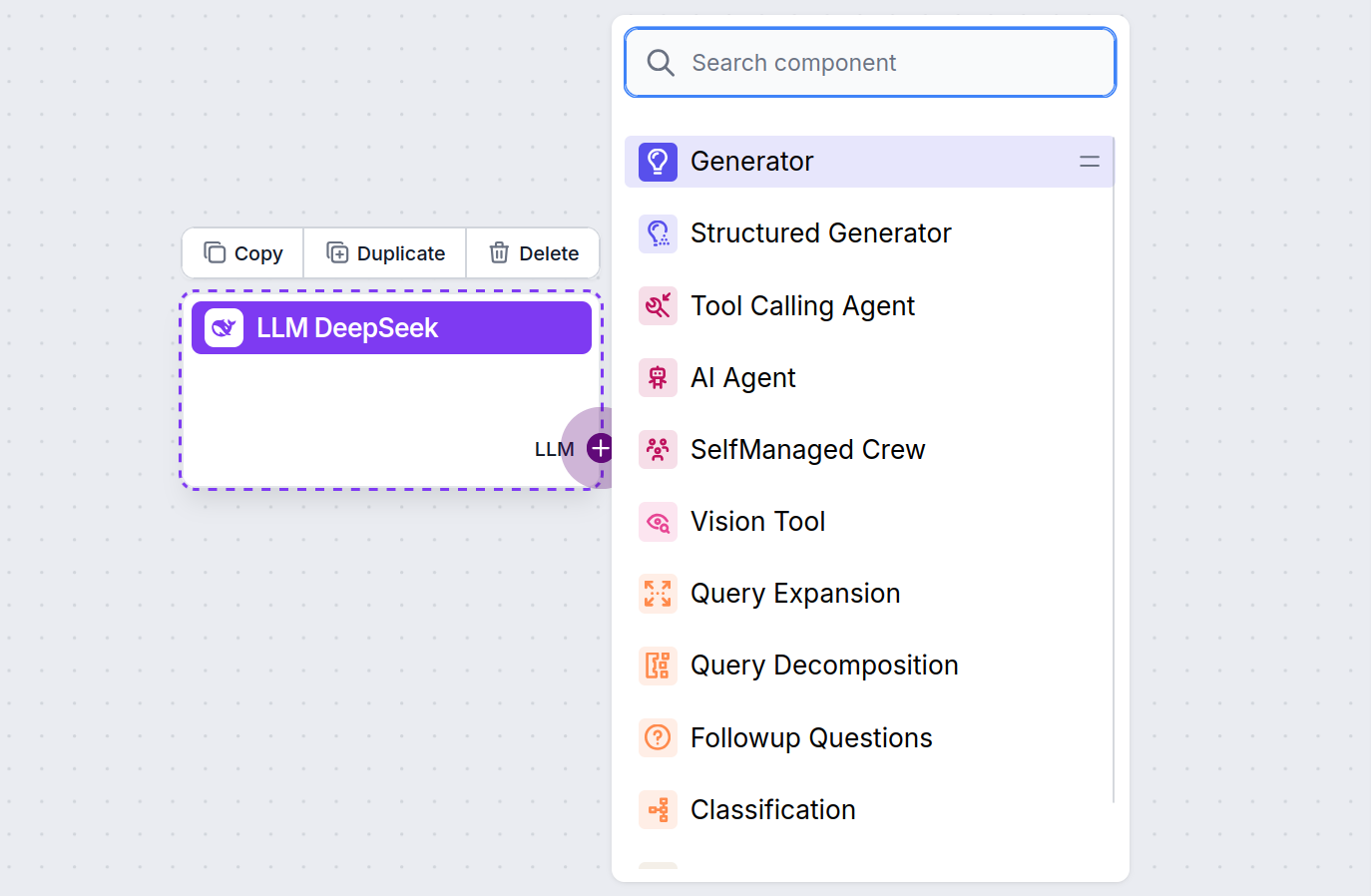

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

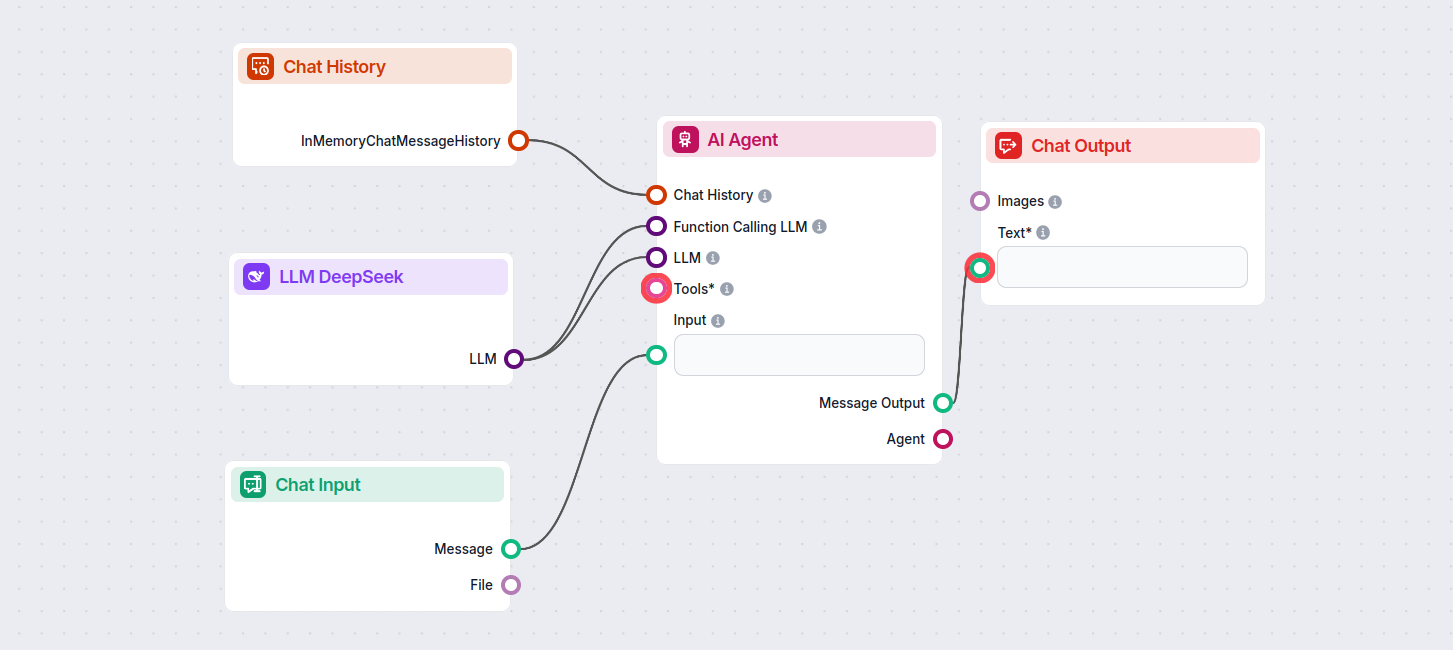

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow using DeepSeek R1 to generate responses. You can think of it as a basic DeepSeek chatbot.

This simple Chatbot Flow includes:

LLM DeepSeek es un componente en FlowHunt que te permite conectar y controlar modelos de IA DeepSeek para generación de texto e imágenes, habilitando chatbots potentes y flujos automatizados.

FlowHunt es compatible con todos los modelos DeepSeek más recientes, incluido DeepSeek R1, conocido por su velocidad y rendimiento, especialmente en comparación con otros modelos líderes de IA.

Puedes ajustar el máximo de tokens para la longitud de la respuesta y la temperatura para la creatividad, así como cambiar entre los modelos DeepSeek disponibles directamente desde tu panel de FlowHunt.

No, conectar un componente LLM es opcional. Por defecto, FlowHunt utiliza ChatGPT-4o, pero añadir LLM DeepSeek te permite alternar y controlar qué modelo de IA impulsa tus flujos.

Comienza a crear chatbots de IA y herramientas de automatización más inteligentes usando los avanzados modelos DeepSeek—todo sin configuraciones complejas ni múltiples suscripciones.

FlowHunt es compatible con docenas de modelos de IA, incluyendo Google Gemini. Aprende a usar Gemini en tus herramientas y chatbots de IA, alterna entre modelos...

FlowHunt admite docenas de modelos de generación de texto, incluidos los modelos de xAI. Aquí te mostramos cómo usar los modelos de xAI en tus herramientas y ch...

FlowHunt es compatible con docenas de modelos de generación de texto, incluidos los modelos Llama de Meta. Aprende cómo integrar Llama en tus herramientas y cha...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.