Bard AI Chatbot: ¿Qué empresa lo desarrolló?

Descubre qué empresa desarrolló el chatbot Bard AI. Conoce el LLM Gemini de Google, sus características, capacidades y cómo se compara con ChatGPT en 2025.

Descubre qué es Google Gemini, cómo funciona y cómo se compara con ChatGPT. Conoce sus capacidades multimodales, precios y aplicaciones reales para 2025.

Google Gemini es un chatbot de IA multimodal y un gran modelo de lenguaje desarrollado por Google DeepMind que puede procesar y generar texto, imágenes, audio y video. Lanzado en diciembre de 2023 y renombrado de Bard en febrero de 2024, Gemini impulsa el asistente de IA de Google en teléfonos Pixel, la Búsqueda de Google y las aplicaciones de Workspace.

Google Gemini representa un avance significativo en la tecnología de inteligencia artificial, cambiando fundamentalmente la forma en que los usuarios interactúan con herramientas impulsadas por IA. Lanzado originalmente como Bard en marzo de 2023, Google renombró su asistente de IA como Gemini en febrero de 2024, reflejando el gran modelo de lenguaje (LLM) que impulsa la plataforma. Gemini no es solo un chatbot simple—es una sofisticada familia de modelos de IA multimodal desarrollada por Google DeepMind que puede comprender y generar contenido en múltiples tipos de datos simultáneamente. Esta capacidad revolucionaria distingue a Gemini de herramientas de IA de generaciones anteriores que se enfocaban principalmente en interacciones basadas en texto. La plataforma se ha integrado en todo el ecosistema de Google, desde smartphones Pixel hasta la Búsqueda de Google y las aplicaciones de Workspace, convirtiéndola en uno de los asistentes de IA más accesibles para consumidores y empresas a nivel mundial.

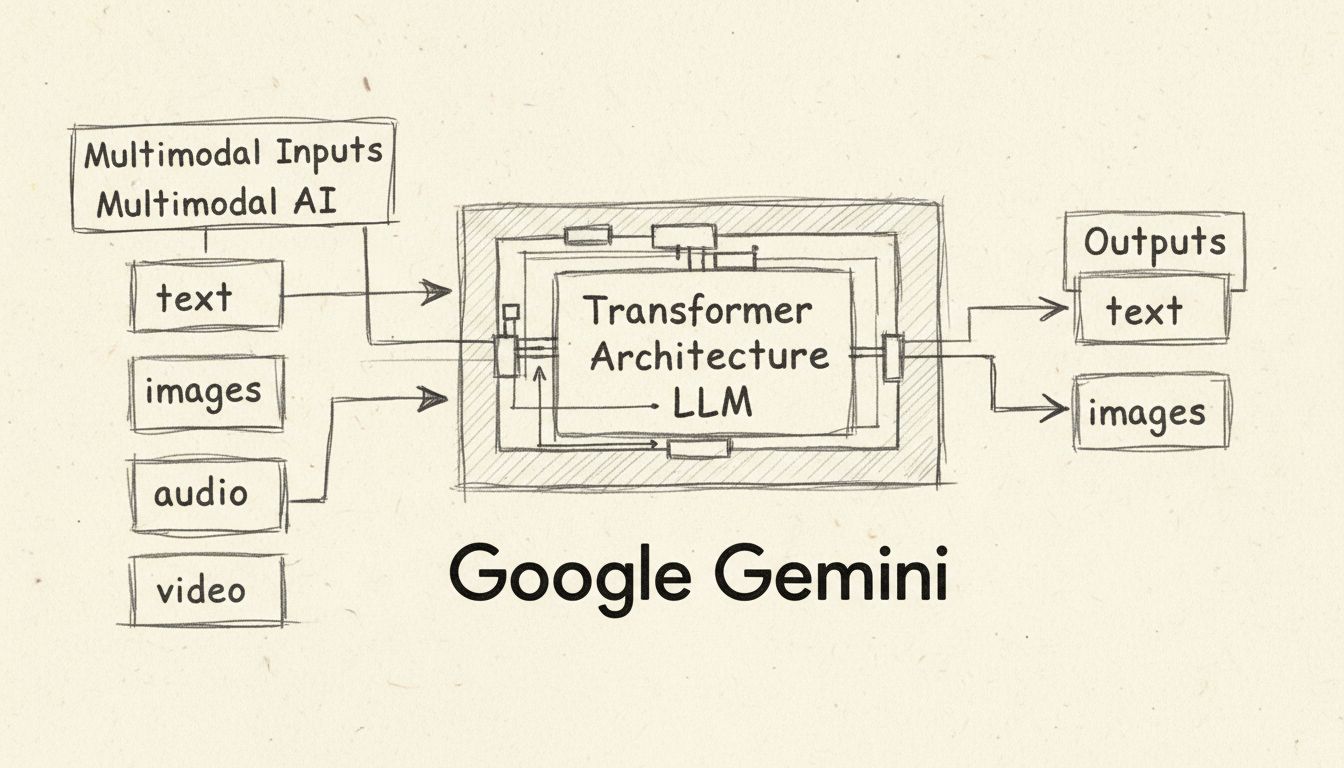

La característica definitoria de Gemini es su arquitectura multimodal, lo que significa que puede procesar y generar varios tipos de datos al mismo tiempo. A diferencia de ChatGPT, que maneja principalmente entradas y salidas de texto, Gemini admite de forma nativa texto, imágenes, audio y video tanto como entradas como salidas. Esta capacidad multimodal permite que Gemini comprenda información visual compleja como gráficos, diagramas y fotografías sin requerir herramientas externas de reconocimiento óptico de caracteres (OCR). El modelo puede analizar notas manuscritas, gráficos y dibujos técnicos para resolver problemas complejos que requerirían múltiples herramientas especializadas en flujos de trabajo tradicionales. Además, Gemini admite procesamiento de audio en más de 100 idiomas, permitiendo reconocimiento de voz y traducción en tiempo real. La función de comprensión de video permite a Gemini procesar fotogramas de video y responder preguntas sobre el contenido, siendo invaluable para análisis y tareas de resumen de contenido audiovisual.

La arquitectura de red neuronal basada en transformers que impulsa a Gemini ha sido específicamente mejorada para manejar secuencias contextuales largas en diferentes tipos de datos. Google DeepMind implementó mecanismos de atención eficientes en el decodificador transformer para ayudar a los modelos a procesar contextos extendidos, con algunas versiones admitiendo hasta 2 millones de tokens—significativamente más que el límite de 128,000 tokens de ChatGPT. Esta ventana de contexto ampliada permite a Gemini analizar libros completos, informes extensos y miles de líneas de código en una sola interacción, proporcionando respuestas más completas y conscientes del contexto.

Google ofrece varias versiones de Gemini, cada una optimizada para casos de uso y entornos de implementación específicos. Comprender estas variantes es crucial para seleccionar el modelo adecuado para tus requerimientos. Gemini 1.0 Nano es la versión más pequeña, diseñada para aplicaciones móviles en el dispositivo, capaz de ejecutarse en dispositivos Android como el Pixel 8 Pro sin requerir conexión a internet. Nano puede describir imágenes, sugerir respuestas en el chat, resumir texto y transcribir voz directamente en tu dispositivo. Gemini 1.0 Ultra representa la versión más potente de la primera generación, construida para tareas altamente complejas como programación avanzada, razonamiento matemático y razonamiento multimodal sofisticado. Ambas versiones, Nano y Ultra, disponen de una ventana de contexto de 32,000 tokens.

La nueva Gemini 1.5 Pro es un modelo multimodal de tamaño medio que logra un excelente equilibrio entre capacidad y eficiencia, con una impresionante ventana de contexto de 2 millones de tokens. Esta versión emplea una arquitectura de Mixture of Experts (MoE), donde el modelo se divide en redes neuronales especializadas más pequeñas que se activan selectivamente según el tipo de entrada, resultando en un rendimiento más rápido y menores costos computacionales. Gemini 1.5 Flash es una versión ligera creada mediante destilación de conocimiento, transfiriendo conocimientos de Gemini 1.5 Pro para crear un modelo más compacto y eficiente. Flash mantiene una ventana de contexto de 1 millón de tokens, ofreciendo menor latencia, lo que la hace ideal para aplicaciones que requieren velocidad y eficiencia. La más reciente Gemini 2.0 Flash, lanzada en diciembre de 2024, es el doble de rápida que la 1.5 Pro e incluye nuevas capacidades como entrada y salida multimodal, comprensión de contexto largo y aplicaciones nativas de streaming de audio.

| Versión del modelo | Ventana de contexto | Mejor para | Características clave |

|---|---|---|---|

| Gemini 1.0 Nano | 32,000 tokens | Tareas móviles en el dispositivo | Ligero, no requiere internet |

| Gemini 1.0 Ultra | 32,000 tokens | Razonamiento complejo y programación | Modelo más potente de la primera generación |

| Gemini 1.5 Pro | 2 millones de tokens | Aplicaciones empresariales | Arquitectura Mixture of Experts |

| Gemini 1.5 Flash | 1 millón de tokens | Aplicaciones críticas en velocidad | Destilado de conocimiento, menor latencia |

| Gemini 2.0 Flash | Contexto extendido | Aplicaciones más recientes | 2x más rápido, streaming multimodal |

Gemini opera usando una arquitectura de modelo transformer, un diseño de red neuronal que Google mismo presentó en 2017. El sistema funciona a través de tres mecanismos principales: los codificadores transforman las secuencias de entrada en representaciones numéricas llamadas embeddings que capturan el significado semántico y la posición de los tokens; un mecanismo de auto-atención permite que el modelo se enfoque en los tokens más importantes sin importar su posición en la secuencia; y los decodificadores usan este mecanismo de atención y los embeddings del codificador para generar la secuencia de salida más probable estadísticamente. A diferencia de los modelos GPT tradicionales que solo procesan indicaciones basadas en texto, Gemini admite secuencias intercaladas de audio, imágenes, texto y video como entradas, y puede producir salidas intercaladas de texto e imagen.

El proceso de entrenamiento de Gemini involucró enormes conjuntos de datos multilingües y multimodales que abarcan texto, imágenes, audio y video. Google DeepMind aplicó avanzadas técnicas de filtrado de datos para optimizar la calidad del entrenamiento y asegurar que el modelo aprendiera de fuentes de información diversas y de alta calidad. Durante las fases de entrenamiento e inferencia, Gemini se beneficia de los chips de última generación de Google, las unidades de procesamiento tensorial Trillium (sexta generación de Google Cloud TPU), que proporcionan mejor rendimiento, menor latencia y menores costos en comparación con generaciones anteriores. Estos procesadores especializados son mucho más eficientes energéticamente que versiones anteriores, haciendo que Gemini sea más sostenible y rentable para operar a gran escala.

Google ha integrado estratégicamente Gemini en toda su suite de productos, haciendo que la asistencia por IA esté disponible en herramientas cotidianas. En teléfonos Google Pixel, Gemini es el asistente de IA predeterminado, reemplazando a Google Assistant. Los usuarios pueden activar Gemini sobre cualquier aplicación, incluido Chrome, para hacer preguntas sobre lo que aparece en su pantalla, resumir páginas web u obtener información de imágenes. El Pixel 8 Pro fue el primer dispositivo diseñado para ejecutar Gemini Nano, permitiendo procesamiento de IA en el dispositivo sin necesidad de conectividad en la nube. En la Búsqueda de Google, Gemini impulsa las AI Overviews, que proporcionan respuestas detalladas y ricas en contexto en la parte superior de los resultados de búsqueda. Estas vistas generales desglosan temas complejos en explicaciones sencillas, ayudando a los usuarios a comprender rápidamente temas difíciles. Los usuarios de 13 años en adelante en EE. UU. pueden acceder a AI Overviews, con disponibilidad ampliándose a mayores de 18 años en países como Reino Unido, India, México, Brasil, Indonesia y Japón.

En Google Workspace, Gemini aparece en el panel lateral de Docs para ayudar a escribir y editar contenido, en Gmail para redactar correos electrónicos y sugerir respuestas, y en otras aplicaciones como Google Maps para proporcionar resúmenes de lugares y zonas. Los desarrolladores de Android pueden construir con Gemini Nano a través de la capacidad AICore del sistema operativo Android, permitiendo crear aplicaciones inteligentes con procesamiento de IA en el dispositivo. El servicio Vertex AI de Google Cloud ofrece acceso a Gemini Pro para desarrolladores que crean aplicaciones personalizadas, mientras que Google AI Studio brinda una herramienta web para prototipar y desarrollar aplicaciones con Gemini.

Gemini ofrece opciones de precios flexibles para adaptarse a diferentes necesidades y presupuestos. El nivel gratuito brinda acceso a Gemini con el modelo 1.5 Flash y una ventana de contexto de 32,000 tokens, ideal para usuarios cotidianos y quienes exploran capacidades de IA. Los usuarios deben tener al menos 13 años (18 en Europa) y una cuenta personal de Google para acceder a la versión gratuita. Gemini Advanced cuesta $20 al mes y da acceso al modelo 1.5 Pro más potente con su ventana de contexto de 2 millones de tokens, junto con funciones avanzadas como Deep Research, generación de imágenes con Nano Banana Pro y creación de videos. Esta suscripción también incluye 100 puntos de crédito de IA mensuales para generación de video en Flow y Whisk.

Para empresas, Google ofrece Gemini Business a $20 por usuario al mes (en planes anuales) o $24 al mes (pago mensual), diseñado para pequeñas y medianas empresas. Gemini Enterprise cuesta $30 por usuario al mes en planes anuales, con precios personalizados disponibles a través del equipo de ventas de Google para implementaciones de mayor escala. Los desarrolladores pueden acceder a Gemini mediante el nivel gratuito de API con uso limitado, permitiéndoles probar y prototipar antes de comprometerse con planes de pago. La suscripción Google AI Pro a $21.99 al mes proporciona acceso completo a Gemini 3 Pro, Deep Research y generación de video con Veo 3.1, mientras que el nivel Google AI Ultra a $274.99 al mes ofrece el acceso máximo a todas las funciones, incluyendo Deep Think y capacidades de Gemini Agent.

Al comparar Gemini con ChatGPT, surgen varias diferencias clave que afectan su idoneidad para distintas aplicaciones. Las capacidades multimodales representan una diferencia significativa—Gemini fue construido desde cero como un modelo multimodal, admitiendo texto, imágenes, audio y video, mientras que ChatGPT se enfocó originalmente en texto y solo después añadió soporte de imágenes con GPT-4. La longitud de la ventana de contexto es otro diferenciador crucial, ya que Gemini 1.5 Pro admite 2 millones de tokens frente al límite de 128,000 tokens de ChatGPT, lo que permite que Gemini procese mucha más información en una sola interacción. La disponibilidad para desarrolladores difiere substancialmente, ya que ChatGPT está disponible a través de la API de OpenAI y ha sido licenciado a Microsoft para su integración en Bing, mientras que Gemini está principalmente disponible a través del ecosistema y servicios de Google.

En cuanto a pruebas de rendimiento, Gemini Ultra supera a ChatGPT en varias áreas, incluyendo GSM8K para razonamiento matemático, HumanEval para generación de código y MMLU para comprensión del lenguaje natural, donde Gemini Ultra incluso superó a expertos humanos. Sin embargo, ChatGPT aún se desempeña mejor en el benchmark HellaSwag para razonamiento de sentido común e inferencia en lenguaje natural. La profundidad de integración favorece a Gemini para los usuarios del ecosistema de Google, ya que está profundamente integrado en la Búsqueda, Workspace y dispositivos Pixel, mientras que ChatGPT requiere acceso por separado a través de la plataforma de OpenAI o la integración de Microsoft Bing. Ambas plataformas presentan preocupaciones similares respecto a las alucinaciones y el sesgo, aunque ambas compañías han implementado medidas de seguridad para mitigar estos riesgos.

Las versátiles capacidades de Gemini habilitan numerosas aplicaciones prácticas en diferentes industrias y casos de uso. En desarrollo de software, Gemini puede comprender, explicar y generar código en lenguajes populares como Python, Java, C++ y Go. El sistema AlphaCode 2 de Google utiliza una versión personalizada de Gemini Pro para resolver problemas de programación competitiva que involucran ciencia computacional teórica y matemáticas complejas. Para creación y análisis de contenido, Gemini puede resumir documentos extensos, generar contenido creativo y analizar materiales visuales sin herramientas externas. La capacidad de análisis de malware permite a los profesionales de seguridad usar Gemini 1.5 Pro para determinar con precisión si archivos o fragmentos de código son maliciosos y generar informes detallados, mientras que Gemini Flash habilita un análisis de malware rápido y a gran escala.

La traducción de idiomas aprovecha las capacidades multilingües de Gemini para traducir entre más de 100 idiomas con precisión casi humana. En educación, Gemini asiste a los estudiantes desglosando temas complejos, creando materiales de estudio y brindando apoyo de aprendizaje personalizado mediante la función Learning Coach Gem. Las aplicaciones de inteligencia empresarial se benefician de la capacidad de Gemini para analizar gráficos, diagramas y visuales complejos para extraer información de datos de negocio. La función Gems permite a los usuarios crear expertos de IA personalizados sobre cualquier tema, con opciones prediseñadas como coach de aprendizaje, socio para brainstorming y editor de escritura. Project Astra, la iniciativa de agente de IA universal de Google, se basa en modelos Gemini para crear agentes capaces de procesar, recordar y comprender información multimodal en tiempo real, demostrando potencial para asistentes de IA autónomos.

A pesar de sus avanzadas capacidades, Gemini enfrenta varias limitaciones importantes que los usuarios deben conocer. Las alucinaciones de IA siguen siendo una preocupación, donde Gemini ocasionalmente genera información incorrecta y la presenta como verdadera. Este problema ha sido especialmente notable en los resultados AI Overviews de búsqueda, donde a veces el sistema ha dado consejos extraños o inexactos. El sesgo en los datos de entrenamiento puede llevar a salidas sesgadas si los datos excluyen ciertos grupos demográficos o contienen sesgos inherentes. En febrero de 2024, Google pausó la generación de imágenes de Gemini después de que el sistema produjera retratos inexactos de figuras históricas y mostró sesgo racial al presentar soldados nazis negros y asiáticos, lo que Google corrigió posteriormente.

Las limitaciones en la comprensión del contexto implican que Gemini a veces no capta completamente la sutileza y el contexto de indicaciones complejas, resultando en respuestas que pueden no ser del todo relevantes para las consultas del usuario. Existen restricciones de originalidad y creatividad, especialmente en la versión gratuita, que tiene dificultades con indicaciones complicadas de varios pasos y razonamiento matizado. Han surgido preocupaciones sobre la propiedad intelectual, con Google enfrentando multas regulatorias en Francia por entrenar a Gemini con noticias y contenido sin el conocimiento o consentimiento de los editores. La actualidad de los datos de entrenamiento es otra limitación, ya que el conocimiento de Gemini tiene una fecha de corte y puede no incluir los desarrollos o eventos más recientes. Los usuarios deben verificar información crítica en fuentes autorizadas en lugar de depender únicamente de las respuestas de Gemini, especialmente para aplicaciones sensibles.

Google continúa mejorando las capacidades de Gemini con actualizaciones y nuevas funciones regulares. El lanzamiento de Gemini 2.0 Flash en diciembre de 2024 demostró notables mejoras en rendimiento, con el modelo funcionando el doble de rápido que la 1.5 Pro manteniendo la calidad. Gemini Live permite conversaciones naturales y manos libres con el asistente de IA, ofreciendo 10 opciones de voz y la posibilidad de pausar y reanudar las conversaciones de forma fluida. La función Deep Research permite a los usuarios buscar en cientos de sitios web, analizar hallazgos y generar informes completos, funcionando como un asistente de investigación personalizado. Canvas proporciona un espacio colaborativo para escribir y programar proyectos, mientras que Gems permite crear expertos de IA especializados para tareas o dominios específicos.

De cara al futuro, Google planea expandir la disponibilidad de Gemini a nivel global, con el objetivo de llegar a más de mil millones de usuarios para finales de 2025. La compañía también está desarrollando versiones más especializadas de Gemini para industrias y casos de uso concretos, incluyendo capacidades mejoradas para salud, finanzas e investigación científica. Se espera que la integración con tecnologías emergentes como la realidad aumentada y la robótica avanzada cree nuevas posibilidades para flujos de trabajo asistidos por IA. Para empresas que buscan aprovechar la automatización con IA a gran escala, plataformas como FlowHunt ofrecen soluciones de nivel empresarial para integrar Gemini y otros modelos de IA en flujos de trabajo automatizados, permitiendo a las organizaciones maximizar el valor de la tecnología de IA mientras mantienen el control y la seguridad sobre sus procesos.

FlowHunt es la principal plataforma de automatización con IA que te ayuda a crear, implementar y gestionar flujos de trabajo inteligentes. A diferencia de otras herramientas de IA, FlowHunt ofrece capacidades de automatización de nivel empresarial para integrar Gemini y otros modelos de IA en los procesos de tu negocio sin complicaciones.

Descubre qué empresa desarrolló el chatbot Bard AI. Conoce el LLM Gemini de Google, sus características, capacidades y cómo se compara con ChatGPT en 2025.

Descubre los anuncios clave de Google I/O 2025, incluyendo Gemini 2.5 Flash, Project Astra, Android XR, agentes de IA en Android Studio, Gemini Nano, Gemma 3n, ...

Gemini Flash 2.0 está estableciendo nuevos estándares en IA con un rendimiento mejorado, velocidad y capacidades multimodales. Explora su potencial en aplicacio...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.