LLM Gemini

FlowHunt prend en charge des dizaines de modèles d'IA, y compris Google Gemini. Découvrez comment utiliser Gemini dans vos outils d'IA et chatbots, passer d'un ...

LLM DeepSeek par FlowHunt vous permet d’accéder et de personnaliser les meilleurs modèles d’IA comme DeepSeek R1 pour la génération de texte et d’image dans vos chatbots et outils d’IA, le tout depuis un tableau de bord unique.

Description du composant

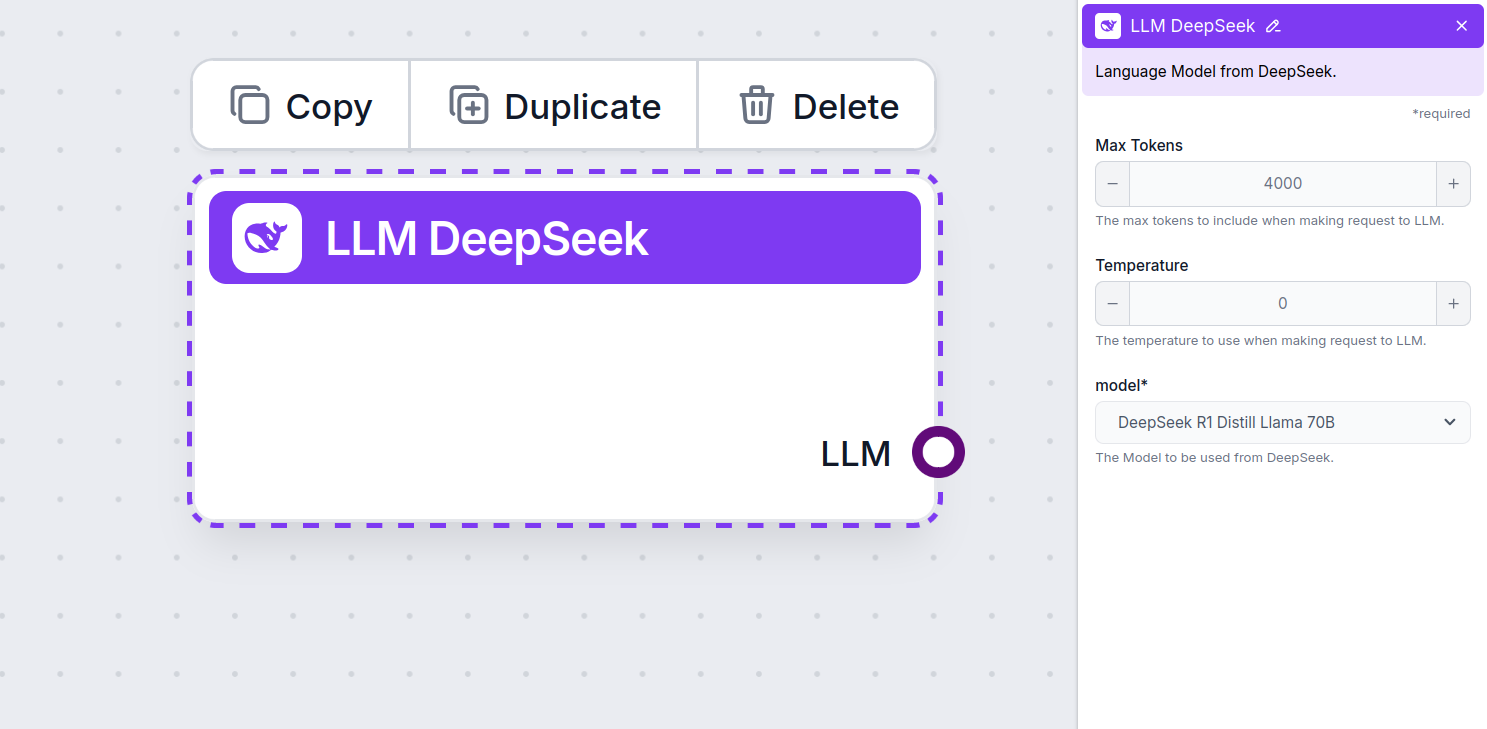

The LLM DeepSeek component connects the DeepSeek models to your Flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to swap and control the model used.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported DeepSeek models. We support all the latest Gemini models:

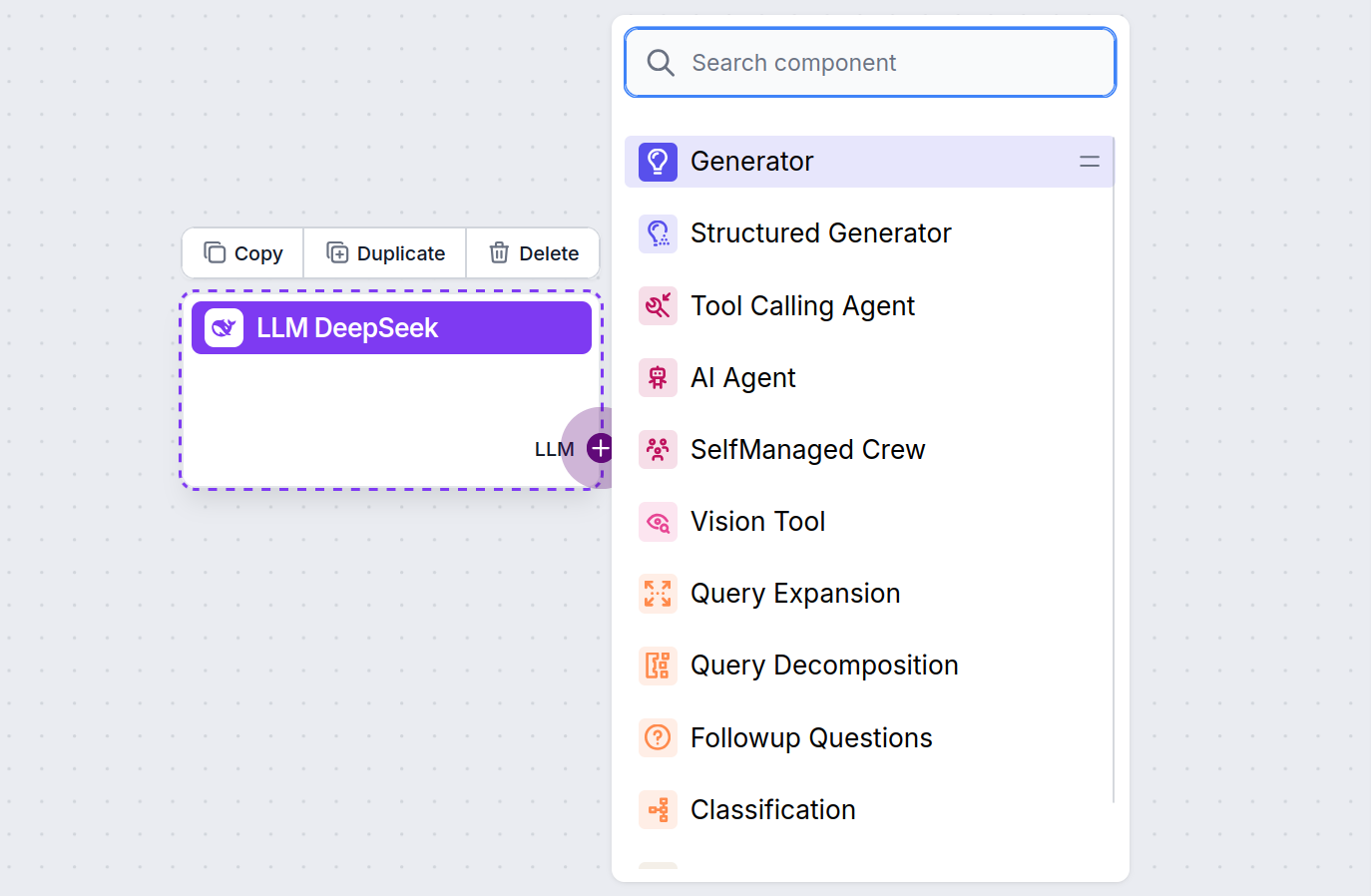

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

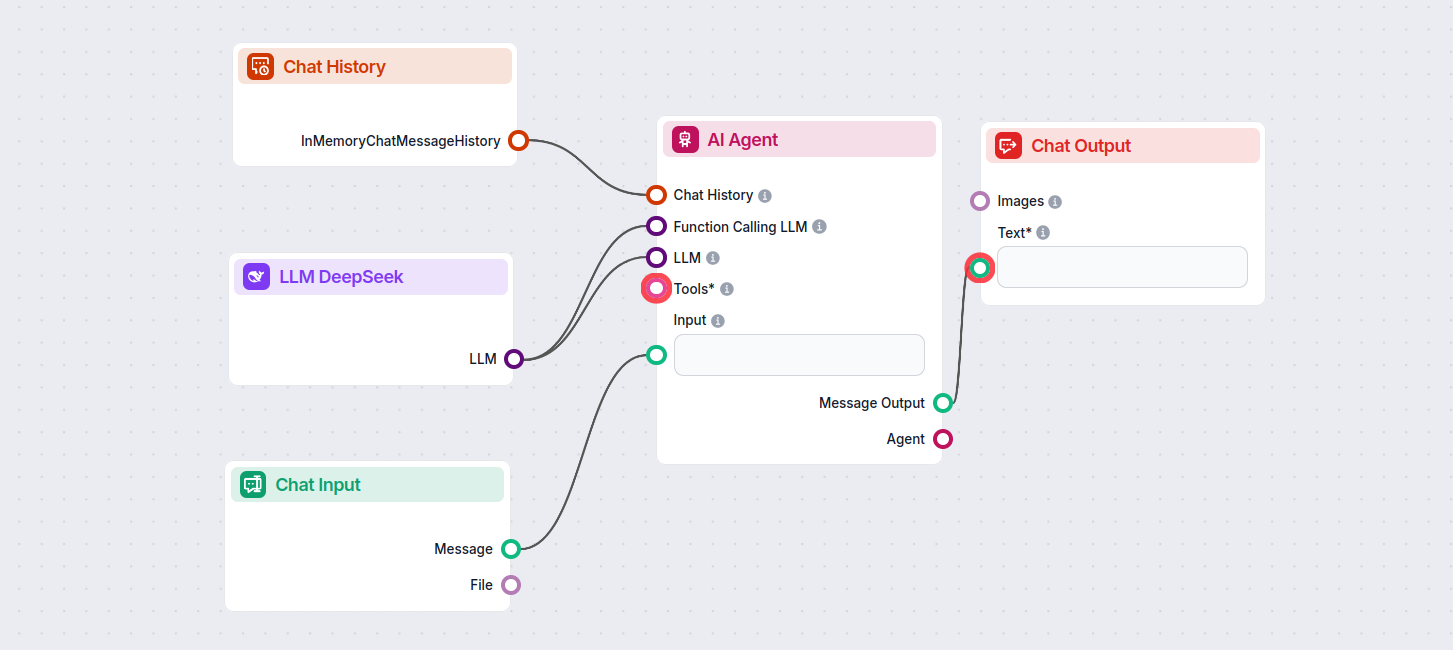

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow using DeepSeek R1 to generate responses. You can think of it as a basic DeepSeek chatbot.

This simple Chatbot Flow includes:

LLM DeepSeek est un composant dans FlowHunt qui vous permet de connecter et contrôler les modèles d'IA DeepSeek pour la génération de texte et d'image, permettant des chatbots puissants et des flux automatisés.

FlowHunt prend en charge tous les derniers modèles DeepSeek, y compris DeepSeek R1, connu pour sa rapidité et ses performances, surtout comparé à d'autres modèles d'IA leaders.

Vous pouvez ajuster le nombre maximal de tokens pour la longueur des réponses et la température pour la créativité, ainsi qu'alterner entre les modèles DeepSeek disponibles directement dans votre tableau de bord FlowHunt.

Non, connecter un composant LLM est optionnel. Par défaut, FlowHunt utilise ChatGPT-4o, mais ajouter LLM DeepSeek vous permet d'alterner et de contrôler quel modèle d'IA alimente vos flux.

Commencez à créer des chatbots d'IA et des outils d'automatisation plus intelligents en utilisant des modèles DeepSeek avancés—le tout sans configuration complexe ni abonnements multiples.

FlowHunt prend en charge des dizaines de modèles d'IA, y compris Google Gemini. Découvrez comment utiliser Gemini dans vos outils d'IA et chatbots, passer d'un ...

FlowHunt prend en charge des dizaines de modèles de génération de texte, y compris ceux de xAI. Voici comment utiliser les modèles xAI dans vos outils et chatbo...

FlowHunt prend en charge des dizaines de modèles de génération de texte, y compris les modèles Llama de Meta. Découvrez comment intégrer Llama dans vos outils e...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.