Analyse d'entreprise par IA exportée vers Google Sheets

Ce workflow alimenté par l'IA fournit une analyse d'entreprise complète et fondée sur les données. Il rassemble des informations sur l'historique de l'entrepris...

Libérez la puissance des modèles Gemini de Google dans FlowHunt—changez de modèle d’IA, contrôlez les réglages et créez des chatbots IA plus intelligents en toute simplicité.

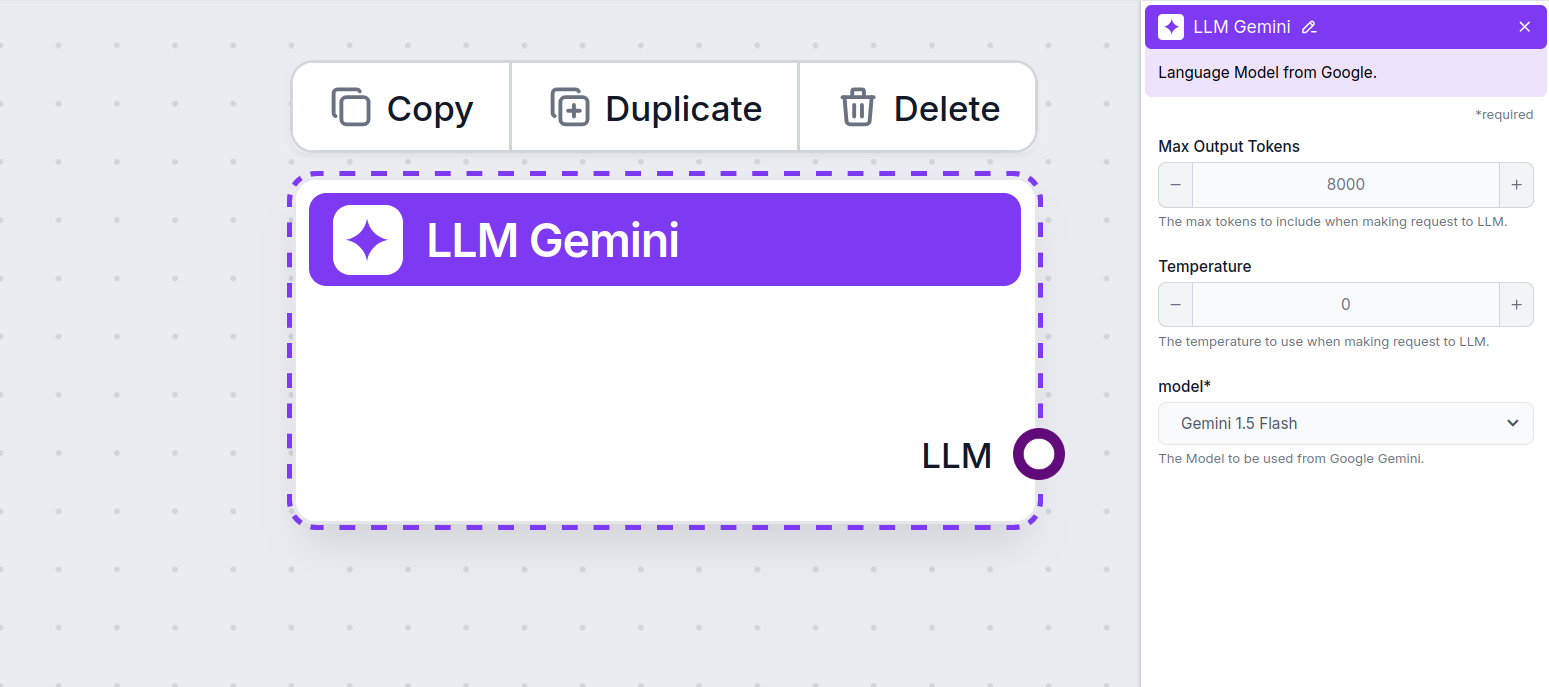

Description du composant

The LLM Gemini component connects the Gemini models from Google to your flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to control the model used. All components come with ChatGPT-4 by default. You can connect this component if you wish to change the model or gain more control over it.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported Gemini models from Google. We support all the latest Gemini models:

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

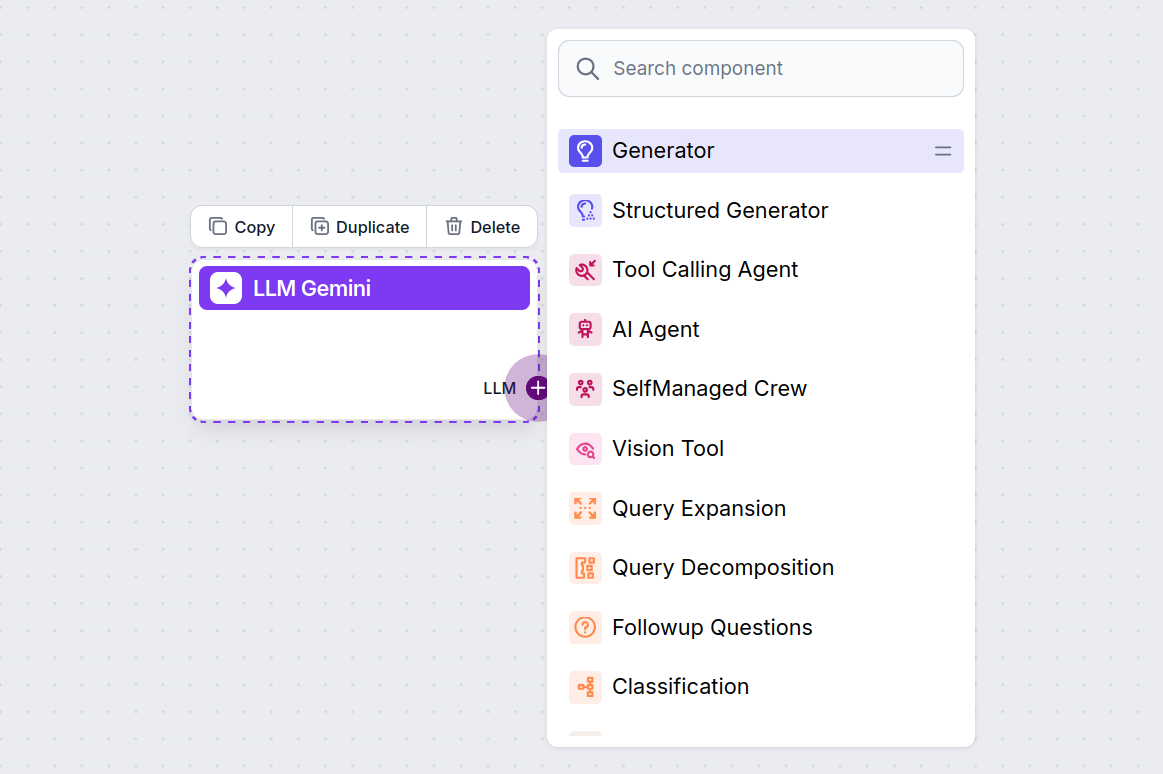

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

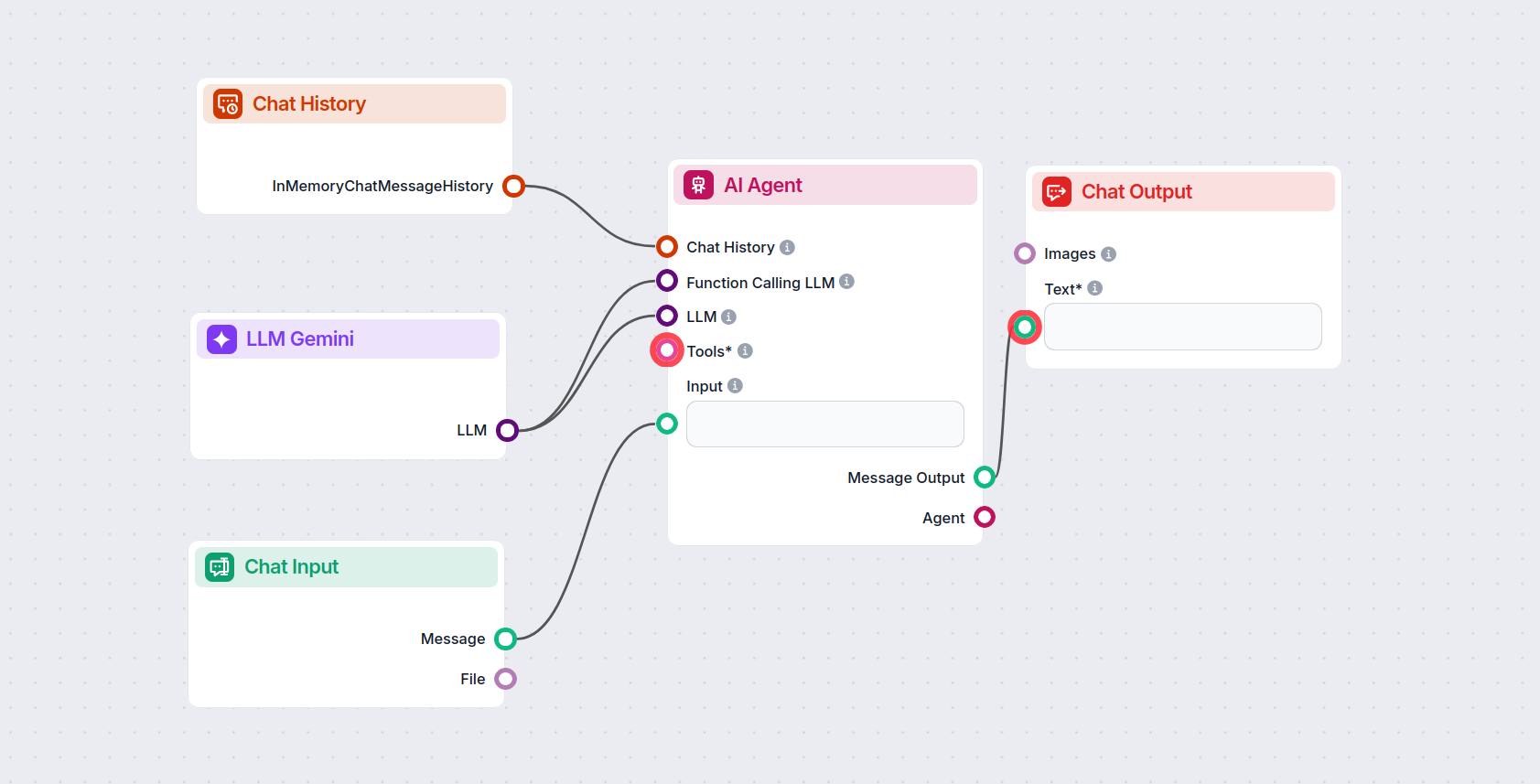

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow that’s using Gemini 2.0 Flash Experimental to generate responses. You can think of it as a basic Gemini chatbot.

This simple Chatbot Flow includes:

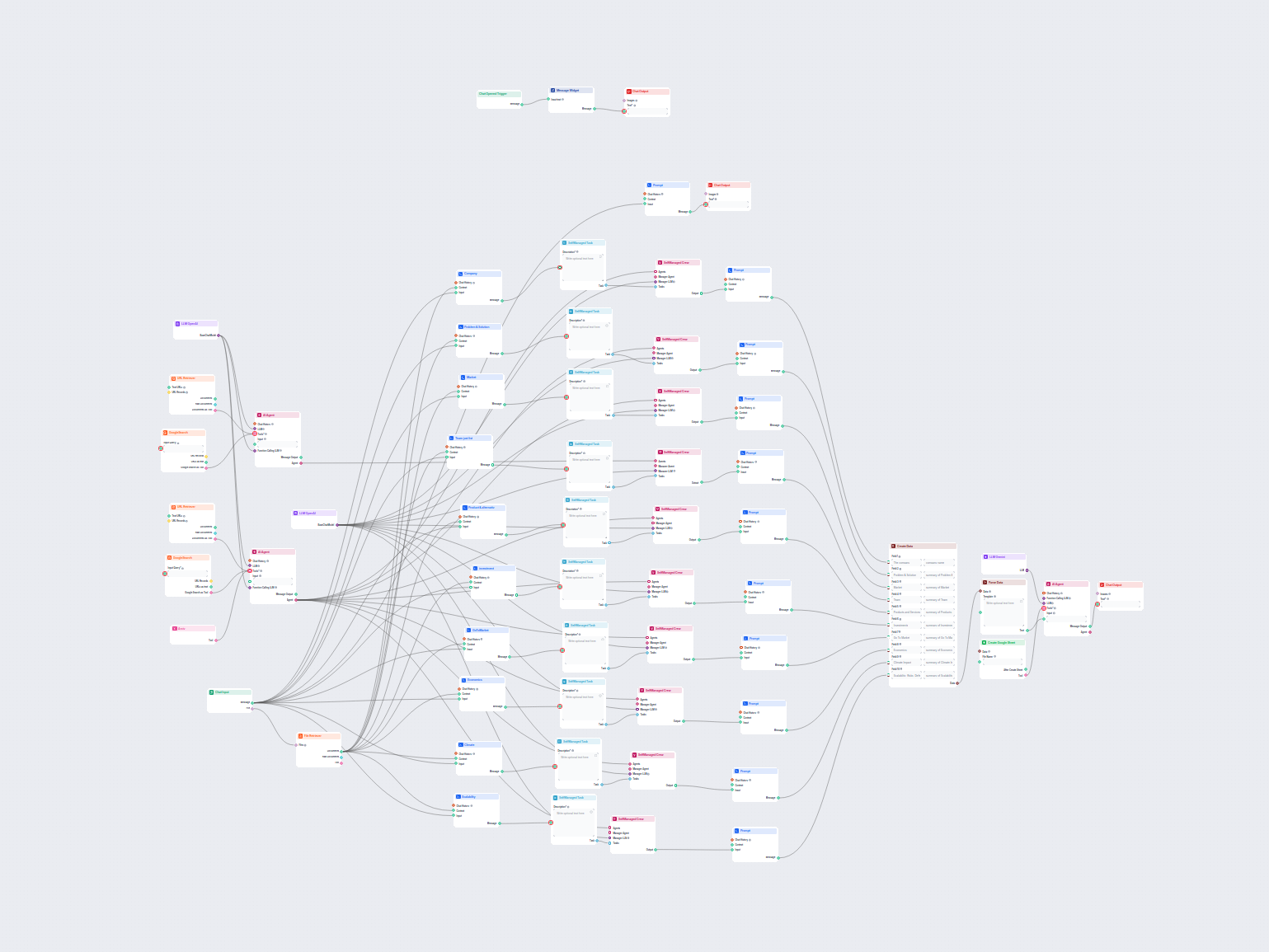

Pour vous aider à démarrer rapidement, nous avons préparé plusieurs exemples de modèles de flux qui démontrent comment utiliser efficacement le composant LLM Gemini. Ces modèles présentent différents cas d'utilisation et meilleures pratiques, facilitant votre compréhension et l'implémentation du composant dans vos propres projets.

Ce workflow alimenté par l'IA fournit une analyse d'entreprise complète et fondée sur les données. Il rassemble des informations sur l'historique de l'entrepris...

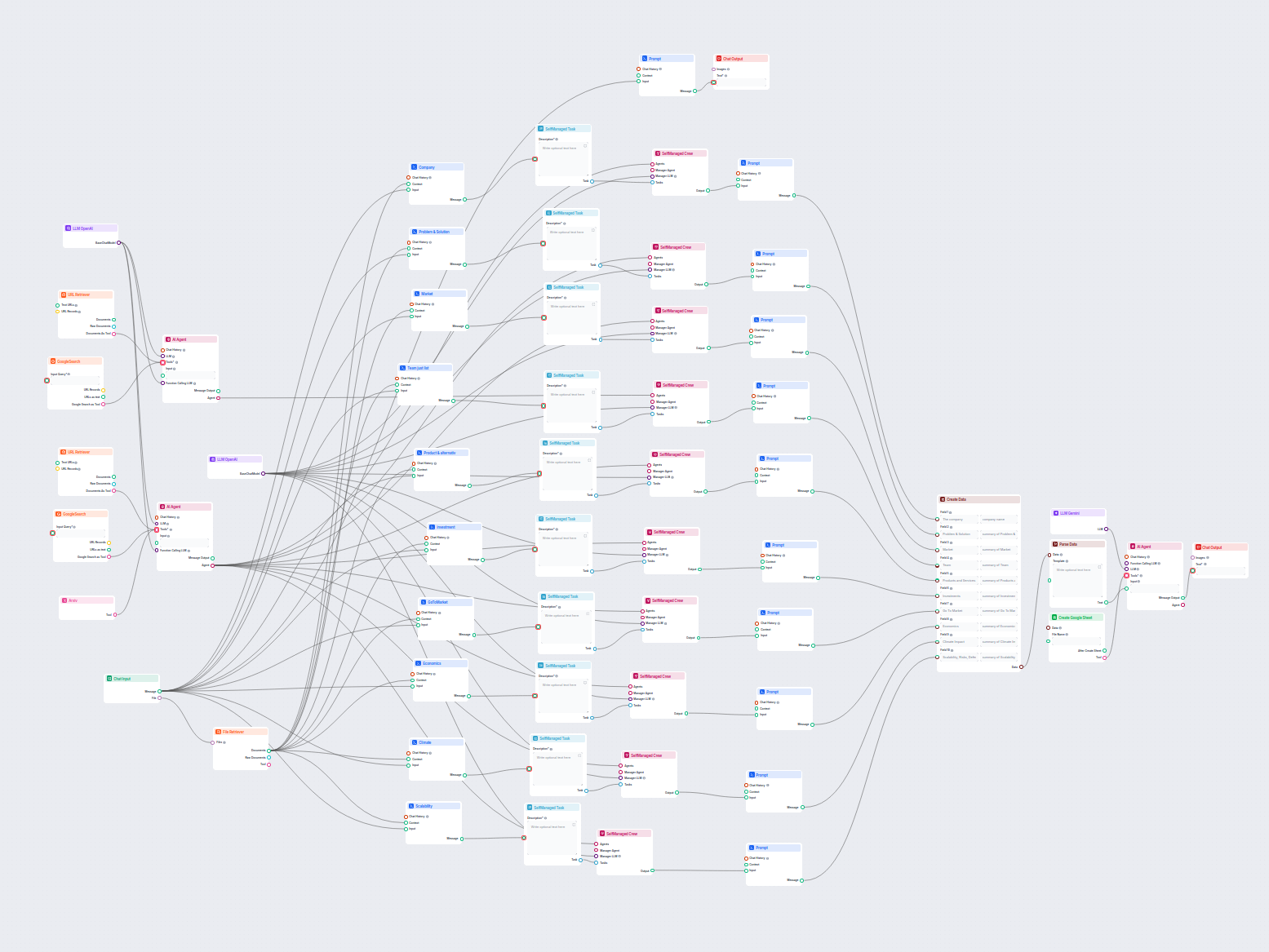

Ce flux de travail IA analyse en profondeur toute entreprise en recherchant des données et documents publics, couvrant marché, équipe, produits, investissements...

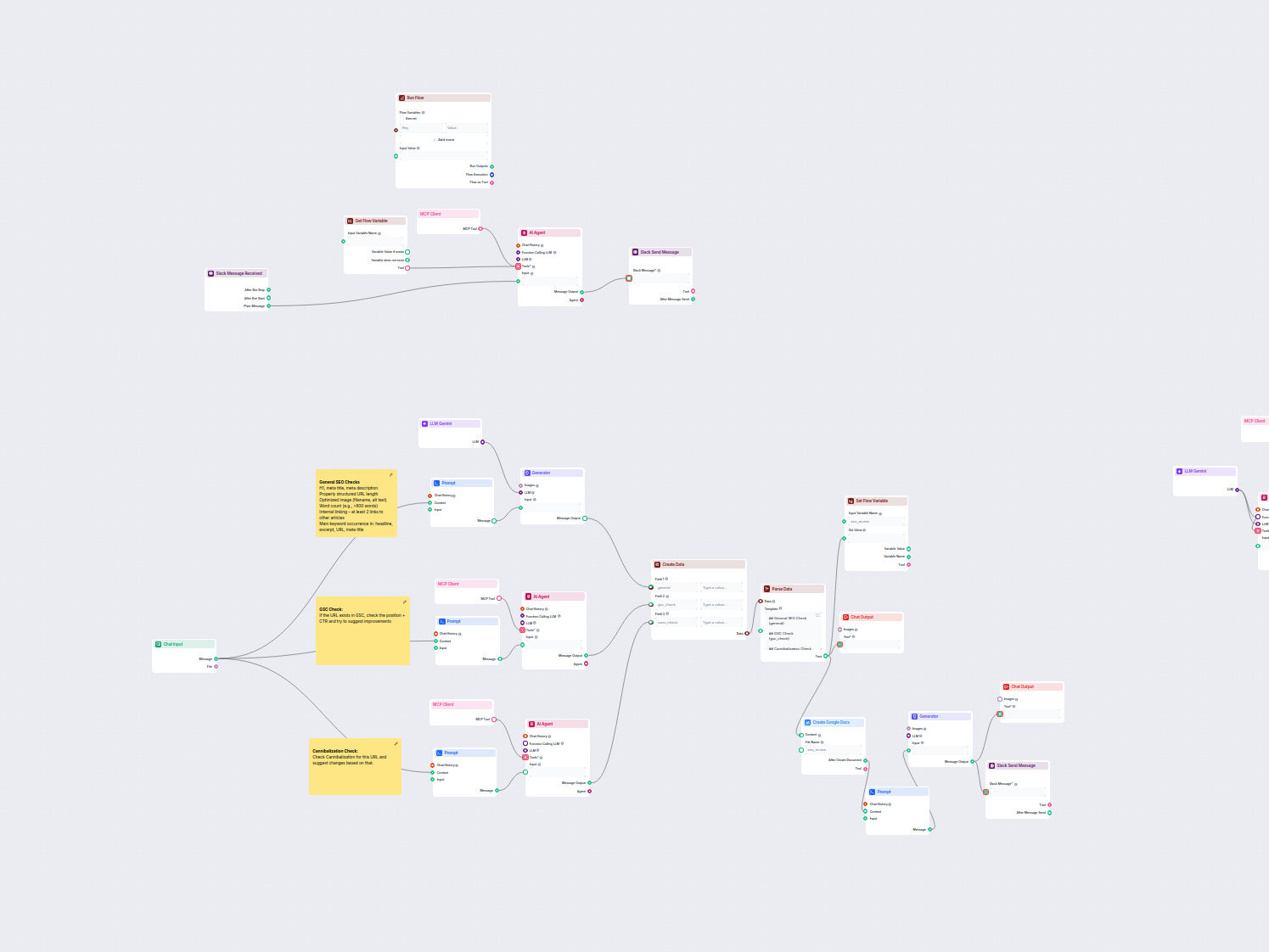

Ce flux de travail automatise le processus de revue et d'audit SEO des pages web. Il analyse le contenu des pages selon les meilleures pratiques SEO, réalise de...

LLM Gemini connecte les modèles Gemini de Google à vos flux d'IA FlowHunt, vous permettant de choisir parmi les dernières variantes Gemini pour la génération de texte et de personnaliser leur comportement.

FlowHunt prend en charge Gemini 2.0 Flash Experimental, Gemini 1.5 Flash, Gemini 1.5 Flash-8B et Gemini 1.5 Pro—chacun offrant des capacités uniques pour les entrées texte, image, audio et vidéo.

Max Tokens limite la longueur de la réponse, tandis que Temperature contrôle la créativité—des valeurs basses donnent des réponses ciblées, des valeurs élevées permettent plus de variété. Les deux peuvent être définis par modèle dans FlowHunt.

Non, l'utilisation des composants LLM est optionnelle. Tous les flux d'IA incluent ChatGPT-4o par défaut, mais ajouter LLM Gemini vous permet de passer aux modèles Google et de peaufiner leurs paramètres.

Commencez à créer des chatbots IA avancés et des outils avec Gemini et d'autres modèles de pointe—le tout sur un seul tableau de bord. Basculez de modèle, personnalisez les paramètres et optimisez vos flux de travail.

FlowHunt prend en charge des dizaines de modèles d'IA, y compris les modèles révolutionnaires DeepSeek. Voici comment utiliser DeepSeek dans vos outils d'IA et ...

FlowHunt prend en charge des dizaines de modèles de texte IA, y compris ceux de Mistral. Voici comment utiliser Mistral dans vos outils et chatbots IA.

FlowHunt prend en charge des dizaines de modèles de génération de texte, y compris les modèles Llama de Meta. Découvrez comment intégrer Llama dans vos outils e...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.