DeepSeek MCP Server

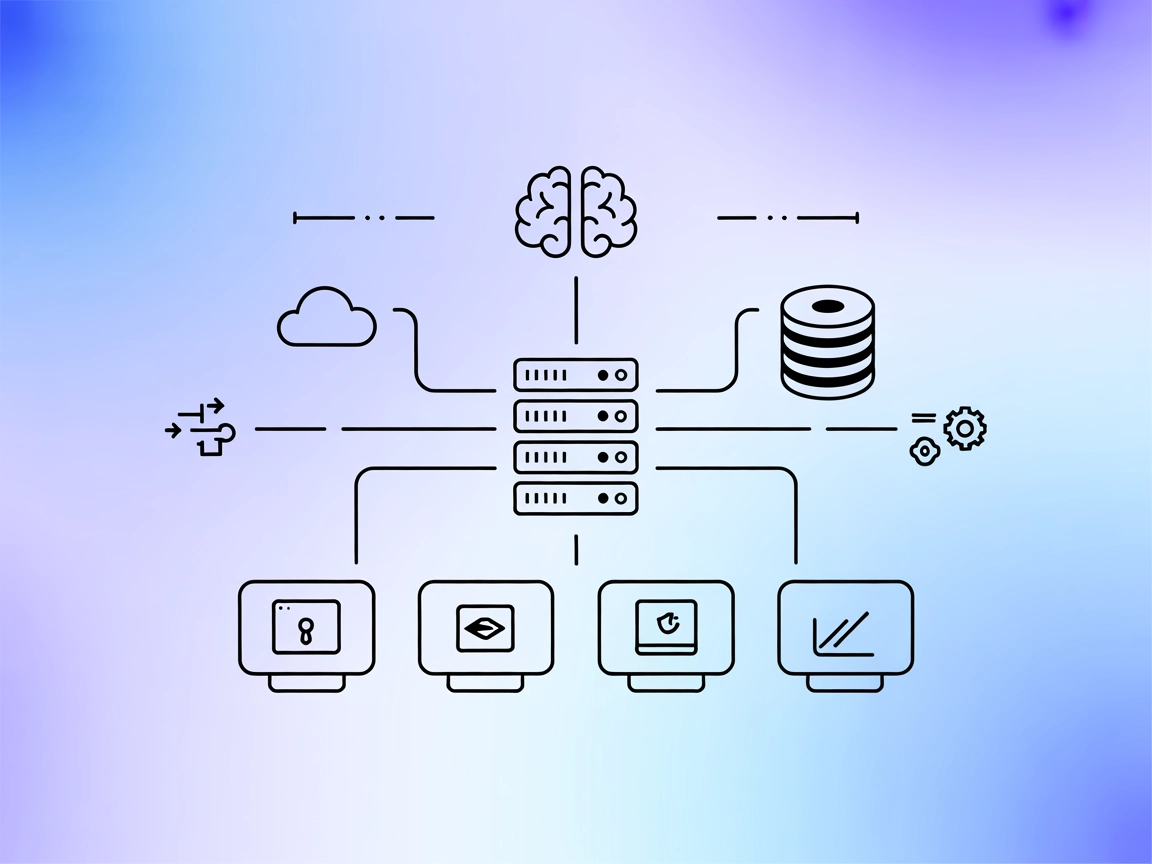

Le serveur DeepSeek MCP intègre les modèles de langage avancés de DeepSeek avec des applications compatibles MCP, offrant un accès API sécurisé et anonymisé et ...

Reliez les puissants modèles de langage de DeepSeek à vos clients compatibles MCP préférés via un serveur proxy sécurisé et anonyme pour une intégration IA fluide et l’automatisation de vos flux.

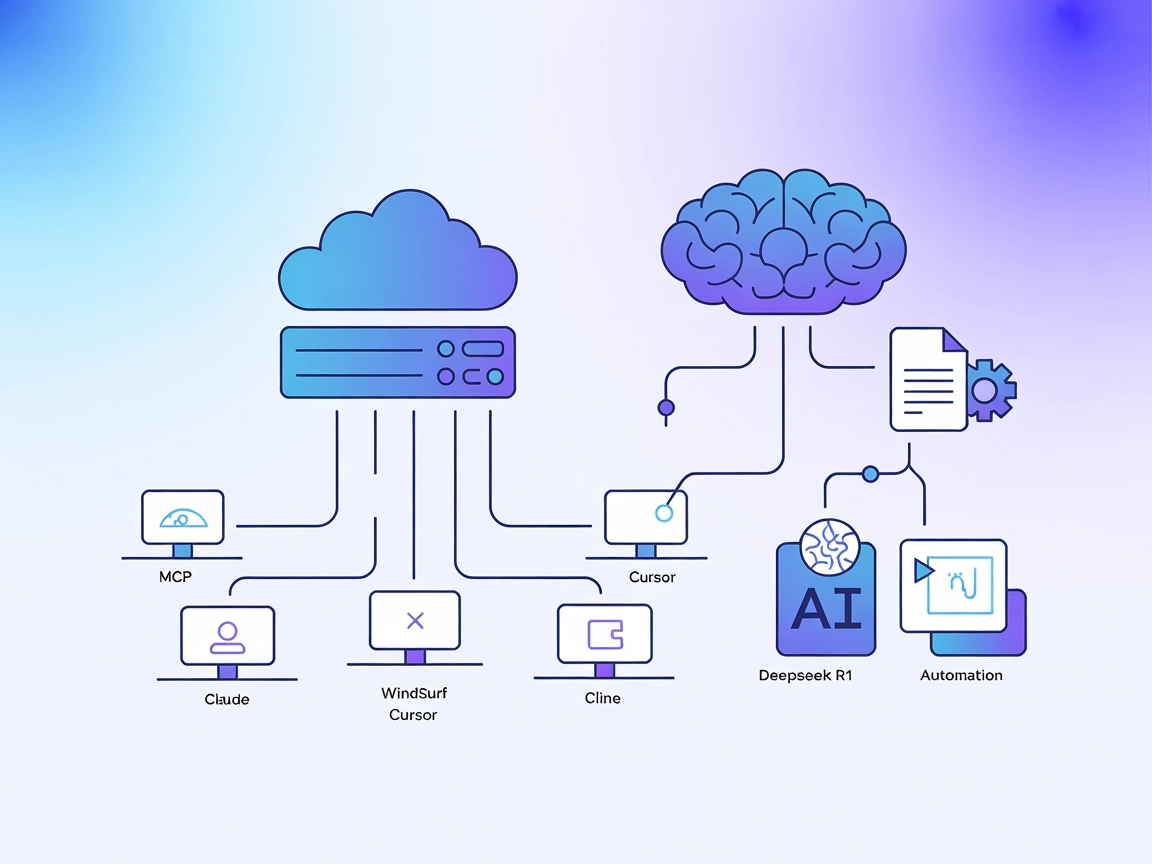

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

Le serveur MCP DeepSeek est un serveur Model Context Protocol (MCP) conçu pour relier les modèles de langage avancés de DeepSeek avec des applications compatibles MCP telles que Claude Desktop. En agissant comme proxy, il permet aux assistants IA d’interagir avec l’API DeepSeek tout en assurant l’anonymat de l’utilisateur — seul le proxy est visible par l’API. Cette intégration facilite les flux de travail pour les développeurs en permettant un accès transparent aux puissantes capacités de traitement du langage naturel de DeepSeek. Grâce au serveur MCP, les applications et agents IA peuvent exploiter les modèles DeepSeek pour des tâches telles que la compréhension du langage, la génération de texte et l’automatisation pilotée par API, le tout dans un cadre protocolaire standardisé, sécurisé et extensible.

Aucun modèle de prompt n’a été mentionné dans le dépôt ou sa documentation.

Aucune ressource MCP explicite n’a été décrite dans le dépôt ou sa documentation.

Aucune définition d’outil (par exemple, query_database, read_write_file, call_api) n’a été trouvée dans les fichiers disponibles ou le README.

windsurf.config.json)."mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

cursor.config.json."mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

cline.config.json."mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

Utilisez des variables d’environnement pour la configuration sensible (comme les clés API). Exemple :

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"],

"env": {

"DEEPSEEK_API_KEY": "${DEEPSEEK_API_KEY}"

},

"inputs": {

"api_key": "${DEEPSEEK_API_KEY}"

}

}

}

Utiliser MCP dans FlowHunt

Pour intégrer des serveurs MCP à votre flux FlowHunt, commencez par ajouter le composant MCP à votre flow et connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section de configuration système MCP, insérez les détails de votre serveur MCP au format JSON suivant :

{

"deepseek-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Une fois la configuration terminée, l’agent IA pourra utiliser ce MCP comme outil avec accès à toutes ses fonctions et capacités. N’oubliez pas de remplacer “deepseek-mcp” par le nom réel de votre serveur MCP et l’URL par celle de votre serveur MCP.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Présentation | ✅ | Trouvé dans README.md |

| Liste des prompts | ⛔ | Aucun modèle de prompt trouvé |

| Liste des ressources | ⛔ | Aucune ressource explicite listée |

| Liste des outils | ⛔ | Aucun outil défini dans les fichiers serveur |

| Sécurisation des clés API | ✅ | .env.example présent, instructions fournies |

| Prise en charge du sampling (moins important) | ⛔ | Non mentionné |

Support des roots : Non mentionné

Support du sampling : Non mentionné

En résumé, le serveur MCP DeepSeek est principalement un adaptateur proxy pour l’API DeepSeek, fournissant une bonne documentation pour l’installation et la gestion sécurisée des clés, mais sans exemples explicites de prompts, ressources ou outils. Il convient particulièrement aux utilisateurs souhaitant un accès facile et anonyme aux modèles DeepSeek dans des environnements compatibles MCP.

Ce serveur MCP est bien documenté pour l’installation et la sécurité mais manque d’exemples détaillés de primitives MCP avancées (comme prompts, ressources, outils). Sa principale valeur est de permettre un accès simple aux modèles DeepSeek. Le projet semble actif et bien accueilli par la communauté.

| Dispose d’une LICENCE | ✅ (MIT) |

|---|---|

| A au moins un outil | ⛔ |

| Nombre de Forks | 32 |

| Nombre d’Étoiles | 242 |

Le serveur MCP DeepSeek est un proxy qui connecte les modèles de langage de DeepSeek aux clients compatibles MCP comme FlowHunt ou Claude Desktop. Il permet aux applications et agents d’utiliser les modèles DeepSeek pour des tâches de langage tout en gardant votre clé API et votre identité cachées des services tiers.

En agissant comme un proxy sécurisé, le serveur MCP DeepSeek garantit que votre clé API et votre identité utilisateur ne sont jamais exposées à l’API DeepSeek, offrant confidentialité et gestion centralisée des accès.

Vous pouvez utiliser le serveur MCP DeepSeek pour un accès anonyme aux modèles, intégrer DeepSeek avec des clients desktop, gérer l’utilisation de l’API de manière centralisée, automatiser des flux de travail ou prototyper rapidement des fonctionnalités alimentées par l’IA.

Il est recommandé d’utiliser des variables d’environnement pour stocker votre clé API DeepSeek. Le serveur MCP lit la clé dans votre configuration d’environnement, garantissant que les données sensibles ne sont pas exposées en clair.

Aucun modèle de prompt ou définition d’outil explicite n’est fourni. Le serveur fonctionne principalement comme proxy, permettant une utilisation basique des modèles dans les environnements compatibles MCP.

Intégrez les modèles DeepSeek à vos flux MCP en toute sécurité et simplicité. Commencez à utiliser des modèles de langage avancés dans vos projets dès aujourd’hui.

Le serveur DeepSeek MCP intègre les modèles de langage avancés de DeepSeek avec des applications compatibles MCP, offrant un accès API sécurisé et anonymisé et ...

Le serveur MCP Deepseek Thinker intègre le raisonnement du modèle Deepseek dans les clients IA compatibles MCP comme Claude Desktop, fournissant des sorties ava...

Le Serveur MCP Deepseek R1 permet l'intégration transparente des modèles linguistiques avancés de DeepSeek, tels que Deepseek R1 et V3, dans Claude Desktop et d...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.