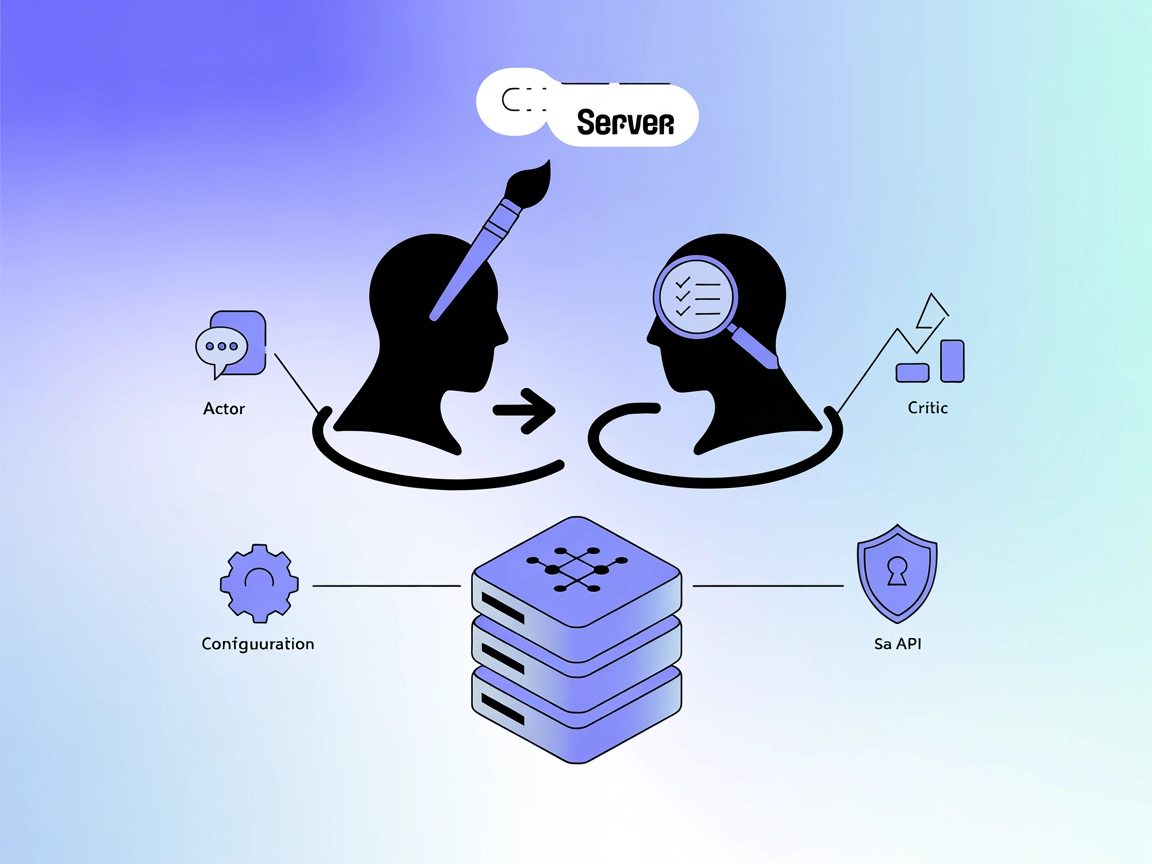

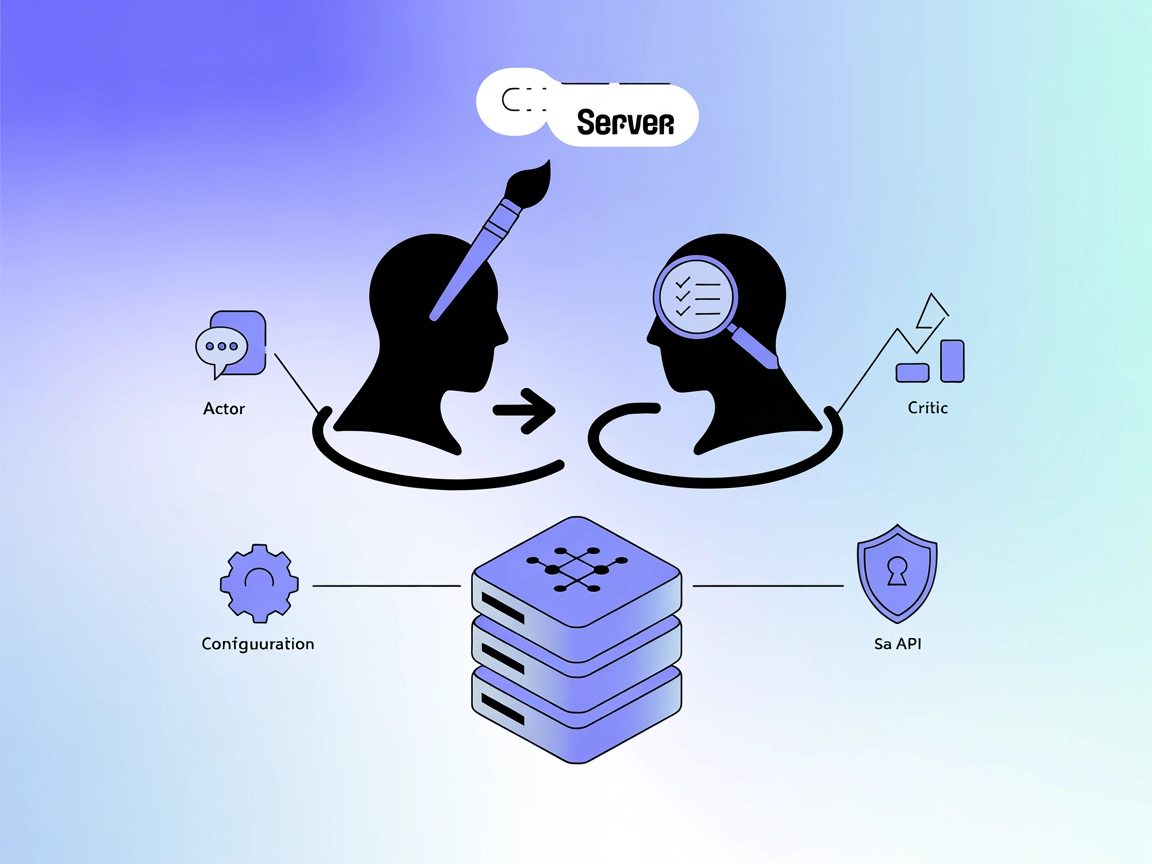

Serwer MCP Actor-Critic Thinking

Serwer MCP Actor-Critic Thinking umożliwia ocenę wydajności z dwóch perspektyw, naprzemiennie przyjmując role „aktora” (twórcy) i „krytyka” (oceniającego), zape...

Łatwo integruj bezpośrednie opinie i zatwierdzenia użytkowników w swoich workflowach deweloperskich opartych na AI dzięki Serwerowi MCP Opinie Użytkowników.

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Serwer MCP Opinie Użytkowników to prosta implementacja Model Context Protocol (MCP) zaprojektowana do umożliwienia workflowów z człowiekiem w pętli w narzędziach deweloperskich takich jak Cline i Cursor. Jego głównym celem jest ułatwienie bezpośredniego uzyskiwania opinii użytkownika podczas zadań automatycznych lub wspieranych przez AI. Integrując ten serwer, workflowy mogą prosić użytkowników o wkład, recenzję lub akceptację na kluczowych etapach, wykorzystując zalety zarówno automatyzacji, jak i ludzkiego osądu. Jest to szczególnie przydatne podczas testowania złożonych aplikacji desktopowych lub procesów wymagających subtelnej oceny użytkownika przed zakończeniem, zapewniając jakość i ograniczając błędy przez włączenie prawdziwych użytkowników do pętli.

Przed ukończeniem zadania użyj narzędzia user_feedback MCP, aby poprosić użytkownika o opinię.

Ten prompt zapewnia, że LLM lub workflow wywoła narzędzie opinii użytkownika w celu uzyskania wyraźnej akceptacji lub wkładu użytkownika przed zakończeniem zadania.

project_directory (ścieżka do projektu) oraz wiadomość summary (np. “Zaimplementowałem zmiany, o które prosiłeś.”). Pozwala to workflowowi zatrzymać się i oczekiwać na wkład człowieka przed kontynuacją.W repozytorium nie znaleziono instrukcji konfiguracji dla Windsurf.

W repozytorium nie znaleziono instrukcji konfiguracji dla Claude.

Brak wyraźnych instrukcji krok po kroku dla Cursor, ale serwer jest zaprojektowany do współpracy z Cursor. Proszę odnieść się do konfiguracji Cline jako przykładu.

pip install uvcurl -LsSf https://astral.sh/uv/install.sh | shC:\MCP\user-feedback-mcpcline_mcp_settings.json){

"mcpServers": {

"github.com/mrexodia/user-feedback-mcp": {

"command": "uv",

"args": [

"--directory",

"c:\\MCP\\user-feedback-mcp",

"run",

"server.py"

],

"timeout": 600,

"autoApprove": [

"user_feedback"

]

}

}

}

Uwaga dotycząca zabezpieczania kluczy API:

W dokumentacji ani kodzie nie ma wzmianki o kluczach API czy zarządzaniu sekretami dla tego serwera MCP.

Używanie MCP w FlowHunt

Aby zintegrować serwery MCP w swoim workflow FlowHunt, zacznij od dodania komponentu MCP do swojego flow i połączenia go z agentem AI:

Kliknij w komponent MCP, aby otworzyć panel konfiguracji. W sekcji systemowej konfiguracji MCP wstaw dane swojego serwera MCP używając tego formatu JSON:

{

"user-feedback-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może korzystać z tego MCP jako narzędzia z dostępem do wszystkich jego funkcji i możliwości. Pamiętaj, aby zamienić “user-feedback-mcp” na rzeczywistą nazwę swojego serwera MCP oraz podać własny adres URL serwera.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | Opinie użytkownika w workflowach deweloperskich |

| Lista promptów | ✅ | Szablon promptu “user_feedback” |

| Lista zasobów | ⛔ | Brak wymienionych zasobów |

| Lista narzędzi | ✅ | user_feedback |

| Zabezpieczanie kluczy API | ⛔ | Brak informacji o kluczach API lub zarządzaniu sekretami |

| Wsparcie dla sampling (mniej istotne w ocenie) | ⛔ | Nie wspomniano |

Ten serwer MCP jest bardzo ukierunkowany i łatwy do integracji dla opinii użytkownika w pętli, jednak brakuje mu rozbudowywalności, ekspozycji zasobów oraz zaawansowanych funkcji takich jak zarządzanie kluczami API czy wsparcie dla sampling. Dla deweloperów potrzebujących wyłącznie blokady na opinię, jest znakomity, jednak do szerszych zastosowań MCP jest ograniczony.

| Czy posiada LICENCJĘ | ✅ (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | ✅ |

| Liczba Forków | 5 |

| Liczba Gwiazdek | 29 |

Ocena: 6/10 – Bardzo dobry do swojego wąskiego zastosowania, ale brakuje mu szerszych funkcji MCP i rozbudowywalności.

To implementacja Model Context Protocol (MCP), która umożliwia workflowy z człowiekiem w pętli, pozwalając automatycznym lub wspieranym przez AI procesom zatrzymać się i poprosić użytkownika o bezpośrednią opinię, akceptację lub wkład na kluczowych etapach.

Jest zaprojektowany dla Cline i Cursor, ale można go zintegrować z każdym systemem obsługującym serwery MCP.

Idealny do zatwierdzania zadań przez człowieka, testowania aplikacji desktopowych, współdzielonych przeglądów kodu, moderacji workflowów w środowiskach o niskim zaufaniu oraz uzyskiwania iteracyjnych opinii podczas rozwoju.

Nie, w dokumentacji ani kodzie nie ma wzmianki o kluczach API czy zarządzaniu sekretami dla tego serwera.

Dodaj komponent MCP do swojego workflowu w FlowHunt, połącz go ze swoim agentem AI i skonfiguruj szczegóły serwera MCP w sekcji konfiguracji systemowej MCP używając podanego formatu JSON.

Wzmocnij swoją automatyzację prawdziwym spojrzeniem człowieka. Zintegruj Serwer MCP Opinie Użytkowników w FlowHunt, aby każdy kluczowy krok uzyskał należne zatwierdzenie.

Serwer MCP Actor-Critic Thinking umożliwia ocenę wydajności z dwóch perspektyw, naprzemiennie przyjmując role „aktora” (twórcy) i „krytyka” (oceniającego), zape...

Serwer Langfuse MCP łączy FlowHunt i innych klientów AI z repozytoriami promptów Langfuse za pomocą Model Context Protocol, umożliwiając scentralizowane wyszuki...

Serwer Multi-Model Advisor MCP umożliwia FlowHunt łączenie asystentów AI z wieloma lokalnymi modelami Ollama, umożliwiając jednoczesne zapytania i syntezę różno...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.