LLM Gemini

FlowHunt podporuje desiatky AI modelov vrátane Google Gemini. Zistite, ako používať Gemini vo svojich AI nástrojoch a chatbot-och, prepínať medzi modelmi a ovlá...

LLM DeepSeek od FlowHunt vám umožní prístup a prispôsobenie špičkových AI modelov ako DeepSeek R1 na generovanie textu a obrázkov vo vašich chatbot-och a AI nástrojoch – všetko z jedného dashboardu.

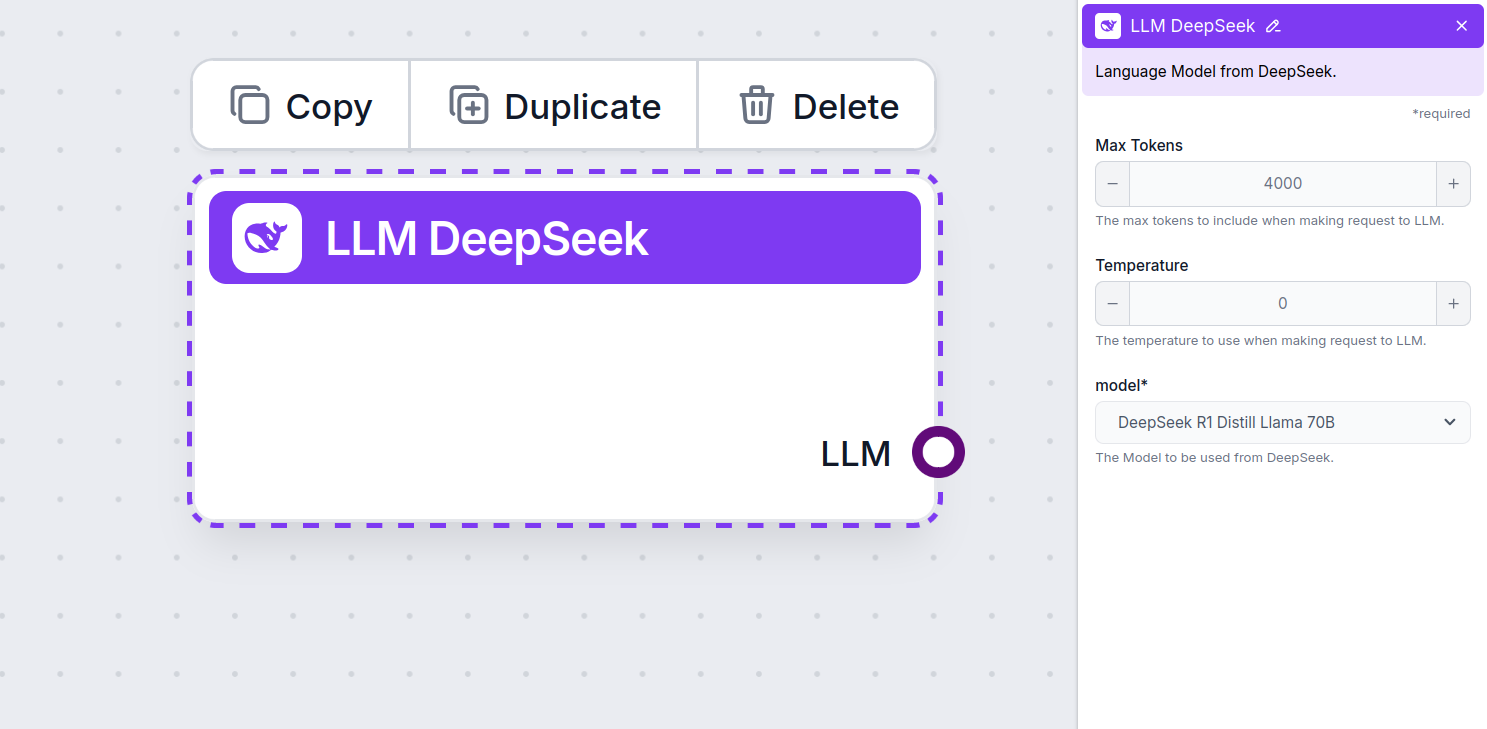

Opis komponentu

The LLM DeepSeek component connects the DeepSeek models to your Flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to swap and control the model used.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported DeepSeek models. We support all the latest Gemini models:

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

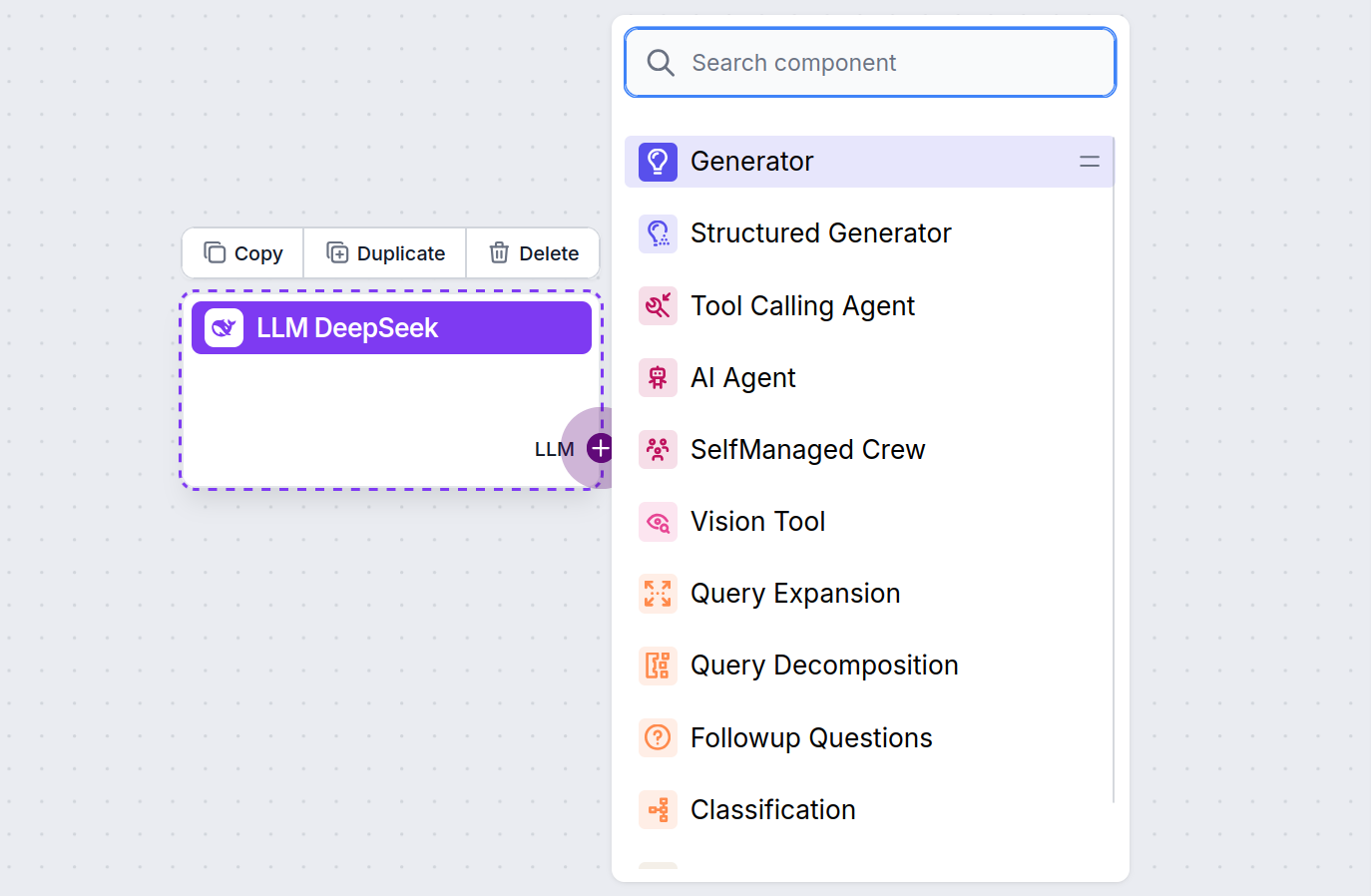

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

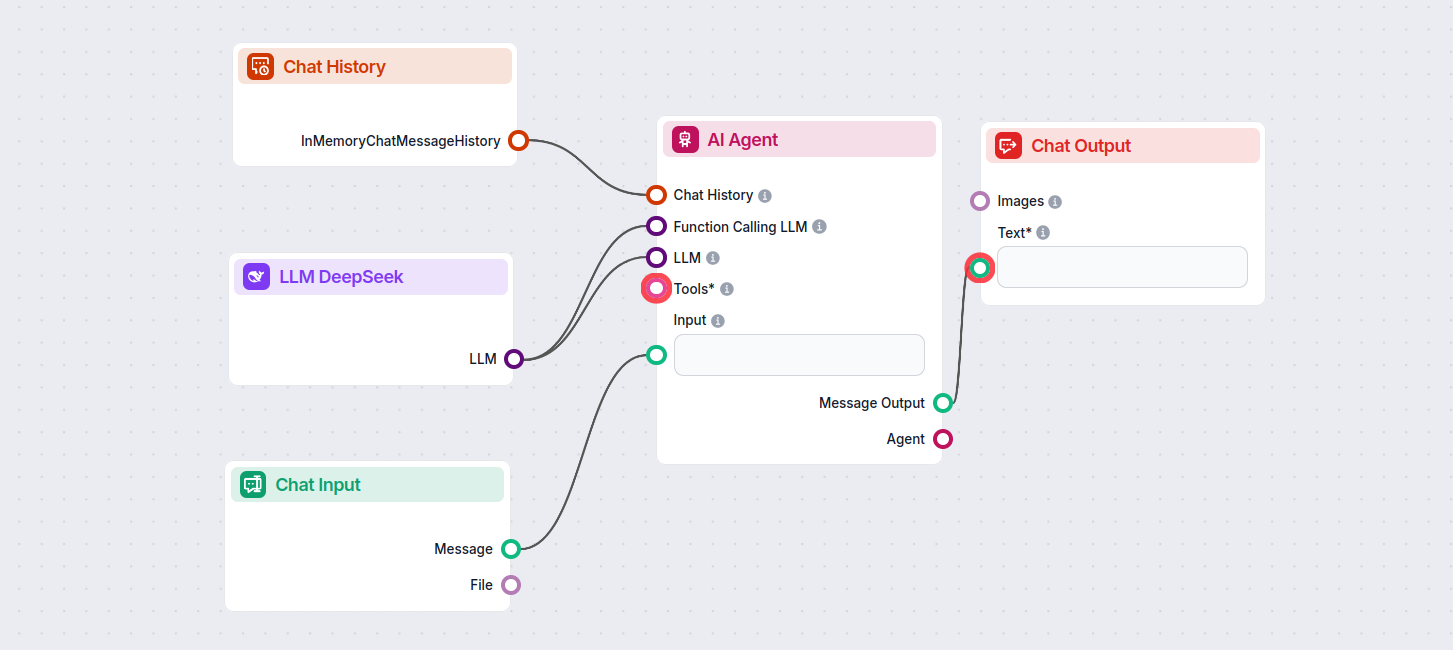

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow using DeepSeek R1 to generate responses. You can think of it as a basic DeepSeek chatbot.

This simple Chatbot Flow includes:

LLM DeepSeek je komponent vo FlowHunt, ktorý vám umožňuje pripojiť a ovládať DeepSeek AI modely na generovanie textu a obrázkov, čím umožňuje výkonné chatboty a automatizované procesy.

FlowHunt podporuje všetky najnovšie modely DeepSeek vrátane DeepSeek R1, ktorý je známy svojou rýchlosťou a výkonom, najmä v porovnaní s inými poprednými AI modelmi.

Môžete upraviť maximálny počet tokenov pre dĺžku odpovede a teplotu pre kreativitu odpovedí, ako aj prepínať medzi dostupnými modelmi DeepSeek priamo vo svojom FlowHunt dashboarde.

Nie, pripojenie LLM komponentu je voliteľné. FlowHunt štandardne používa ChatGPT-4o, ale pridaním LLM DeepSeek môžete prepínať a ovládať, ktorý AI model poháňa vaše procesy.

Začnite vytvárať inteligentnejšie AI chatboty a automatizačné nástroje pomocou pokročilých modelov DeepSeek – a to všetko bez zložitého nastavovania alebo viacerých predplatných.

FlowHunt podporuje desiatky AI modelov vrátane Google Gemini. Zistite, ako používať Gemini vo svojich AI nástrojoch a chatbot-och, prepínať medzi modelmi a ovlá...

FlowHunt podporuje desiatky modelov na generovanie textu, vrátane modelov od xAI. Tu je návod, ako používať modely xAI vo vašich AI nástrojoch a chatbot-och....

FlowHunt podporuje desiatky modelov na generovanie textu, vrátane modelov Llama od spoločnosti Meta. Naučte sa, ako integrovať Llama do svojich AI nástrojov a c...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.