Wan 2.2 & 2.5 Video Oluşturmayla İçerik Üretimini Nasıl Dönüştürebilirsiniz?

FlowHunt artık Wan 2.2 ve 2.5 video oluşturma modellerini metinden videoya, görselden videoya, persona değiştirme ve animasyon için destekliyor. Profesyonel düz...

Wan 2.1, Alibaba tarafından geliştirilen güçlü bir açık kaynaklı Yapay Zekâ video üretim modeli olup, metin veya görsellerden stüdyo kalitesinde videoları ücretsiz olarak yerel bilgisayarınızda üretmenizi sağlar.

Wan 2.1 (WanX 2.1 olarak da bilinir), Alibaba’nın Tongyi Lab tarafından geliştirilen tamamen açık kaynaklı bir yapay zekâ video üretim modeli olarak yeni bir çağ başlatıyor. Pahalı abonelikler veya API erişimi gerektiren birçok tescilli video üretim sisteminin aksine, Wan 2.1 benzer ya da daha iyi kalite sunarken tamamen ücretsizdir ve geliştiriciler, araştırmacılar ve yaratıcı profesyoneller için erişilebilirdir.

Wan 2.1’i gerçekten özel kılan şey, erişilebilirlikle yüksek performansı bir araya getirmesidir. Daha küçük T2V-1.3B varyantı sadece yaklaşık 8.2 GB GPU belleği gerektirir; bu da çoğu modern tüketici GPU’su ile uyumlu olmasını sağlar. Diğer yandan, 14B parametreli büyük sürüm, hem açık kaynaklı hem de birçok ticari modeli standart kıyaslamalarda geride bırakan son teknoloji performans sunar.

Wan 2.1 yalnızca metinden videoya üretimle sınırlı değildir. Esnek mimarisi şu görevleri destekler:

Bu esneklik sayesinde, bir metin girdisi, durağan bir görsel veya mevcut bir video ile başlayıp hayal ettiğiniz şekilde dönüştürebilirsiniz.

Oluşturulan videolar içinde okunabilir İngilizce ve Çince metin oluşturabilen ilk video modeli olarak Wan 2.1, uluslararası içerik üreticilerine yeni olanaklar sunuyor. Bu özellik, çok dilli videolarda altyazı veya sahne metni eklemek için özellikle değerlidir.

Wan 2.1’in verimliliğinin merkezinde, 3 boyutlu nedensel Video Varyasyonel Otomatik Kodlayıcısı yer alır. Bu teknolojik atılım, uzay-zaman bilgisini verimli bir şekilde sıkıştırarak modelin:

sağlar.

Küçük 1.3B modeli yalnızca 8.19 GB VRAM gerektirir ve bir RTX 4090’da yaklaşık 4 dakikada 5 saniyelik 480p video üretebilir. Bu verimliliğe rağmen, kalitesi çok daha büyük modellerle yarışır veya onları aşar; hız ve görsel kalite arasında mükemmel bir denge sunar.

Kamusal değerlendirmelerde Wan 14B, Wan-Bench testlerinde en yüksek genel skoru elde ederek şu alanlarda rakiplerini geride bıraktı:

OpenAI’nin Sora’sı veya Runway’in Gen-2’si gibi kapalı kaynaklı sistemlerin aksine, Wan 2.1’i yerel olarak ücretsiz çalıştırabilirsiniz. Genellikle önceki açık kaynaklı modelleri (CogVideo, MAKE-A-VIDEO ve Pika gibi) ve hatta birçok ticari çözümü kalite kıyaslamalarında geride bırakır.

Son bir sektör araştırmasında, “Birçok yapay zekâ video modeli arasında Wan 2.1 ve Sora öne çıkıyor” denildi – Wan 2.1 açıklığı ve verimliliğiyle, Sora ise tescilli yeniliğiyle dikkat çekiyor. Topluluk testlerinde, kullanıcılar Wan 2.1’in görüntüden videoya yeteneğinin netlik ve sinematik his açısından rakiplerinden daha iyi olduğunu bildirdi.

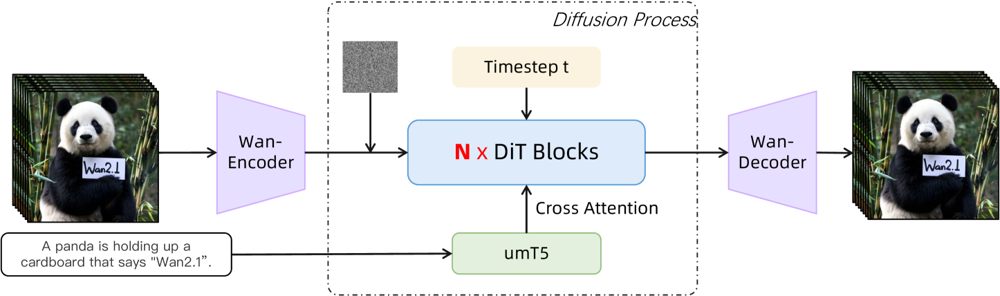

Wan 2.1, yenilikçi bir uzay-zaman VAE ile birleştirilmiş bir difüzyon-dönüştürücü omurgası üzerine inşa edilmiştir. Çalışma prensibi şöyle:

Şekil: Wan 2.1’in yüksek seviyeli mimarisi (metinden videoya durumu). Bir video (veya görsel) önce Wan-VAE kodlayıcı tarafından gizliye dönüştürülür. Bu gizli temsili, N difüzyon dönüştürücü bloğundan geçerken, metin gömüsüne (umT5’ten) çapraz dikkatle erişir. Son olarak Wan-VAE kod çözücü video karelerini yeniden oluşturur. Bu tasarım – “Bir difüzyon dönüştürücüyü çevreleyen 3B nedensel VAE kodlayıcı/kod çözücü” (ar5iv.org ) – uzay-zaman verisinin verimli sıkıştırılmasını ve yüksek kaliteli video çıktısını mümkün kılar.

Bu yenilikçi mimari – “Bir difüzyon dönüştürücüyü çevreleyen 3B nedensel VAE kodlayıcı/kod çözücü” – uzay-zaman verisini verimli şekilde sıkıştırmayı ve yüksek kaliteli video üretimini mümkün kılar.

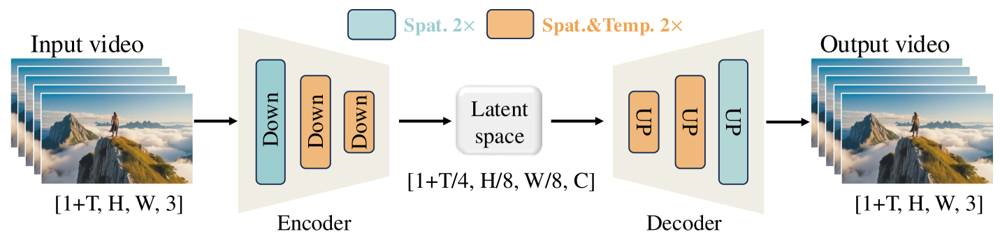

Wan-VAE, videolar için özel olarak tasarlanmıştır. Girişi, etkileyici faktörlerle (zamansal 4× ve uzamsal 8×) sıkıştırarak kompakt bir gizli temsile dönüştürür ve ardından tam videoya çözer. 3B evrişimler ve nedensel (zamanı koruyan) katmanlar, üretilen içeriğin hareket bütünlüğünü sağlar.

Şekil: Wan 2.1’in Wan-VAE çerçevesi (kodlayıcı-kod çözücü). Wan-VAE kodlayıcı (solda), giriş videosuna ([1+T, H, W, 3] şeklinde kareler) bir dizi aşağı örnekleme katmanı (“Down”) uygular ve kompakt bir gizliye ulaşıldığında ([1+T/4, H/8, W/8, C]) durur. Wan-VAE kod çözücü (sağda), bu gizliyi simetrik olarak yukarı örnekleyerek (“UP”) orijinal video karelerine geri döndürür. Mavi bloklar uzamsal sıkıştırmayı, turuncu bloklar ise birleşik uzamsal+zamansal sıkıştırmayı gösterir (ar5iv.org ). Wan-VAE, videoyu 256× sıkıştırarak (uzay-zaman hacminde), ardından gelen difüzyon modeli için yüksek çözünürlüklü video modellemesini mümkün kılar.

Wan 2.1’i kendiniz denemeye hazır mısınız? İşte başlamanın yolu:

Depoyu klonlayın ve bağımlılıkları yükleyin:

git clone https://github.com/Wan-Video/Wan2.1.git

cd Wan2.1

pip install -r requirements.txt

Model ağırlıklarını indirin:

pip install "huggingface_hub[cli]"

huggingface-cli login

huggingface-cli download Wan-AI/Wan2.1-T2V-14B --local-dir ./Wan2.1-T2V-14B

İlk videonuzu oluşturun:

python generate.py --task t2v-14B --size 1280*720 \

--ckpt_dir ./Wan2.1-T2V-14B \

--prompt "A futuristic city skyline at sunset, with flying cars zooming overhead."

--offload_model True --t5_cpu bayraklarını kullanın--size parametresiyle kontrol edin (ör. 16:9 480p için 832*480)Referans olarak, bir RTX 4090 yaklaşık 4 dakikada 5 saniyelik 480p video üretebilir. Büyük ölçekli kullanım için çoklu GPU desteği ve çeşitli performans iyileştirmeleri (FSDP, kuantizasyon vb.) vardır.

Yapay zekâ video üretiminde devlere meydan okuyan açık kaynaklı bir güç merkezi olan Wan 2.1, erişilebilirlikte önemli bir değişimi temsil ediyor. Ücretsiz ve açık olması sayesinde, iyi bir GPU’ya sahip herkes en ileri video üretimini abonelik veya API ücreti olmadan keşfedebilir.

Geliştiriciler için açık kaynak lisansı, modelin özelleştirilebilmesini ve iyileştirilebilmesini sağlar. Araştırmacılar yeteneklerini genişletebilir, yaratıcı profesyoneller ise video içeriklerini hızlı ve verimli bir şekilde prototipleyebilir.

Tescilli yapay zekâ modellerinin giderek ödeme duvarlarının arkasına saklandığı bir dönemde, Wan 2.1 en yeni performansın demokratikleşebileceğini ve geniş toplulukla paylaşılabileceğini gösteriyor.

Wan 2.1, Alibaba’nın Tongyi Lab tarafından geliştirilen, metin girdileri, görseller veya mevcut videolar üzerinden yüksek kaliteli videolar üretebilen tamamen açık kaynaklı bir yapay zekâ video üretim modelidir. Ücretsiz olarak kullanılabilir, birden fazla görevi destekler ve tüketici GPU’larında verimli şekilde çalışır.

Wan 2.1 çoklu görevli video üretimini destekler (metinden videoya, görüntüden videoya, video düzenleme vb.), videolarda çok dilli metin oluşturabilir, 3 boyutlu nedensel Video VAE ile yüksek verimlilik sunar ve kıyaslamalarda birçok ticari ve açık kaynaklı modeli geride bırakır.

Python 3.8+, CUDA destekli PyTorch 2.4.0+ ve NVIDIA GPU (küçük model için 8GB+, büyük model için 16-24GB VRAM) gereklidir. GitHub deposunu klonlayın, bağımlılıkları yükleyin, model ağırlıklarını indirin ve verilen betikleri kullanarak videoları yerelde oluşturun.

Wan 2.1, açık kaynaklı ve ücretsiz olması sayesinde en yeni video üretimini herkese ulaştırır; geliştiricilerin, araştırmacıların ve yaratıcıların ödeme duvarları veya mülkiyet kısıtlamaları olmadan deneme ve yenilik yapmasına olanak tanır.

Sora veya Runway Gen-2 gibi kapalı kaynaklı alternatiflerin aksine, Wan 2.1 tamamen açık kaynaklıdır ve yerel olarak çalıştırılabilir. Genellikle önceki açık kaynaklı modelleri geride bırakır ve kalite kıyaslamalarında birçok ticari çözümle başa baş ya da daha iyi performans gösterir.

Arshia, FlowHunt'ta bir Yapay Zeka İş Akışı Mühendisidir. Bilgisayar bilimi geçmişi ve yapay zekaya olan tutkusu ile, yapay zeka araçlarını günlük görevlere entegre eden verimli iş akışları oluşturmada uzmanlaşmıştır ve bu sayede verimlilik ile yaratıcılığı artırır.

FlowHunt ile kendi yapay zekâ araçlarınızı ve video üretim iş akışlarınızı oluşturmaya başlayın veya platformu canlı görmek için bir demo planlayın.

FlowHunt artık Wan 2.2 ve 2.5 video oluşturma modellerini metinden videoya, görselden videoya, persona değiştirme ve animasyon için destekliyor. Profesyonel düz...

FlowHunt'ın Ekim 2025 güncellemesi, metinden videoya, görselden videoya ve animasyon için devrim niteliğindeki Wan 2.2 ve 2.5 video üretim modellerini, Qwen'in ...

Sora 2'nin yapay zekâ video üretimindeki çığır açan yeteneklerini keşfedin: Gerçekçi karakter yeniden yaratmadan fizik simülasyonuna kadar, bu teknolojinin içer...

Çerez Onayı

Göz atma deneyiminizi geliştirmek ve trafiğimizi analiz etmek için çerezleri kullanıyoruz. See our privacy policy.