Zabezpečení AI agentů: Prevence vícekrokových útoků na autonomní AI systémy

Autonomní AI agenti čelí unikátním bezpečnostním výzvám nad rámec chatbotů. Když AI může procházet web, spouštět kód, posílat e-maily a volat API, rozsah dopadu...

Komplexní průvodce bezpečnou integrací AI platforem s vaší databází pomocí API bran, šifrování, řízení přístupu a monitorovacích strategií.

Klíčové bezpečnostní postupy pro zpřístupnění databází AI:

Bezpečné zpřístupnění databáze znamená umožnit AI systémům přístup k potřebným datům při zachování důsledné kontroly nad tím, jaká data jsou zpřístupněna, komu (nebo čemu), kdy k tomu dochází a jak je tento přístup monitorován a zaznamenáván. Jedná se o zásadně odlišný přístup oproti prostému otevření databáze internetu nebo poskytnutí přímých přihlašovacích údajů AI platforem.

Když hovoříme o zpřístupnění databáze AI platformám, popisujeme záměrné architektonické rozhodnutí vytvořit řízené rozhraní mezi vašimi daty a externími AI systémy. Toto rozhraní funguje jako bezpečnostní kontrolní bod, který v každém kroku vynucuje autentizaci, autorizaci, šifrování a auditní záznamy. Cílem je vytvořit to, co bezpečnostní experti nazývají „single choke point“—centralizované místo, kde lze veškerý přístup monitorovat, řídit a validovat.

Výzvou je, že AI platformy často vyžadují široký přístup k různorodým datovým sadám, aby mohly efektivně fungovat. Model strojového učení může potřebovat analyzovat vzorce chování zákazníků, historii transakcí i informace o produktech najednou. Generativní AI systém může potřebovat prohledávat více tabulek pro zodpovězení komplexních dotazů. Udělení tohoto přístupu bez správných opatření však může vystavit vaši organizaci riziku úniku dat, porušení souladu a interních hrozeb.

Obchodní důvody pro bezpečné zpřístupnění databází AI jsou přesvědčivé. Organizace, které úspěšně integrují AI s datovou infrastrukturou, získávají výrazné konkurenční výhody: rychlejší rozhodování, automatizované poznatky, lepší zákaznickou zkušenost a provozní efektivitu. Rizika jsou však stejně významná.

Úniky dat zahrnující vystavené databáze jsou čím dál častější a nákladnější. Průměrná cena úniku dat v roce 2024 překročila 4,45 milionu USD a incidenty spojené s databázemi tvoří podstatnou část těchto ztrát. Pokud se navíc únik týká osobních údajů podléhajících nařízením jako GDPR nebo CCPA, finanční i reputační škody se dramaticky násobí. Kromě přímých nákladů čelí organizace provozním výpadkům, ztrátě důvěry zákazníků a potenciální právní odpovědnosti.

Výzva se ještě prohlubuje při zapojení AI systémů. AI modely si mohou nechtěně zapamatovat citlivá tréninková data, která lze získat pomocí prompt injection útoků nebo technik extrakce modelu. AI agenti s přístupem k databázi mohou být manipulováni pečlivě sestavenými prompty k provedení nechtěných dotazů či zpřístupnění důvěrných informací. Tyto nové vektory útoků vyžadují bezpečnostní přístupy, které jdou nad rámec tradiční ochrany databáze.

Regulační dohled nad AI navíc rychle roste. Úřady pro ochranu dat po celém světě vydávají doporučení, jak musí organizace nakládat s osobními údaji při využití AI systémů. Soulad s GDPR, CCPA, HIPAA a vznikajícími AI-specifickými předpisy vyžaduje doložit, že jste přijali odpovídající opatření ještě před zpřístupněním jakýchkoliv dat AI platformám.

Než začnete implementovat jakoukoli strategii pro zpřístupnění databáze AI platformám, potřebujete jasně znát svou aktuální bezpečnostní infrastrukturu a datovou krajinu. Toto posouzení by mělo odpovědět na několik klíčových otázek:

Jaká data skutečně máte? Proveďte komplexní inventarizaci a klasifikaci dat. Kategorizujte data podle úrovně citlivosti: veřejná, interní, důvěrná, omezená. Identifikujte data obsahující osobní údaje (PII), údaje z platebních karet (PCI), chráněné zdravotní informace (PHI) či jiné regulované typy dat. Tato klasifikace je základem pro všechna rozhodnutí ohledně řízení přístupu.

Jaké máte aktuální bezpečnostní opatření? Zdokumentujte stávající bezpečnostní opatření databáze: autentizační mechanismy, stav šifrování (při přenosu i v klidu), segmentaci sítě, zálohování a obnovu, možnosti auditního logování. Identifikujte mezery, kde opatření chybí nebo jsou zastaralá.

Jaké máte povinnosti souladu? Zkontrolujte platné předpisy pro váš obor a geografickou polohu. Pokud zpracováváte osobní údaje, je pravděpodobně povinné splnit GDPR. Ve zdravotnictví platí HIPAA. Finanční služby musí zohlednit PCI-DSS. Pochopení těchto povinností formuje vaši bezpečnostní architekturu.

Jakou máte toleranci k riziku? Různé organizace mají různou ochotu přijímat riziko. Poskytovatel zdravotní péče pracující s údaji pacientů má mnohem nižší toleranci k riziku než SaaS firma analyzující anonymizovaná data o používání. Vaše tolerance by měla určovat, jak restriktivní mají být vaše přístupová pravidla.

Nejdůležitějším architektonickým rozhodnutím je nikdy nevystavovat databázi přímo AI platformám. Místo toho implementujte bezpečnou API bránu, která stojí mezi databází a externími systémy. Tato brána se stává jediným kontrolním bodem pro veškerý přístup k databázi.

API brána plní několik klíčových funkcí. Zaprvé poskytuje vrstvu abstrakce, která odděluje AI platformu od struktury vaší databáze. Když změníte strukturu databáze, stačí aktualizovat API, nikoli řešit přístup se všemi AI platformami zvlášť. Zadruhé umožňuje aplikovat jednotná bezpečnostní pravidla na všechny požadavky. Zatřetí vytváří centralizované místo pro monitoring, logování a upozorňování na podezřelou aktivitu.

Při výběru nebo vývoji API brány hledejte řešení podporující identity-aware proxying (IAP). IAP brána autentizuje každý požadavek dříve, než dorazí k databázi, a zajišťuje, že data získávají pouze autorizované systémy. Měla by podporovat více autentizačních metod včetně OAuth 2.0, JWT tokenů, vzájemného TLS (mTLS) a API klíčů. Brána by měla také aplikovat omezení počtu požadavků (rate limiting) a validaci požadavků k blokování chybných či podezřelých dotazů.

Mezi oblíbené možnosti patří cloudová řešení jako AWS API Gateway s IAM integrací, Google Cloud Identity-Aware Proxy, Azure API Management nebo specializovaná řešení jako Hoop či DreamFactory. Každé má své přednosti, ale principem je vždy vytvořit řízenou přístupovou vrstvu.

Jakmile máte API bránu, dalším klíčovým krokem je implementace robustních autentizačních a autorizačních mechanismů. Tyto pojmy se často zaměňují, ale mají rozdílné účely: autentizace ověřuje, kdo (nebo co) požadavek provádí, zatímco autorizace určuje, co má daný subjekt povoleno dělat.

Pro lidské uživatele přistupující k AI systémům, které komunikují s vaší databází, použijte vícefaktorovou autentizaci (MFA). Ta obvykle kombinuje něco, co znáte (heslo), něco, co máte (telefon nebo hardwarový token), a něco, čím jste (biometrie). MFA výrazně snižuje riziko kompromitace účtu, což je častý vstupní bod pro úniky dat.

Pro AI systémy a servisní účty používejte silné, automaticky rotované přihlašovací údaje. Nikdy neukládejte přístupové údaje k databázi přímo v aplikačním kódu nebo konfiguračních souborech. Místo toho využívejte proměnné prostředí, správce tajných klíčů (HashiCorp Vault, AWS Secrets Manager, Azure Key Vault) nebo cloudové systémy, které automaticky rotují přístupové údaje dle plánu.

Kde je to možné, implementujte autentizaci na bázi certifikátů. Vzájemná TLS (mTLS), kdy se ověřuje klient i server pomocí digitálních certifikátů, poskytuje silnější bezpečnost než autentizace heslem. Každá AI platforma nebo služba má unikátní certifikát, který musí být předložen pro přístup k API bráně.

Role-Based Access Control (RBAC) je nejběžnější model autorizace. Definujete role (např. “AI_Analytics_Reader” nebo “ML_Training_Agent”) a přiřazujete těmto rolím oprávnění. Každý AI systém má jednu či více rolí a může provádět jen ty operace, které role povoluje. RBAC je snadno implementovatelný a pochopitelný, ideální pro většinu organizací.

Attribute-Based Access Control (ABAC) je sofistikovanější a flexibilnější. Místo přiřazení rolí definujete politiky na základě atributů požadavku: oddělení uživatele, úroveň klasifikace dat, čas, geografická poloha požadavku, účel přístupu atd. ABAC umožňuje detailnější řízení, ale vyžaduje pečlivou návrhovou politiku.

Dodržujte princip nejmenších oprávnění: každému AI systému přidělte jen ta oprávnění, která opravdu potřebuje. Pokud AI systém potřebuje pouze číst jména a e-maily zákazníků, nedávejte mu přístup k platebním údajům nebo rodným číslům. Pokud potřebuje jen číst data, nedávejte mu práva pro zápis nebo mazání.

Ani se silnou autentizací a autorizací nesmíte zapomenout chránit samotná data. To znamená kombinovat dvě strategie: šifrování a maskování dat.

Šifrování při přenosu chrání data mezi databází a AI platformou. Používejte TLS 1.2 nebo vyšší pro všechna spojení. I když někdo zachytí síťový provoz, data bez šifrovacího klíče nepřečte. Moderní API brány a databáze podporují TLS ve výchozím nastavení, ale ověřte, že je správně zapnuto a nastaveno.

Šifrování v klidu chrání data uložená v databázi. Ani když útočník získá přístup k souborům databáze nebo zálohám, data bez klíčů nepřečte. Většina moderních databází podporuje transparentní šifrování dat (TDE) nebo podobné funkce. Povolením této funkce a správou klíčů zvýšíte ochranu.

Správa klíčů je zásadní. Nikdy neukládejte klíče spolu se šifrovanými daty. Použijte dedikovanou službu pro správu klíčů (KMS), která umožňuje řídit přístup ke klíčům odděleně od databáze. Klíče pravidelně rotujte—alespoň jednou ročně, u citlivých dat i častěji. Implementujte verzování klíčů, aby bylo možné dešifrovat i historická data.

Maskování dat znamená nahrazení citlivých hodnot obfuskovanými nebo syntetickými hodnotami. Například rodné číslo zákazníka může být maskováno jako “XXX-XX-1234”, kdy jsou viditelné jen poslední čtyři číslice. Číslo platební karty jako “--****-4567”. AI systémy tak pracují s daty stejné struktury a distribuce, ale bez citlivých hodnot.

Dynamické maskování dat aplikuje maskovací pravidla při dotazu, podle role uživatele a citlivosti dat. Zástupce zákaznické podpory vidí celé jméno a telefon, zatímco AI analytický systém jen maskované verze. Tento přístup je flexibilnější než statické maskování, protože umožňuje různá pravidla pro různé uživatele.

Implementujte maskování na úrovni sloupců pro nejcitlivější data. Identifikujte sloupce obsahující PII, platební údaje, zdravotní data nebo jiné regulované informace a aplikujte na ně maskovací pravidla. Mnoho databází to umožňuje nativně, případně lze implementovat v API bráně.

Podívejme se, jak RBAC funguje v praxi. Představte si databázi obsahující informace o zákaznících, historii transakcí a produktová data. Chcete ji zpřístupnit třem různým AI systémům: doporučovacímu enginu, systému pro detekci podvodů a analytické platformě.

| AI systém | Požadovaný přístup | Doporučená role | Specifická oprávnění |

|---|---|---|---|

| Doporučovací engine | Profily zákazníků, historie nákupů | AI_RECOMMENDATIONS_READER | SELECT na tabulky customers, orders, products; žádný přístup k platebním metodám ani kontaktním údajům |

| Systém pro detekci podvodů | Detaily transakcí, historie zákazníků | AI_FRAUD_DETECTOR | SELECT na transactions, customers, accounts; přístup k platebním informacím, ale ne ke kontaktům zákazníků |

| Analytická platforma | Agregovaná data o zákaznících | AI_ANALYTICS_READER | SELECT pouze na agregované pohledy; žádný přístup k individuálním záznamům ani detailům transakcí |

Každá role má specifická oprávnění, která omezují, jaká data a jaké operace může daný AI systém provádět. Doporučovací engine nevidí platební informace, protože je nepotřebuje. Systém pro detekci podvodů vidí transakce, ale ne e-maily zákazníků. Analytická platforma vidí jen agregovaná data, ne jednotlivé záznamy.

Tento přístup zajišťuje, že pokud je některý AI systém kompromitován, útočník získá pouze data, která daný systém potřebuje. Dopady bezpečnostního incidentu jsou tak minimalizovány.

Ani se silnými preventivními opatřeními nesmíte zapomenout detekovat a řešit bezpečnostní incidenty. To vyžaduje komplexní monitoring, detailní audit a automatizovanou detekci hrozeb.

Zapněte detailní auditní logování pro veškerý přístup k databázi. Každý dotaz provedený AI systémem by měl být zaznamenán včetně:

Auditní logy ukládejte bezpečně a neměnitelně odděleně od primární databáze. Cloudoví poskytovatelé nabízejí spravované služby pro logování (např. AWS CloudTrail, Google Cloud Logging, Azure Monitor). Uchovávejte logy minimálně jeden rok, u citlivých dat ještě déle.

Implementujte monitoring v reálném čase, který detekuje podezřelé vzorce přístupu k databázi. Nastavte upozornění na:

Moderní nástroje pro monitoring databáze dokáží automaticky rozpoznávat anomálie v dotazech. Nástroje jako Imperva, Satori a další využívají AI pro detekci hrozeb na základě naučených vzorců a upozorňují na odchylky.

Vypracujte plán reakce na incidenty specifický pro bezpečnost databází s AI systémy. Plán by měl obsahovat:

Pro organizace s rozsáhlými a různorodými daty zvažte segmentaci, abyste minimalizovali riziko jejich expozice. Můžete využít několik forem:

Síťová segmentace: Umístěte databázi na oddělený segment sítě s omezeným přístupem. Přímý přístup má pouze API brána. AI platformy komunikují s databází vždy přes API bránu, nikdy přímo.

Segmentace databáze: Pokud databáze obsahuje citlivá i necitlivá data, zvažte jejich uložení do samostatných databází. AI systémům, které nepotřebují citlivá data, stačí zpřístupnit pouze tuto databázi.

Sharding dat: U velmi rozsáhlých dat rozdělte data na menší části (shardy) podle kritéria (např. ID zákazníka, region). AI systémům poskytněte přístup jen k potřebným shardům.

Syntetická data: Pro vývoj a testování používejte syntetická data, která napodobují strukturu a distribuci reálných dat, ale neobsahují citlivé informace. AI systémy lze trénovat a testovat na syntetických datech, což snižuje potřebu zpřístupňovat data reálná.

Zpřístupnění databáze AI platformám má zásadní dopady na soulad s předpisy. Různé regulace kladou různé požadavky:

GDPR (Obecné nařízení o ochraně osobních údajů): Pokud zpracováváte osobní údaje obyvatel EU, platí GDPR. Klíčové požadavky:

CCPA (Kalifornský zákon na ochranu soukromí spotřebitelů): Pokud zpracováváte osobní údaje obyvatel Kalifornie. Klíčové požadavky:

HIPAA (Zákon o přenositelnosti a odpovědnosti zdravotního pojištění): Při práci s chráněnými zdravotními informacemi. Klíčové požadavky:

Oborové standardy: Podle oboru se mohou vztahovat další standardy:

Před zpřístupněním jakýchkoli dat AI platformám proveďte posouzení souladu a zjistěte, jaké předpisy na vaše data dopadají a jaké konkrétní požadavky ukládají.

Řízení bezpečného přístupu AI k databázím znamená koordinaci více systémů a vynucování jednotných pravidel napříč organizací. Právě zde jsou workflow platformy jako FlowHunt neocenitelné.

FlowHunt umožňuje vytvářet automatizované workflow, které bezpečně propojují AI systémy s databázovou infrastrukturou. Místo ruční správy API klíčů, monitoringu přístupů a koordinace týmů nabízí FlowHunt jednotné prostředí pro:

Orchestrace workflow: Definujte komplexní workflow zahrnující databázové dotazy, AI zpracování a transformaci dat. FlowHunt zajišťuje bezpečný a správný průběh každého kroku.

Integrace řízení přístupu: FlowHunt se napojuje na vaše systémy řízení identity a přístupu a automaticky vynucuje pravidla RBAC i princip nejmenších oprávnění napříč AI workflow.

Audit a soulad: FlowHunt vede podrobné auditní záznamy o všech workflow, včetně toho, kdo, kdy a k jakým datům přistupoval. Tyto záznamy usnadňují splnění požadavků GDPR, CCPA, HIPAA a dalších předpisů.

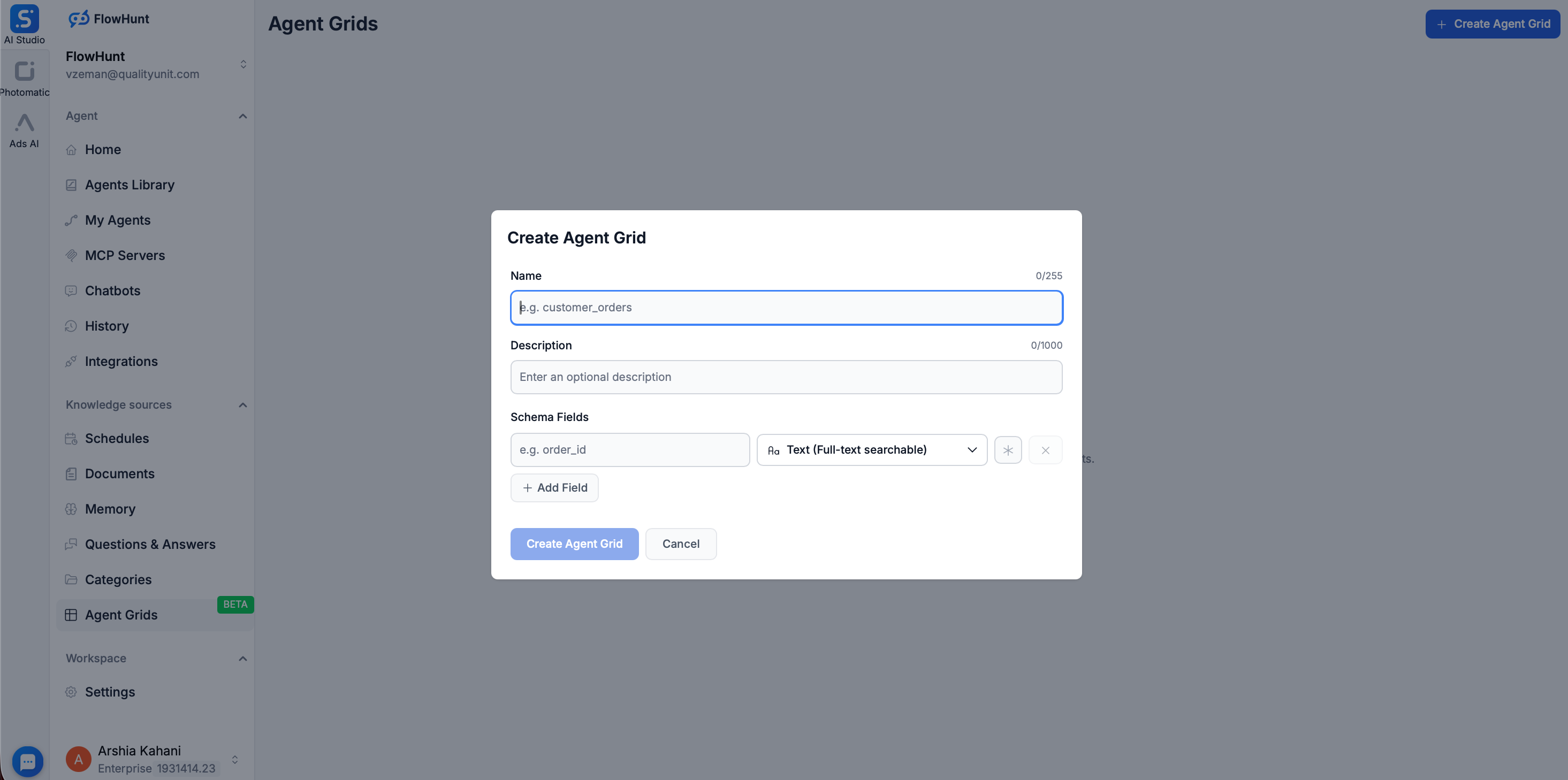

Firmám, které potřebují další vrstvu izolace mezi AI modely a produkční databází, nabízí FlowHunt funkci Grid. Grid umožňuje vytvořit vyhledávatelnou databázi pouhým nahráním strukturovaných souborů, například CSV.

Po nahrání CSV do Gridu FlowHunt využívá Elasticsearch k indexaci dat, čímž z běžného souboru vytvoří dynamický, rychlý Zdroje znalostí. Tento přístup má významné bezpečnostní výhody:

Využitím FlowHunt Grid a workflow zjednodušíte správu bezpečnostních pravidel a zajistíte jednotné vynucování politik napříč organizací.

Implementace bezpečného zpřístupnění databáze AI platformám je vícestupňový proces. Zde je praktická mapa:

Krok 1: Zhodnoťte aktuální stav

Krok 2: Navrhněte architekturu

Krok 3: Implementujte základní opatření

Krok 4: Ochrana dat

Krok 5: Monitoring a audit

Krok 6: Testování a ověření

Krok 7: Provoz a údržba

Při implementaci bezpečného zpřístupnění databáze si dejte pozor na tyto chyby:

Přímé vystavení databáze: Nikdy nevystavujte databázi přímo internetu nebo AI platformám bez API brány. Jde o největší bezpečnostní riziko.

Příliš široká oprávnění: Udělení více oprávnění, než AI systém potřebuje, porušuje princip nejmenších oprávnění. Začněte s minimálními oprávněními a rozšiřujte je jen dle potřeby.

Nedostatečné šifrování: Šifrování pouze při přenosu nebo jen v klidu nestačí. Implementujte šifrování na obou úrovních.

Slabá správa přihlašovacích údajů: Ukládání přihlašovacích údajů v kódu, verzovacím systému nebo jejich neregulérní rotace představují významné riziko.

Nedostatečný monitoring: I se silnými preventivními opatřeními bez monitoringu neodhalíte, že byla opatření obejita.

Ignorování souladu: Pokud začnete řešit soulad až po incidentu, je to drahé. Zahrňte požadavky souladu do architektury od začátku.

Nedostatečné testování: Nasazení bezpečnostních opatření bez důkladného testování znamená riziko jejich selhání v kritických situacích.

S růstem sofistikovanosti AI systémů se objevují nové vektory útoků. Dvě zvlášť nebezpečné hrozby jsou prompt injection a extrakce modelu.

Prompt injection: Útočník vytvoří prompt, který přiměje AI systém k provedení nechtěných akcí. Například prompt může přimět AI ignorovat běžná přístupová pravidla a vydat data, která by vidět neměla. Ochrana:

Extrakce modelu: Útočník interaguje s AI modelem, aby získal informace o tréninkových datech nebo vnitřní struktuře. Ochrana:

Bezpečné zpřístupnění databáze AI platformám není jen možné—je stále více nezbytné pro firmy, které chtějí využít potenciál AI a zároveň chránit své nejcennější aktivum. Klíčem je vrstvený přístup kombinující silnou autentizaci a autorizaci, šifrování, maskování dat, komplexní monitoring a pravidelné testování.

Začněte základy: nikdy nevystavujte databá

Arshia je inženýr AI pracovních postupů ve FlowHunt. Sxa0vzděláním vxa0oboru informatiky a vášní pro umělou inteligenci se specializuje na vytváření efektivních workflow, které integrují AI nástroje do každodenních úkolů a zvyšují tak produktivitu i kreativitu.

Zefektivněte své AI workflow s daty a zároveň udržujte bezpečnost a standardy souladu na podnikové úrovni.

Autonomní AI agenti čelí unikátním bezpečnostním výzvám nad rámec chatbotů. Když AI může procházet web, spouštět kód, posílat e-maily a volat API, rozsah dopadu...

Jailbreaking AI chatbotů obchází bezpečnostní ochranné mechanismy, aby se model choval mimo zamýšlené hranice. Naučte se nejběžnější techniky — DAN, hraní rolí,...

V oblasti bezpečnosti AI se exfiltrace dat vztahuje na útoky, při kterých jsou citlivá data přístupná AI chatbotovi — PII, přihlašovací údaje, obchodní informac...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.