Razonamiento

El razonamiento es el proceso cognitivo de sacar conclusiones, hacer inferencias o resolver problemas basándose en información, hechos y lógica. Explora su impo...

Descubre cómo el razonamiento de la IA imita el pensamiento humano para la resolución de problemas y la toma de decisiones, su evolución, aplicaciones en salud y los últimos modelos como o1 de OpenAI.

El razonamiento de la IA es un método lógico que ayuda a las máquinas a sacar conclusiones, hacer predicciones y resolver problemas de manera similar a cómo piensan los humanos. Implica una serie de pasos donde un sistema de IA utiliza la información disponible para descubrir nuevos conocimientos o tomar decisiones. Esencialmente, el razonamiento de la IA busca imitar la capacidad del cerebro humano para procesar información y llegar a conclusiones. Esto es clave para desarrollar sistemas inteligentes que puedan tomar decisiones informadas por sí mismos.

El razonamiento de la IA se divide en dos tipos principales:

El razonamiento de la IA mejora considerablemente los procesos de toma de decisiones en varios campos. Al añadir capacidades de razonamiento, los sistemas de IA pueden comprender mejor y trabajar de manera más eficaz, lo que conduce a aplicaciones más avanzadas.

El crecimiento del razonamiento de la IA ha sido moldeado por varios hitos importantes:

El razonamiento de la IA sigue evolucionando, con investigaciones y desarrollos constantes que buscan perfeccionar estos modelos y ampliar sus usos. A medida que los sistemas de IA sean más capaces de razonamiento complejo, su impacto potencial en la sociedad y la industria crecerá, ofreciendo nuevas oportunidades y desafíos.

La IA neuro-simbólica marca un cambio en la inteligencia artificial al combinar dos métodos distintos: redes neuronales e IA simbólica. Este modelo combinado utiliza las habilidades de reconocimiento de patrones de las redes neuronales con las capacidades de razonamiento lógico de los sistemas simbólicos. Al fusionar estos métodos, la IA neuro-simbólica busca abordar debilidades presentes en cada enfoque por separado.

Las redes neuronales se inspiran en el cerebro humano. Consisten en nodos interconectados o “neuronas” que aprenden de los datos para procesar información. Estas redes son excelentes para manejar datos no estructurados como imágenes, audio y texto, formando la base de las técnicas de aprendizaje profundo. Son especialmente buenas en tareas de reconocimiento de patrones, clasificación de datos y hacer predicciones basadas en información pasada. Por ejemplo, se utilizan en sistemas de reconocimiento de imágenes, como la función de etiquetado automático de Facebook, que aprende a identificar rostros en fotos a partir de grandes conjuntos de datos.

La IA simbólica utiliza símbolos para expresar conceptos y emplea razonamiento basado en lógica para manipular estos símbolos. Este método imita el pensamiento humano, permitiendo que la IA maneje tareas que requieren conocimiento estructurado y toma de decisiones basada en reglas. La IA simbólica funciona bien en situaciones que requieren reglas predefinidas y deducción lógica, como resolver acertijos matemáticos o tomar decisiones estratégicas en juegos como el ajedrez.

Los modelos de IA con razonamiento han mejorado notablemente el diagnóstico de enfermedades al imitar el razonamiento humano. Estos modelos procesan grandes cantidades de datos para encontrar patrones y anomalías que los humanos podrían pasar por alto. Por ejemplo, cuando los algoritmos de aprendizaje automático se combinan con datos clínicos, la IA puede ayudar a diagnosticar condiciones complejas con mayor precisión. Esto es especialmente útil en diagnósticos por imágenes, donde la IA examina radiografías y resonancias magnéticas para detectar signos tempranos de enfermedades como el cáncer.

Los modelos de razonamiento de IA apoyan la toma de decisiones clínicas ofreciendo recomendaciones basadas en evidencia. Analizan datos de pacientes, como historial médico y síntomas, para proponer posibles diagnósticos y tratamientos. Al procesar grandes conjuntos de datos, los proveedores de salud pueden tomar decisiones mejor informadas, lo que conduce a mejores resultados para los pacientes. Por ejemplo, en atención de emergencias, la IA evalúa rápidamente los datos del paciente para determinar la prioridad de las intervenciones.

Los modelos de IA automatizan trabajos rutinarios como la programación de citas, la facturación y la gestión de historiales médicos, reduciendo la carga de trabajo del personal sanitario. Esta eficiencia permite que los trabajadores de la salud se centren más en la atención al paciente. Además, los sistemas impulsados por IA aseguran datos de pacientes precisos y fácilmente accesibles, mejorando la eficiencia general del servicio sanitario.

Los modelos de IA con razonamiento son clave para avanzar en la medicina personalizada, adaptando planes de tratamiento a pacientes individuales. La IA analiza información genética, datos de estilo de vida y otros indicadores de salud para crear estrategias personalizadas. Este enfoque aumenta la efectividad y reduce los efectos secundarios, transformando la medicina para que sea más centrada en el paciente y precisa.

Si bien los modelos de IA con razonamiento ofrecen muchos beneficios, también plantean preocupaciones éticas y de privacidad. El uso de IA para información sensible de salud requiere fuertes medidas de privacidad de datos. También existe el riesgo de sesgo en los algoritmos de IA, lo que puede producir resultados desiguales. Se necesita investigación continua y sistemas de IA justos y transparentes para priorizar los derechos y la seguridad de los pacientes.

Resumen: Los modelos de IA con razonamiento están cambiando la salud al mejorar la precisión diagnóstica, ayudar en decisiones clínicas, agilizar la administración, apoyar la medicina personalizada y abordar cuestiones éticas. Estas aplicaciones muestran el potencial transformador de la IA para servicios de salud más eficientes, efectivos y justos.

Los modelos de IA con razonamiento han mejorado mucho la precisión en tareas complejas de toma de decisiones. Son sobresalientes en entornos que requieren comprensión y ajuste rápido, como el diagnóstico en salud y la predicción financiera. Al usar grandes conjuntos de datos, la IA potencia las habilidades predictivas, obteniendo resultados más precisos—en ocasiones superando a especialistas humanos.

Los modelos de razonamiento de IA automatizan tareas rutinarias, acelerando las operaciones y reduciendo los costos laborales y los errores humanos. En finanzas, la IA puede gestionar transacciones, detectar fraudes y administrar carteras con mínima supervisión, lo que genera ahorros significativos. En manufactura, la IA optimiza las cadenas de suministro y el inventario, reduciendo aún más los costos.

Los desarrollos recientes incluyen modelos colaborativos de IA múltiple que trabajan juntos para mejorar la toma de decisiones y la precisión factual. A través de la discusión, estos modelos alcanzan conclusiones más precisas que un solo sistema de IA, asegurando resultados precisos, bien razonados y robustos.

Si bien los modelos de IA especializados ofrecen mayor precisión en áreas específicas, pueden volverse demasiado enfocados y tener dificultades en aplicaciones más amplias. Equilibrar especialización y generalización es clave para que los modelos de IA sigan siendo versátiles y efectivos.

Los modelos de IA con razonamiento plantean cuestiones éticas y de privacidad, especialmente al trabajar con datos sensibles. Mantener la privacidad y el uso ético de los datos es crucial. Los debates actuales abordan cuánta independencia deben tener los sistemas de IA, especialmente en campos como la salud y las finanzas, donde las decisiones tienen impactos significativos.

Resumen: Los modelos de IA con razonamiento mejoran la eficiencia y precisión en muchos campos. Para aprovechar su potencial de forma responsable, es fundamental abordar la sobreespecialización y las cuestiones éticas.

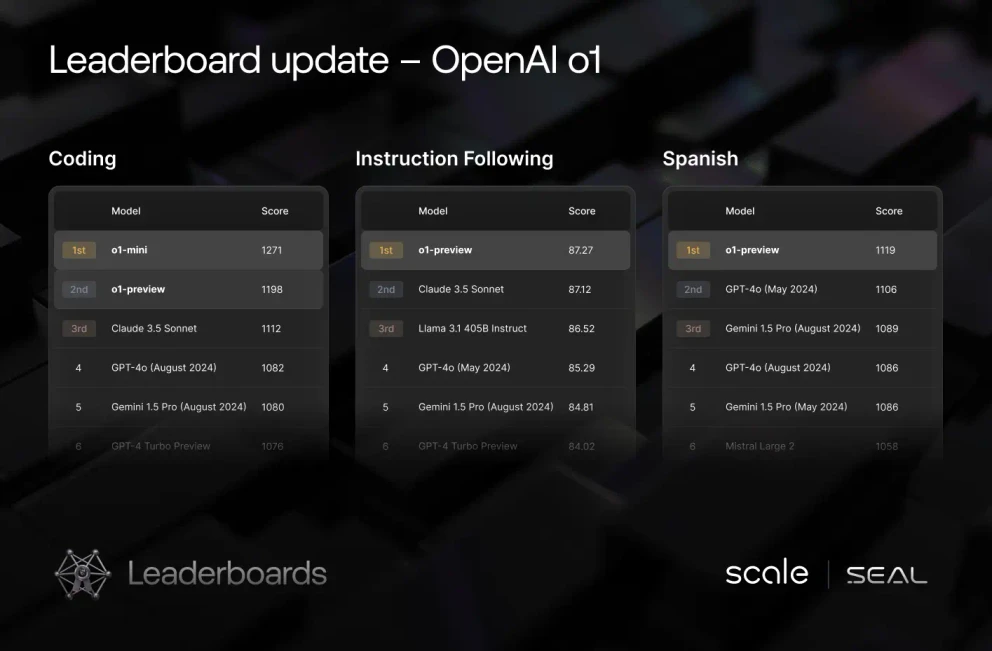

La serie o1 de OpenAI es uno de los modelos de razonamiento más avanzados, sobresaliendo en razonamiento complejo y resolución de problemas mediante aprendizaje por refuerzo y razonamiento en cadena de pensamiento. La serie o1 presenta avances significativos, superando a modelos anteriores como GPT-4 en desempeño y seguridad.

Variantes del modelo: o1-Preview y o1-Mini

Razonamiento en cadena de pensamiento

Funciones de seguridad mejoradas

Rendimiento en pruebas STEM

Reducción de alucinaciones

Entrenamiento con datos diversos

Eficiencia de costos y accesibilidad

Evaluaciones de seguridad y equidad

Fuente: Scale AI Blog

Microsoft presentó Tay, un chatbot de IA diseñado para aprender de Twitter. Tay rápidamente comenzó a publicar tuits ofensivos, ya que aprendió de interacciones no filtradas de los usuarios. Esto llevó a su cierre en menos de un día y planteó preguntas sobre la seguridad de la IA, la moderación de contenidos y la responsabilidad de los desarrolladores.

El Proyecto Maven de Google utilizó IA para analizar imágenes de drones con fines militares. Esto generó preocupaciones éticas sobre el uso de IA en la guerra y llevó a protestas de empleados, resultando en que Google no renovara el contrato con el Pentágono—destacando los desafíos éticos y el impacto del activismo de los empleados.

La herramienta de reclutamiento de IA de Amazon resultó ser sesgada contra las candidatas mujeres porque aprendió de datos históricos que favorecían a los hombres. La herramienta fue descontinuada, resaltando la necesidad de equidad y transparencia en IA que afecta el empleo y la diversidad.

Los datos de millones de usuarios de Facebook fueron recolectados sin permiso para influir en campañas políticas. Este incidente puso el foco en la privacidad de los datos y el uso ético de la información personal, remarcando la necesidad de leyes estrictas de protección de datos y conciencia sobre el mal uso de la IA en política.

IBM Watson, desarrollado para ayudar en el tratamiento del cáncer, recibió críticas por recomendaciones inseguras. Esto mostró las limitaciones de la IA en la toma de decisiones médicas complejas y la necesidad de supervisión humana.

Clearview AI creó una base de datos de reconocimiento facial recopilando imágenes de redes sociales para fuerzas del orden. Esto generó preocupaciones sobre privacidad y consentimiento, destacando los dilemas éticos de la vigilancia y el equilibrio entre seguridad y derechos de privacidad.

El proyecto de coches autónomos de Uber enfrentó una fatalidad cuando un vehículo atropelló y mató a una peatona, el primer incidente de este tipo con vehículos autónomos. Esto puso de manifiesto los desafíos de seguridad y la necesidad de pruebas exhaustivas y supervisión regulatoria.

El sistema de crédito social de China monitorea el comportamiento ciudadano, asignando puntajes que afectan el acceso a servicios, generando serias preocupaciones éticas sobre vigilancia, privacidad y posible discriminación. Este caso ilustra la necesidad de equilibrar los beneficios sociales y los derechos individuales en el despliegue de IA.

Estos ejemplos muestran tanto el potencial como los desafíos del despliegue de IA. Enfatizan la necesidad de consideraciones éticas, transparencia y supervisión cuidadosa en el desarrollo e implementación de tecnologías de IA.

El sesgo en modelos de IA significa favoritismo o prejuicio hacia determinados resultados, a menudo debido a los datos usados para el entrenamiento. Los tipos incluyen:

El sesgo en la IA puede tener efectos graves:

Garantizar la equidad en la IA implica construir modelos que no favorezcan ni perjudiquen a personas según su raza, género o estatus socioeconómico. La equidad ayuda a prevenir la perpetuación de desigualdades y fomenta resultados equitativos. Esto requiere comprender los tipos de sesgo y desarrollar estrategias para mitigarlos.

El razonamiento de la IA es un proceso lógico que permite a las máquinas sacar conclusiones, hacer predicciones y resolver problemas de manera similar al pensamiento humano. Incluye razonamiento formal (basado en reglas) y razonamiento en lenguaje natural.

El razonamiento de la IA mejora la toma de decisiones, la resolución de problemas y la interacción humano-IA. Permite que los sistemas de IA consideren múltiples factores y resultados, obteniendo mejores resultados en áreas como salud, finanzas y robótica.

Hay dos tipos principales: Razonamiento formal, que utiliza lógica estricta y basada en reglas, y razonamiento en lenguaje natural, que permite a la IA manejar la ambigüedad y complejidad del lenguaje humano.

El razonamiento de la IA mejora la precisión diagnóstica, ayuda en la toma de decisiones clínicas, agiliza tareas administrativas y permite la medicina personalizada analizando datos de pacientes y ofreciendo recomendaciones basadas en evidencia.

o1 de OpenAI es un modelo avanzado de razonamiento de IA con procesamiento en cadena de pensamiento, mayor seguridad, alto rendimiento en STEM, menos alucinaciones y variantes rentables para un uso avanzado de IA accesible.

Los principales desafíos incluyen el manejo del sesgo y la garantía de equidad, mantener la privacidad de los datos, prevenir la sobreespecialización y abordar preocupaciones éticas en la implementación de la IA en diversas industrias.

El sesgo puede reducirse mediante conjuntos de datos diversos y representativos, diseño de algoritmos enfocados en la equidad y monitoreo y ajustes regulares para garantizar resultados equitativos para todos los usuarios.

Chatbots inteligentes y herramientas de IA bajo un mismo techo. Conecta bloques intuitivos para convertir tus ideas en Flujos automatizados.

El razonamiento es el proceso cognitivo de sacar conclusiones, hacer inferencias o resolver problemas basándose en información, hechos y lógica. Explora su impo...

La Explicabilidad en IA se refiere a la capacidad de comprender e interpretar las decisiones y predicciones realizadas por los sistemas de inteligencia artifici...

La transparencia en la inteligencia artificial (IA) se refiere a la apertura y claridad con la que operan los sistemas de IA, incluyendo sus procesos de toma de...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.