¿Qué es el chatbot de IA Google Gemini?

Descubre qué es Google Gemini, cómo funciona y cómo se compara con ChatGPT. Conoce sus capacidades multimodales, precios y aplicaciones reales para 2025.

Explora cómo Google I/O 2025 está inaugurando la Era de Gemini con actualizaciones impulsadas por IA en todo el ecosistema de Google, y descubre cómo FlowHunt lleva el último modelo Gemini 2.5 Flash a tus proyectos de IA.

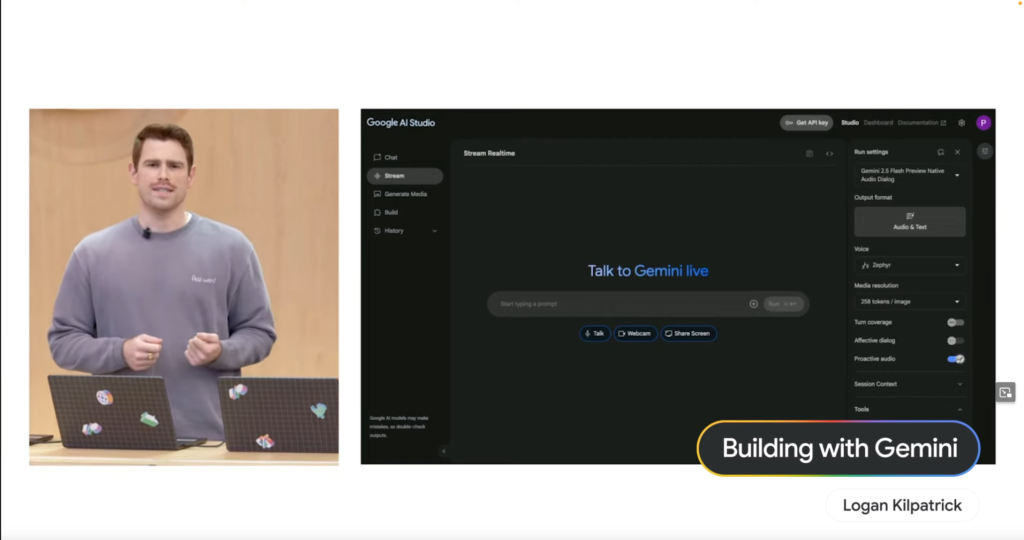

Logan Kilpatrick dio inicio presentando cómo Project Astra busca que la interacción con la IA sea completamente natural. Muchas de estas capacidades ya están accesibles a través de la Live API, impulsada por el nuevo modelo de audio nativo Gemini 2.5 Flash. Este modelo es más hábil para ignorar sonidos externos y admite de forma nativa 24 idiomas, allanando el camino para experiencias de IA más intuitivas y receptivas.

Paige Bailey demostró el poder de construir con Gemini mediante una demo de “Keynote Companion”. Usando Google AI Studio, mostró cómo la IA podía entender comandos hablados, interactuar con datos en tiempo real (como mostrar Shoreline Amphitheatre en un mapa) e incluso realizar búsquedas complejas como encontrar cafeterías cercanas con Wi-Fi, todo en un flujo conversacional. Esto resalta las impresionantes capacidades multimodales de Gemini.

Adaptativo por diseño: Compose y Android XR

Diana Wong enfatizó el compromiso de Google con facilitar la creación de interfaces adaptativas. Las nuevas funciones en la librería Compose Adaptive Layouts, como la expansión de paneles, están diseñadas para ayudar a los desarrolladores a crear apps que se ajusten sin problemas a distintos tamaños de pantalla y factores de forma. Esta filosofía adaptativa se extiende directamente a Android XR, la plataforma de realidad extendida construida en colaboración con Samsung. Los desarrolladores pueden comenzar a crear para futuros visores como Project Moohan ahora mismo, sabiendo que sus apps adaptativas estarán listas para esta nueva frontera inmersiva.

Codificación más inteligente: Agentes de IA en Android Studio

Florina Muntenescu presentó una novedad revolucionaria para los desarrolladores de Android: un nuevo agente de IA que llegará pronto a Android Studio. Este agente está diseñado para ayudar con tareas tediosas como actualizaciones de versiones. En una demo impactante, el agente de IA analizó un proyecto antiguo, identificó fallos de compilación y luego utilizó Gemini para averiguar cómo solucionarlos, iterando hasta que la compilación tuvo éxito. Esto promete agilizar significativamente el flujo de trabajo de desarrollo.

Interfaces web optimizadas: Nuevas capacidades para elementos complejos

Una Kravets destacó nuevas capacidades web que simplifican la creación de elementos de interfaz comunes pero sorprendentemente complejos. Los desarrolladores encontrarán más fácil construir componentes sólidos y accesibles como carruseles y tarjetas flotantes, mejorando la experiencia de usuario en la web.

Gemini Nano en la web: APIs de IA multimodal sin límites

Addy Osmani anunció que Gemini Nano está desbloqueando nuevas capacidades multimodales directamente en la web. Nuevas APIs de IA multimodal integradas permitirán a los usuarios interactuar con Gemini usando entrada de audio e imagen. Una demo de “Cinemal” mostró esto permitiendo a un usuario tomar una foto de un boleto con su cámara web, y la IA en el dispositivo localizó instantáneamente su sección de asiento en un mapa del teatro: un poderoso ejemplo de procesamiento en el dispositivo.

David East demostró cómo Firebase está integrando IA para acelerar el desarrollo de apps. Ahora los desarrolladores pueden llevar sus diseños de Figma a la vida en Firebase Studio con ayuda de Builder.io. ¿Lo impresionante? No es solo un volcado monolítico de código; la exportación de Figma genera componentes React individuales y bien aislados. Usando Gemini dentro de Firebase Studio, David mostró cómo luego podía pedir fácilmente a la IA que añadiera funciones como un botón de “Agregar al carrito” en la página de detalles de un producto, que la IA implementó de inmediato, actualizando el código y la vista previa web en tiempo real.

Gemma 3n: IA potente con solo 2GB de RAM

Gus Martins trajo buenas noticias para la comunidad de código abierto con el anuncio de Gemma 3n. Este modelo increíblemente eficiente puede funcionar con tan solo 2GB de RAM, haciéndolo mucho más rápido y ligero para hardware móvil en comparación con Gemma 3. Es fundamental que Gemma 3n ahora incluya comprensión de audio, siendo realmente multimodal.

SignGemma: cerrando brechas de comunicación

Google también está ampliando los límites de la accesibilidad con SignGemma. Esta nueva familia de modelos está entrenada para traducir lenguaje de señas (con un enfoque actual en el American Sign Language – ASL) en texto de lenguaje hablado, abriendo nuevas vías para la comunicación y la inclusión.

¿Te inspiran los increíbles avances de IA en Google I/O? ¿Quieres empezar a crear sofisticados agentes de IA que puedan entender, razonar y actuar?

FlowHunt es la plataforma impulsada por IA que te ayuda a crear potentes agentes de IA sin necesidad de ser un experto en aprendizaje automático. Diseña flujos de trabajo complejos, integra diversas herramientas y despliega agentes inteligentes con facilidad.

¿Y la buena noticia? Tal y como se destacó en el keynote, ¡FlowHunt ahora soporta el revolucionario Gemini 2.5 Flash! Esto significa que puedes empezar a aprovechar de inmediato su velocidad, eficiencia y mejoradas capacidades de audio para crear agentes de IA aún más potentes y receptivos.

¡Prueba los nuevos modelos implementados en menos de 24 horas en FlowHunt ahora mismo!

Google I/O 2025 destaca el cambio de la compañía hacia un futuro nativo de IA, con los modelos Gemini en el centro de nuevos productos y funciones en Android, la web y herramientas para desarrolladores.

Gemini 2.5 Flash es el último modelo de IA de audio nativo de Google, que ofrece procesamiento de audio rápido, eficiente y multilingüe, ahora disponible para desarrolladores e integrado en plataformas como FlowHunt.

Gemma 3n es un modelo de IA eficiente que funciona con tan solo 2GB de RAM y capacidades multimodales (audio). SignGemma es una familia de modelos que traduce el lenguaje de señas, enfocándose en ASL, en texto de lenguaje hablado.

FlowHunt ahora admite Gemini 2.5 Flash, lo que permite a los usuarios crear agentes de IA avanzados con mejores capacidades de audio y multimodales, sin requerir experiencia en aprendizaje automático.

Android presentó interfaces adaptativas, soporte XR y agentes de IA en Android Studio para una codificación más inteligente. En la web, Gemini Nano habilita API de IA multimodales para entrada de audio e imagen directamente en los navegadores.

Yasha es un talentoso desarrollador de software especializado en Python, Java y aprendizaje automático. Yasha escribe artículos técnicos sobre IA, ingeniería de prompts y desarrollo de chatbots.

Experimenta el poder del nuevo modelo Gemini 2.5 Flash en FlowHunt y crea agentes de IA de próxima generación con avanzadas capacidades multimodales.

Descubre qué es Google Gemini, cómo funciona y cómo se compara con ChatGPT. Conoce sus capacidades multimodales, precios y aplicaciones reales para 2025.

Gemini Flash 2.0 está estableciendo nuevos estándares en IA con un rendimiento mejorado, velocidad y capacidades multimodales. Explora su potencial en aplicacio...

Descubre por qué Gemini 3 Flash de Google está revolucionando la IA con un rendimiento superior, menores costos y velocidades más rápidas, incluso superando a G...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.