MCP: Protocolo de Contexto de Modelo

El Protocolo de Contexto de Modelo (MCP) es una interfaz de estándar abierto que permite a los Modelos de Lenguaje Grandes (LLM) acceder de forma segura y consi...

La IA agentica está transformando la automatización de flujos de trabajo con el Protocolo de Contexto de Modelo (MCP), permitiendo una integración dinámica de agentes de IA con recursos diversos. Descubre cómo el MCP estandariza el acceso a contexto y herramientas para aplicaciones potentes de IA agentica.

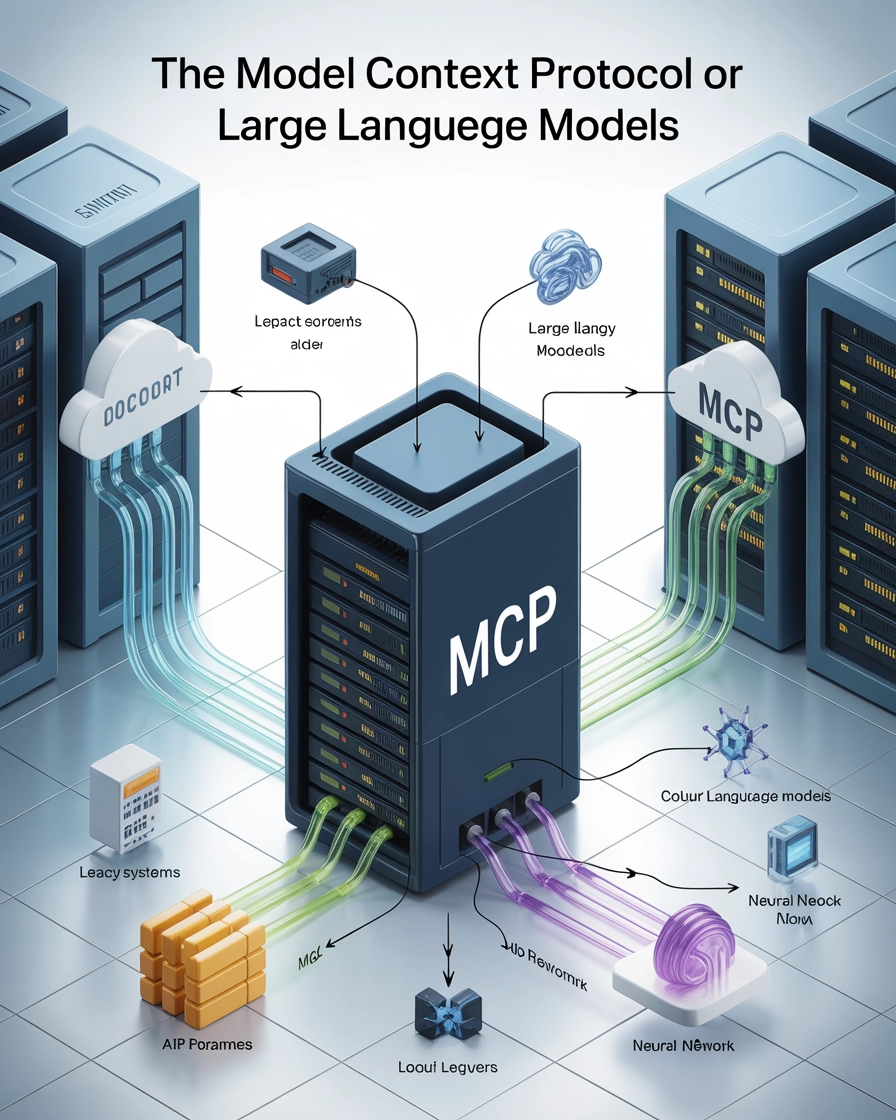

La IA agentica está redefiniendo el panorama de la automatización de flujos de trabajo, empoderando a los sistemas para actuar de manera autónoma, integrar recursos digitales diversos y entregar valor real más allá de la simple generación de textos estáticos. Permitiendo esta evolución está el Protocolo de Contexto de Modelo (MCP): un protocolo abierto para la estandarización de contexto en modelos de lenguaje de gran escala (LLM) que rápidamente está emergiendo como la piedra angular de la integración escalable de IA.

En su esencia, el Protocolo de Contexto de Modelo (MCP) establece un marco estandarizado y de código abierto para exponer y consumir contexto, herramientas externas y fuentes de datos dentro de aplicaciones impulsadas por LLM. Esto representa un salto significativo respecto a los modelos tradicionales de pregunta-respuesta, donde la interacción se limita al intercambio de texto plano. La IA agentica, en contraste, requiere la capacidad de invocar herramientas, acceder a datos en vivo, llamar a APIs y responder de manera dinámica a información cambiante, todo lo cual es posible gracias a MCP.

A través de un conjunto de endpoints RESTful bien definidos —aprovechando HTTP, Server-Sent Events y JSON RPC— MCP permite que las aplicaciones anfitrionas (clientes) descubran, describan e interactúen con una amplia gama de recursos proporcionados por los servidores. Esto significa que los sistemas de IA pueden identificar automáticamente herramientas y datos disponibles, obtener descripciones estructuradas y solicitar acciones, todo a través de una interfaz común y componible.

MCP suele compararse con el USB-C para aplicaciones de IA, y con razón: ambos apuntan a proporcionar una experiencia universal y plug-and-play. Sin embargo, mientras que USB-C es un estándar físico de hardware para la conectividad de dispositivos, MCP es un protocolo de software diseñado específicamente para el ámbito digital. Su innovación radica en hacer que las herramientas y recursos no solo sean conectables, sino también descubribles y accesibles dinámicamente por cualquier sistema de IA agentica compatible.

A diferencia de las integraciones codificadas a mano, MCP permite a los desarrolladores registrar nuevas herramientas o fuentes de datos como servidores, haciéndolas instantáneamente disponibles para cualquier cliente compatible. Esta modularidad y flexibilidad permiten la composición y reconfiguración rápida de la automatización de flujos de trabajo de IA, sin necesidad de reescrituras extensas o integraciones personalizadas.

Imagina desarrollar un asistente de programación agentico. Tradicionalmente, acoplarías de manera rígida APIs de calendario, sistemas de reservas y datos internos, incrustando lógica compleja directamente en tu aplicación. Con MCP, todos estos recursos se exponen como endpoints descubribles. El cliente de IA consulta al servidor MCP por las capacidades disponibles, presenta el contexto y las solicitudes al LLM y, según las recomendaciones del modelo, recupera datos o invoca herramientas sin problemas.

Por ejemplo, si la IA necesita una lista de cafeterías cercanas para agendar una reunión, simplemente consulta al servidor MCP, obtiene resultados actualizados y los introduce en la siguiente pregunta. Las descripciones de herramientas, parámetros y esquemas de invocación se proporcionan en forma estructurada, permitiendo que el LLM recomiende acciones precisas que el cliente puede ejecutar con total transparencia y control.

Esta arquitectura no solo permite flujos de trabajo de IA agentica más ricos, sino que también garantiza que los recursos se compartan y actualicen fácilmente entre equipos y organizaciones, fomentando un ecosistema vibrante de componentes de IA reutilizables.

La adopción de MCP está acelerándose entre empresas visionarias y profesionales de IA que buscan operacionalizar la IA agentica a gran escala. Su base open source garantiza una amplia accesibilidad, mejora continua y un sólido apoyo comunitario. Plataformas y proveedores líderes —incluidos aquellos en los ecosistemas de Kafka y Confluent— ya están construyendo servidores compatibles con MCP, expandiendo instantáneamente el universo de fuentes de datos y herramientas de automatización disponibles para la integración de IA agentica.

Para los responsables de IA, adoptar MCP significa desbloquear toda la agilidad, escalabilidad y componibilidad de los sistemas de IA, permitiendo desde la automatización interna hasta sofisticados servicios de IA orientados al cliente sobre una columna vertebral unificada y estandarizada.

Al adoptar el Protocolo de Contexto de Modelo, las organizaciones se posicionan a la vanguardia de la integración moderna de IA, equipando a los equipos para construir, adaptar y escalar soluciones de IA agentica con una velocidad y eficacia inigualables. MCP es más que un protocolo: es la puerta de entrada a la próxima era de la automatización de flujos de trabajo de IA.

Durante años, el poder de los modelos de lenguaje de gran escala (LLM) ha estado limitado por la naturaleza estática de sus interacciones. En el paradigma tradicional, un usuario introduce un prompt y el LLM devuelve una respuesta en texto. Aunque esto funciona para consultas simples basadas en información, limita fundamentalmente lo que la IA puede lograr en automatización empresarial e integración de flujos de trabajo.

Las herramientas tradicionales de LLM operan dentro de un marco rígido de entrada/salida de palabras. Solo generan salidas textuales, sin importar la sofisticación de la petición. Esto implica:

Pongámoslo en perspectiva: imagina que le pides a un LLM tradicional, “Agenda una reunión para tomar café con Peter la próxima semana.” El modelo puede ofrecer consejos sobre programación o pedir aclaraciones, pero no puede consultar tu calendario, determinar la disponibilidad de Peter, buscar una cafetería ni crear una invitación. Cada paso sigue siendo manual y cada contexto debe proporcionarse una y otra vez.

Aquí entra la IA agentica: la siguiente evolución en automatización inteligente. Los modelos de IA agentica no solo responden preguntas, sino que toman acciones. Invocan herramientas externas, acceden a datos empresariales actualizados y automatizan flujos de trabajo de varios pasos.

¿Por qué es necesario? Porque los escenarios de negocio reales son dinámicos y requieren más que palabras. Por ejemplo:

En cada escenario, el enfoque antiguo deja al usuario con consejos o soluciones parciales, mientras que la IA agentica entrega resultados integrados y accionables.

El Protocolo de Contexto de Modelo (MCP) es la infraestructura crítica que transforma las herramientas LLM estáticas en potentes motores de IA agentica. MCP conecta los modelos de lenguaje con el mundo real —datos empresariales, APIs, archivos y herramientas de automatización— permitiendo una integración perfecta de IA.

¿Cómo resuelve MCP estos desafíos?

Ejemplo práctico:

MCP cambia las reglas del juego para la automatización de flujos de trabajo de IA en la empresa:

En resumen, MCP cierra la brecha entre modelos centrados solo en lenguaje y la verdadera integración de IA. Permite a las empresas superar los prompts estáticos y los modelos aislados, desbloqueando el verdadero potencial de la IA agentica para impulsar eficiencia, productividad y automatización a escala.

A medida que las empresas aceleran la adopción de IA agentica, la demanda de integración de IA fluida y escalable entre los recursos organizacionales es mayor que nunca. Los negocios modernos dependen de agentes de IA no solo para generar información, sino para tomar acciones significativas —invocando herramientas, automatizando flujos de trabajo y respondiendo a eventos del mundo real. Lograr esto en un contexto empresarial requiere un enfoque robusto y estandarizado, y ahí es donde entra el Protocolo de Contexto de Modelo (MCP).

La IA agentica de nivel empresarial requiere mucho más que integraciones estáticas y codificadas a mano. Los agentes de IA deben acceder a una amplia variedad de recursos actualizados —desde bases de datos internas y sistemas de archivos hasta APIs externas, plataformas de streaming como Kafka y herramientas especializadas. La naturaleza estática de las integraciones convencionales —donde cada conexión a un recurso o herramienta se inserta directamente en la aplicación de IA— rápidamente conduce a una arquitectura monolítica y frágil. Este enfoque no solo es difícil de escalar, sino que también frena la innovación, ya que cada recurso o herramienta nueva demanda codificación y mantenimiento personalizado.

En la práctica, las empresas suelen necesitar agentes de IA que puedan:

Estos requisitos ponen en evidencia la insuficiencia de las integraciones monolíticas y codificadas a mano, especialmente cuando las organizaciones buscan escalar sus capacidades de IA agentica entre equipos, departamentos y casos de uso.

Las integraciones codificadas a mano encierran la lógica de negocio y la conectividad a recursos dentro de aplicaciones de IA individuales. Por ejemplo, si una empresa quiere que un agente de IA gestione la programación de reuniones, el agente podría incluir directamente código para APIs de calendario, búsquedas de ubicación y sistemas de reservas. Esto aísla la lógica, haciéndola inaccesible para otros agentes o aplicaciones —creando silos, duplicando esfuerzos y dificultando el mantenimiento.

Estos diseños monolíticos introducen varios cuellos de botella:

El Protocolo de Contexto de Modelo (MCP) aborda estos desafíos al servir como un protocolo estandarizado y conectable para conectar agentes de IA con recursos y herramientas empresariales. Piensa en MCP como la columna vertebral que permite a la IA descubrir, acceder y orquestar acciones de manera flexible entre un ecosistema dinámico de capacidades —sin codificación manual ni actualizaciones manuales.

En su núcleo, MCP introduce una arquitectura clara cliente-servidor:

La comunicación entre el agente (cliente) y el servidor de recursos ocurre por HTTP usando JSON-RPC, permitiendo notificaciones asíncronas, descubrimiento de capacidades y acceso a recursos. El agente puede interrogar dinámicamente al servidor MCP por herramientas, fuentes de datos o prompts disponibles —haciendo que los recursos sean descubribles y conectables.

Considera un agente de IA empresarial encargado de programar reuniones. En lugar de codificar integraciones para calendarios, APIs de ubicación y sistemas de reservas, el agente consulta al servidor MCP por las capacidades disponibles. El servidor describe sus herramientas (por ejemplo, integración de calendario, reserva de citas) y expone recursos (por ejemplo, lista de cafeterías cercanas, salas de reuniones disponibles). El agente puede entonces seleccionar e invocar dinámicamente las herramientas adecuadas según la intención del usuario —como: “Agenda un café con Peter la próxima semana.”

Con MCP, si otro equipo quiere que su agente reserve salas de conferencias o acceda a diferentes recursos, simplemente registra esas capacidades en el servidor MCP. No hay necesidad de reescribir la lógica del agente ni duplicar esfuerzos de integración. La arquitectura es inherentemente escalable, componible y descubrible.

Una fortaleza clave de MCP en el contexto empresarial es su componibilidad. Los servidores pueden actuar como clientes de otros servidores MCP —permitiendo integraciones modulares y en capas. Por ejemplo, un servidor MCP conectado a un tema de Kafka puede proporcionar datos de eventos en tiempo real a múltiples agentes, sin que cada uno tenga que implementar código personalizado para Kafka. Este diseño conectable soporta despliegues a escala empresarial, donde los recursos, herramientas e integraciones evolucionan rápidamente.

Al adoptar MCP, las empresas obtienen:

MCP permite un futuro donde la IA empresarial no está limitada por la rigidez de integraciones codificadas a mano, sino potenciada por una arquitectura flexible, componible y escalable. Para las organizaciones que buscan operacionalizar la IA agentica a escala, MCP no es solo una opción técnica: es una base esencial.

La integración moderna de IA está evolucionando rápidamente, exigiendo arquitecturas flexibles y escalables que permitan la interacción fluida entre agentes de IA y herramientas o datos reales. El Protocolo de Contexto de Modelo (MCP) representa un salto en la IA agentica, ofreciendo una arquitectura robusta y descubrible que supera el simple hecho de insertar funciones de IA en aplicaciones de escritorio. Vamos a profundizar en cómo la arquitectura MCP permite sistemas de IA agentica conectables a través de su modelo cliente-servidor, comunicaciones versátiles y potentes funciones de descubribilidad.

En su núcleo, MCP utiliza una arquitectura cliente-servidor clara que separa responsabilidades y maximiza la modularidad:

Esta separación significa que la aplicación anfitriona no necesita “incrustar” todas las integraciones o lógica de herramientas. En su lugar, puede descubrir, consultar y utilizar recursos externos dinámicamente a través de servidores MCP, haciendo el sistema altamente conectable y mantenible.

MCP soporta dos modos principales de comunicación entre cliente y servidor:

Conexiones locales (Standard IO/Tuberías):

Conexiones remotas (HTTP, Server Sent Events, JSON RPC):

Una característica destacada de MCP es su descubribilidad inherente, haciendo la arquitectura de agentes de IA altamente dinámica:

Este mecanismo permite a las aplicaciones anfitrionas soportar nuevas integraciones o fuentes de datos sin modificar el código: solo “conectando” nuevos servidores o herramientas.

A continuación se muestra un flujo visual simplificado que representa la arquitectura MCP:

+-------------------------------+

| Aplicación Anfitriona |

| (ejecuta librería cliente) |

+---------------+---------------+

|

| 1. Prompt de usuario

v

+---------------+---------------+

| Cliente MCP |

+---------------+---------------+

|

| 2. Descubre capacidades (HTTP/Local)

v

+-----------------------------------------------+

| Servidor MCP |

| (expone endpoints RESTful, recursos, |

| herramientas, prompts) |

+----------------+------------------------------+

|

+-------------+----------------+

| 3. Proporciona: |

| - Lista de recursos/herram. |

| - Descripciones/esquemas |

+------------------------------+

|

v

+-----------------------------------------------+

| Ejemplo de flujo de trabajo: |

| - Cliente pregunta al LLM: "¿Qué recursos?" |

| - LLM responde: "Usa recurso X, herramienta Y"|

| - Cliente obtiene X, invoca Y |

| - Resultados al usuario |

+-----------------------------------------------+

Con MCP, la integración de IA pasa de conexiones estáticas y codificadas a una arquitectura agentica dinámica, escalable y componible. Los clientes pueden descubrir y aprovechar nuevas herramientas o fuentes de datos en tiempo de ejecución, y los servidores pueden apilarse o componerse —llevando la verdadera modularidad a los sistemas de agentes de IA. Esta arquitectura no es solo para aplicaciones de escritorio de aficionados, sino que está orientada a soluciones profesionales y empresariales donde la flexibilidad y extensibilidad son críticas.

En resumen: La arquitectura MCP permite sistemas de IA verdaderamente agenticos —capaces de descubrir e invocar herramientas, acceder a datos actualizados o propietarios y extender dinámicamente sus capacidades, todo mediante un protocolo estandarizado y robusto. Esta es la puerta de entrada a la nueva generación de IA agentica conectable y profesional.

Vamos a lo práctico y veamos cómo la IA agentica, impulsada por el Protocolo de Contexto de Modelo (MCP), transforma una simple agenda —como tomar café con un amigo— en un flujo de trabajo conectado y fluido. Esta sección te guía a través de un caso de uso real, mostrando cómo una app anfitriona, cliente MCP, servidor MCP y un LLM (Modelo de Lenguaje de Gran Escala) interactúan para automatizar y orquestar citas. Resaltaremos la componibilidad, conectabilidad e integración dinámica que hacen de MCP un cambio de paradigma para la automatización de flujos de trabajo de IA.

Imagina que quieres crear una app que programe encuentros para tomar café —ya sea con un colega, un amigo o alguien especial. Así es como la IA agentica, usando el stack MCP, gestiona el flujo:

El recorrido comienza con una aplicación anfitriona (imagina tu app o servicio de agendas). Esta app integra la librería cliente MCP, que actúa como puente entre tu aplicación y los recursos de IA agentica.

El cliente MCP inicia el proceso aceptando el prompt del usuario, por ejemplo:

“Quiero tomar café con Peter la próxima semana.”

En este punto, la app anfitriona necesita interpretar y actuar sobre esta petición. Necesita algo más que una respuesta textual: requiere acciones reales.

Para saber qué acciones son posibles, el cliente MCP consulta al servidor MCP por la lista de capacidades, herramientas y recursos disponibles (como APIs de calendario, listados de cafeterías o sistemas de reservas). Todo esto es descubrible mediante un endpoint RESTful bien definido, lo que significa que se pueden agregar nuevas herramientas sin modificar la app principal.

El cliente puede consultar un archivo de configuración con URLs de servidores registrados para saber dónde buscar.

El cliente MCP envía entonces el prompt del usuario, junto con la lista de recursos disponibles, al LLM. El LLM ayuda a decidir cuáles son relevantes:

Por recomendación del LLM, el cliente MCP obtiene el recurso solicitado (por ejemplo, la lista de cafeterías locales) del servidor MCP. Estos datos se adjuntan al siguiente prompt para el LLM, brindándole el contexto necesario para recomendar pasos accionables.

El LLM ahora cuenta con la intención del usuario y los últimos datos del recurso. Devuelve una recomendación como:

Las descripciones y esquemas de cada herramienta se entregan al LLM como datos estructurados (no solo texto), permitiéndole recomendar invocaciones y parámetros específicos.

El cliente MCP toma las recomendaciones del LLM y activa las invocaciones necesarias:

La app anfitriona, gracias a la arquitectura MCP, puede conectar o intercambiar herramientas y recursos según sea necesario —sin reescribir la lógica central.

Aquí un diagrama paso a paso del flujo de programación con IA agentica y MCP:

flowchart TD

A[Solicitud de usuario: "Café con Peter la próxima semana"] --> B[App anfitriona (con cliente MCP)]

B --> C{Descubre capacidades}

C --> D[Servidor MCP: Retorna recursos/herramientas]

D --> E[LLM: "¿Qué recursos necesito?"]

E --> F[LLM: "Consulta directorio de cafeterías"]

F --> G[Cliente MCP: Obtiene recurso del servidor MCP]

G --> H[LLM: Recibe prompt de usuario + datos de recurso]

H --> I[LLM: Recomienda invocación de herramientas]

I --> J[Cliente MCP: Ejecuta calendario y reservas]

J --> K[¡Cita agendada!]

Componibilidad:

Puedes construir flujos complejos combinando herramientas y recursos independientes. Tu servidor MCP puede incluso ser cliente de otros servidores, encadenando capacidades y haciendo el sistema altamente modular.

Conectabilidad:

¿Necesitas agregar una nueva herramienta (como un buscador de restaurantes o un calendario diferente)? Solo regístrala en tu servidor MCP—no hay que refactorizar la app.

Integración dinámica:

En tiempo de ejecución, el sistema descubre y orquesta dinámicamente los componentes necesarios según la intención del usuario y los recursos disponibles. El LLM gestiona la lógica, así tu app se mantiene mantenible y preparada para el futuro.

Con MCP, la IA agentica trasciende a los asistentes de chat estáticos. Obtienes un motor de flujos de trabajo vivo, que se integra activamente con tus datos y herramientas empresariales. Agendar café, reuniones o automatizar procesos complejos —todo se vuelve plug-and-play, componible y escalable.

En resumen: MCP te permite construir aplicaciones de IA agentica como un profesional, haciendo la automatización de flujos de trabajo de IA práctica, modular y lista para la empresa.

¿Listo para probarlo? Profundiza con la documentación oficial de Model Context Protocol y empieza a construir flujos de trabajo agenticos más inteligentes hoy mismo.

El Protocolo de Contexto de Modelo (MCP) está revolucionando la integración de IA, especialmente al construir IA agentica y automatizar flujos de trabajo con herramientas LLM. Ya sea que desarrolles agentes sofisticados o busques agilizar operaciones empresariales, MCP ofrece un conjunto de potentes características —conectabilidad, descubribilidad, componibilidad, seguridad y flexibilidad de proveedores— que hacen la automatización de flujos de trabajo de IA sencilla y preparada para el futuro.

Prompt de usuario: “Quiero tomar café con Peter la próxima semana.”

Flujo de trabajo paso a paso:

- Agente (Aplicación anfitriona): Consulta al servidor MCP por recursos disponibles (por ejemplo, API de calendario, buscador de cafeterías).

- Agente pregunta al LLM: Determina qué herramientas se necesitan para la tarea.

- LLM responde: Identifica recursos requeridos como listas de cafeterías y creadores de citas.

- Agente invoca: Obtiene datos y agenda la reunión —sin código personalizado, solo integración plug-and-play.

En resumen:

El Protocolo de Contexto de Modelo ofrece extensibilidad plug-and-play real, descubribilidad, seguridad y flexibilidad de proveedores para la IA agentica y la automatización de flujos de trabajo impulsados por LLM. Al adoptar MCP, tu equipo acelera la integración de IA, mejora la seguridad y se mantiene ágil en un ecosistema en rápida evolución —permitiéndote construir y escalar soluciones de IA más inteligentes y adaptables.

¿Listo para llevar tus flujos de IA al siguiente nivel? ¡Adopta MCP y desbloquea una integración de IA fluida, segura y escalable para tu empresa!

El Protocolo de Contexto de Modelo (MCP) está

El Protocolo de Contexto de Modelo (MCP) es un protocolo abierto diseñado para estandarizar el acceso al contexto y a herramientas en aplicaciones de IA agentica, permitiendo la integración dinámica de agentes de IA con recursos y flujos de trabajo diversos.

MCP permite que los agentes de IA descubran, accedan e invoquen herramientas externas, APIs y fuentes de datos de forma dinámica, transformando las interacciones estáticas con LLM en flujos de trabajo escalables y accionables que automatizan tareas e integran sistemas empresariales sin problemas.

Usar MCP para la integración de IA proporciona beneficios como el descubrimiento dinámico de recursos, arquitectura modular, reducción de duplicidad de esfuerzos y la posibilidad de escalar flujos de trabajo de IA entre equipos y aplicaciones sin codificar integraciones a mano.

Puedes comenzar con MCP y la IA agentica explorando la plataforma de Flowhunt, que proporciona herramientas para construir, adaptar y escalar soluciones de IA agentica usando el Protocolo de Contexto de Modelo. Regístrate para una cuenta gratuita y comienza a integrar flujos de trabajo de IA en tus aplicaciones.

Viktor Zeman es copropietario de QualityUnit. Incluso después de 20 años liderando la empresa, sigue siendo principalmente un ingeniero de software, especializado en IA, SEO programático y desarrollo backend. Ha contribuido a numerosos proyectos, incluidos LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab y muchos otros.

Desbloquea el poder de la IA agentica con la integración del Protocolo de Contexto de Modelo de Flowhunt. Construye flujos de trabajo de IA dinámicos y escalables que acceden a recursos diversos y automatizan tareas sin problemas.

El Protocolo de Contexto de Modelo (MCP) es una interfaz de estándar abierto que permite a los Modelos de Lenguaje Grandes (LLM) acceder de forma segura y consi...

Descubre qué son los servidores MCP (Model Context Protocol), cómo funcionan y por qué están revolucionando la integración de la IA. Aprende cómo MCP simplifica...

Ejemplo rápido de cómo desarrollar tu propio servidor MCP con Python.

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.