Boosting

Le boosting est une technique d'apprentissage automatique qui combine les prédictions de plusieurs apprenants faibles pour créer un apprenant fort, améliorant l...

La régression par forêt aléatoire est un puissant algorithme d’apprentissage automatique utilisé pour l’analytique prédictive. Il construit plusieurs arbres de décision et moyenne leurs sorties, offrant ainsi une meilleure précision, robustesse et polyvalence dans divers secteurs.

La régression par forêt aléatoire est un algorithme d’apprentissage automatique puissant utilisé pour l’analytique prédictive. Il s’agit d’une méthode d’apprentissage par ensemble, c’est-à-dire qu’elle combine plusieurs modèles afin de créer un modèle de prédiction plus précis. Plus précisément, la régression par forêt aléatoire construit une multitude d’arbres de décision lors de l’entraînement et fournit la prédiction moyenne des différents arbres.

L’apprentissage par ensemble est une technique qui combine plusieurs modèles d’apprentissage automatique pour améliorer les performances globales. Dans le cas de la régression par forêt aléatoire, elle agrège les résultats de nombreux arbres de décision pour produire une prédiction plus fiable et plus robuste.

L’agrégation bootstrap, ou bagging, est une méthode utilisée pour réduire la variance d’un modèle d’apprentissage automatique. Dans la régression par forêt aléatoire, chaque arbre de décision est entraîné sur un sous-ensemble aléatoire des données, ce qui contribue à améliorer la capacité de généralisation du modèle et à réduire le surapprentissage.

Un arbre de décision est un modèle simple mais puissant utilisé pour des tâches de classification et de régression. Il divise les données en sous-ensembles en fonction de la valeur des variables d’entrée, prenant des décisions à chaque nœud jusqu’à ce qu’une prédiction finale soit faite à la feuille de l’arbre.

La régression par forêt aléatoire est largement utilisée dans de nombreux domaines, notamment :

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

# Charger le jeu de données

X, y = load_your_data() # Remplacez par votre méthode de chargement des données

# Séparer en ensembles d'entraînement et de test

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Initialiser le modèle

model = RandomForestRegressor(n_estimators=100, random_state=42)

# Entraîner le modèle

model.fit(X_train, y_train)

# Faire des prédictions

predictions = model.predict(X_test)

# Évaluer le modèle

mse = mean_squared_error(y_test, predictions)

print(f'Erreur quadratique moyenne : {mse}')

Découvrez comment la régression par forêt aléatoire et les solutions propulsées par l'IA peuvent transformer vos analyses prédictives et vos processus de prise de décision.

Le boosting est une technique d'apprentissage automatique qui combine les prédictions de plusieurs apprenants faibles pour créer un apprenant fort, améliorant l...

Le bagging, abréviation de Bootstrap Aggregating, est une technique fondamentale d'apprentissage ensembliste en IA et en apprentissage automatique qui améliore ...

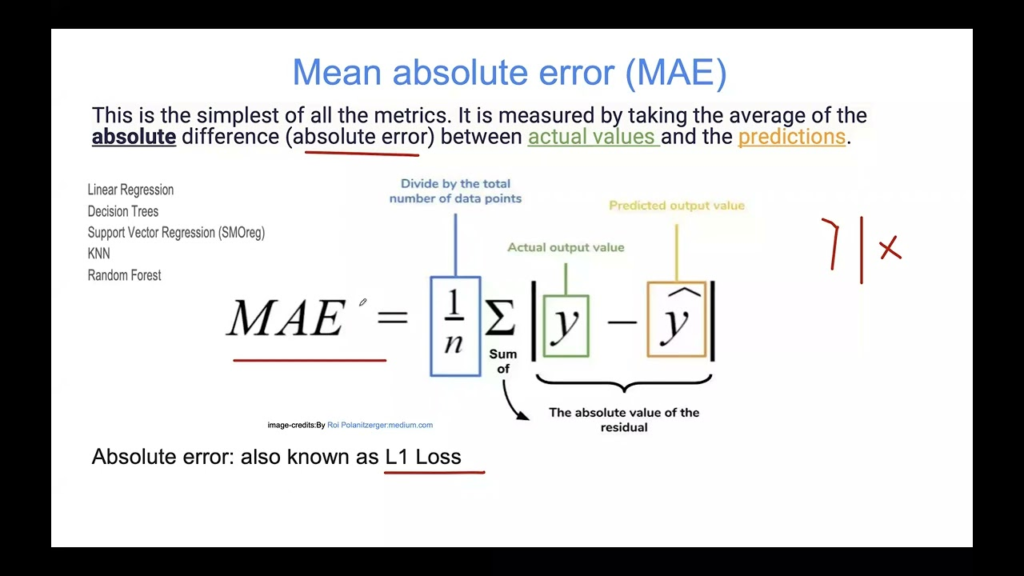

L'Erreur Absolue Moyenne (MAE) est une métrique fondamentale en apprentissage automatique pour évaluer les modèles de régression. Elle mesure l'amplitude moyenn...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.