Précision Moyenne (mAP)

La Précision Moyenne (mAP) est un indicateur clé en vision par ordinateur pour évaluer les modèles de détection d’objets, capturant à la fois la précision de dé...

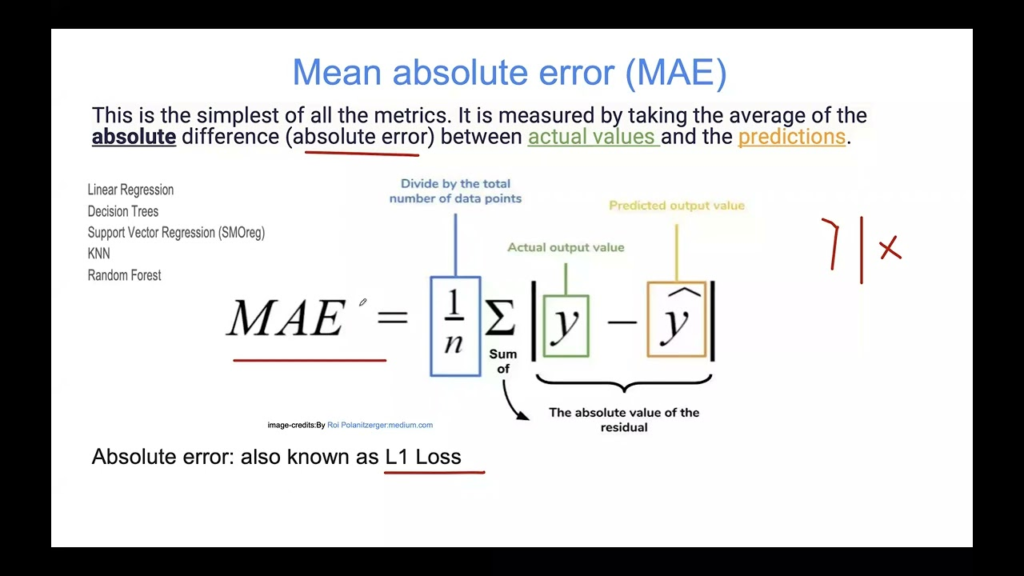

L’Erreur Absolue Moyenne (MAE) mesure l’amplitude moyenne des erreurs de prédiction dans les modèles de régression, offrant un moyen simple et interprétable d’évaluer la précision d’un modèle.

L’Erreur Absolue Moyenne (MAE) est une métrique clé en apprentissage automatique pour évaluer les modèles de régression, mesurant l’amplitude moyenne des erreurs sans tenir compte de leur direction. Elle est robuste face aux valeurs aberrantes et facilement interprétable dans les unités de la variable cible, ce qui la rend utile pour l’évaluation des modèles.

L’Erreur Absolue Moyenne (MAE) est une métrique fondamentale en apprentissage automatique, particulièrement utilisée pour évaluer les modèles de régression. Elle mesure l’amplitude moyenne des erreurs dans un ensemble de prédictions, sans tenir compte de la direction de ces erreurs. Cette métrique offre un moyen simple de quantifier la précision d’un modèle en calculant la moyenne des différences absolues entre les valeurs prédites et les valeurs réelles. Contrairement à d’autres métriques, la MAE ne met pas les erreurs au carré, ce qui signifie qu’elle accorde la même importance à toutes les déviations, quelle que soit leur taille. Cette caractéristique rend la MAE particulièrement utile lorsqu’on souhaite évaluer l’amplitude des erreurs de prédiction sans attribuer de poids différent aux surestimations ou sous-estimations.

Comment la MAE est-elle calculée ?

La formule de la MAE s’exprime ainsi :

Où :

La MAE est calculée en prenant la valeur absolue de chaque erreur de prédiction, en additionnant ces erreurs absolues, puis en divisant par le nombre de prédictions. On obtient ainsi une amplitude moyenne de l’erreur facile à interpréter et à communiquer.

La MAE revêt une grande importance dans l’entraînement de l’IA grâce à sa simplicité et à son interprétabilité. Ses avantages incluent :

Évaluation de modèle :

Dans les situations pratiques, la MAE sert à évaluer la performance des modèles de régression. Par exemple, pour la prédiction des prix immobiliers, une MAE de 1 000 € indique qu’en moyenne, les prix prédits diffèrent des prix réels de 1 000 €.

Comparaison de modèles :

La MAE constitue une métrique fiable pour comparer la performance de différents modèles. Une MAE plus faible indique de meilleures performances. Par exemple, si un modèle SVM donne une MAE de 28,85 degrés pour la prédiction de la température, alors qu’un modèle Random Forest donne une MAE de 33,83 degrés, le modèle SVM est considéré comme plus précis.

Applications réelles :

La MAE est utilisée dans diverses applications telles que la radiothérapie, où elle sert de fonction de perte dans des modèles de deep learning comme DeepDoseNet pour la prédiction 3D de doses, surpassant les modèles utilisant la MSE.

Modélisation environnementale :

En modélisation environnementale, la MAE permet d’évaluer les incertitudes des prédictions, offrant une représentation équilibrée des erreurs par rapport à la RMSE.

| Métrique | Pénalise les grandes erreurs | Unité de mesure | Sensibilité aux valeurs aberrantes | Quand l’utiliser |

|---|---|---|---|---|

| Erreur Absolue Moyenne (MAE) | Non | Même que la variable cible | Moins sensible | Quand l’interprétabilité et la robustesse face aux valeurs aberrantes sont requises |

| Erreur Quadratique Moyenne (MSE) | Oui (met les erreurs au carré) | Unité au carré | Plus sensible | Quand les grandes erreurs sont particulièrement indésirables |

| Racine de l’Erreur Quadratique Moyenne (RMSE) | Oui (carré & racine) | Même que la variable cible | Plus sensible | Quand les grandes déviations sont critiques |

| Erreur Absolue Moyenne en Pourcentage (MAPE) | Non | Pourcentage (%) | Variable | Quand l’erreur relative en pourcentage est importante |

La MAE peut être calculée avec la bibliothèque sklearn de Python comme suit :

from sklearn.metrics import mean_absolute_error

import numpy as np

# Données d'exemple

y_true = np.array([1, 2, 3, 4, 5])

y_pred = np.array([1.5, 2.5, 2.8, 4.2, 4.9])

# Calcul de la MAE

mae = mean_absolute_error(y_true, y_pred)

print("Erreur Absolue Moyenne :", mae)

La MAE est idéale lorsque :

Bien que la MAE soit polyvalente et largement utilisée, elle présente certaines limites :

L’Erreur Absolue Moyenne (MAE) est une métrique largement utilisée dans l’entraînement de l’IA, notamment pour évaluer la précision des modèles prédictifs. Voici un résumé de recherches récentes impliquant la MAE :

IA générative pour un calcul statistique rapide et précis des fluides

Cet article présente un algorithme d’IA générative nommé GenCFD, conçu pour le calcul statistique rapide et précis des écoulements turbulents. L’algorithme exploite un modèle de diffusion basé sur le score conditionnel pour obtenir des approximations de haute qualité des quantités statistiques, telles que la moyenne et la variance. L’étude souligne que les modèles d’apprentissage opérateur traditionnels, qui minimisent souvent les erreurs absolues moyennes, tendent à régresser vers des solutions de l’écoulement moyen. Les auteurs présentent des perspectives théoriques et des expériences numériques démontrant la performance supérieure de l’algorithme pour générer des échantillons réalistes d’écoulement de fluide. Lire l’article

Détection dynamique de défauts et évaluation des performances dans les systèmes photovoltaïques grâce à l’IA

Cette recherche se concentre sur l’amélioration de la détection des défauts dans les systèmes photovoltaïques à l’aide de l’IA, en particulier via des algorithmes d’apprentissage automatique. L’étude insiste sur l’importance de caractériser précisément les pertes de puissance et de détecter les défauts afin d’optimiser les performances. Elle rapporte le développement d’un modèle informatique atteignant une erreur absolue moyenne de 6,0 % pour l’estimation quotidienne de l’énergie, démontrant l’efficacité de l’IA pour la détection des défauts et l’évaluation des performances du système. Lire l’article

Estimation efficace en ligne de l’état de santé des batteries basée sur l’apprentissage automatique

Cet article explore des méthodes basées sur les données pour estimer l’état de santé (SoH) des batteries dans les applications de mobilité électrique. Il aborde l’utilisation de techniques d’apprentissage automatique pour améliorer la précision de l’estimation du SoH, qui est traditionnellement réalisée par des méthodes basées sur des modèles. La recherche met en avant le potentiel de réduction des erreurs absolues moyennes dans les systèmes de gestion de batteries grâce à des algorithmes d’IA avancés. Lire l’article

L'Erreur Absolue Moyenne (MAE) est une métrique en apprentissage automatique qui mesure l'amplitude moyenne des erreurs entre les valeurs prédites et réelles dans les modèles de régression, sans tenir compte de leur direction.

La MAE est calculée en prenant la valeur absolue de chaque erreur de prédiction, en additionnant ces valeurs, puis en divisant par le nombre de prédictions, ce qui donne l'amplitude moyenne de l'erreur.

Utilisez la MAE lorsque vous souhaitez une mesure simple et interprétable de l'erreur moyenne dans les mêmes unités que votre variable cible, en particulier en présence de valeurs aberrantes ou si vous ne souhaitez pas pénaliser plus fortement les grandes erreurs.

La MAE ne fournit pas d'information sur la direction des erreurs et traite toutes les erreurs de manière égale, ce qui peut ne pas être idéal lorsque les grandes erreurs doivent être plus pénalisées.

Contrairement à la MSE et à la RMSE, qui pénalisent davantage les grandes erreurs en les élevant au carré, la MAE traite toutes les erreurs de manière égale et est moins sensible aux valeurs aberrantes, ce qui la rend plus robuste pour les jeux de données avec des valeurs extrêmes.

Des chatbots intelligents et des outils d'IA sous un même toit. Connectez des blocs intuitifs pour transformer vos idées en Flows automatisés.

La Précision Moyenne (mAP) est un indicateur clé en vision par ordinateur pour évaluer les modèles de détection d’objets, capturant à la fois la précision de dé...

L’erreur d'entraînement en IA et en apprentissage automatique est l’écart entre les prédictions d’un modèle et les résultats réels pendant l’entraînement. C’est...

L’erreur de généralisation mesure la capacité d’un modèle d’apprentissage automatique à prédire des données inédites, en équilibrant biais et variance pour gara...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.