AI 워크플로우에서의 로깅

AI 워크플로우에서 로깅의 중요성과 FlowHunt가 툴 호출 및 작업에 대한 상세 로그를 어떻게 제공하는지, AI 시스템 모니터링·디버깅·최적화를 위한 모범 사례를 살펴봅니다....

이 글에서는 FlowHunt와 Langfuse를 연결하여 포괄적인 관측성을 확보하고, AI 워크플로우의 성능을 추적하며, Langfuse 대시보드를 활용해 FlowHunt 워크스페이스를 모니터링 및 최적화하는 방법을 설명합니다.

FlowHunt에서 AI 워크플로우가 확장될수록 백엔드에서 실제로 어떤 일이 일어나는지 파악하는 것이 중요해집니다. “왜 이 워크플로우가 느릴까?”, “토큰을 얼마나 쓰고 있지?”, *“오류는 어디서 발생하지?"*와 같은 질문에 답하려면 시스템에 대한 세밀한 가시성이 필요합니다.

적절한 관측성 없이 AI 워크플로우를 디버깅하는 것은 눈을 감고 조종하는 것과도 같습니다. 결과는 볼 수 있지만, 그 과정은 놓치게 되죠. Langfuse와 같은 추적 도구는 워크플로우 실행의 모든 단계를 포착해, 성능, 비용, 동작에 대한 세분화된 인사이트를 제공합니다.

이 글에서는 FlowHunt를 Langfuse와 손쉽게 연결하여, 모든 AI 워크플로우를 포괄적으로 관측하는 방법을 설명합니다. 실행 경로 추적, 토큰 사용량 모니터링, 병목 구간 식별, 성능 지표 시각화까지 — 모두 한 곳의 대시보드에서 가능합니다.

마지막에는 FlowHunt 워크스페이스에 대한 완전한 가시성을 확보하여, 워크플로우를 최적화하고 비용을 절감하며 신뢰성을 보장할 수 있게 됩니다.

**관측성(Observability)**이란, 시스템을 계측하여 외부 출력(주로 추적, 지표, 로그)을 통해 내부 상태를 이해하는 실천입니다.

FlowHunt에서 AI 기반 워크플로우를 운영하는 사용자에게 관측성은 다음과 같은 가시성을 제공합니다:

관측성이 없으면 문제 진단이 사후적이고 시간이 오래 걸립니다. 반면, 관측성이 있으면 지속적인 최적화와 신속한 문제 해결이 가능합니다.

Langfuse는 LLM(대형 언어 모델) 애플리케이션을 위한 오픈소스 관측성 및 분석 플랫폼입니다. AI 워크플로우 실행의 상세 추적을 캡처하여, 개발자와 팀이 AI 시스템을 디버깅, 모니터링, 최적화하는 데 필요한 인사이트를 제공합니다.

Langfuse의 주요 기능:

Langfuse를 FlowHunt와 연결하면, 원시 실행 데이터를 실행 가능한 인텔리전스로 전환하여, 잘 되는 부분, 개선이 필요한 부분, 최적화가 필요한 지점을 파악할 수 있습니다.

이 가이드를 따라 하면 다음을 달성할 수 있습니다:

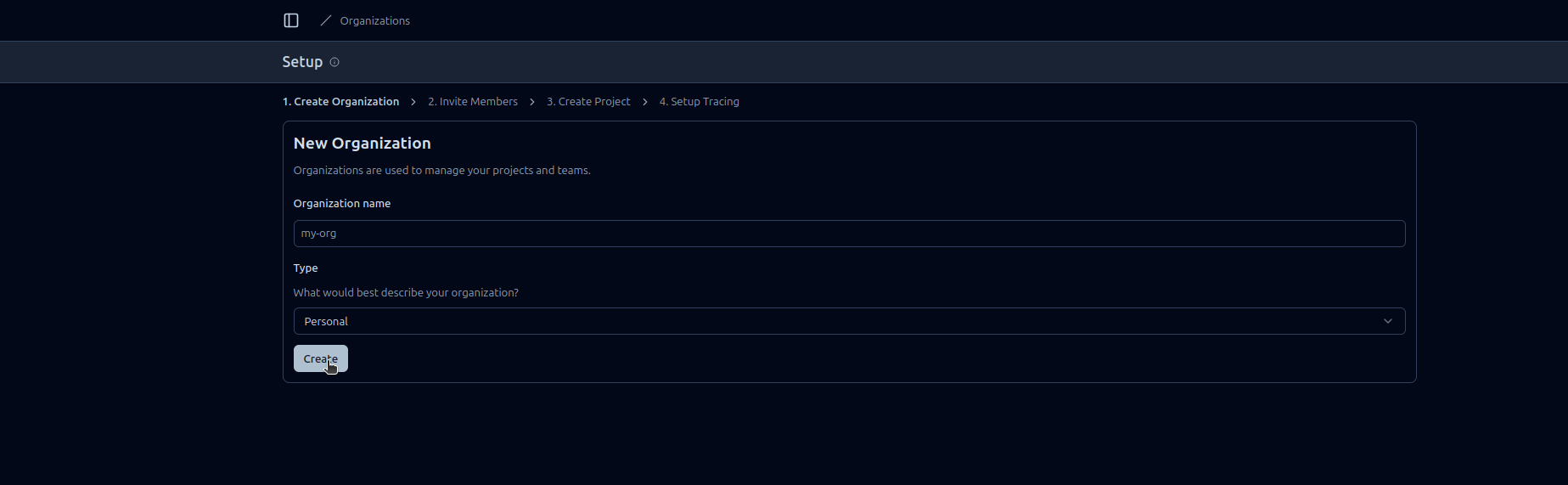

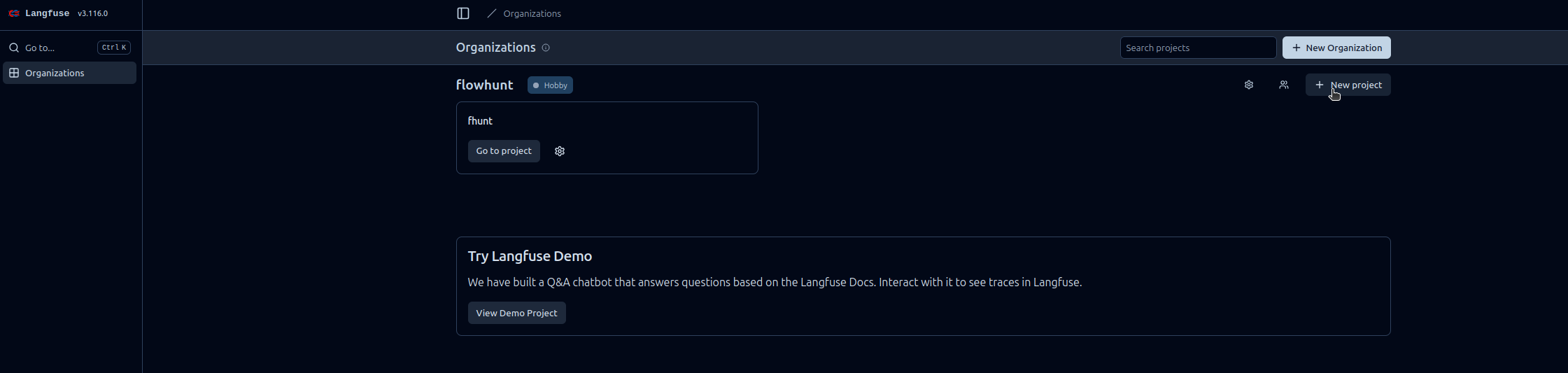

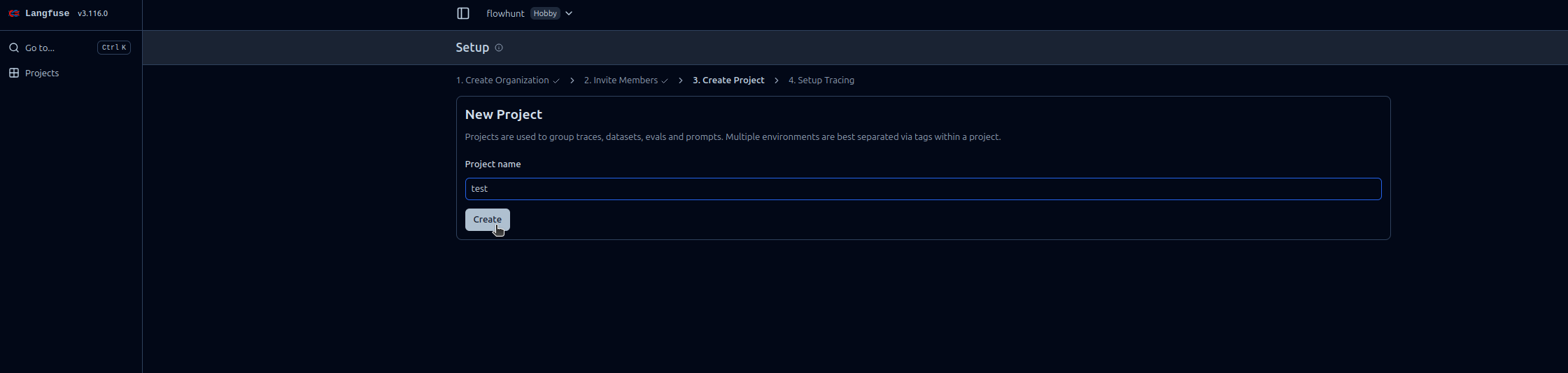

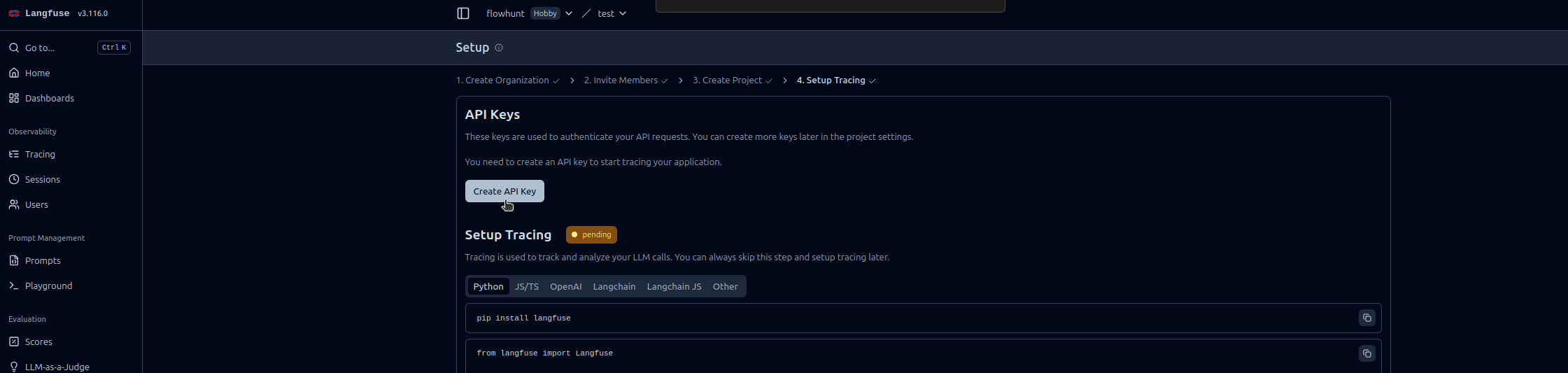

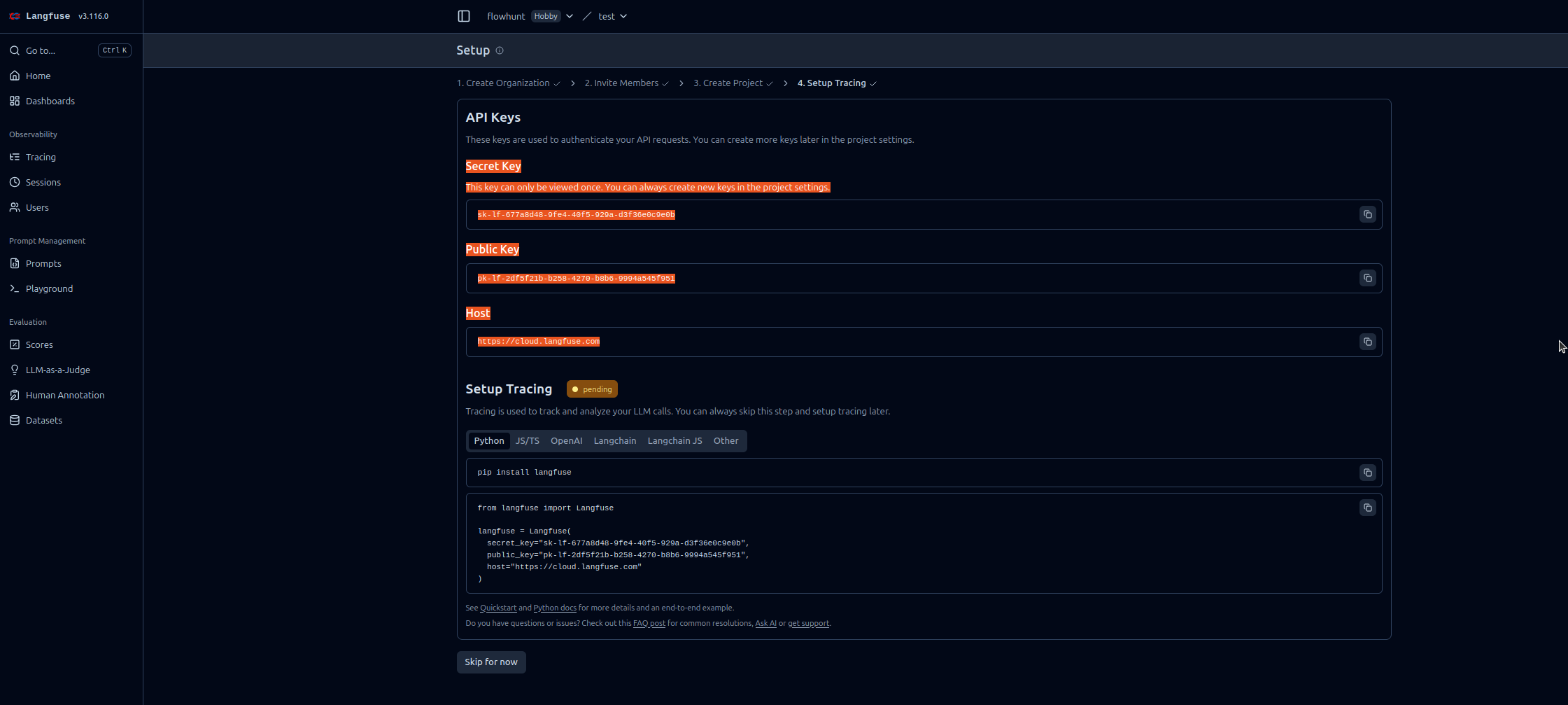

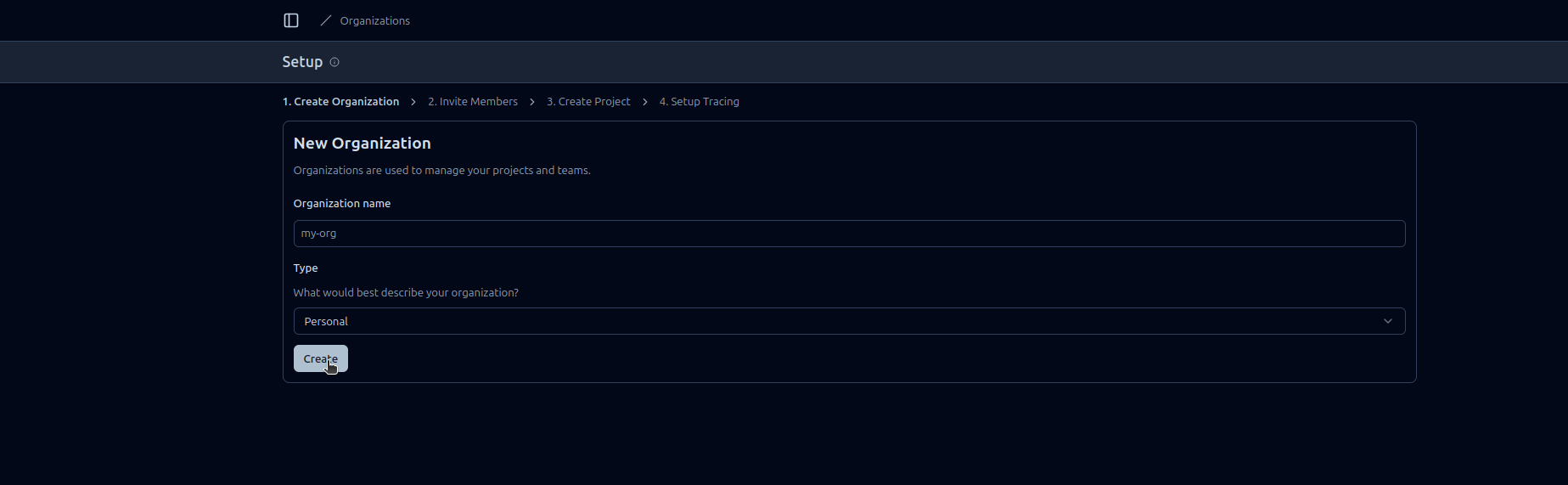

Langfuse에서 FlowHunt 관측성을 활성화하는 단계별 안내입니다:

https://cloud.langfuse.com)

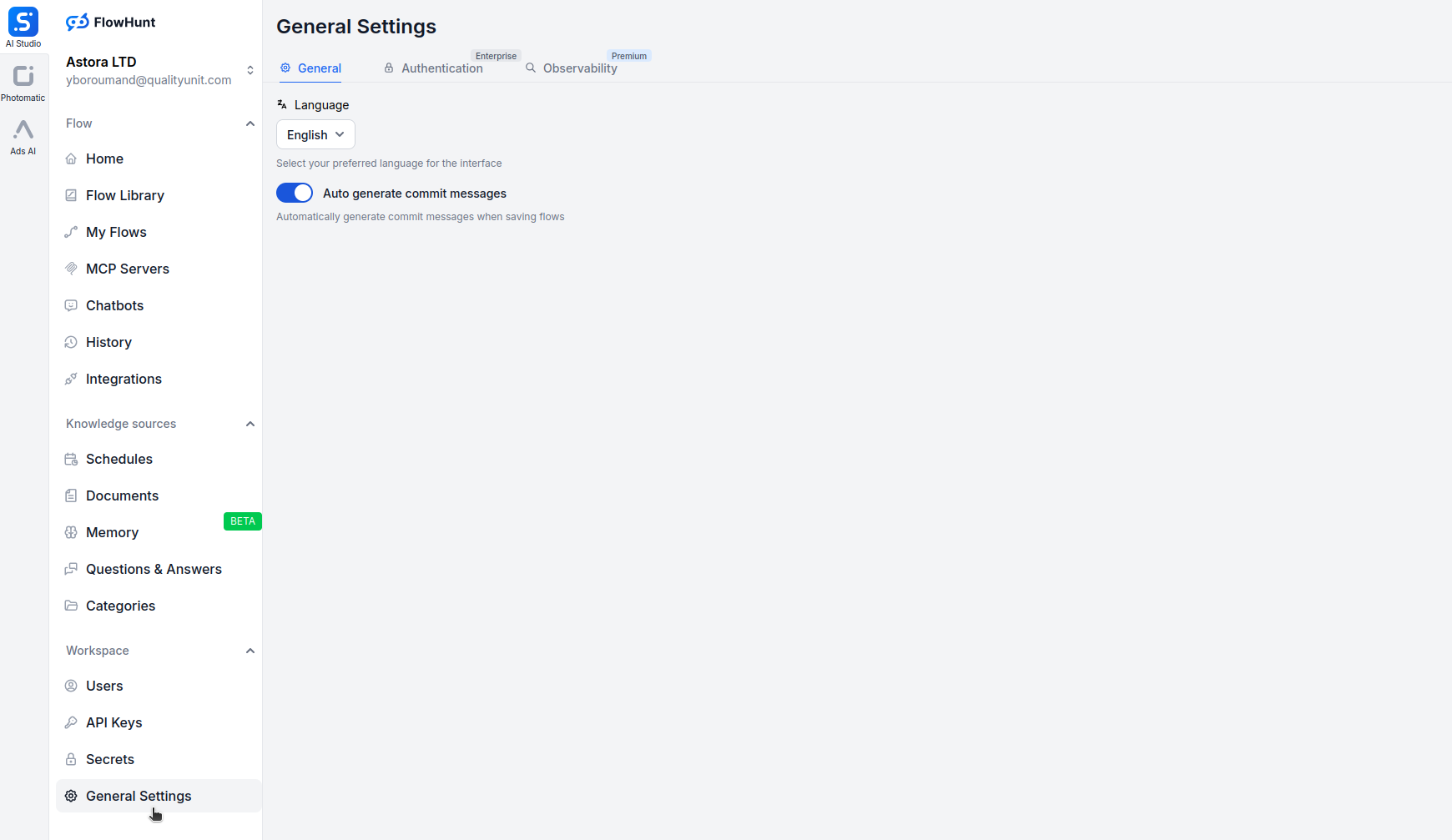

브라우저에서 app.flowhunt.io 로 이동합니다.

일반 설정(보통 사이드바 또는 상단 메뉴에서 접근 가능)으로 이동합니다.

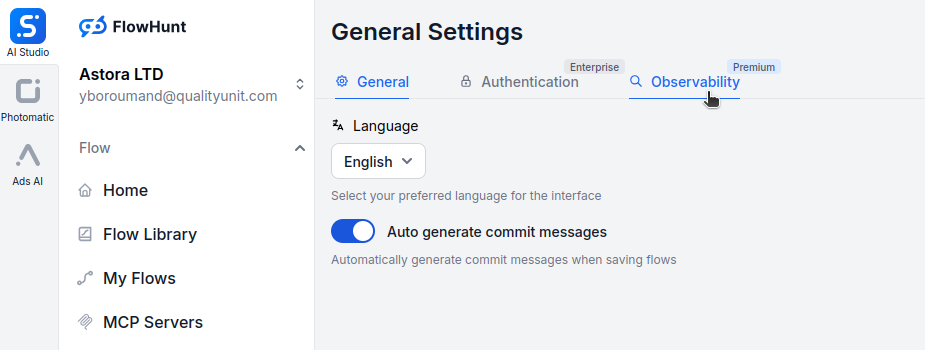

하단으로 스크롤하여 관측성 탭을 클릭합니다.

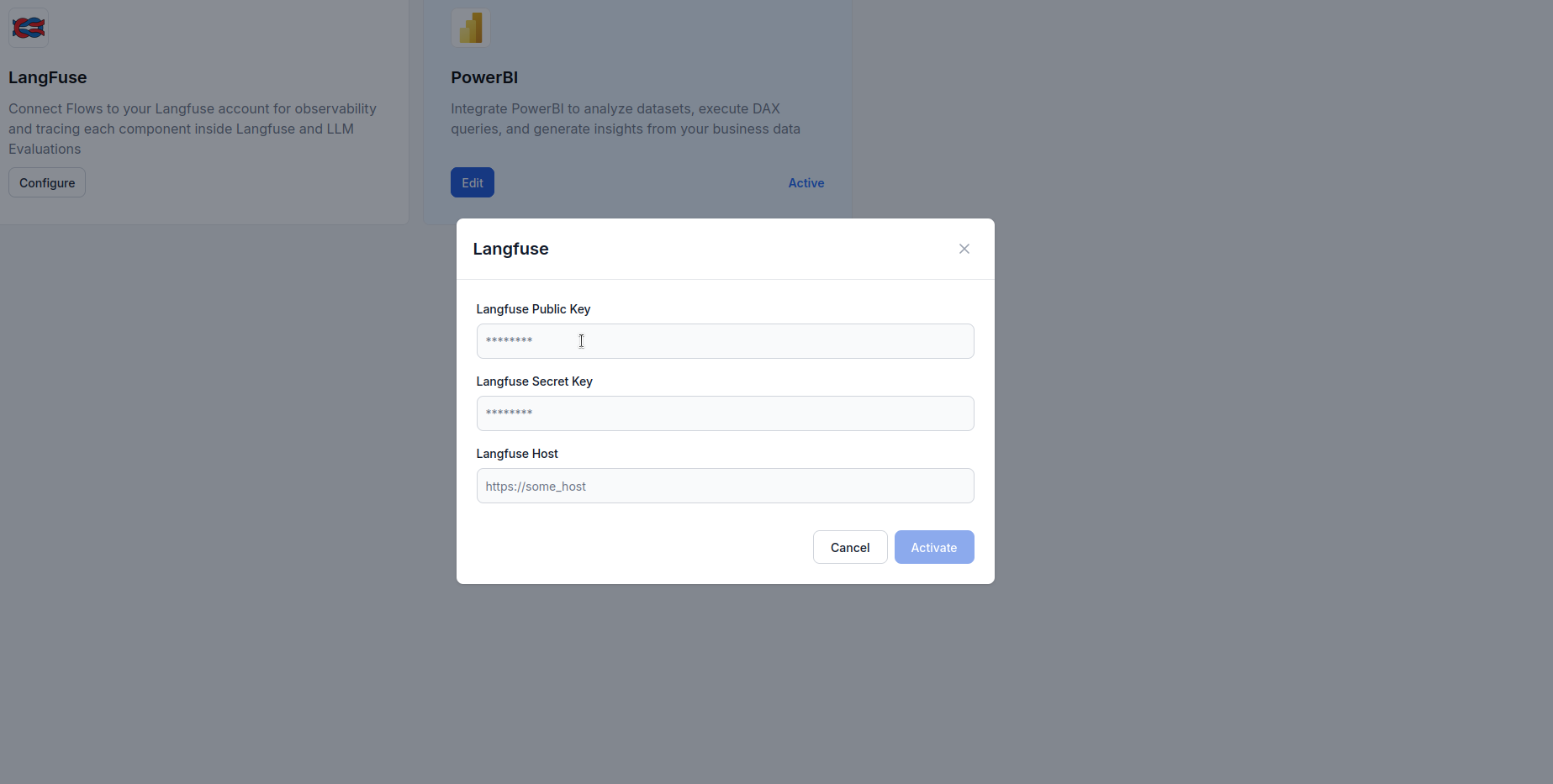

Langfuse 박스를 찾아 Configure를 클릭합니다.

https://cloud.langfuse.com)

FlowHunt를 Langfuse와 연결하면 강력한 시각화 및 분석 기능을 사용할 수 있습니다. 생성할 수 있는 대표적 인사이트는 다음과 같습니다:

각 워크플로우 실행의 상세 타임라인을 확인할 수 있습니다.

이를 통해 병목 구간을 식별하고 워크플로우 동작을 세부적으로 이해할 수 있습니다.

워크플로우별 토큰 소비를 모니터링합니다:

토큰 소모가 많은 작업을 찾아 비용 최적화에 활용할 수 있습니다.

주요 성능 지표를 추적합니다:

이 지표들은 SLA 준수와 사용자 경험 최적화에 도움이 됩니다.

실패 및 원인 진단:

신속한 문제 해결과 신뢰성 향상에 기여합니다.

대화형 AI 에이전트의 경우:

에이전트 동작과 사용자 경험 최적화에 활용할 수 있습니다.

다양한 LLM 제공자별 성능 비교:

실제 사용 데이터를 바탕으로 모델 선택을 지원합니다.

FlowHunt와 Langfuse를 연동하면 AI 워크플로우가 블랙박스에서 투명하고 최적화 가능한 시스템으로 바뀝니다. 포괄적 추적을 통해 모든 실행 단계를 가시적으로 확인하고, 성능·비용·신뢰성에 대한 데이터 기반 결정을 내릴 수 있습니다.

Langfuse 관측성 연동은 간단한 API 키 설정만으로도 모니터링을 시작할 수 있으며, 생산 환경에서 워크플로우가 어떻게 동작하는지 정확히 보여주는 풍부한 대시보드를 제공합니다.

이제 FlowHunt 워크스페이스가 Langfuse와 연결되었으니, 지속적인 개선의 토대를 갖추게 되었습니다. 병목을 파악하고, 토큰 사용을 최적화하며, 지연을 줄이고, 신뢰감을 가지고 AI 시스템의 가치를 극대화하세요.

AI 워크플로우에서 로깅의 중요성과 FlowHunt가 툴 호출 및 작업에 대한 상세 로그를 어떻게 제공하는지, AI 시스템 모니터링·디버깅·최적화를 위한 모범 사례를 살펴봅니다....

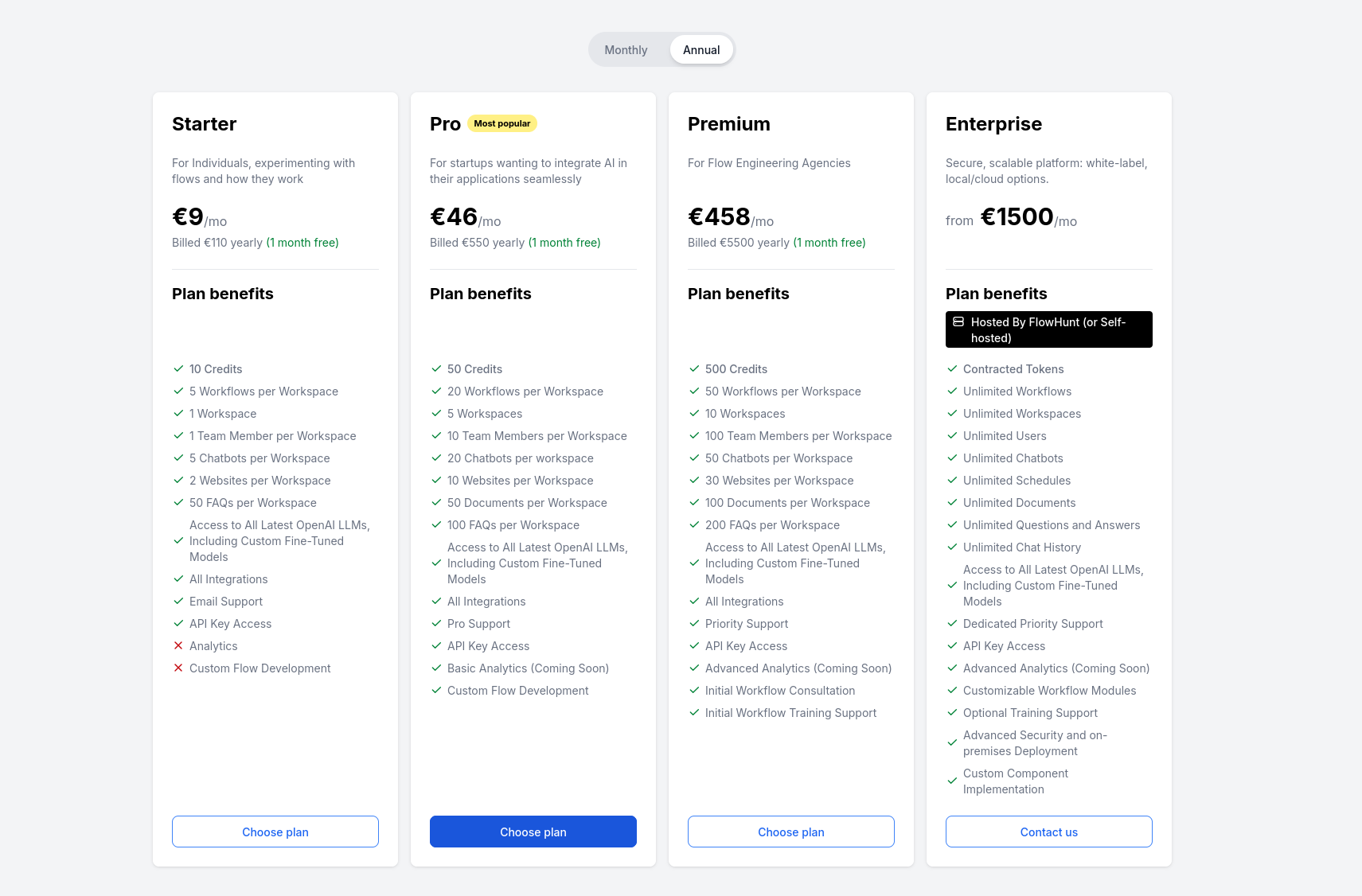

FlowHunt의 요금제에 대한 종합 안내서로, 크레딧과 상호작용 방식, 복잡성이 비용에 미치는 영향, 미사용 크레딧 처리 방법 등을 설명합니다....

FlowHunt 2.6.12에서는 슬랙 통합, 의도 분류, 그리고 Gemini 모델을 도입하여 AI 챗봇 기능, 고객 인사이트, 팀 워크플로우를 강화합니다....