Hallucinatie

Een hallucinatie in taalmodellen treedt op wanneer AI tekst genereert die aannemelijk lijkt, maar in werkelijkheid onjuist of verzonnen is. Lees meer over de oo...

Wat zijn hallucinaties in AI, waarom gebeuren ze en hoe kun je ze vermijden? Leer hoe je AI-chatbot-antwoorden accuraat houdt met praktische, mensgerichte strategieën.

AI-chatbots zijn slimmer dan ooit, maar soms verzinnen ze dingen uit het niets. Deze fouten, “hallucinaties” genoemd, kunnen van een behulpzame assistent een bron van verwarring of zelfs risico maken. Als je betrouwbare antwoorden wilt, moet je begrijpen wat hallucinaties zijn, waarom ze ontstaan en hoe je ze voorkomt voordat ze problemen veroorzaken.

Een hallucinatie bij AI is wanneer een chatbot of taalmodel je een antwoord geeft dat geloofwaardig klinkt, maar in werkelijkheid onjuist, verzonnen of zelfs onmogelijk is. Deze fouten zijn geen willekeurige typefouten; het zijn zelfverzekerde, aannemelijke uitspraken zonder basis in de werkelijkheid.

Stel dat je aan een chatbot vraagt: “Wie won de Nobelprijs voor Natuurkunde in 2025?” Als het model niet over actuele informatie beschikt, kan het een naam verzinnen in plaats van toe te geven dat het het antwoord niet weet. In tegenstelling tot een zoekmachine die “geen resultaten” geeft, vult een chatbot soms de gaten op met overtuigende maar onjuiste details.

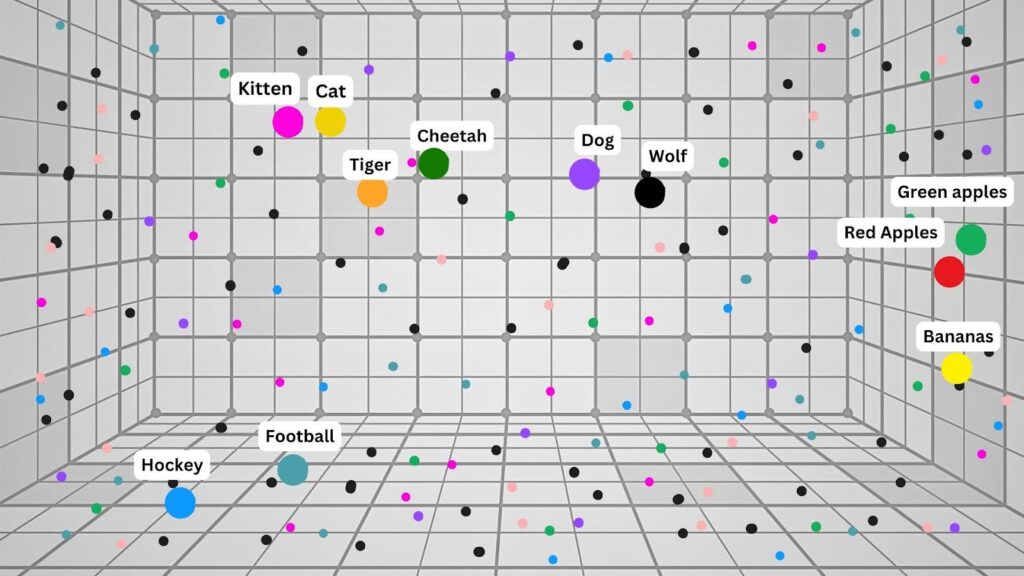

Hallucinaties zijn geen fout, maar een bijwerking van hoe grote taalmodellen (LLM’s) zoals ChatGPT, Copilot of Gemini werken. Deze modellen:

Veelvoorkomende oorzaken van hallucinaties zijn onder meer:

Hoewel geen enkele AI perfect is, zijn er bewezen manieren om hallucinaties te verminderen en de kwaliteit van antwoorden te verbeteren. Dit werkt het beste:

Moderne AI-tools kunnen verbinding maken met databases, zoekmachines of bedrijfswiki’s. Geef je AI voor belangrijke taken altijd vertrouwde context of verwijs naar betrouwbare bronnen.

Neem het antwoord niet zomaar aan; vraag de AI om bronnen, links, of in elk geval om uit te leggen hoe het tot een conclusie is gekomen.

Voorbeeldprompt:

Gebruik alleen het geleverde bedrijfsreglement en de nieuwste webzoekresultaten om deze vraag te beantwoorden. Vermeld je bronnen en leg je redenering uit.

Dit helpt je niet alleen het antwoord te verifiëren, maar leert de AI ook zichzelf te controleren.

Hoe specifieker je vraag, hoe beter het resultaat. Zeg de AI welke informatie te gebruiken, wat te vermijden en welk formaat je verwacht. Bijvoorbeeld:

Vat de belangrijkste bevindingen samen uit het bijgevoegde marktrapport (editie 2024). Als informatie ontbreekt, zeg dan “niet gevonden” in plaats van aannames te doen.

Veel geavanceerde chatbots bieden real-time zoekplug-ins, retrieval-augmented generation (RAG) of integratie met bedrijfskennis. Zet deze altijd aan als actuele of feitelijke nauwkeurigheid vereist is.

Hoe geavanceerd je chatbot ook is, menselijke controle blijft cruciaal. Controleer altijd belangrijke uitkomsten, vooral in gevoelige sectoren zoals gezondheidszorg, financiën of recht.

Een “mens in het proces” betekent:

Wil je meer leren over strategieën met een mens in het proces? Houd onze aankomende artikel over dit onderwerp in de gaten!

AI-hallucinaties kunnen bij elke chatbot voorkomen, zelfs bij de beste. De sleutel is begrijpen waarom deze fouten ontstaan en maatregelen nemen om ze vroegtijdig op te sporen:

Met deze gewoonten verander je je chatbot van een “creatieve verhalenverteller” in een betrouwbare assistent, terwijl je zelf de uiteindelijke verantwoordelijkheid (en het oordeel) houdt.

Wil je AI toepassen in je dagelijkse werk? Krijg praktische gidsen, echte use-cases en stapsgewijze workflows voor drukbezette professionals. Van betere e-mails schrijven tot het automatiseren van notulen: de AI Academy helpt je slimmer werken met AI.

👉 Ontdek meer op AI Academy en ga vandaag nog aan de slag!

Wij helpen bedrijven zoals die van u bij het ontwikkelen van slimme chatbots, MCP-servers, AI-tools of andere soorten AI-automatisering om mensen te vervangen bij repetitieve taken in uw organisatie.

Een hallucinatie in taalmodellen treedt op wanneer AI tekst genereert die aannemelijk lijkt, maar in werkelijkheid onjuist of verzonnen is. Lees meer over de oo...

Verbeter de nauwkeurigheid van je AI-chatbot met FlowHunt's functie voor het overslaan van indexering. Sluit ongeschikte inhoud uit om interacties relevant en v...

Verminder AI-hallucinaties en zorg voor nauwkeurige chatbotantwoorden door gebruik te maken van de Schedule-functie van FlowHunt. Ontdek de voordelen, praktisch...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.