Introductie

TikTok-content maken was traditioneel een tijdrovend proces dat kennis van filmen, editen en posten vereiste. Recente doorbraken in kunstmatige intelligentie hebben dit landschap echter fundamenteel veranderd. De opkomst van geavanceerde gezichtsvervangingstechnologie—met name modellen zoals Wan 2.2 Animate—maakt het nu mogelijk voor makers om TikTok-video’s van professionele kwaliteit te genereren op een ongekende schaal. Met deze technologie kun je een enkele referentieafbeelding uploaden en deze combineren met AI-gegenereerde of bestaande videocontent om tientallen of zelfs honderden unieke video’s te maken. In deze uitgebreide gids verkennen we hoe deze revolutionaire technologie werkt, waarom het belangrijk is voor contentmakers en hoe jij het kunt inzetten om een succesvolle TikTok-aanwezigheid op te bouwen zonder uren te besteden aan productie.

Wat is AI-gezichtsvervangingstechnologie?

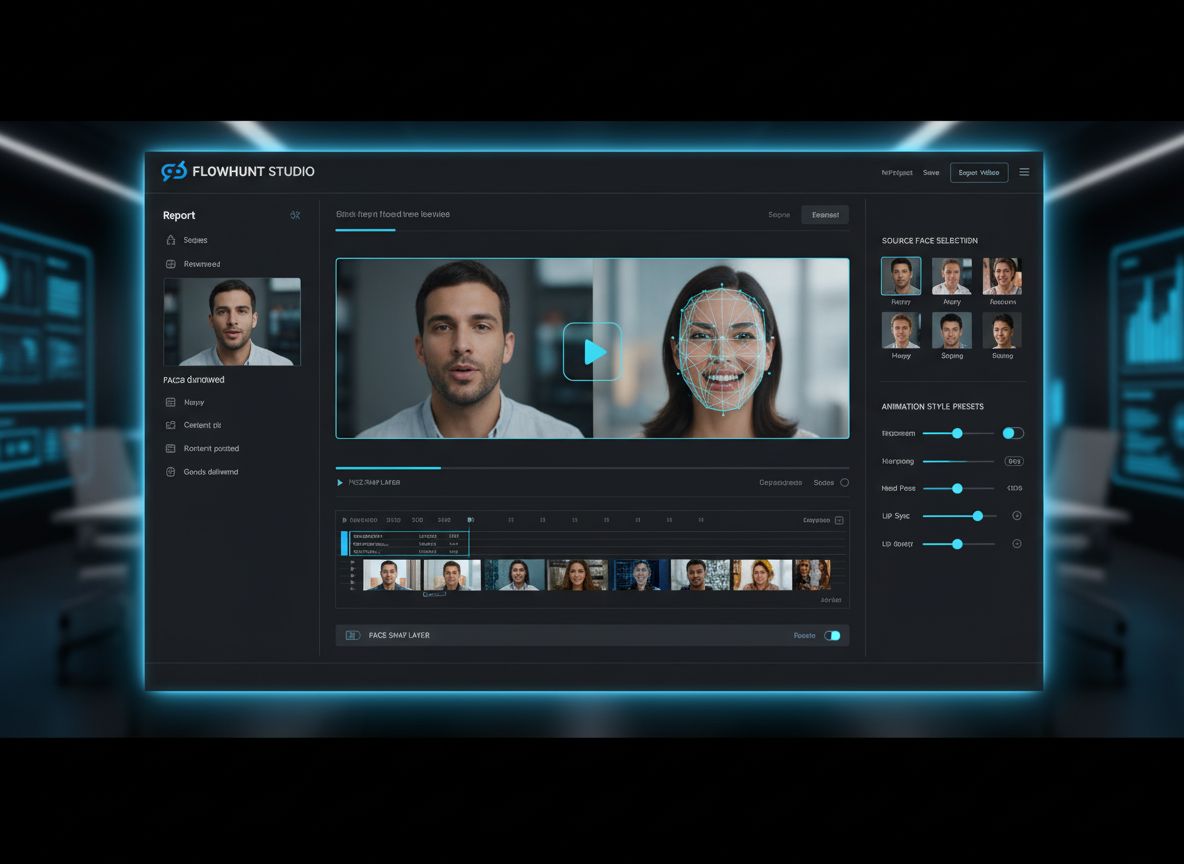

Kunstmatige intelligentie-gezichtsvervanging is een grote sprong voorwaarts in video-generatie en manipulatietechnologie. In de kern gebruikt deze technologie deep learning-algoritmes die getraind zijn op miljoenen afbeeldingen en video’s om gelaatstrekken, gezichtsuitdrukkingen en bewegingen te begrijpen. Wanneer je een referentieafbeelding en een bronvideo aanlevert, analyseert de AI beide inputs en brengt de gelaatstrekken van jouw referentieafbeelding intelligent over op de persoon in de video. Het proces is veel geavanceerder dan simpel afbeeldingen over elkaar leggen—de technologie begrijpt lichtomstandigheden, hoeken, uitdrukkingen en zelfs subtiele bewegingen om ervoor te zorgen dat de vervanging er natuurlijk en consistent uitziet gedurende de hele video.

De technische basis van gezichtsvervanging steunt op verschillende geavanceerde machine learning-technieken die samenwerken. Eerst voert het systeem gezichtsdetectie en herkenning van herkenningspunten uit, waarbij het belangrijke punten op zowel het referentiegezicht als het gezicht in de video in kaart brengt. Vervolgens gebruikt het generatieve modellen om een naadloze overgang te creëren tussen de twee, rekening houdend met verschillen in huidskleur, textuur en belichting. Het resultaat is een video waarin de gezichtsvervanging authentiek oogt en consistent blijft over alle frames. Dit is fundamenteel anders dan oudere face-swap-technologie die vaak onnatuurlijke of duidelijk kunstmatige resultaten opleverde. Moderne systemen zoals Wan 2.2 Animate zijn getraind op zulke grote datasets dat ze uiteenlopende lichtomstandigheden, hoeken en gezichtsuitdrukkingen met opvallende nauwkeurigheid aankunnen.

Klaar om uw bedrijf te laten groeien?

Start vandaag uw gratis proefperiode en zie binnen enkele dagen resultaten.

Waarom AI-gezichtsvervanging belangrijk is voor TikTok-makers

De implicaties van gezichtsvervangingstechnologie voor TikTok-makers zijn diepgaand en veelzijdig. Het algoritme van TikTok beloont consistentie en volume—makers die vaak posten met boeiende content hebben doorgaans een groter bereik en meer engagement. Maar om zoveel content te produceren moet je normaal gesproken een team inhuren of enorm veel tijd besteden aan filmen, editen en posten. Gezichtsvervangingstechnologie elimineert deze bottleneck door één maker in staat te stellen tientallen video’s te genereren uit één referentieafbeelding en een bibliotheek van videotemplates. Dit democratiseert contentcreatie, waardoor solo-makers kunnen concurreren met grotere productieteams.

Naast volume opent gezichtsvervangingstechnologie geheel nieuwe creatieve mogelijkheden. Een maker kan nu een consistent persoonlijk merk behouden over meerdere videostijlen en -formats zonder zichzelf telkens opnieuw te hoeven filmen. Je kunt één professionele portretfoto hebben en deze gebruiken in honderden verschillende videotemplates—educatieve content, entertainment, productreviews, tutorials en meer. De technologie stelt makers ook in staat om te experimenteren met verschillende persona’s of karakters zonder dat daar meerdere mensen of ingewikkelde verkleedpartijen voor nodig zijn. Voor makers die in meerdere talen werken of zich op verschillende geografische markten richten, maakt gezichtsvervanging het mogelijk om gelokaliseerde versies van content te creëren zonder alles opnieuw te hoeven filmen. Deze mogelijkheid is vooral waardevol om content wereldwijd op te schalen, terwijl je toch een persoonlijke band met het publiek behoudt.

Wan 2.2 Animate begrijpen: De technologie achter moderne gezichtsvervanging

Wan 2.2 Animate, ontwikkeld door Tongyi Lab, vertegenwoordigt de huidige state-of-the-art in AI-gedreven gezichtsvervanging en videogeneratie. Dit model is specifiek ontworpen om de complexiteit van realistische gezichtsvervanging aan te kunnen en tegelijkertijd videokwaliteit en consistentie te waarborgen. Het “Animate”-gedeelte van de naam verwijst naar het vermogen van het model om statische afbeeldingen te animeren—een enkele foto tot leven te brengen in een video. De aanduiding “2.2” geeft aan dat dit een geavanceerde iteratie is die geleerd heeft van eerdere versies en verbeteringen bevat op het gebied van snelheid, kwaliteit en consistentie.

Wat Wan 2.2 Animate bijzonder effectief maakt, is de aanpak van de temporele dimensie van video. In tegenstelling tot eenvoudige afbeelding-op-afbeelding gezichtsvervanging begrijpt deze technologie dat video een reeks frames is die consistent en samenhangend moeten blijven. Het model analyseert de bewegingspatronen, uitdrukkingen en lichtveranderingen in de gehele videoreeks en past de gezichtsvervanging toe op een manier die deze dynamiek respecteert. Hierdoor ziet het vervangen gezicht er niet alleen goed uit in losse frames—het beweegt natuurlijk, toont emoties op het juiste moment en behoudt een consistente belichting en schaduw in de hele video. De technologie kan ook lastige gevallen aan, zoals wanneer het gezicht gedeeltelijk bedekt is, onder extreme hoeken staat of in uitdagende lichtomstandigheden is gefilmd.

Schrijf u in voor onze nieuwsbrief

Ontvang gratis de nieuwste tips, trends en aanbiedingen.

Gezichtsvervangingstechnologie gebruiken voor TikTok-contentcreatie

Beginnen met gezichtsvervangingstechnologie is verrassend eenvoudig, hoewel begrip van het proces je helpt betere resultaten te behalen. De eerste stap is het voorbereiden van je referentieafbeelding—dit is de foto of afbeelding die de gezichten in je video zal vervangen. De kwaliteit van deze referentieafbeelding bepaalt direct de kwaliteit van je output, dus het is de moeite waard hierin te investeren. De ideale referentieafbeelding is een heldere, goed belichte portretfoto waarop het gezicht duidelijk zichtbaar is en een groot deel van het frame inneemt. Professionele portretfoto’s werken bijzonder goed omdat ze doorgaans goed belicht, scherp en onder een flatterende hoek zijn genomen. Vermijd afbeeldingen waarop het gezicht te klein, deels bedekt of onder extreme lichtomstandigheden is.

Vervolgens heb je een bronvideo nodig—de video waarin het gezicht van de persoon wordt vervangen. Dit kan van alles zijn: van een professioneel geproduceerde videotemplate tot zelfgemaakte content. Het belangrijkste is dat het gezicht in de video duidelijk zichtbaar is, bij voorkeur vanaf het eerste frame. De video moet redelijk goed belicht en van goede resolutie zijn, hoewel de technologie behoorlijk vergevingsgezind is en ook met video’s van mindere kwaliteit kan werken. Veel makers gebruiken vooraf gemaakte videotemplates die speciaal voor gezichtsvervanging zijn ontworpen, verkrijgbaar via diverse platforms en diensten. Deze templates zijn meestal korte, pakkende video’s (15-60 seconden) die goed passen binnen het TikTok-formaat en het vervangen gezicht effectief in beeld brengen.

Zodra je zowel je referentieafbeelding als bronvideo hebt, upload je deze naar de gezichtsvervangingstool. De AI verwerkt deze inputs en genereert je outputvideo. De verwerkingstijd varieert afhankelijk van de videolengte en de gebruikte dienst, maar duurt doorgaans van enkele seconden tot een paar minuten. Het resultaat is een nieuwe video waarin het gezicht uit jouw referentieafbeelding naadloos in de bronvideo is geïntegreerd. Je kunt deze video vervolgens direct op TikTok plaatsen, of verder bewerken met muziek, tekstoverlays of andere effecten voordat je hem post.

TikTok-contentproductie opschalen met AI-gezichtsvervanging

De echte kracht van gezichtsvervangingstechnologie komt naar voren als je gaat denken aan opschalen. In plaats van één video tegelijk te maken, kun je maandelijks tientallen of zelfs honderden video’s maken door gezichtsvervanging te combineren met andere automatiseringstools. De workflow wordt dan: maak één hoogwaardige referentieafbeelding, verzamel of creëer een bibliotheek met videotemplates en genereer vervolgens systematisch video’s door je referentieafbeelding met elke template te combineren. Met de juiste automatisering kan dit proces grotendeels automatisch verlopen na de initiële opzet.

Een praktisch voorbeeld: een maker wil een TikTok-profiel opbouwen rond educatieve content over productiviteitstips. Hij of zij kan 50 verschillende videotemplates maken of verzamelen, elk met een andere productiviteitstip en pakkende visuals en tekst. Door de referentieafbeelding te combineren met elk van deze templates, zijn er direct 50 unieke video’s om te posten. Als ze dit maandelijks doen met verschillende templatesets, hebben ze 600 video’s per jaar—veel meer dan een individuele maker handmatig zou kunnen produceren. De consistentie van steeds hetzelfde gezicht in al deze video’s versterkt juist het persoonlijke merk, omdat het publiek deze aanwezigheid gaat herkennen en zich ermee verbindt.

FlowHunt maakt deze opschaling mogelijk door automatiseringsworkflows te bieden die het hele proces aankunnen. Je kunt een workflow instellen die automatisch video’s genereert uit je referentieafbeelding en een templatebibliotheek, extra effecten of tekst toevoegt en ze zelfs plant om op verschillende dagen te posten. Zo wordt contentcreatie van een dagelijkse taak getransformeerd in een wekelijks of maandelijks project, waarbij je content in batches maakt en automatisering de distributie verzorgt.

{{ cta-dark-panel

heading=“Geef je workflow een boost met FlowHunt”

description=“Ontdek hoe FlowHunt jouw AI-content- en SEO-workflows automatiseert—van onderzoek en contentgeneratie tot publicatie en analyse—alles op één plek.”

ctaPrimaryText=“Boek een Demo”

ctaPrimaryURL=“https://calendly.com/liveagentsession/flowhunt-chatbot-demo"

ctaSecondaryText=“Probeer FlowHunt Gratis”

ctaSecondaryURL=“https://app.flowhunt.io/sign-in"

gradientStartColor="#123456”

gradientEndColor="#654321”

gradientId=“827591b1-ce8c-4110-b064-7cb85a0b1217”

}}

Best practices voor hoogwaardige gezichtsvervanging

Hoewel gezichtsvervangingstechnologie behoorlijk robuust is, zorgt het volgen van bepaalde best practices voor aanzienlijk betere resultaten. Investeer ten eerste in een professionele referentieafbeelding. Dit betekent niet per se dat je een fotograaf moet inhuren—moderne smartphonecamera’s leveren uitstekende resultaten als je let op belichting en compositie. De ideale setup is natuurlijke of professionele belichting die je gezicht gelijkmatig verlicht, een neutrale of bijpassende achtergrond en een duidelijke, directe blik op je gezicht. Vermijd extreme hoeken, zware schaduwen of tegenlicht, want dit kan de AI verwarren en leiden tot minder consistente vervangingen.

Ten tweede: kies videotemplates die qua belichting en kleurtemperatuur aansluiten bij je referentieafbeelding. Als je referentieafbeelding is genomen in warm, natuurlijk licht, kan het combineren met een video in koel, kunstmatig licht zichtbare inconsistenties veroorzaken. De AI doet zijn best dit te corrigeren, maar starten met compatibele inputs levert betere resultaten op. Ten derde: zorg ervoor dat het videotemplate duidelijke gezichtsherkenning heeft, bij voorkeur vanaf het begin. Video’s waarin het gezicht langzaam in beeld komt of gedurende de video deels bedekt is, leveren minder consistente resultaten op dan video’s waarin het gezicht vanaf het eerste frame duidelijk zichtbaar is.

Let ook op beeldverhouding en kadering. TikTok-video’s zijn verticaal (9:16-beeldverhouding), dus zorg dat je templates en referentieafbeeldingen geschikt zijn voor dit formaat. Een referentieafbeelding die te klein is of slecht gekadreerd binnen het verticale formaat kan leiden tot vreemd ogende output. Test tenslotte je workflow met een paar video’s voordat je grootschalig gaat produceren. Genereer een handvol video’s, beoordeel de kwaliteit en consistentie en pas je referentieafbeelding of templatekeuze aan voordat je opschaalt naar honderden video’s.

Omgaan met kwaliteits- en consistentiezorgen

Een veelgehoorde zorg bij grootschalige gezichtsvervanging is of kwaliteit en consistentie behouden blijven over honderden video’s. Het antwoord is ja, maar met kanttekeningen. De technologie zelf is zeer consistent—als je dezelfde referentieafbeelding met meerdere templates gebruikt, blijft de gezichtsvervanging consistent. Maar variatie in templatekwaliteit, belichting en compositie zorgt vanzelf voor enige variatie in de uiteindelijke output. Dat is zelfs wenselijk vanuit contentperspectief, omdat je content zo niet te uniform of robotachtig aanvoelt.

Om kwaliteit over grote volumes te waarborgen, stel duidelijke standaarden op voor je videotemplates. Alle templates moeten vergelijkbare lichtomstandigheden, kleurcorrectie en compositie hebben. Ze moeten het gezicht duidelijk tonen op de plek waar vervanging plaatsvindt. Door deze standaarden te hanteren, zorg je dat de resultaten van gezichtsvervanging consistent van hoge kwaliteit zijn in je hele contentbibliotheek. Bekijk daarnaast regelmatig je output om eventuele problemen vroegtijdig te signaleren. Als bepaalde templates steeds mindere resultaten geven, kun je ze verbeteren of uit je rotatie halen.

Een ander aandachtspunt is de authenticiteit en transparantie rond het gebruik van gezichtsvervangingstechnologie. Hoewel de technologie realistische resultaten oplevert, is het goed rekening te houden met de verwachtingen van je publiek en de platformrichtlijnen. De communityrichtlijnen van TikTok verbieden gezichtsvervanging niet, maar wel misleidende content. Gebruik je gezichtsvervanging voor duidelijk entertainment of gestileerde content, dan is dat doorgaans prima. Maar gebruik je het om iemand anders te imiteren of misleidende content te maken, dan overtreed je de regels. Transparant zijn over je gebruik van AI-tools, waar gepast, kan zelfs het vertrouwen van je publiek versterken en je content onderscheiden in een steeds AI-bewustere wereld.

Gezichtsvervanging integreren in je contentstrategie

Gezichtsvervangingstechnologie werkt het best als je het doordacht integreert in een bredere contentstrategie, en niet als gimmick gebruikt. Denk na over welke soorten content zich goed lenen voor gezichtsvervanging en welke minder. Educatieve content, motiverende video’s, entertainment en productreviews werken uitstekend omdat de focus ligt op de boodschap en de visuals, niet op de authenticiteit van de spreker. Sterk persoonlijke content zoals vlogs of behind-the-scenes video’s kan juist minder authentiek aanvoelen als je zwaar leunt op gezichtsvervanging.

Een gebalanceerde aanpak combineert gezichtsvervanging met authentieke, originele content. Je kunt bijvoorbeeld gezichtsvervanging gebruiken voor 70-80% van je content—zoals educatieve tips, entertainment en promotie—en 20-30% reserveren voor authentieke, originele content waarin je je echte persoonlijkheid laat zien en een oprechte band opbouwt met je publiek. Zo blijft je content authentiek, terwijl je profiteert van de efficiëntie van automatisering. Gebruik gezichtsvervanging ook om verschillende contentideeën en formats te testen. Als je niet zeker weet of een bepaald type content aanslaat bij je publiek, kun je snel meerdere variaties genereren en testen voordat je veel tijd investeert in originele productie.

De zakelijke meerwaarde van AI-gedreven contentcreatie

Vanuit zakelijk perspectief betekent gezichtsvervangingstechnologie een enorme kans voor contentmakers om hun output op te schalen zonder evenredige toename van kosten of tijdsinvestering. Traditionele contentcreatie heeft een lineaire relatie tussen output en inspanning—voor twee keer zoveel content moet je meestal ook twee keer zoveel tijd investeren. Gezichtsvervangingstechnologie doorbreekt deze lijn: je kunt exponentieel meer content maken met slechts iets meer inspanning na de initiële opzet.

Denk aan de rekensom: een maker besteedt 2-3 uur aan het instellen van de referentieafbeelding, het verzamelen of maken van videotemplates en het configureren van de automatiseringsworkflow. Daarna kunnen ze 50-100 video’s per week genereren met minimale extra inspanning. Over een jaar zijn dit 2.600 tot 5.200 video’s, gemaakt met slechts een paar uur initiële opzet en af en toe wat onderhoud. Vergelijk dat met traditionele contentcreatie, waar zelfs 100 video’s per jaar honderden uren filmen, editen en posten betekent. De tijdsbesparing vertaalt zich direct naar kostenbesparing en geeft makers ruimte om zich te richten op strategie, community en andere waardevolle activiteiten in plaats van productielogistiek.

Voor makers die hun content willen monetariseren via advertentie-inkomsten, sponsoring of productverkoop is deze efficiëntiewinst transformerend. Meer content betekent meer kansen om viraal te gaan, meer contactmomenten met je publiek en meer mogelijkheden om kijkers om te zetten in klanten of supporters. De technologie geeft individuele makers eigenlijk de productiemogelijkheden van kleine teams en maakt het speelveld gelijk tussen solo-creators en grotere producties.

Opkomende trends en toekomstige ontwikkelingen

Het vakgebied van AI-videogeneratie en gezichtsvervanging ontwikkelt zich snel, met regelmatig nieuwe mogelijkheden en verbeteringen. Een opkomende trend is de integratie van gezichtsvervanging met andere AI-technologieën zoals spraaksynthese en scriptgeneratie. Stel je een workflow voor waarbij je een onderwerp opgeeft, de AI een script schrijft, een voice-over genereert, video-content aanmaakt of selecteert, gezichtsvervanging uitvoert en het resultaat automatisch op TikTok post—alles met minimale menselijke tussenkomst. Dit niveau van automatisering wordt steeds haalbaarder naarmate deze technologieën verder rijpen en integreren.

Een andere trend is de verbetering van kwaliteit en snelheid van gezichtsvervanging. De huidige technologie levert al indrukwekkende resultaten, maar toekomstige iteraties zullen waarschijnlijk nog beter omgaan met uitzonderingen, sneller processen en minder handmatige stappen vereisen. Ook zien we meer gespecialiseerde gezichtsvervangingstools, specifiek voor bijvoorbeeld TikTok, YouTube-video’s, professionele presentaties en meer. Deze gespecialiseerde tools zullen naar verwachting betere resultaten bieden voor hun specifieke toepassingen dan algemene tools.

Ook het regelgevend kader rond AI-gegenereerde content ontwikkelt zich. Naarmate gezichtsvervangingstechnologie algemener wordt, ontwikkelen platforms en toezichthouders duidelijkere richtlijnen rond transparantie en authenticiteit. Makers doen er goed aan deze ontwikkelingen te volgen en hun werkwijze waar nodig aan te passen. Transparantie over AI-gebruik wordt waarschijnlijk steeds belangrijker, zowel uit oogpunt van compliance als van vertrouwen bij het publiek.

Praktische workflow: van opzet tot opschalen met FlowHunt

Om te laten zien hoe dit alles in de praktijk samenkomt, lopen we door een volledige workflow met de automatiseringsmogelijkheden van FlowHunt. Eerst bereid je je referentieafbeelding voor—een professionele portretfoto die als jouw gezicht zal dienen voor al je TikTok-video’s. Vervolgens verzamel of maak je een bibliotheek met videotemplates. Deze kun je halen uit templatebibliotheken, zelf maken of laten ontwerpen, of genereren met AI-videotools. Je organiseert deze templates op categorie of thema, zodat ze makkelijk te beheren zijn.

In FlowHunt maak je een automatiseringsworkflow die je referentieafbeelding systematisch combineert met elk videotemplate via gezichtsvervangingstechnologie. De workflow stel je zo in dat er dagelijks of wekelijks een nieuwe video wordt gegenereerd, steeds uit je templatebibliotheek. Je kunt extra stappen toevoegen, zoals muziek, tekstoverlays of hashtags op basis van de inhoud van de video. De workflow plant deze video’s vervolgens automatisch in om op TikTok te posten op optimale tijden, gebaseerd op de activiteit van jouw doelgroep.

Naarmate je contentbibliotheek groeit, kun je je workflow verfijnen op basis van prestatiegegevens. De analyses van FlowHunt laten zien welke video’s het beste presteren, welke templates het meeste engagement genereren en welke posttijden het hoogste bereik opleveren. Op basis daarvan kun je je workflow aanpassen om te focussen op de best presterende templates en tijden. Zo ontstaat gaandeweg een zelfoptimaliserend systeem waarin je contentproductie steeds efficiënter en effectiever wordt.

Het mooie van deze aanpak is dat het schaalbaar is. Je kunt starten met 10 videotemplates en 10 video’s per week genereren. Zie je succes en wil je opschalen, dan voeg je gewoon meer templates toe aan je bibliotheek. De workflow blijft hetzelfde, maar je output groeit evenredig mee. Uiteindelijk kun je 50-100 video’s per week genereren met dezelfde hoeveelheid handmatige inspanning als bij 10 video’s.

Conclusie

AI-gezichtsvervangingstechnologie, zoals Wan 2.2 Animate, heeft de mogelijkheden voor TikTok-makers fundamenteel veranderd. Door tientallen of honderden video’s te maken uit één referentieafbeelding en een bibliotheek van templates, democratiseert deze technologie contentcreatie en kunnen individuele makers op schaal concurreren met grotere producties. De sleutel tot succes is begrijpen hoe de technologie werkt, best practices volgen voor kwaliteit en consistentie, en het doordacht integreren in een bredere contentstrategie. In combinatie met automatiseringsplatforms zoals FlowHunt wordt gezichtsvervanging niet alleen een tool om losse video’s te maken, maar een volledig systeem om contentproductie efficiënt op te schalen. Makers die deze technologie beheersen en effectieve automatiseringsworkflows bouwen, hebben straks een aanzienlijk concurrentievoordeel in het steeds drukkere TikTok-landschap.