MCP Code Executor MCP Server

De MCP Code Executor MCP Server stelt FlowHunt en andere LLM-gestuurde tools in staat om veilig Python-code uit te voeren in geïsoleerde omgevingen, afhankelijk...

Maak veilige, geautomatiseerde en parallelle Python-code-uitvoering mogelijk binnen je AI-workflows met FlowHunt’s pydanticpydantic-aimcp-run-python MCP Server.

FlowHunt biedt een extra beveiligingslaag tussen uw interne systemen en AI-tools, waardoor u granulaire controle heeft over welke tools toegankelijk zijn vanaf uw MCP-servers. MCP-servers die in onze infrastructuur worden gehost, kunnen naadloos worden geïntegreerd met FlowHunt's chatbot evenals populaire AI-platforms zoals ChatGPT, Claude en verschillende AI-editors.

De pydanticpydantic-aimcp-run-python MCP Server is ontworpen als brug tussen AI-assistenten en Python-code-uitvoeringsomgevingen. Door een veilige en gecontroleerde interface te bieden voor het uitvoeren van Python-scripts, maakt deze MCP Server het mogelijk voor AI-clients om programmatisch te communiceren met Python-functies, computationele workflows te automatiseren en resultaten op te halen als onderdeel van bredere ontwikkelpijplijnen. Deze mogelijkheid is bijzonder waardevol voor taken zoals dynamische code-evaluatie, snel prototypen of het integreren van Python-gebaseerde analyses binnen LLM-gestuurde automatisering. De server stelt ontwikkelaars in staat het coderen, debuggen en verwerken van data te stroomlijnen door hun AI-tools te verbinden met live Python-uitvoering—terwijl duidelijke veiligheids- en operationele grenzen behouden blijven.

Er worden geen prompt-templates genoemd in de repository-bestanden of documentatie.

Er worden geen specifieke resource-primitives genoemd in de beschikbare repository-inhoud.

functions-namespace is aanwezig, maar volgens de repo-inhoud zijn er geen expliciete tools binnen deze namespace gedefinieerd.functions-namespace en gelijktijdig uitgevoerd kunnen worden. Nuttig voor het verdelen van workloads of batchverwerking binnen de MCP-context.multi_tool_use.parallel-mogelijkheid om meerdere Python-functies gelijktijdig uit te voeren en zo workflows te optimaliseren die profiteren van parallelisme.mcpServers-sectie:{

"mcpServers": {

"pydanticpydantic-aimcp-run-python": {

"command": "npx",

"args": [

"@pydanticpydantic-aimcp-run-python@latest",

"start"

]

}

}

}

{

"mcpServers": {

"pydanticpydantic-aimcp-run-python": {

"command": "npx",

"args": [

"@pydanticpydantic-aimcp-run-python@latest",

"start"

]

}

}

}

{

"mcpServers": {

"pydanticpydantic-aimcp-run-python": {

"command": "npx",

"args": [

"@pydanticpydantic-aimcp-run-python@latest",

"start"

]

}

}

}

{

"mcpServers": {

"pydanticpydantic-aimcp-run-python": {

"command": "npx",

"args": [

"@pydanticpydantic-aimcp-run-python@latest",

"start"

]

}

}

}

Definieer voor de veiligheid je API-sleutels en geheimen in omgevingsvariabelen en niet direct in configuratiebestanden. Verwijs ernaar met het veld env en geef ze indien nodig door in de sectie inputs. Voorbeeld:

{

"mcpServers": {

"pydanticpydantic-aimcp-run-python": {

"command": "npx",

"args": [

"@pydanticpydantic-aimcp-run-python@latest",

"start"

],

"env": {

"PYTHON_API_KEY": "${PYTHON_API_KEY}"

},

"inputs": {

"api_key": "${PYTHON_API_KEY}"

}

}

}

}

MCP gebruiken in FlowHunt

Om MCP-servers te integreren in je FlowHunt-workflow, begin je met het toevoegen van het MCP-component aan je flow en verbind je deze met je AI-agent:

Klik op het MCP-component om het configuratiepaneel te openen. Voeg in de systeem-MCP-configuratiesectie je MCP-servergegevens toe met dit JSON-formaat:

{

"pydanticpydantic-aimcp-run-python": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Na configuratie kan de AI-agent deze MCP nu als tool gebruiken met toegang tot alle functies en mogelijkheden. Vergeet niet “pydanticpydantic-aimcp-run-python” te wijzigen naar de daadwerkelijke naam van jouw MCP-server en vervang de URL door die van jouw eigen MCP-server.

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | |

| Lijst van Prompts | ⛔ | Geen prompt-templates gevonden |

| Lijst van Resources | ⛔ | Geen resource-primitives gevonden |

| Lijst van Tools | ✅ | multi_tool_use.parallel en functions-namespace; geen expliciet gedefinieerd |

| API-sleutels beveiligen | ✅ | Voorbeeld gegeven in het installatiegedeelte |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Niet genoemd |

Op basis van de beschikbare informatie biedt deze MCP-server basis Python-uitvoering en parallelle tool-orkestratie, maar ontbreken prompt-templates, resource-primitives en expliciete sampling- of roots-ondersteuning. De grootste pluspunten zijn de eenvoudige integratie en duidelijke veiligheidsaanbevelingen. Verbeteringen zijn mogelijk door meer tools, prompts en documentatie over geavanceerde MCP-functies toe te voegen.

Deze MCP-server is functioneel nuttig voor Python-code-uitvoering en parallelisme, maar het ontbreken van prompts, resources en expliciete geavanceerde MCP-functies maakt het meer een basale integratie. De codebase is minimaal en documentatie over diepgaande mogelijkheden ontbreekt.

| Heeft een LICENSE | ⛔ (Niet gevonden in de root van de repo voor dit subproject) |

|---|---|

| Heeft minstens één tool | ✅ (multi_tool_use.parallel) |

| Aantal forks | (Controleer op GitHub repo) |

| Aantal sterren | (Controleer op GitHub repo) |

Al met al zou ik deze MCP-server een 4/10 geven voor fundamenteel nut maar een beperkte set aan functionaliteiten en documentatie.

Het biedt een veilige interface voor het uitvoeren van Python-scripts en -functies vanuit AI-agenten, waarmee automatisering, live code-evaluatie en parallelle uitvoering binnen AI-gedreven workflows mogelijk worden gemaakt.

Het ondersteunt dynamische Python-uitvoering en bevat een tool voor parallelle uitvoering (multi_tool_use.parallel) om meerdere Python-functies gelijktijdig uit te voeren.

Sla gevoelige gegevens op in omgevingsvariabelen en verwijs ernaar in de 'env'- en 'inputs'-secties van je MCP-serverconfiguratie, in plaats van deze hard te coderen in configuratiebestanden.

Toepassingen zijn onder andere door AI aangestuurde Python-scripting, geautomatiseerde data-analyse, parallelle taakuitvoering, integratie met CI/CD-pijplijnen en het bieden van een code-sandbox voor onderwijs of experimenten.

Er zijn geen prompt-templates of specifieke resource-primitives gedefinieerd voor deze MCP Server.

Voeg het MCP-component toe aan je flow, open de configuratie en voeg de servergegevens toe met het verstrekte JSON-formaat. Zorg dat de server-URL en -naam overeenkomen met jouw implementatie.

Versnel je AI-automatisering met veilige Python-code-uitvoering, parallelle taakorkestratie en moeiteloze integratie. Ervaar live Python-scripting in je flows!

De MCP Code Executor MCP Server stelt FlowHunt en andere LLM-gestuurde tools in staat om veilig Python-code uit te voeren in geïsoleerde omgevingen, afhankelijk...

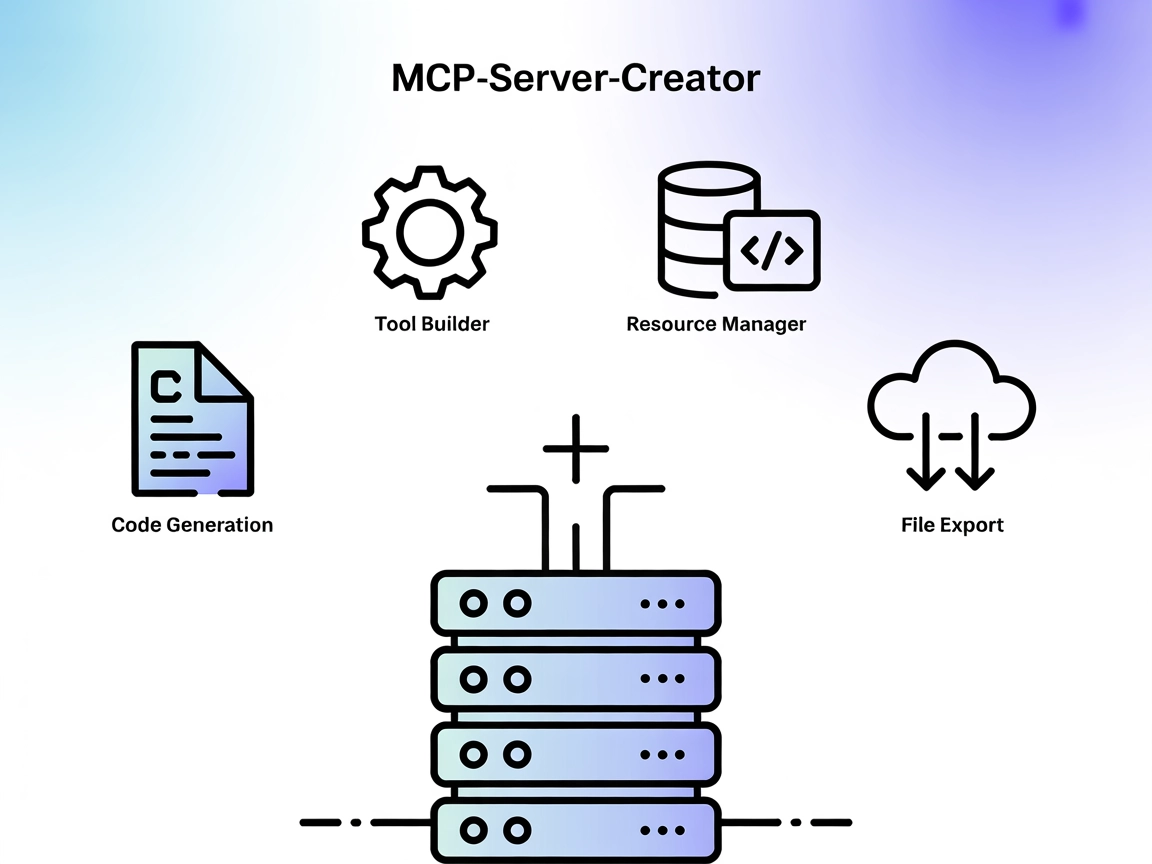

De MCP-Server-Creator is een meta-server die snelle creatie en configuratie van nieuwe Model Context Protocol (MCP) servers mogelijk maakt. Met dynamische codeg...

De py-mcp-mssql MCP Server biedt een veilige en efficiënte brug voor AI-agenten om programmatisch te communiceren met Microsoft SQL Server-databases via het Mod...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.