Gemini 3 Flash: Przełomowy model AI, który pokonuje Pro za ułamek ceny

Odkryj, dlaczego Gemini 3 Flash od Google rewolucjonizuje AI dzięki lepszej wydajności, niższym kosztom i szybszemu działaniu – nawet przewyższając Gemini 3 Pro...

Gemini Flash 2.0 rewolucjonizuje AI dzięki niezrównanej szybkości, precyzji oraz zdolności równoczesnego przetwarzania tekstu, obrazów i dźwięku, napędzając innowacje w różnych branżach.

Gemini Flash 2.0 od Google to ogromny krok naprzód w dziedzinie sztucznej inteligencji, który ustanawia nowe standardy jako zaawansowany model AI. Zaprojektowany, by przesuwać granice innowacji, ten model wyróżnia się zarówno szybkością, jak i precyzją. Wykorzystuje zaawansowane możliwości AI Google do obsługi wielu języków i trybów, co pozwala mu rozumieć tekst, obrazy i dźwięk równocześnie. Ta funkcja zwiększa nie tylko jego elastyczność, ale czyni go także potężnym narzędziem w różnych zastosowaniach i branżach.

To, co wyróżnia Gemini Flash 2.0, to ulepszona szybkość i efektywność, zwłaszcza w zastosowaniach czasu rzeczywistego. Model ten został stworzony do szybkiego i precyzyjnego przetwarzania dużych ilości danych, gwarantując minimalny czas oczekiwania dla użytkowników. Niezależnie od tego, czy jest wykorzystywany w obsłudze klienta do natychmiastowych odpowiedzi, czy w tworzeniu treści do generowania wniosków z danych, działa z imponującą skutecznością. Ta przewaga czyni Gemini Flash 2.0 kluczowym narzędziem w naszym świecie skoncentrowanym na danych.

Dla tych, którzy tworzą nowe technologie, Gemini Flash 2.0 oferuje płynną integrację z narzędziami deweloperskimi Google, szczególnie poprzez Gemini API oraz Google AI Studio. Narzędzia te pozwalają programistom szybciej tworzyć i wdrażać rozwiązania niż dotychczas. Gemini API zapewnia solidne wsparcie, umożliwiając budowanie aplikacji, które w pełni wykorzystują możliwości Gemini Flash 2.0. Dzięki temu deweloperzy mogą skoncentrować się na innowacjach, mając pewność, że technologia bazowa jest solidna i niezawodna.

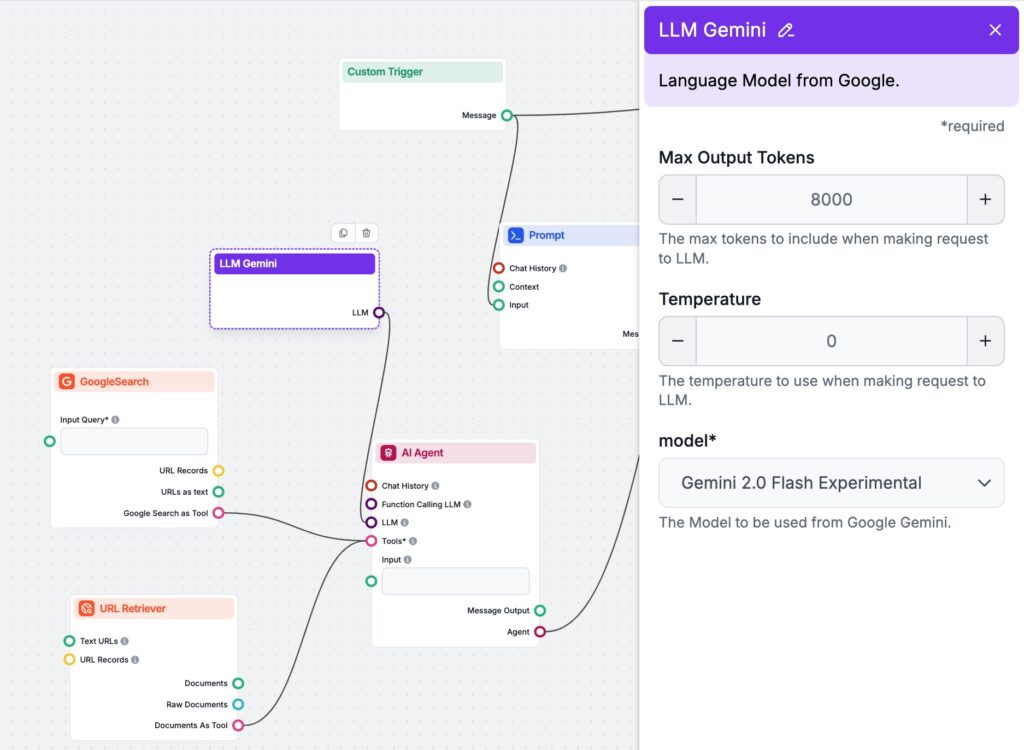

Użytkownicy FlowHunt mogą wybierać wszystkie modele Gemini, w tym Gemini 2.0 Flash Experimental w swoich flow.

Gemini 2.0 Flash Experimental dostępny w flow

Gemini Flash 2.0 przewodzi zmianom w rozwoju AI. Dzięki temu, że systemy AI stają się bardziej intuicyjne i responsywne, model ten podważa dotychczasowe założenia i wyznacza nowe standardy dla technologii AI. Jego zdolność do pracy z różnymi typami danych jednocześnie to ogromny krok naprzód, który wpłynie na sposób projektowania i wykorzystania systemów AI w przyszłości. W miarę jak coraz więcej branż sięga po rozwiązania AI, Gemini Flash 2.0 wyróżnia się jako lider napędzający te zmiany.

Co wyróżnia Gemini Flash 2.0?

Zdolność obsługi wielu języków i typów danych jednocześnie, takich jak tekst, obrazy i dźwięk, sprawia, że jest wyjątkowy.

Jak radzi sobie z danymi multimodalnymi?

Wykorzystuje zaawansowane algorytmy do łączenia wejść z różnych formatów, tworząc spójny wynik.

Czy deweloperzy mają dostęp do Gemini Flash 2.0?

Tak, deweloperzy mogą korzystać z niego poprzez Gemini API oraz Google AI Studio, co ułatwia integrację z istniejącymi projektami.

Które branże odnoszą największe korzyści?

Takie sektory jak obsługa klienta, tworzenie treści czy rozwój technologii czerpią wiele z jego funkcjonalności.

Czy Gemini Flash 2.0 jest dostępny globalnie?

Celem jest globalna dostępność, jednak rzeczywiste wdrożenie zależy od lokalnej infrastruktury technologicznej.

Jak wypada w porównaniu do poprzednich modeli?

Oferuje wyższą szybkość, efektywność oraz zdolność do obsługi różnych typów danych w porównaniu do starszych modeli.

Jakie są funkcje bezpieczeństwa?

Zawiera zaawansowane rozwiązania chroniące dane i prywatność użytkownika. FlowHunt automatycznie wywołuje wszystkie zapytania LLM z włączonymi parametrami bezpieczeństwa.

Jak przetwarzane są dane użytkownika?

Dane użytkowników są traktowane z zachowaniem ścisłej poufności, zgodnie z przepisami o ochronie danych, aby zapewnić bezpieczne i etyczne wykorzystanie.

Zdolność obsługi wielu języków i typów danych jednocześnie, takich jak tekst, obrazy i dźwięk, sprawia, że jest wyjątkowy.

Wykorzystuje zaawansowane algorytmy do łączenia wejść z różnych formatów, tworząc spójny wynik.

Tak, deweloperzy mogą korzystać z niego poprzez Gemini API oraz Google AI Studio, co ułatwia integrację z istniejącymi projektami.

Takie sektory jak obsługa klienta, tworzenie treści czy rozwój technologii czerpią wiele z jego funkcjonalności.

Celem jest globalna dostępność, jednak rzeczywiste wdrożenie zależy od lokalnej infrastruktury technologicznej.

Oferuje wyższą szybkość, efektywność oraz zdolność do obsługi różnych typów danych w porównaniu do starszych modeli.

Zawiera zaawansowane rozwiązania chroniące dane i prywatność użytkownika. FlowHunt automatycznie wywołuje wszystkie zapytania LLM z włączonymi parametrami bezpieczeństwa.

Dane użytkowników są traktowane z zachowaniem ścisłej poufności, zgodnie z przepisami o ochronie danych, aby zapewnić bezpieczne i etyczne wykorzystanie.

Viktor Zeman jest współwłaścicielem QualityUnit. Nawet po 20 latach kierowania firmą pozostaje przede wszystkim inżynierem oprogramowania, specjalizującym się w AI, programatycznym SEO i programowaniu backendu. Przyczynił się do powstania wielu projektów, w tym LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab i wielu innych.

Poznaj nową generację AI z Gemini Flash 2.0 – prędkość i możliwości multimodalne. Buduj lepsze rozwiązania już dziś.

Odkryj, dlaczego Gemini 3 Flash od Google rewolucjonizuje AI dzięki lepszej wydajności, niższym kosztom i szybszemu działaniu – nawet przewyższając Gemini 3 Pro...

Poznaj kluczowe ogłoszenia z Google I/O 2025, w tym Gemini 2.5 Flash, Project Astra, Android XR, agentów AI w Android Studio, Gemini Nano, Gemma 3n, SignGemma o...

Poznaj architekturę, sposób myślenia i rzeczywistą wydajność Gemini 1.5 Flash 8B — zaawansowanego agenta AI wyróżniającego się w przetwarzaniu informacji, rozum...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.