Jak zrewolucjonizować tworzenie treści dzięki generowaniu wideo Wan 2.2 i 2.5?

FlowHunt obsługuje już modele generowania wideo Wan 2.2 i 2.5 do tekstu na wideo, obrazu na wideo, podmiany person i animacji. Odmień swoje tworzenie treści dzi...

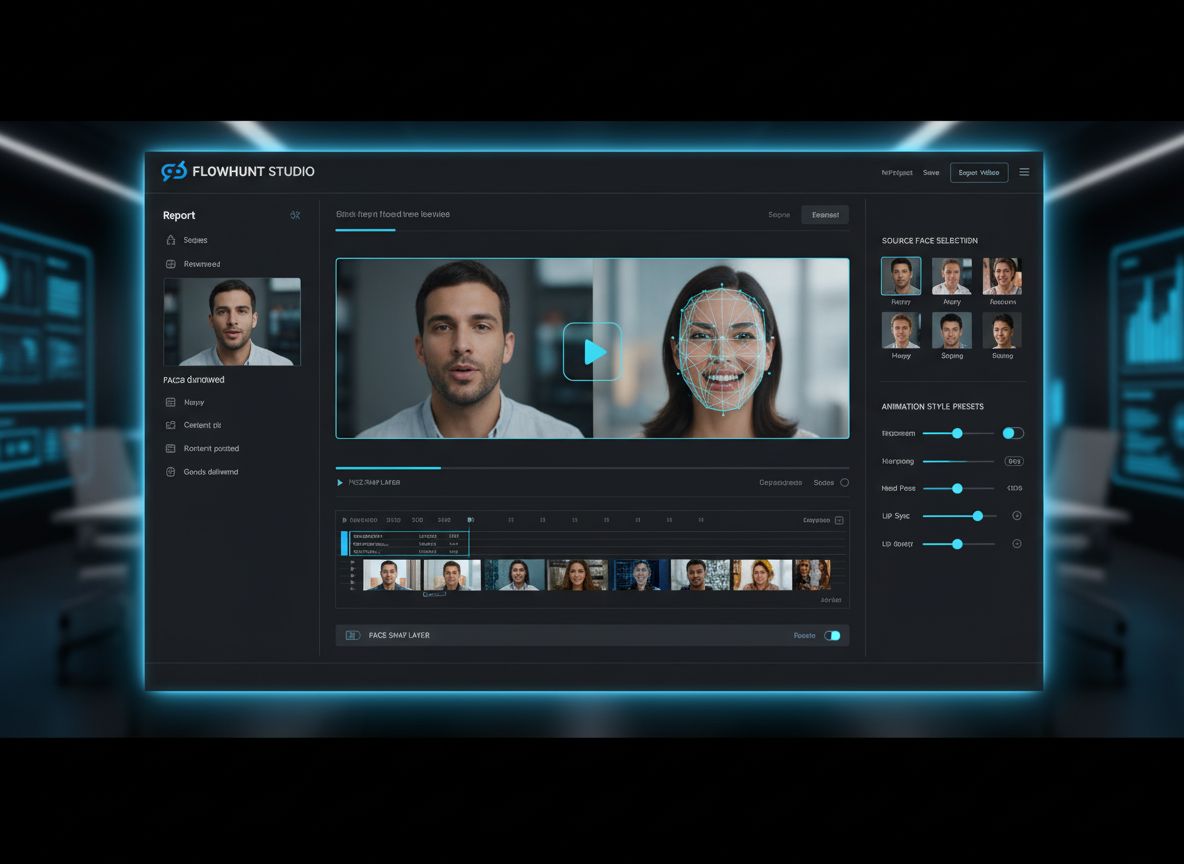

Dowiedz się, jak korzystać z WAN 2.2 Animate Replace, aby tworzyć profesjonalne filmy z podmienionymi twarzami i animacjami AI. Poznaj pełen workflow, zaawansowane techniki oraz kreatywne zastosowania dla twórców i marketerów.

Sztuczna inteligencja zrewolucjonizowała sposób tworzenia i edycji treści wideo, a jedną z najbardziej ekscytujących innowacji w tym obszarze jest technologia wymiany twarzy. Możliwość płynnej podmiany twarzy w filmach przy zachowaniu naturalnych animacji otwiera nieograniczone możliwości kreatywne dla twórców, marketerów i profesjonalistów z branży rozrywkowej. W tym kompleksowym przewodniku poznasz, jak opanować WAN 2.2 Animate Replace — nowoczesną funkcję dostępną w FlowHunt Photomatic, która udostępnia profesjonalną wymianę twarzy każdemu użytkownikowi. Niezależnie od tego, czy chcesz tworzyć treści rozrywkowe, spersonalizowane filmy marketingowe czy innowacyjne materiały do social mediów, zrozumienie tej technologii da Ci znaczącą przewagę w cyfrowym świecie treści.

Technologia wymiany twarzy to ogromny krok naprzód w manipulacji wideo i tworzeniu treści. W swoim rdzeniu, wykorzystuje zaawansowane algorytmy uczenia maszynowego do rozpoznawania cech twarzy, analizowania wzorców ruchu i płynnego osadzania nowej twarzy w istniejącym materiale filmowym, zachowując wszystkie oryginalne animacje, mimikę i ruchy. Proces ten jest znacznie bardziej zaawansowany niż proste nakładanie obrazu — angażuje modele głębokiego uczenia, które rozumieją trójwymiarową geometrię twarzy, warunki oświetleniowe, teksturę skóry i sposób, w jaki twarz wchodzi w interakcje z otoczeniem. Tradycyjna edycja wideo wymagałaby ręcznej korekty każdej klatki, co jest czasochłonne i często daje nienaturalny efekt. Nowoczesna wymiana twarzy oparta o AI potrafi analizować tysiące klatek jednocześnie i podejmować inteligentne decyzje jak najlepiej połączyć nową twarz z kontekstem oryginalnego filmu. Technologia ta bardzo rozwinęła się w ostatnich latach — od eksperymentalnych projektów naukowych po praktyczne, intuicyjne narzędzia dostępne dla profesjonalistów i amatorów poprzez platformy takie jak FlowHunt Photomatic. Sieci neuronowe stojące za tą technologią zostały wytrenowane na ogromnych zbiorach zdjęć i filmów twarzy, dzięki czemu rozumieją subtelności ludzkiej mimiki i ruchu w sposób nieosiągalny dla klasycznego oprogramowania.

Znaczenie szeroko dostępnej technologii wymiany twarzy wykracza daleko poza rozrywkę i wirusowe filmy. W dzisiejszym cyfrowym świecie personalizacja jest kluczowa dla skuteczności marketingu i angażowania odbiorców. Marki odkrywają, że spersonalizowane filmy — w których klient widzi swoją twarz lub znaną twarz w przekazie marketingowym — generują znacznie wyższe wskaźniki zaangażowania i konwersji niż treści ogólne. Ta technologia demokratyzuje także produkcję wideo, pozwalając małym firmom i niezależnym twórcom tworzyć materiały, które wcześniej wymagały kosztownych studiów, profesjonalnych aktorów i długiej postprodukcji. Branża rozrywkowa już eksperymentuje z wymianą twarzy do tworzenia deepfake’ów celebrytów w żartobliwym kontekście, choć pojawiają się tu także ważne dylematy etyczne dotyczące zgody i autentyczności. Instytucje edukacyjne wykorzystują podobne technologie do tworzenia ciekawszych materiałów dydaktycznych, a działy HR produkują spersonalizowane filmy onboardingowe i szkoleniowe. Możliwość szybkiego tworzenia wariantów treści — testowania różnych twarzy, emocji, scenariuszy — przyspiesza proces kreatywny i pozwala na eksperymentowanie z pomysłami, które wcześniej byłyby zbyt kosztowne. Technologia wymiany twarzy umożliwia także współpracę z talentami zdalnie, eliminując bariery geograficzne i znacząco obniżając koszty produkcji. Wraz z upowszechnieniem tej technologii, umiejętność jej efektywnego wykorzystania staje się niezbędną kompetencją dla twórców, marketerów i profesjonalistów wideo.

WAN 2.2 Animate Replace to najnowocześniejszy model generowania wideo AI opracowany przez Tongyi Lab, będący najnowszym osiągnięciem w dziedzinie wymiany twarzy i animacji. W odróżnieniu od wcześniejszych narzędzi, WAN 2.2 szczególnie wyróżnia się zachowaniem naturalności i integralności animacji podczas podmiany twarzy. Nazwa “Animate Replace” wskazuje, że model ten został zoptymalizowany pod kątem scenariuszy, w których kluczowe jest zachowanie złożonych animacji i ruchów z filmu źródłowego przy jednoczesnej wymianie twarzy. Model przyjmuje dwa główne wejścia: obraz referencyjny z twarzą, którą chcesz użyć, oraz film referencyjny z ruchem i animacją, które chcesz zachować. AI przeprowadza zaawansowaną analizę obu materiałów, identyfikując kluczowe punkty twarzy, rozumiejąc trójwymiarową strukturę twarzy z obrazu i mapując, jak ta twarz powinna się poruszać zgodnie z ruchem w filmie referencyjnym. WAN 2.2 imponuje szczególnie tym, jak radzi sobie ze zróżnicowanym oświetleniem, różnymi kątami i złożoną mimiką, zachowując fotorealistyczną jakość. Model został nauczony, jak skóra odbija światło, jak mięśnie twarzy poruszają się pod jej powierzchnią oraz jak płynnie zblendować nową twarz z tłem i otoczeniem oryginalnego wideo. Dzięki temu efekt końcowy wygląda naturalnie i przekonująco, a nie sztucznie czy nienaturalnie. Technologia ta sprawdza się świetnie w rozrywce — można na przykład tworzyć przekonujące filmy z podmienionymi twarzami znanych osób — ale jest równie cenna w profesjonalnych zastosowaniach, gdzie autentyczność i jakość mają kluczowe znaczenie.

FlowHunt zintegrował WAN 2.2 Animate Replace ze swoją platformą Photomatic AI, udostępniając tę zaawansowaną technologię poprzez intuicyjny, przyjazny interfejs. Aby zacząć, należy zalogować się do swojego panelu FlowHunt i przejść do sekcji Photomatic, która jest centrum wszystkich możliwości generowania zdjęć i filmów. W Photomatic znajdziesz sekcję Models, gdzie możesz przeglądać dostępne modele AI i wybrać WAN 2.2 Animate. Interfejs został zaprojektowany tak, by nawet osoby bez doświadczenia technicznego mogły łatwo się w nim odnaleźć — każda opcja jest jasno opisana i opatrzona podpowiedziami. Na pulpicie znajdziesz dwa główne miejsca na wejścia: jedno na obraz referencyjny, drugie na wideo referencyjne. Obraz referencyjny powinien zawierać twarz, którą chcesz użyć w swoim filmie — może to być portret, zdjęcie typu headshot lub dowolna fotografia, na której twarz jest dobrze widoczna i oświetlona. Wideo referencyjne to materiał źródłowy zawierający ruchy i animacje, które chcesz zachować — na przykład 8-sekundowy klip z tańczącą osobą, konkretną czynnością lub przemówieniem. Ogromną zaletą tego workflow jest elastyczność — możesz eksperymentować z różnymi kombinacjami obrazów i filmów, tworząc zupełnie nowe treści. Interfejs FlowHunt umożliwia także regulację różnych parametrów kontrolujących przebieg wymiany twarzy, dzięki czemu możesz dopasować efekt do swoich potrzeb i preferencji. Platforma zajmuje się wszystkimi złożonymi obliczeniami w tle, więc nie musisz martwić się o szczegóły techniczne jak alokacja GPU czy optymalizacja modelu.

Stworzenie filmu z podmienioną twarzą za pomocą WAN 2.2 Animate Replace w FlowHunt Photomatic to prosty proces, który zajmuje zaledwie kilka minut. Pierwszym krokiem jest przygotowanie obrazu referencyjnego — powinno to być wyraźne, dobrze oświetlone zdjęcie twarzy, którą chcesz użyć. Jakość zdjęcia ma duże znaczenie; im wyższa rozdzielczość i lepsze warunki oświetleniowe, tym lepszy efekt końcowy. Najlepiej, jeśli twarz patrzy prosto w obiektyw lub pod lekkim kątem, ponieważ to daje AI najlepszy wgląd w strukturę i rysy twarzy. Gdy masz już obraz, wybierz lub przygotuj wideo referencyjne, które powinno zawierać animacje i ruchy, które chcesz przenieść do filmu wynikowego. Może to być klip od kilku sekund do kilku minut, choć na początek najlepiej sprawdzają się krótsze materiały (8-30 sekund). Jakość wideo też ma znaczenie — zalecana jest rozdzielczość co najmniej 720p, choć im wyższa, tym lepiej. Po zebraniu materiałów zaloguj się do FlowHunt i przejdź do Photomatic. Wybierz Models i kliknij WAN 2.2 Animate. Zobaczysz interfejs z dwoma miejscami do przesyłania plików: dla obrazu referencyjnego i filmu referencyjnego. Najpierw prześlij obraz, potem wideo. System przetworzy oba pliki i wyświetli podgląd, byś mógł sprawdzić, czy wszystko jest poprawnie załadowane. Następnie możesz dodać prompt tekstowy — jest to opcjonalne pole, w którym możesz doprecyzować swoje oczekiwania wobec AI, np. “profesjonalne oświetlenie” lub “zachowaj naturalne miny”, aby lepiej nakierować algorytm. Po skonfigurowaniu wszystkiego kliknij Generuj i AI rozpocznie przetwarzanie. Proces generowania trwa zwykle kilka minut w zależności od długości filmu i obciążenia systemu. Zobaczysz pasek postępu pokazujący status generowania. Po zakończeniu możesz obejrzeć wygenerowany film bezpośrednio w interfejsie i pobrać go na komputer.

Zobacz, jak FlowHunt automatyzuje tworzenie treści i wideo AI — od wymiany twarzy i animacji po publikację i analitykę — wszystko w jednym miejscu.

Podstawowy workflow generowania filmów z wymienioną twarzą jest prosty, jednak istnieje wiele zaawansowanych technik pozwalających znacząco poprawić jakość i profesjonalizm efektu końcowego. Kluczowa jest odpowiednia obróbka obrazu referencyjnego — przed przesłaniem warto go przyciąć i odpowiednio wykadrować. Twarz powinna zajmować co najmniej 30-40% kadru, by AI miała wystarczająco dużo detali do pracy i mogła precyzyjnie rozpoznać rysy twarzy. Oświetlenie to kolejny bardzo ważny czynnik — zdjęcia zrobione w naturalnym lub studyjnym świetle dają lepszy efekt niż te z ostrym lub nierównomiernym oświetleniem. Jeśli masz zdjęcie z nieoptymalnym światłem, warto przed przesłaniem poprawić jasność i kontrast w podstawowym edytorze zdjęć. Wybierając film referencyjny, zwróć uwagę na jakość ruchów i animacji, które chcesz zachować. Filmy z płynnymi, naturalnymi ruchami sprawdzą się lepiej niż te z nagłymi czy roztrzęsionymi ujęciami. Jeśli korzystasz z wideo nagranego smartfonem, rozważ stabilizację obrazu przed przesłaniem. Liczy się też liczba klatek na sekundę — filmy nagrane w co najmniej 24 fps będą wyglądać naturalniej. Kolejną zaawansowaną techniką jest eksperymentowanie z promptami — zamiast zostawiać pole pustym, możesz podać konkretne wytyczne, np. “kinowe oświetlenie”, “profesjonalna jakość”, “naturalny odcień skóry”, “zachowaj intensywność mimiki”. Takie podpowiedzi pomagają AI lepiej zrozumieć Twój zamysł i mogą znacząco poprawić efekt. Jeśli planujesz tworzyć wiele wariantów tego samego filmu, przygotuj zestaw zdjęć referencyjnych z niewielkimi różnicami w kącie, wyrazie twarzy czy oświetleniu. Umożliwi Ci to szybkie generowanie różnych wersji i wybór najlepszej. Dla zastosowań profesjonalnych warto rozważyć postprodukcję w klasycznym edytorze wideo — choć WAN 2.2 Animate Replace daje wysoką jakość, dodatkowa korekcja barw, dźwięk czy efekty mogą podnieść film do poziomu broadcastowego.

Wszechstronność technologii wymiany twarzy otwiera liczne możliwości kreatywne w różnych branżach i kontekstach. W rozrywce i social media twórcy tworzą wirusowe treści — najbardziej znany przykład to “Rick Roll”, czyli podmiana twarzy w kultowym klipie Ricka Astleya. Takie treści są chętnie udostępniane i generują duże zaangażowanie na TikToku, Instagramie czy YouTube. Marketingowcy wykorzystują wymianę twarzy do masowego tworzenia spersonalizowanych komunikatów wideo. Wyobraź sobie, że firma chce wysłać spersonalizowane życzenia urodzinowe do tysięcy klientów — zamiast nagrywać osobne filmy dla każdego, nagrywają jeden klip i podmieniają w nim twarz na twarz odbiorcy. To bardzo skuteczny sposób na zwiększenie zaangażowania. Szkoły wykorzystują technologię do tworzenia ciekawszych materiałów nauczania — nauczyciel historii może przygotować film, w którym postać historyczna “osobiście” tłumaczy dany temat, co czyni lekcję ciekawszą i bardziej zapadającą w pamięć. Dz iały HR tworzą spersonalizowane filmy onboardingowe, w których nowy pracownik widzi siebie w różnych sytuacjach szkoleniowych. W branży rozrywkowej wymiana twarzy służy do tworzenia deepfake’ów celebrytów w humorystycznych kontekstach, choć tu pojawiają się kwestie etyczne. Agenci nieruchomości eksperymentują z podmianą twarzy, tworząc spersonalizowane wirtualne spacery, w których potencjalny kupujący widzi siebie lub swoją rodzinę w prezentowanej nieruchomości. Marki modowe i kosmetyczne tworzą wirtualne przymiarki, by klienci mogli zobaczyć, jak produkt wygląda na ich twarzy. Technologia wykorzystywana jest także w grach i VR — gracze mogą zobaczyć swoją twarz na awatarze. Te różnorodne zastosowania pokazują, że wymiana twarzy to nie tylko ciekawostka, lecz potężne narzędzie biznesowe i kreatywne dla wielu branż.

Aby skutecznie korzystać z wymiany twarzy, warto zrozumieć, jak działa ta technologia. WAN 2.2 Animate Replace wykorzystuje połączenie kilku zaawansowanych technik AI pracujących w złożonym pipeline. Pierwszy etap to detekcja twarzy i identyfikacja punktów charakterystycznych — AI analizuje zarówno obraz, jak i film referencyjny, lokalizując oczy, nos, usta i linię szczęki. Na tej podstawie tworzy szczegółową mapę struktury twarzy. Drugi etap to rekonstrukcja 3D — AI na podstawie punktów charakterystycznych buduje trójwymiarowy model twarzy z obrazu referencyjnego. Dzięki temu rozumie, jak twarz wygląda pod różnymi kątami i w różnych warunkach oświetleniowych. Trzeci etap to analiza ruchu — AI analizuje każdą klatkę filmu referencyjnego, by zrozumieć, jak zmienia się mimika, jak porusza się głowa. Te dane ruchu są następnie nakładane na model 3D twarzy z obrazu. Czwarty etap to rendering i blendowanie — AI renderuje nową twarz z przechwyconymi ruchami i płynnie osadza ją w oryginalnym tle filmu. Proces blendowania jest bardzo zaawansowany — musi uwzględniać oświetlenie, cienie i interakcje twarzy z otoczeniem. Ostatni etap to postprocessing i poprawianie jakości — AI stosuje różne filtry i korekty, by efekt końcowy wyglądał naturalnie i fotorealistycznie. W całym procesie AI podejmuje tysiące mikrodecyzji dotyczących wyjątków, zmian światła czy złożonej mimiki. Dlatego technologia wymaga dużych zasobów obliczeniowych i generowanie trwa kilka minut, a nie odbywa się natychmiast. Zrozumienie tego procesu tłumaczy, dlaczego niektóre wejścia dają lepsze efekty — im lepsze (wyższej jakości) obrazy i filmy referencyjne, tym AI łatwiej je prawidłowo przetworzyć na każdym etapie pipeline’u.

Aby uzyskiwać konsekwentnie wysoką jakość filmów z WAN 2.2 Animate Replace, warto stosować kilka sprawdzonych praktyk wypracowanych przez wielu użytkowników. Przede wszystkim zadbaj o przygotowanie materiałów referencyjnych. Na obraz referencyjny warto poświęcić więcej czasu — jeśli robisz nowe zdjęcie, użyj profesjonalnego oświetlenia lub fotografuj na zewnątrz w naturalnym świetle. Jeżeli korzystasz ze starego zdjęcia, sprawdź, czy jest ostre, dobrze oświetlone i nie ma na nim nadmiernych cieni lub odbić. Twarz powinna być w neutralnym lub lekko uśmiechniętym wyrazie, co daje AI dobry punkt wyjścia do naturalnych animacji. Wybierając film referencyjny, stawiaj na płynne, naturalne ruchy. Unikaj ekstremalnych zbliżeń czy nietypowych kątów, bo mogą zmylić algorytmy AI. Najlepiej, jeśli twarz jest wyraźnie widoczna, a ruchy spokojne i płynne. Jeśli samodzielnie tworzysz film referencyjny, nagraj kilka wersji i wybierz najlepszą. Zwróć uwagę na spójne oświetlenie w całym filmie — im mniej zmian światła, tym lepszy efekt. Kolejna dobra praktyka to zaczynanie od krótszych filmów na etapie nauki — klipy 8-30 sekund są idealne do testów i eksperymentów. Gdy opanujesz workflow, możesz przejść do dłuższych materiałów. Po wygenerowaniu filmu zawsze sprawdź podgląd przed pobraniem — pozwoli to wyłapać ewentualne błędy czy artefakty jeszcze przed zapisem. Jeśli coś jest nie tak, zmień ustawienia i wygeneruj ponownie. Dokumentuj, które ustawienia i parametry dały najlepsze efekty — taka wiedza pozwoli Ci optymalizować proces w przyszłości. Pamiętaj, by być cierpliwym — choć WAN 2.2 Animate Replace jest bardzo zaawansowany, nie jest doskonały i nie każda kombinacja zdjęcia i filmu da idealny efekt. Kluczem jest eksperymentowanie i iteracja.

Jak każda potężna technologia, wymiana twarzy wiąże się z istotnymi kwestiami etycznymi, o których użytkownicy powinni pamiętać. Najważniejsza jest zgoda — użycie czyjejś twarzy bez jego zgody do stworzenia filmu, w którym ta osoba nie wystąpiła, budzi poważne wątpliwości etyczne i prawne. Sama technologia wymiany twarzy jest neutralna, ale może być użyta do tworzenia deepfake’ów bez zgody czy wprowadzających w błąd materiałów. Odpowiedzialny użytkownik zawsze powinien uzyskać wyraźną zgodę na użycie czyjejś twarzy, zwłaszcza jeśli film będzie publicznie udostępniony lub wykorzystany komercyjnie. Kolejna kwestia to autentyczność i transparentność — jeśli korzystasz z wymiany twarzy w marketingu czy zastosowaniach profesjonalnych, warto jasno poinformować odbiorców, że film został poddany manipulacji. Wprowadzanie w błąd co do autentyczności może zaszkodzić zaufaniu i wiarygodności. W wielu krajach powstają już regulacje dotyczące deepfake’ów i mediów syntetycznych, warto więc być na bieżąco z przepisami. Rozważ także potencjalny wpływ swoich treści — nawet mając zgodę, nie twórz filmów, które mogą kogoś ośmieszyć, skrzywdzić czy zniesławić. Rozrywkowe deepfake’i są akceptowalne, jeśli są tworzone za zgodą i w dobrym tonie, ale wykorzystywanie wymiany twarzy do dezinformacji politycznej czy podszywania się pod kogoś w celach oszustwa jest wysoce nieetyczne i prawdopodobnie nielegalne. Wraz z upowszechnieniem tej technologii odpowiedzialność za jej etyczne użycie spoczywa na użytkownikach. FlowHunt i inne platformy coraz częściej wprowadzają zabezpieczenia i polityki zapobiegające nadużyciom, ale ostatecznie to od uczciwości i rozsądku użytkownika zależy, jak zostanie ona wykorzystana.

Dla twórców i marketerów, którzy chcą regularnie korzystać z wymiany twarzy, kluczowe są integracja i automatyzacja. FlowHunt Photomatic został zaprojektowany tak, aby łatwo integrował się z szerszym procesem produkcji treści, umożliwiając automatyzację wymiany twarzy jako elementu większego pipeline’u. Jeżeli tworzysz wiele filmów z wymienioną twarzą, warto przygotować szablony i ustandaryzowane procesy — możesz na przykład stworzyć standardowe wideo referencyjne i używać go z różnymi zdjęciami, albo zbudować bibliotekę zdjęć referencyjnych do łączenia z różnymi filmami. To znacząco przyspiesza produkcję i zapewnia spójność. Kolejną opcją jest łączenie wymiany twarzy z innymi narzędziami AI dostępnymi w FlowHunt — możesz wygenerować obraz AI, a następnie go animować za pomocą wymiany twarzy, albo wygenerować bazowy film AI i spersonalizować go. W marketingu warto zintegrować wymianę twarzy z kampaniami e-mailowymi lub spersonalizowanym wideo — wiele platform mailingowych obsługuje już dynamiczne treści wideo, dzięki czemu możesz wysyłać spersonalizowane filmy do różnych segmentów odbiorców. Pracując w zespole, ustal jasny workflow i standardy — dokumentuj, które obrazy i filmy sprawdzają się najlepiej, twórz szablony i określaj standardy jakości filmów. Dobra organizacja pozwala utrzymać wysoką jakość i wydajność całego procesu. Zadbaj też o logiczne katalogowanie i przechowywanie wygenerowanych filmów, by łatwo je odnaleźć i ponownie wykorzystać. Na koniec monitoruj efekty swoich filmów — analizuj wskaźniki zaangażowania, konwersji i feedback odbiorców, by wiedzieć, jakie treści najlepiej się sprawdzają i jak optymalizować dalszą produkcję.

Choć WAN 2.2 Animate Replace to technologia solidna i niezawodna, czasem mogą pojawić się problemy lub niezadowalające efekty. Znając najczęstsze trudności i sposoby ich rozwiązania, łatwiej sobie z nimi poradzisz. Typowym problemem jest słabe rozpoznanie twarzy, zwykle spowodowane nieostrym, zbyt ciemnym lub zbyt jasnym zdjęciem referencyjnym, nietypowym kątem lub słabymi detalami. W takim przypadku spróbuj użyć innego zdjęcia — wyraźniejszego, z lepszym oświetleniem. Innym problemem mogą być nienaturalne animacje lub wyraz twarzy; zwykle dzieje się tak, gdy film referencyjny zawiera bardzo intensywną mimikę lub nietypowe ruchy, które trudno przenieść na nową twarz. Wybierz wtedy film z bardziej umiarkowanymi, naturalnymi ruchami. Jeśli w wygenerowanym filmie pojawiają się artefakty lub problem z blendowaniem, przyczyną mogą być różnice w oświetleniu lub kącie pomiędzy zdjęciem a filmem — spróbuj dopasować oświetlenie zdjęcia do filmu. Czasem kolorystyka filmu odbiega od oczekiwań — można to poprawić w edytorze wideo przez korekcję barw. Jeśli proces generowania trwa zbyt długo lub kończy się błędem, może być to przejściowy problem systemowy — poczekaj chwilę i spróbuj ponownie. Sprawdź też połączenie internetowe i poprawność przesłanych plików. Warto też zaczynać od prostszych kombinacji zdjęć i filmów — najpierw naucz się procesu na łatwiejszych materiałach, zanim przejdziesz do bardziej wymagających. To pozwoli Ci lepiej zrozumieć, jak działa technologia i co wpływa na efekty. W razie powtarzających się problemów skontaktuj się z pomocą FlowHunt — zespół wsparcia udzieli wskazówek i pomoże rozwiązać problem.

Technologia wymiany twarzy rozwija się błyskawicznie, a przyszłość przyniesie jeszcze bardziej zaawansowane i dostępne narzędzia. Obecnie badania skupiają się na zwiększeniu realizmu, zwłaszcza w trudnych sytuacjach jak ekstremalne kąty, złożone oświetlenie czy szybkie ruchy. Przyszłe wersje modeli będą jeszcze lepiej radzić sobie z takimi przypadkami. Intensywnie rozwijany jest też obszar wymiany twarzy w czasie rzeczywistym — pozwoli to na transmisje live z podmienioną twarzą bez potrzeby postprocessingu. To otworzy nowe możliwości dla rozrywki na żywo, wydarzeń wirtualnych czy interaktywnych doświadczeń. Trwają także prace nad optymalizacją modeli pod kątem wydajności, by skrócić czas generowania i umożliwić korzystanie z technologii na słabszych urządzeniach. Dużo uwagi poświęca się też temu, by wymiana twarzy była jeszcze bardziej kontrolowalna — przyszłe narzędzia pozwolą np. precyzyjnie sterować mimiką, oświetleniem czy podkreślaniem wybranych cech twarzy. Integracja wymiany twarzy z innymi technologiami AI zapowiada się równie ciekawie — połączenie z syntezą głosu AI umożliwi tworzenie w pełni syntetycznych filmów, w których twarz i głos są generowane przez AI. To może zrewolucjonizować produkcję treści, ale rodzi też poważne wyzwania etyczne, którym branża musi sprostać. Wraz z dojrzewaniem technologii pojawią się bardziej zaawansowane zabezpieczenia i mechanizmy uwierzytelniania — np. systemy blockchain do weryfikacji autentyczności wideo. Prawdopodobnie ukształtują się też branżowe standardy i dobre praktyki w zakresie etycznego użycia mediów syntetycznych. Organizacje branżowe już zaczynają opracowywać takie wytyczne.

WAN 2.2 Animate Replace to ogromny krok naprzód w dziedzinie generowania wideo AI i udostępnienie profesjonalnej wymiany twarzy dla twórców, marketerów i profesjonalistów z wielu branż. Dzięki FlowHunt Photomatic ta zaawansowana technologia jest dostępna przez intuicyjny interfejs, który nie wymaga wiedzy technicznej do skutecznego użycia. Niezależnie, czy tworzysz treści rozrywkowe do social mediów, spersonalizowane filmy marketingowe, materiały edukacyjne czy profesjonalne zastosowania — wymiana twarzy otwiera nieznane dotąd możliwości kreatywne. Kluczem do sukcesu jest zrozumienie

WAN 2.2 Animate Replace to zaawansowany model generowania wideo AI, który pozwala zastąpić twarz w filmie referencyjnym twarzą z obrazu referencyjnego, zachowując oryginalną animację i ruchy. To idealne rozwiązanie do tworzenia profesjonalnych filmów z podmienionymi twarzami.

Proces polega na przesłaniu obrazu referencyjnego (z twarzą, którą chcesz użyć) oraz wideo referencyjnego (z ruchem i animacjami). AI analizuje oba materiały i płynnie zastępuje twarz w filmie Twoją twarzą z obrazu, zachowując wszystkie oryginalne animacje.

Wymiana twarzy może być wykorzystywana do treści rozrywkowych, spersonalizowanych wiadomości wideo, kreatywnych materiałów do social mediów, kampanii marketingowych, prezentacji edukacyjnych czy zabawnych, wirusowych filmów. Szczególnie skuteczna jest przy tworzeniu angażujących, udostępnianych treści przyciągających uwagę.

Tak, zdecydowanie. Technologia wymiany twarzy jest coraz częściej wykorzystywana w profesjonalnym marketingu do tworzenia spersonalizowanych filmów, referencji czy materiałów promocyjnych. WAN 2.2 Animate Replace w FlowHunt Photomatic zapewnia jakość i kontrolę potrzebną do zastosowań profesjonalnych.

Czas generowania zależy od długości i złożoności filmu, ale większość filmów jest przetwarzana w ciągu kilku minut. Ośmiosekundowy film zwykle powstaje bardzo szybko, co pozwala na szybkie iteracje i eksperymenty z różnymi twarzami i animacjami.

Arshia jest Inżynierką Przepływów Pracy AI w FlowHunt. Z wykształceniem informatycznym i pasją do sztucznej inteligencji, specjalizuje się w tworzeniu wydajnych przepływów pracy, które integrują narzędzia AI z codziennymi zadaniami, zwiększając produktywność i kreatywność.

Poznaj moc WAN 2.2 Animate Replace w FlowHunt Photomatic. Twórz oszałamiające filmy z podmienionymi twarzami w kilka minut.

FlowHunt obsługuje już modele generowania wideo Wan 2.2 i 2.5 do tekstu na wideo, obrazu na wideo, podmiany person i animacji. Odmień swoje tworzenie treści dzi...

Odkryj, jak narzędzia AI do zamiany twarzy, takie jak Wan 2.2 Animate, zmieniają proces tworzenia wideo na TikToku, umożliwiając twórcom generowanie viralowych ...

Październikowa aktualizacja FlowHunt 2025 wprowadza rewolucyjne modele generowania wideo Wan 2.2 i 2.5 do tekstu-na-wideo, obrazu-na-wideo i animacji, a także z...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.