Serwer Databricks MCP

Serwer Databricks MCP umożliwia płynną integrację pomiędzy asystentami AI a platformą Databricks, zapewniając dostęp do zasobów Databricks za pomocą języka natu...

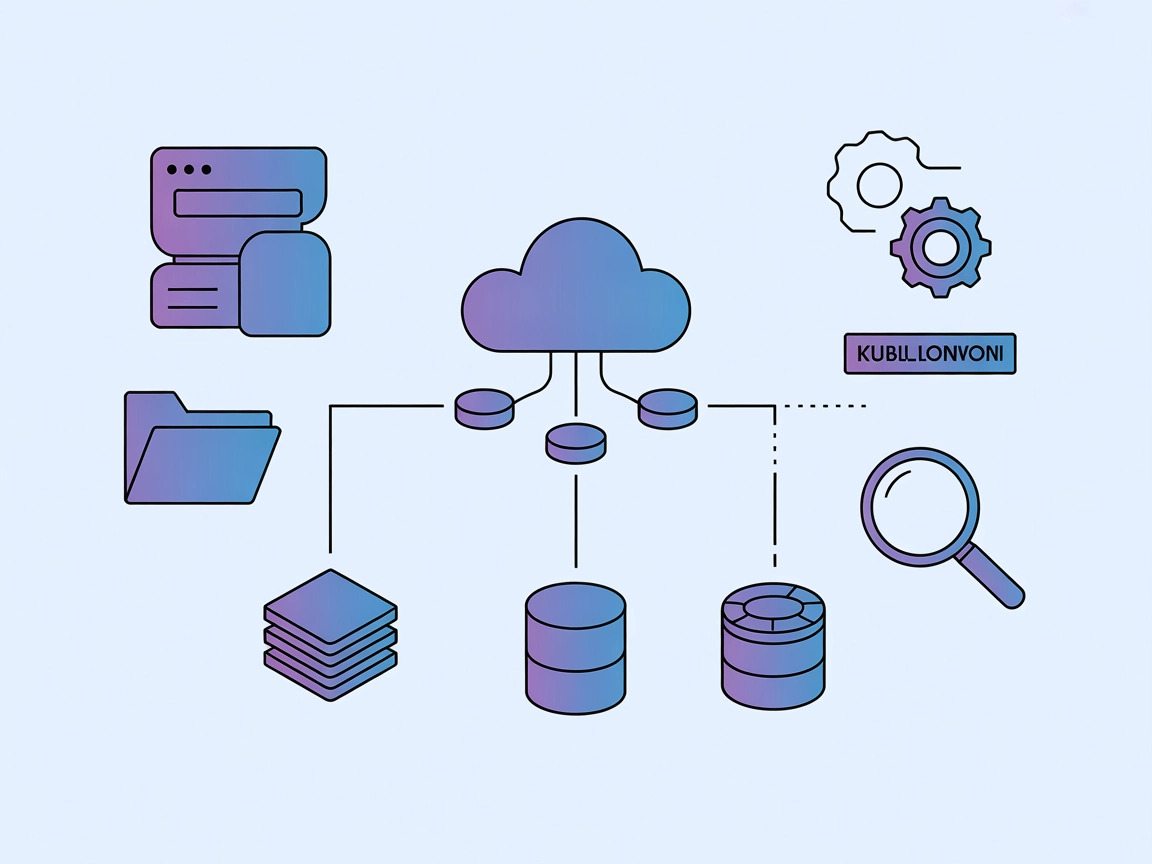

Połącz swojego asystenta AI z Databricks dzięki Genie MCP Server, aby uzyskać dostęp do zapytań w języku naturalnym, metadanych workspace’u oraz zarządzania rozmowami wieloetapowymi, usprawniając przepływy pracy oparte na danych.

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Databricks Genie MCP Server to serwer Model Context Protocol (MCP) zaprojektowany jako pomost między asystentami AI a API Databricks Genie. Dzięki tej integracji duże modele językowe (LLM) mogą komunikować się ze środowiskiem Databricks w języku naturalnym. Serwer pozwala na takie działania jak: wyświetlanie przestrzeni Genie, pobieranie metadanych workspace’u, inicjowanie i prowadzenie rozmów Genie oraz wykonywanie zapytań SQL – wszystko za pomocą standaryzowanych narzędzi MCP. Jako łącznik, Databricks Genie MCP Server umożliwia deweloperom wzbogacenie pracy o konwersacyjną eksplorację danych, bezpośrednie zapytania SQL i płynną interakcję z agentami rozmów Databricks, usprawniając rozwój i analizę opartą na danych.

W repozytorium nie udokumentowano jawnych szablonów promptów.

W repozytorium nie opisano jawnych zasobów.

.env ze swoimi danymi logowania do Databricks (DATABRICKS_HOST i DATABRICKS_TOKEN).{

"mcpServers": {

"databricks-genie": {

"command": "python",

"args": ["main.py"]

}

}

}

{

"env": {

"DATABRICKS_HOST": "your-databricks-instance.cloud.databricks.com",

"DATABRICKS_TOKEN": "your-personal-access-token"

},

"inputs": {}

}

.env ze swoim hostem i tokenem Databricks.mcp install main.py

.env.{

"mcpServers": {

"databricks-genie": {

"command": "python",

"args": ["main.py"]

}

}

}

.env.{

"mcpServers": {

"databricks-genie": {

"command": "python",

"args": ["main.py"]

}

}

}

Korzystanie z MCP w FlowHunt

Aby zintegrować serwery MCP w swoim przepływie FlowHunt, zacznij od dodania komponentu MCP do flow i połączenia go z agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemowego MCP wstaw dane serwera MCP w tym formacie JSON:

{

"databricks-genie": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może już korzystać z MCP jako narzędzia ze wszystkimi funkcjonalnościami. Pamiętaj, by “databricks-genie” zastąpić faktyczną nazwą swojego serwera MCP i podać swój adres URL do MCP.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | |

| Lista promptów | ⛔ | Brak szablonów promptów w repozytorium |

| Lista zasobów | ⛔ | Brak udokumentowanych jawnych zasobów MCP |

| Lista narzędzi | ✅ | 4 narzędzia: patrz sekcja wyżej |

| Zabezpieczanie kluczy API | ✅ | Opisane przez .env i przykład JSON |

| Sampling Support (mało istotne w ocenie) | ⛔ | Brak wzmianki |

Databricks Genie MCP Server stanowi praktyczny pomost między Databricks a LLM, oferując jasne instrukcje wdrożenia i narzędzia. Brakuje jednak szablonów promptów, jawnych zasobów oraz dokumentacji na temat zaawansowanych funkcji MCP jak sampling czy roots. Podstawowe narzędzia są dobrze opisane i użyteczne dla użytkowników Databricks. Ogólnie wypada powyżej średniej, ale przydałoby się bogatsze wykorzystanie funkcji MCP.

| Posiada LICENSE | Tak (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | Tak |

| Liczba Forków | 1 |

| Liczba Gwiazdek | 3 |

To serwer Model Context Protocol, który łączy duże modele językowe z Databricks Genie, umożliwiając interakcję w języku naturalnym, generowanie zapytań SQL i pobieranie metadanych workspace’u bezpośrednio z poziomu asystentów AI.

Możesz wyświetlić listę przestrzeni Genie, pobrać metadane przestrzeni, inicjować i zarządzać rozmowami Genie w języku naturalnym oraz uruchamiać lub kontynuować zapytania SQL.

Usprawnia eksplorację danych poprzez konwersacyjne, wieloetapowe zapytania i automatyczne generowanie SQL, czyniąc analizę danych bardziej dostępną i ograniczając ręczne pisanie zapytań.

Dane takie jak host i token Databricks są zarządzane przez zmienne środowiskowe – nigdy nie są wpisywane na stałe, co zapewnia bezpieczeństwo wrażliwych informacji.

Nie, repozytorium nie zawiera jawnych szablonów promptów ani dodatkowych zasobów MCP, ale podstawowe narzędzia do rozmów i zapytań SQL są w pełni wspierane.

Odblokuj konwersacyjną analizę danych i bezpośrednie zapytania SQL w FlowHunt, łącząc swój workspace Databricks z Genie MCP Server.

Serwer Databricks MCP umożliwia płynną integrację pomiędzy asystentami AI a platformą Databricks, zapewniając dostęp do zasobów Databricks za pomocą języka natu...

Zintegruj zaawansowane funkcje orkiestracji MLOps i LLMOps ZenML w przepływach swojego asystenta AI za pomocą ZenML MCP Server. Umożliwiaj zarządzanie pipeline’...

Kubernetes MCP Server łączy asystentów AI z klastrami Kubernetes/OpenShift, umożliwiając programistyczne zarządzanie zasobami, operacje na podach oraz automatyz...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.