Integracja serwera Grafana MCP

Zintegruj i zautomatyzuj pulpity nawigacyjne, źródła danych oraz narzędzia monitorujące Grafany w przepływach pracy opartych na AI dzięki serwerowi Grafana MCP ...

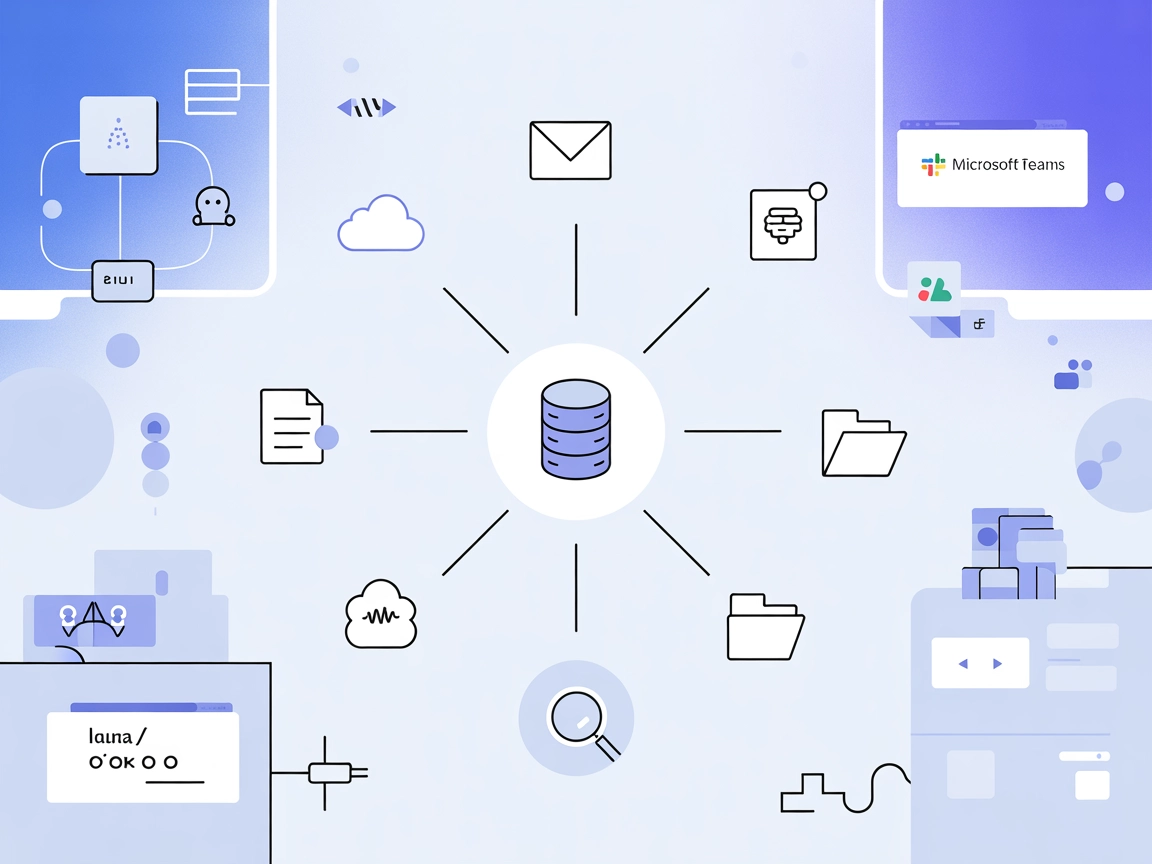

Agreguj, wyszukuj i przekształcaj wiedzę z dziesiątek platform dzięki Graphlit MCP Server, odblokowując zaawansowane przepływy RAG i AI w FlowHunt.

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Serwer Graphlit MCP (Model Context Protocol) pełni rolę pomostu między klientami MCP a platformą Graphlit, umożliwiając płynną integrację z szeroką gamą zewnętrznych źródeł danych i usług. Jego głównym zadaniem jest agregowanie, indeksowanie i udostępnianie do przeszukiwania różnorodnych treści z platform takich jak Slack, Discord, strony internetowe, Google Drive, e-mail, Jira, Linear i GitHub, przekształcając je w zunifikowaną, gotową pod RAG (Retrieval-Augmented Generation) bazę wiedzy. Serwer obsługuje pobieranie dokumentów, stron internetowych, plików audio i wideo — automatycznie wyodrębniając lub transkrybując treści dla efektywnego wyszukiwania. Dzięki wbudowanym narzędziom do crawl’owania, wyszukiwania i nie tylko, Graphlit MCP Server umożliwia asystentom AI i deweloperom zarządzanie dużymi repozytoriami wiedzy, realizując zaawansowane przepływy pracy, takie jak wyszukiwanie dokumentów, automatyczna ekstrakcja i agregacja danych z wielu źródeł w popularnych środowiskach programistycznych.

Brak jawnych szablonów promptów w dostępnej dokumentacji lub plikach repozytorium.

Brak jawnie opisanych zasobów w dostępnej dokumentacji lub plikach repozytorium.

mcpServers:{

"mcpServers": {

"graphlit": {

"command": "npx",

"args": ["@graphlit/graphlit-mcp-server@latest"]

}

}

}

Używaj zmiennych środowiskowych dla kluczy API:

{

"mcpServers": {

"graphlit": {

"command": "npx",

"args": ["@graphlit/graphlit-mcp-server@latest"],

"env": {

"GRAPHLIT_API_KEY": "your-api-key"

},

"inputs": {

"projectId": "your-project-id"

}

}

}

}

{

"mcpServers": {

"graphlit": {

"command": "npx",

"args": ["@graphlit/graphlit-mcp-server@latest"]

}

}

}

{

"mcpServers": {

"graphlit": {

"command": "npx",

"args": ["@graphlit/graphlit-mcp-server@latest"]

}

}

}

{

"mcpServers": {

"graphlit": {

"command": "npx",

"args": ["@graphlit/graphlit-mcp-server@latest"]

}

}

}

Uwaga: Zawsze używaj zmiennych środowiskowych do zabezpieczania wrażliwych danych, takich jak klucze API, zgodnie z powyższym przykładem dla Windsurf.

Użycie MCP w FlowHunt

Aby zintegrować serwery MCP w przepływie FlowHunt, rozpocznij od dodania komponentu MCP do swojego przepływu i połączenia go z agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemu MCP wstaw dane serwera MCP w formacie JSON:

{

"graphlit": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może korzystać z tego MCP jako narzędzia ze wszystkimi jego funkcjami. Pamiętaj, by zamienić “graphlit” na nazwę swojego serwera MCP i podać własny adres URL serwera MCP.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | Kompletny, z README.md |

| Lista promptów | ⛔ | Brak jawnych szablonów promptów |

| Lista zasobów | ⛔ | Brak jawnych zasobów |

| Lista narzędzi | ✅ | Rozszerzona lista z README.md |

| Zabezpieczanie kluczy API | ✅ | Przykład podany w README.md |

| Sampling Support (mniej istotne przy ocenie) | ⛔ | Brak wzmianki o wsparciu dla sampling |

Wsparcie dla Roots: Niewspomniane jednoznacznie w dokumentacji.

Graphlit MCP Server charakteryzuje się bogatą funkcjonalnością narzędzi i czytelnymi instrukcjami integracji, lecz brakuje mu jawnej dokumentacji szablonów promptów i zasobów MCP. Obecność LICENCJI, aktywny rozwój i duże zaangażowanie na GitHub czynią go solidnym wyborem do zarządzania wiedzą i zastosowań RAG, choć brak dokumentacji zasobów i promptów może ograniczać gotowość do użycia w niektórych przypadkach.

| Ma LICENCJĘ | ✅ (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | ✅ |

| Liczba forków | 34 |

| Liczba gwiazdek | 306 |

Serwer Graphlit MCP działa jako pomost między klientami MCP a platformą Graphlit, agregując, indeksując i udostępniając do przeszukiwania szeroki zakres zewnętrznych treści — w tym dokumentów, wiadomości, e-maili i multimediów — z platform takich jak Slack, Discord, Google Drive, GitHub i innych. Zapewnia zunifikowaną, gotową pod RAG bazę wiedzy i obsługuje zaawansowane przepływy pracy AI, takie jak wyszukiwanie dokumentów, automatyczna ekstrakcja i wieloźródłowa agregacja.

Graphlit obsługuje pobieranie danych z narzędzi takich jak Slack, Microsoft Teams, Google Drive, OneDrive, GitHub, Jira, Notion, Discord, Twitter/X, podcasty (RSS) i innych. Przetwarza dokumenty, strony internetowe, e-maile, audio, wideo, obrazy, rozmowy i zgłoszenia.

Zawsze używaj zmiennych środowiskowych do przechowywania wrażliwych kluczy API. W konfiguracji Twojego serwera MCP ustaw poświadczenia, takie jak GRAPHLIT_API_KEY, za pomocą zmiennych środowiskowych, zgodnie z przykładem Windsurf w dokumentacji.

Typowe zastosowania obejmują zarządzanie wiedzą w przedsiębiorstwie, automatyczne pobieranie i wyszukiwanie treści, wieloźródłowe Retrieval-Augmented Generation (RAG), integrację danych między platformami oraz publikację lub transformację treści (np. zamianę tekstu na audio lub obrazy).

Dodaj komponent MCP do przepływu pracy w FlowHunt, a następnie skonfiguruj go, podając szczegóły swojego serwera Graphlit MCP w sekcji konfiguracji systemu MCP. Pozwala to Twojemu agentowi AI na dostęp do wszystkich narzędzi Graphlit oraz pobieranie, wyszukiwanie lub przekształcanie danych z wielu źródeł.

Zintegruj Graphlit MCP Server z FlowHunt, aby bez wysiłku łączyć, wyszukiwać i przekształcać wiedzę ze wszystkich ulubionych platform.

Zintegruj i zautomatyzuj pulpity nawigacyjne, źródła danych oraz narzędzia monitorujące Grafany w przepływach pracy opartych na AI dzięki serwerowi Grafana MCP ...

Zintegruj FlowHunt z serwerem Graphlit Model Context Protocol (MCP), aby zjednoczyć, przeszukiwać i automatyzować bazy wiedzy w Slacku, Discordzie, Google Drive...

Serwer Grafbase MCP łączy asystentów AI z zewnętrznymi źródłami danych lub API, umożliwiając LLM-om dostęp do danych w czasie rzeczywistym, automatyzację przepł...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.