Parsowanie zależności

Parsowanie zależności to metoda analizy składniowej w NLP, która identyfikuje relacje gramatyczne między słowami, tworząc struktury drzewiaste niezbędne w takic...

Rozpoznawanie koreferencji to fundamentalne zadanie NLP polegające na identyfikacji i łączeniu wyrażeń w tekście odnoszących się do tej samej jednostki, kluczowe dla maszynowego rozumienia w zastosowaniach takich jak streszczanie, tłumaczenie i odpowiadanie na pytania.

Rozpoznawanie koreferencji to fundamentalne zadanie w przetwarzaniu języka naturalnego (NLP), polegające na identyfikacji i łączeniu wyrażeń w tekście, które odnoszą się do tej samej jednostki. Rozstrzyga, kiedy dwa lub więcej słów lub fraz w tekście dotyczy tej samej rzeczy lub osoby. Ten proces jest kluczowy, aby maszyny mogły zrozumieć i spójnie interpretować tekst, podczas gdy ludzie naturalnie dostrzegają powiązania między zaimkami, nazwami i innymi wyrażeniami referencyjnymi.

Rozpoznawanie koreferencji stanowi integralną część aplikacji NLP, takich jak streszczanie dokumentów, odpowiadanie na pytania, tłumaczenie maszynowe, analiza sentymentu i ekstrakcja informacji. Odgrywa kluczową rolę w poprawie zdolności maszyn do przetwarzania i rozumienia ludzkiego języka poprzez rozstrzyganie niejednoznaczności i dostarczanie kontekstu.

Kluczowe punkty:

Rozpoznawanie koreferencji stosuje się w różnych zadaniach NLP, usprawniając interakcję człowiek-komputer. Kluczowe zastosowania to:

Mimo swojego znaczenia, rozpoznawanie koreferencji wiąże się z wieloma wyzwaniami:

Do rozpoznawania koreferencji stosuje się różne techniki:

Do rozpoznawania koreferencji używa się wielu nowoczesnych modeli i systemów:

Ocena skuteczności systemów rozpoznawania koreferencji obejmuje kilka miar:

Przyszłość rozpoznawania koreferencji obejmuje kilka obiecujących kierunków:

Rozpoznawanie koreferencji to kluczowy aspekt NLP, łączący maszynowe rozumienie z ludzką komunikacją poprzez rozstrzyganie odniesień i niejednoznaczności w języku. Jego zastosowania są szerokie i różnorodne, obejmując dziedziny od automatyzacji AI po chatboty, gdzie rozumienie ludzkiego języka jest kluczowe.

Rozpoznawanie koreferencji to istotne zadanie w przetwarzaniu języka naturalnego (NLP), polegające na określeniu, kiedy dwa lub więcej wyrażeń w tekście odnosi się do tej samej jednostki. Zadanie to jest kluczowe dla wielu zastosowań, takich jak ekstrakcja informacji, streszczanie tekstu czy odpowiadanie na pytania.

Najważniejsze osiągnięcia badawcze ostatnich lat:

Rozkładanie rozpoznawania koreferencji zdarzeń na rozwiązywalne podzadania:

Ahmed i in. (2023) proponują nowe podejście do rozpoznawania koreferencji zdarzeń (ECR), dzieląc problem na dwa łatwiejsze do zarządzania podzadania. Tradycyjne metody borykają się z nierównomierną dystrybucją par koreferencyjnych i niekoreferencyjnych oraz dużą złożonością obliczeniową. Ich podejście wprowadza heurystykę do efektywnego filtrowania par niekoreferencyjnych oraz zbalansowaną metodę treningową, osiągając wyniki porównywalne z najlepszymi modelami przy mniejszych wymaganiach obliczeniowych. Autorzy analizują także wyzwania związane z klasyfikacją trudnych par wzmianek.

Czytaj więcej

Integracja baz wiedzy w domenie chemicznej:

Lu i Poesio (2024) zajmują się rozpoznawaniem koreferencji i powiązań w patentach chemicznych poprzez włączenie wiedzy zewnętrznej do modelu uczenia wielozadaniowego. Ich badania podkreślają znaczenie wiedzy domenowej dla zrozumienia procesów chemicznych i pokazują, że jej integracja poprawia zarówno rozpoznawanie koreferencji, jak i powiązań. Praca ta wskazuje na potencjał adaptacji domenowej w zwiększaniu skuteczności zadań NLP.

Rozpoznawanie koreferencji w ekstrakcji relacji dialogowych:

Xiong i in. (2023) rozszerzają istniejący zbiór DialogRE do wersji DialogRE^C+, skupiając się na tym, jak rozpoznawanie koreferencji wspiera ekstrakcję relacji w dialogu (DRE). Wprowadzając łańcuchy koreferencyjne do scenariuszy DRE, wspomagają rozumowanie o relacjach argumentów. Zbiór zawiera ręcznie oznaczone 5 068 łańcuchów koreferencyjnych różnych typów, takich jak łańcuchy mówiących i organizacji. Autorzy opracowują modele grafowe DRE wykorzystujące wiedzę o koreferencji, demonstrując poprawę wydajności w ekstrakcji relacji z dialogów. Praca ta podkreśla praktyczne zastosowanie rozpoznawania koreferencji w złożonych systemach dialogowych.

Badania te stanowią istotny postęp w dziedzinie rozpoznawania koreferencji, prezentując innowacyjne metody i zastosowania, które rozwiązują wyzwania tego skomplikowanego zadania NLP.

Inteligentne chatboty i narzędzia AI w jednym miejscu. Łącz intuicyjne bloki, aby zamienić swoje pomysły w zautomatyzowane Flow.

Parsowanie zależności to metoda analizy składniowej w NLP, która identyfikuje relacje gramatyczne między słowami, tworząc struktury drzewiaste niezbędne w takic...

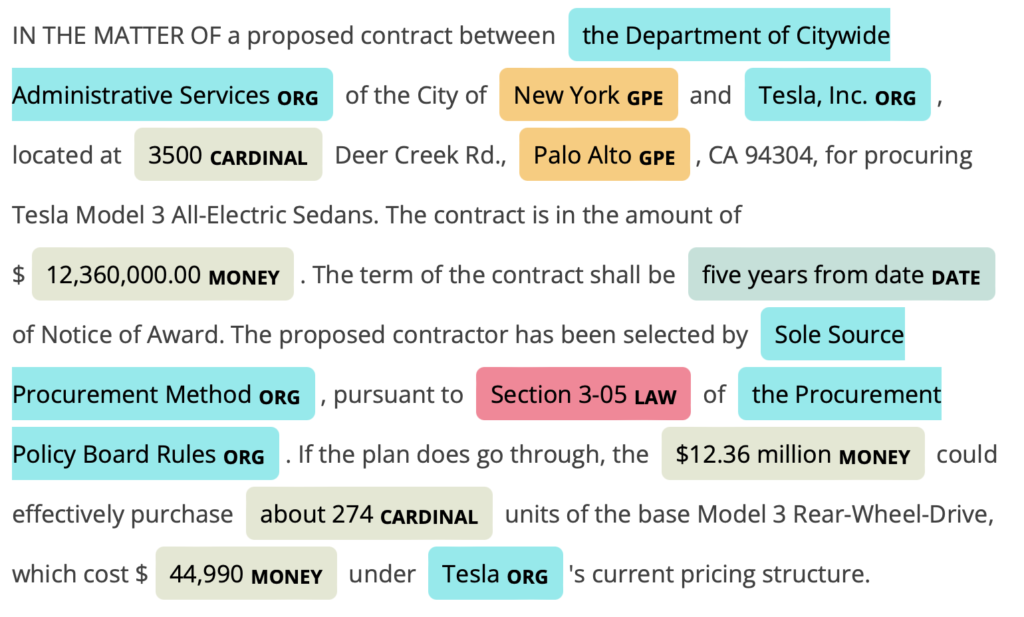

Rozpoznawanie Nazwanych Encji (NER) to kluczowa dziedzina Przetwarzania Języka Naturalnego (NLP) w AI, skupiająca się na identyfikacji i klasyfikacji encji w te...

Przetwarzanie języka naturalnego (NLP) umożliwia komputerom rozumienie, interpretację i generowanie ludzkiego języka z wykorzystaniem lingwistyki komputerowej, ...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.