MCP: Protocolo de Contexto de Modelo

O Protocolo de Contexto de Modelo (MCP) é uma interface aberta e padronizada que permite que Modelos de Linguagem de Grande Porte (LLMs) acessem de forma segura...

Automação de IA

A IA agente está transformando a automação de fluxos de trabalho com o Model Context Protocol (MCP), permitindo integração dinâmica de agentes de IA com diversos recursos. Descubra como o MCP padroniza o acesso ao contexto e ferramentas para aplicações poderosas de IA agente.

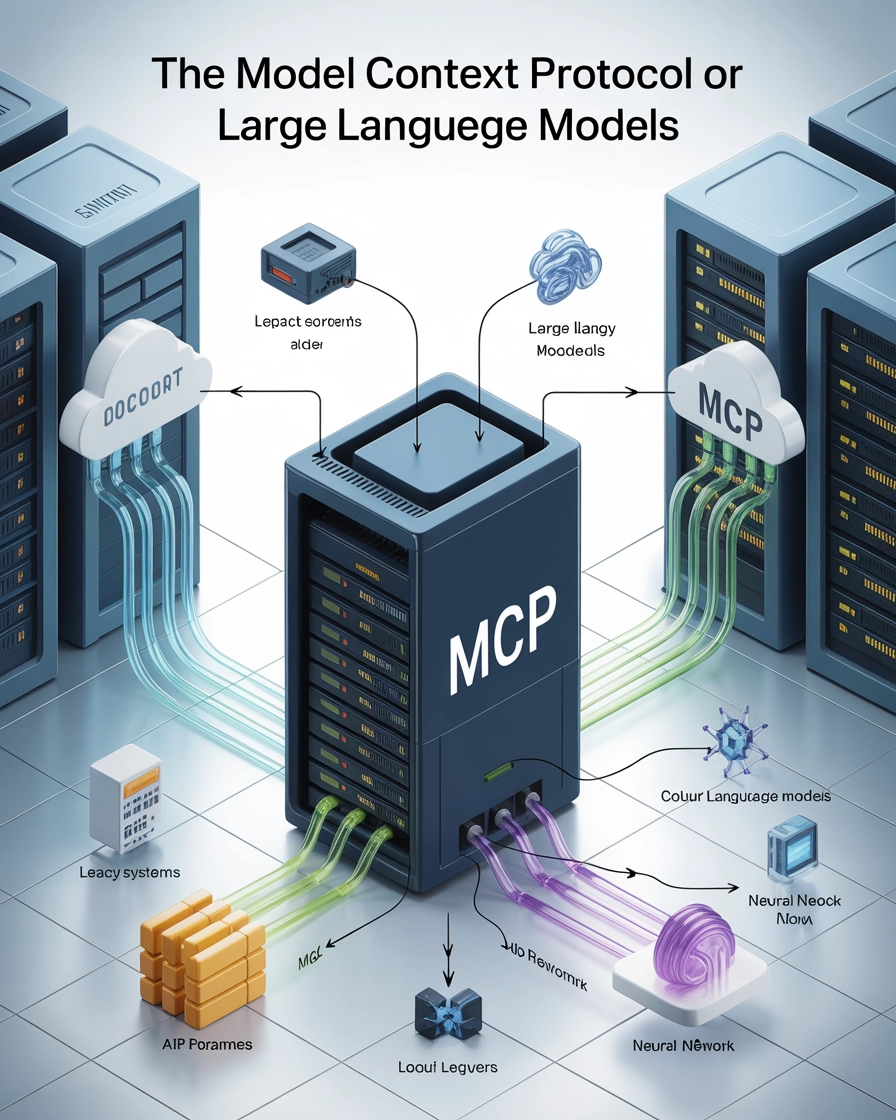

A IA agente está redefinindo o cenário da automação de fluxos de trabalho, capacitando sistemas a agir de forma autônoma, integrar recursos digitais diversos e entregar valor real muito além de prompts estáticos. Facilitando essa evolução está o Model Context Protocol (MCP)—um protocolo aberto para padronização de contexto em modelos de linguagem grandes (LLMs) que rapidamente se destaca como a pedra angular da integração escalável de IA.

Em sua essência, o Model Context Protocol (MCP) estabelece uma estrutura padronizada e open source para expor e consumir contexto, ferramentas externas e fontes de dados dentro de aplicações movidas por LLM. Isso representa um grande salto em relação aos modelos tradicionais de prompt-resposta, onde a interação se limita à troca de texto simples. Por outro lado, a IA agente exige a capacidade de invocar ferramentas, acessar dados em tempo real, chamar APIs e responder dinamicamente a informações em constante mudança—tudo isso viabilizado pelo MCP.

Por meio de um conjunto de endpoints RESTful bem definidos—aproveitando HTTP, Server-Sent Events e JSON RPC—o MCP permite que aplicações hospedeiras (clientes) descubram, descrevam e interajam com uma ampla variedade de recursos fornecidos por servidores. Isso significa que sistemas de IA podem identificar automaticamente ferramentas e dados disponíveis, recuperar descrições estruturadas e solicitar ações, tudo através de uma interface comum e componível.

O MCP costuma ser comparado ao USB-C para aplicações de IA, e com razão: ambos buscam proporcionar uma experiência universal “plug-and-play”. No entanto, enquanto o USB-C é um padrão físico de hardware para conectividade de dispositivos, o MCP é um protocolo de software projetado especificamente para o domínio digital. Sua inovação está em tornar ferramentas e recursos não apenas plugáveis, mas também descobríveis e acessíveis dinamicamente para qualquer sistema de IA agente compatível.

Diferente de integrações codificadas manualmente, o MCP permite aos desenvolvedores registrar novas ferramentas ou fontes de dados como servidores—tornando-os instantaneamente disponíveis para qualquer cliente compatível. Essa modularidade e flexibilidade possibilitam a rápida composição e reconfiguração da automação de fluxos de trabalho de IA, sem a necessidade de reescritas extensas ou integrações sob medida.

Imagine desenvolver um assistente de agendamento com IA agente. Tradicionalmente, você conectaria APIs de calendário, sistemas de reservas e dados internos de forma rígida—embutindo lógica complexa diretamente em sua aplicação. Com o MCP, todos esses recursos são expostos como endpoints descobríveis. O cliente de IA consulta o servidor MCP pelas capacidades disponíveis, apresenta contexto e solicitações ao LLM e, com base nas recomendações do modelo, recupera dados ou invoca ferramentas de forma transparente.

Por exemplo, se a IA precisa de uma lista de cafeterias próximas para agendar uma reunião, ela simplesmente consulta o servidor MCP, obtém resultados atualizados e os utiliza no próximo prompt. Descrições das ferramentas, parâmetros e esquemas de invocação são fornecidos de forma estruturada, permitindo ao LLM recomendar ações precisas que o cliente pode executar com total transparência e controle.

Essa arquitetura não só permite fluxos de trabalho de IA agente mais ricos, como também garante que recursos sejam facilmente compartilhados e atualizados entre equipes e organizações, fomentando um ecossistema vibrante de componentes de IA reutilizáveis.

A adoção do MCP está acelerando entre empresas inovadoras e profissionais de IA que buscam operacionalizar agentes inteligentes em escala. Sua base open source garante ampla acessibilidade, melhoria contínua e suporte comunitário robusto. Plataformas e fornecedores líderes—including os ecossistemas Kafka e Confluent—já estão construindo servidores compatíveis com MCP, expandindo instantaneamente o universo de fontes de dados e ferramentas de automação disponíveis para integração de IA agente.

Para decisores de IA, adotar o MCP significa desbloquear toda a agilidade, escalabilidade e componibilidade dos sistemas de IA—possibilitando desde automação interna até serviços sofisticados de IA para clientes, em uma espinha dorsal unificada e padronizada.

Ao adotar o Model Context Protocol, as organizações se posicionam na vanguarda da integração moderna de IA—equipando equipes para construir, adaptar e escalar soluções de IA agente com velocidade e eficácia incomparáveis. MCP é mais do que apenas um protocolo; é o portal para a próxima era da automação de fluxos de trabalho de IA.

Durante anos, o poder dos modelos de linguagem grandes (LLMs) foi limitado pela natureza estática de suas interações. No paradigma tradicional, um usuário insere um prompt e o LLM retorna uma resposta em texto. Embora isso funcione para consultas simples, baseadas em informações, limita fundamentalmente o que a IA pode alcançar em automação empresarial e integração de fluxos de trabalho.

Ferramentas tradicionais de LLM operam dentro de um quadro rígido de entrada e saída textual. Elas geram apenas saídas textuais, independentemente da sofisticação da solicitação. Isso significa:

Para ilustrar: Imagine pedir a um LLM tradicional, “Agende um café com o Pedro na próxima semana.” O modelo pode oferecer dicas de agendamento ou pedir esclarecimentos, mas não consegue verificar sua agenda, determinar a disponibilidade de Pedro, encontrar uma cafeteria ou criar um convite no calendário. Cada etapa permanece manual e cada contexto deve ser fornecido repetidamente.

Entra em cena a IA agente—a próxima evolução em automação inteligente. Modelos de IA agente não apenas respondem perguntas; eles tomam ações. Invocam ferramentas externas, acessam dados empresariais atualizados e automatizam fluxos de trabalho com múltiplas etapas.

Por que isso é necessário? Porque cenários reais de negócios são dinâmicos e exigem mais do que palavras. Por exemplo:

Em cada cenário, a abordagem antiga oferece conselhos ou soluções parciais, enquanto a IA agente entrega resultados acionáveis e integrados.

O Model Context Protocol (MCP) é a infraestrutura crítica que transforma ferramentas estáticas de LLM em potentes soluções de IA agente. MCP conecta modelos de linguagem ao mundo real—dados empresariais, APIs, arquivos e ferramentas de automação de fluxos de trabalho—permitindo integração de IA sem atritos.

Como o MCP resolve esses desafios?

Exemplo Prático:

O MCP é revolucionário para automação de fluxos de trabalho de IA nas empresas:

Resumindo, o MCP preenche a lacuna entre modelos baseados apenas em linguagem e integração real de IA. Ele capacita empresas a irem além de prompts estáticos e modelos de IA isolados, desbloqueando o verdadeiro potencial da IA agente para impulsionar eficiência, produtividade e automação em escala.

À medida que as empresas aceleram a adoção de IA agente, a demanda por integração de IA fluida e escalável entre os recursos organizacionais nunca foi tão alta. Os negócios modernos dependem de agentes de IA não só para gerar informações, mas para agir de forma significativa—invocando ferramentas, automatizando fluxos de trabalho e respondendo a eventos do mundo real. Alcançar isso no contexto empresarial exige uma abordagem robusta e padronizada, e é aí que entra o Model Context Protocol (MCP).

IA agente em nível empresarial exige muito mais do que integrações estáticas e codificadas. Agentes de IA devem acessar uma ampla variedade de recursos atualizados—de bancos de dados internos e sistemas de arquivos a APIs externas, plataformas de streaming como Kafka e ferramentas especializadas. A natureza estática das integrações convencionais—onde cada conexão com um recurso ou ferramenta é embutida diretamente na aplicação de IA—leva rapidamente a uma arquitetura frágil e monolítica. Essa abordagem não só é difícil de escalar, como também dificulta a inovação, já que cada novo recurso ou ferramenta exige código sob medida e manutenção.

Na prática, as empresas frequentemente precisam de agentes de IA que possam:

Esses requisitos evidenciam a inadequação de integrações monolíticas e codificadas, especialmente quando as organizações buscam escalar suas capacidades de IA agente entre equipes, departamentos e casos de uso.

Integrações codificadas prendem a lógica de negócio e a conectividade de recursos dentro de aplicações individuais de IA. Por exemplo, se uma empresa deseja que um agente de IA gerencie agendamentos de reuniões, o agente pode embutir diretamente código para APIs de calendário, pesquisas de localização e sistemas de reservas. Isso isola a lógica, tornando-a indisponível para outros agentes ou aplicações—criando silos, duplicando esforços e complicando a manutenção.

Tais designs monolíticos introduzem vários gargalos:

O Model Context Protocol (MCP) resolve esses desafios ao servir como um protocolo padronizado e plugável para conectar agentes de IA a recursos e ferramentas empresariais. Pense no MCP como a espinha dorsal que permite à IA descobrir, acessar e orquestrar ações de forma flexível em um ecossistema dinâmico de capacidades—sem codificação manual ou atualizações frequentes.

No centro, o MCP introduz uma arquitetura cliente-servidor clara:

A comunicação entre o agente (cliente) e o servidor de recursos ocorre via HTTP usando JSON-RPC, permitindo notificações assíncronas, descoberta de capacidades e acesso a recursos. O agente pode interrogar dinamicamente o servidor MCP sobre ferramentas, fontes de dados ou prompts disponíveis—tornando os recursos descobríveis e plugáveis.

Considere um agente de IA encarregado de agendar reuniões. Em vez de integrar diretamente APIs de calendário, locais e sistemas de reservas, o agente consulta o servidor MCP pelas capacidades disponíveis. O servidor descreve suas ferramentas (ex: integração de calendário, reservas) e expõe recursos (ex: lista de cafeterias próximas, salas de reunião disponíveis). O agente pode então selecionar e invocar dinamicamente as ferramentas adequadas com base na intenção do usuário—como, “Agende um café com Pedro na próxima semana.”

Com o MCP, se outra equipe quiser habilitar seu agente para reservar salas de conferência ou acessar recursos diferentes, basta registrar essas capacidades no servidor MCP. Não é necessário reescrever a lógica dos agentes ou duplicar esforços de integração. A arquitetura é inerentemente escalável, componível e descobrível.

Uma grande vantagem do MCP no contexto empresarial é sua componibilidade. Servidores podem atuar como clientes de outros servidores MCP—permitindo integrações modulares e em camadas. Por exemplo, um servidor MCP conectado a um tópico Kafka pode fornecer dados de eventos em tempo real para múltiplos agentes, sem que cada um precise de código Kafka específico. Esse design plugável suporta implantações em escala empresarial, onde recursos, ferramentas e integrações evoluem rapidamente.

Ao adotar o MCP, as empresas obtêm:

O MCP permite um futuro onde a IA empresarial não é limitada pela rigidez de integrações manuais, mas potencializada por uma arquitetura flexível, componível e escalável. Para organizações que buscam operacionalizar IA agente em escala, o MCP não é apenas uma opção técnica—é uma fundação essencial.

A integração moderna de IA está evoluindo rapidamente, exigindo arquiteturas flexíveis, escaláveis e que possibilitem interação fluida entre agentes de IA e ferramentas ou dados do mundo real. O Model Context Protocol (MCP) representa uma mudança de paradigma em IA agente, oferecendo uma arquitetura robusta e descobrível que vai além de simplesmente embutir recursos de IA em aplicativos desktop. Vamos explorar como a arquitetura MCP permite sistemas de IA agente plugáveis por meio de seu modelo cliente-servidor, comunicações versáteis e recursos de descobrimento poderosos.

No centro, o MCP utiliza uma arquitetura cliente-servidor clara que separa responsabilidades e maximiza a modularidade:

Essa separação significa que a aplicação hospedeira não precisa “embutir” todas as integrações ou lógica de ferramentas. Em vez disso, pode descobrir, consultar e utilizar recursos externos via servidores MCP, tornando o sistema altamente plugável e de fácil manutenção.

O MCP suporta dois modos principais de comunicação entre cliente e servidor:

Conexões Locais (Standard IO/Pipes):

Conexões Remotas (HTTP, Server Sent Events, JSON RPC):

Um destaque do MCP é seu descobrimento inerente, tornando a arquitetura de agentes de IA altamente dinâmica:

Esse mecanismo permite que aplicações hospedeiras suportem integrações ou fontes de dados novas sem mudanças no código—basta “plugar” novos servidores ou ferramentas.

Veja um fluxo simplificado representando a arquitetura MCP:

+-------------------------------+

| Aplicação Hospedeira |

| (executa Biblioteca Cliente MCP)|

+---------------+---------------+

|

| 1. Prompt do Usuário

v

+---------------+---------------+

| Cliente MCP |

+---------------+---------------+

|

| 2. Descobre Capacidades (HTTP/Local)

v

+-----------------------------------------------+

| Servidor MCP |

| (expõe endpoints RESTful, recursos, |

| ferramentas, prompts) |

+----------------+------------------------------+

|

+-------------+----------------+

| 3. Fornece: |

| - Lista de recursos/ferramentas|

| - Descrições/esquemas |

+------------------------------+

|

v

+-----------------------------------------------+

| Exemplo de Workflow: |

| - Cliente pergunta ao LLM: "Quais recursos/ferramentas?"|

| - LLM responde: "Use o recurso X, ferramenta Y" |

| - Cliente busca recurso X, invoca ferramenta Y |

| - Resultados retornados ao usuário |

+-----------------------------------------------+

Com o MCP, a integração de IA passa de conexões estáticas e codificadas para uma arquitetura de IA agente dinâmica, escalável e componível. Clientes podem descobrir e utilizar novas ferramentas ou fontes de dados em tempo de execução, e servidores podem ser empilhados ou compostos—trazendo verdadeira modularidade aos sistemas de agentes de IA. Essa arquitetura não é apenas para apps de hobby em desktop, mas está pronta para soluções profissionais e empresariais onde flexibilidade e extensibilidade são críticas.

Resumindo: A arquitetura MCP possibilita sistemas de IA verdadeiramente agentes—capazes de descobrir e invocar ferramentas, acessar dados atualizados ou proprietários e expandir suas capacidades dinamicamente, tudo por meio de um protocolo padronizado e robusto. Este é o portal para a próxima geração de IA agente plugável e profissional.

Vamos ser práticos e ver como a IA agente, potencializada pelo Model Context Protocol (MCP), transforma o agendamento do dia a dia—como marcar um café com um amigo—em um fluxo plugável e fluido. Esta seção mostra um caso de uso real, detalhando como um app hospedeiro, cliente MCP, servidor MCP e um LLM (Large Language Model) interagem para automatizar e orquestrar compromissos. Vamos destacar a componibilidade, plugabilidade e integração dinâmica que tornam o MCP um divisor de águas para a automação de fluxos de trabalho de IA.

Imagine que você quer criar um app para agendar encontros em cafeterias—seja com um colega, amigo ou alguém especial. Veja como a IA agente, usando o stack MCP, conduz o fluxo:

Tudo começa com uma aplicação hospedeira (pense em seu app ou serviço de agendamento). Este app integra a biblioteca cliente MCP, que serve de ponte entre sua aplicação e os recursos de IA agente.

O cliente MCP inicia o processo ao aceitar o prompt do usuário, por exemplo:

“Quero tomar um café com Pedro na próxima semana.”

Neste momento, o app precisa descobrir como interpretar e agir sobre o pedido. Precisa mais do que uma resposta textual—precisa de ação real.

Para saber quais ações são possíveis, o cliente MCP consulta o servidor MCP por uma lista de capacidades, ferramentas e recursos disponíveis (como APIs de calendário, listas de cafeterias locais ou sistemas de reservas). Tudo isso é descobrível por um endpoint RESTful bem definido, permitindo que novas ferramentas sejam plugadas sem modificar o app principal.

O cliente pode consultar um arquivo de configuração com URLs de servidores registrados para saber onde buscar.

O cliente MCP então envia o prompt do usuário, junto com a lista de recursos disponíveis, para o LLM. O LLM ajuda a decidir quais recursos são relevantes:

Seguindo a recomendação do LLM, o cliente MCP busca o recurso solicitado (ex: lista de cafeterias locais) no servidor MCP. Esses dados de recurso são, então, anexados ao próximo prompt para o LLM, fornecendo o contexto necessário para recomendar ações.

O LLM, agora equipado com a intenção do usuário e dados atualizados, retorna uma recomendação como:

Descrições e esquemas de cada ferramenta são fornecidos ao LLM como dados estruturados (não apenas texto), possibilitando recomendações de invocação de ferramentas e parâmetros específicos.

O cliente MCP pega as recomendações do LLM e aciona as invocações de ferramentas necessárias:

O app hospedeiro, graças à arquitetura do MCP, pode plugar ou trocar ferramentas e recursos conforme necessário—sem reescrever a lógica central.

Veja um diagrama passo a passo do workflow de agendamento MCP com IA agente:

flowchart TD

A[Solicitação do Usuário: "Café com Pedro na próxima semana"] --> B[App Hospedeiro (com Cliente MCP)]

B --> C{Descobre Capacidades}

C --> D[Servidor MCP: Retorna lista de recursos/ferramentas]

D --> E[LLM: "Quais recursos preciso?"]

E --> F[LLM: "Buscar diretório de cafeterias"]

F --> G[Cliente MCP: Busca recurso no Servidor MCP]

G --> H[LLM: Recebe prompt + dados de recurso]

H --> I[LLM: Recomenda invocação de ferramenta]

I --> J[Cliente MCP: Executa ferramentas de calendário e reserva]

J --> K[Compromisso Agendado!]

Componibilidade:

Você pode criar fluxos de trabalho complexos combinando ferramentas e recursos independentes. Seu servidor MCP pode até atuar como cliente de outros servidores, encadeando capacidades e tornando o sistema altamente modular.

Plugabilidade:

Precisa adicionar uma nova ferramenta (como buscador de restaurantes ou outro calendário)? Basta registrá-la no servidor MCP—sem precisar refatorar o app.

Integração Dinâmica:

Em tempo de execução, o sistema descobre e orquestra dinamicamente os componentes necessários conforme a intenção do usuário e os recursos disponíveis. O LLM lida com a lógica, mantendo seu app sustentável e preparado para o futuro.

Com MCP, a IA agente vai além de assistentes de chat estáticos. Você tem um motor de workflow vivo que se integra ativamente a dados e ferramentas empresariais. Agendar café, marcar reuniões ou orquestrar automações complexas—tudo se torna plugável, componível e escalável.

Resumindo: O MCP permite que você construa aplicações de IA agente como um profissional, tornando a automação de fluxos de trabalho com IA prática, modular e pronta para a empresa.

Pronto para experimentar? Aprofunde-se na documentação oficial do Model Context Protocol e comece a construir workflows agentes e inteligentes hoje mesmo.

O Model Context Protocol (MCP) está revolucionando a abordagem profissional para integração de IA, especialmente na construção de IA agente e automação de fluxos de trabalho com ferramentas LLM. Seja desenvolvendo agentes sofisticados ou otimizando operações empresariais, o MCP oferece um conjunto de recursos poderosos—plugabilidade, descobrimento, componibilidade, segurança e flexibilidade de fornecedores—que tornam a automação de fluxos de trabalho com IA fluida e à prova de futuro.

Prompt do Usuário: “Quero tomar um café com Pedro na próxima semana.”

Workflow AI Passo a Passo:

- Agente (Aplicação Hospedeira): Consulta o servidor MCP por recursos disponíveis (ex: API de calendário, localizador de cafeterias).

- Agente pergunta ao LLM: Determina quais ferramentas são necessárias.

- LLM Responde: Identifica recursos como lista de cafeterias e agendador de compromissos.

- Agente Invoca: Busca dados e agenda a reunião—sem código personalizado, apenas integração plug-and-play.

Resumindo:

O Model Context Protocol entrega verdadeira extensibilidade plug-and-play, descobrimento, segurança e flexibilidade de fornecedores para IA agente e automação de fluxos de trabalho com LLM. Ao adotar o MCP, sua equipe acelera a integração de IA, aumenta a segurança e mantém a agilidade em um ecossistema em rápida evolução—permitindo construir e escalar soluções de IA mais inteligentes e adaptáveis.

Pronto para elevar seus workflows de IA? Adote o MCP e desbloqueie integração de IA fluida, segura e escalável para sua empresa!

O Model Context Protocol (MCP) está revolucionando a IA empresarial ao permitir que sistemas de IA agente avancem de integrações frágeis e sob medida para ecossistemas robustos e escaláveis. Hoje, empresas líderes e ferramentas inovadoras de desenvolvimento estão adotando o MCP para impulsionar estratégias de integração de IA de próxima geração, proporcionando melhorias tangíveis em produtividade e manutenção.

No cenário de IA empresarial, o MCP está sendo adotado por pioneiros, incluindo:

O Model Context Protocol (MCP) é um protocolo aberto projetado para padronizar o acesso a contexto e ferramentas em aplicações de IA agente, permitindo a integração dinâmica de agentes de IA com diversos recursos e fluxos de trabalho.

O MCP permite que agentes de IA descubram, acessem e invoquem ferramentas externas, APIs e fontes de dados de forma dinâmica, transformando interações estáticas com LLMs em fluxos de trabalho escaláveis e acionáveis que automatizam tarefas e integram-se perfeitamente com sistemas empresariais.

O uso do MCP para integração de IA oferece benefícios como descoberta dinâmica de recursos, arquitetura modular, redução de duplicidade de esforços e a capacidade de escalar fluxos de trabalho de IA entre equipes e aplicações sem codificação fixa de integrações.

Você pode começar com MCP e IA agente explorando a plataforma Flowhunt, que oferece ferramentas para construir, adaptar e escalar soluções de IA agente usando o Model Context Protocol. Cadastre-se para uma conta gratuita e comece a integrar fluxos de trabalho de IA em suas aplicações.

Viktor Zeman é co-proprietário da QualityUnit. Mesmo após 20 anos liderando a empresa, ele continua sendo principalmente um engenheiro de software, especializado em IA, SEO programático e desenvolvimento backend. Ele contribuiu para inúmeros projetos, incluindo LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab e muitos outros.

Desbloqueie o poder da IA agente com a integração do Model Context Protocol do Flowhunt. Construa fluxos de trabalho de IA dinâmicos e escaláveis que acessam diversos recursos e automatizam tarefas de forma fluida.

O Protocolo de Contexto de Modelo (MCP) é uma interface aberta e padronizada que permite que Modelos de Linguagem de Grande Porte (LLMs) acessem de forma segura...

Exemplo rápido de como desenvolver seu próprio Servidor MCP com Python.

Explore exemplos abrangentes de servidores MCP e aprenda como construir, implantar e integrar servidores Model Context Protocol para aprimorar as capacidades de...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.