Exfiltração de Dados (Contexto de IA)

Na segurança de IA, exfiltração de dados refere-se a ataques onde dados sensíveis acessíveis por um chatbot de IA — PII, credenciais, inteligência de negócios, ...

Automação de IA

Um guia abrangente para integrar plataformas de IA ao seu banco de dados com segurança, utilizando gateways de API, criptografia, controles de acesso e estratégias de monitoramento.

Principais práticas de segurança para expor bancos de dados à IA:

Expor um banco de dados de forma segura significa permitir que sistemas de IA acessem os dados necessários, mantendo controles rígidos sobre quais dados são acessados, quem (ou o que) está acessando, quando ocorre o acesso e como esse acesso é monitorado e registrado. Isso é fundamentalmente diferente de simplesmente abrir seu banco de dados para a internet ou fornecer credenciais diretas de banco para plataformas de IA.

Quando falamos em expor um banco de dados para plataformas de IA, estamos descrevendo uma decisão arquitetural deliberada de criar uma interface controlada entre seus dados e sistemas externos de IA. Essa interface atua como um ponto de verificação de segurança, aplicando autenticação, autorização, criptografia e registro de auditoria em todas as etapas. O objetivo é criar o que profissionais de segurança chamam de “ponto único de estrangulamento”: um local centralizado onde todo acesso pode ser monitorado, controlado e validado.

O desafio é que plataformas de IA muitas vezes requerem amplo acesso a conjuntos de dados diversos para funcionar de forma eficaz. Um modelo de aprendizado de máquina pode precisar analisar padrões de comportamento de clientes, históricos de transações e informações de produtos simultaneamente. Um sistema de IA generativa pode precisar pesquisar em várias tabelas para responder perguntas complexas. Conceder esse acesso sem as proteções adequadas pode expor sua organização a vazamentos de dados, violações de conformidade e ameaças internas.

O argumento de negócio para expor bancos de dados com segurança à IA é claro. Organizações que integram com sucesso a IA à sua infraestrutura de dados obtêm vantagens competitivas significativas: decisões mais rápidas, insights automatizados, melhores experiências para o cliente e eficiência operacional. Porém, os riscos são igualmente significativos.

Vazamentos de dados envolvendo bancos de dados expostos têm se tornado cada vez mais comuns e custosos. O custo médio de uma violação de dados em 2024 ultrapassou US$ 4,45 milhões, com incidentes relacionados a bancos de dados respondendo por uma parcela significativa dessas perdas. Quando a violação envolve dados pessoais sujeitos a regulamentações como GDPR ou CCPA, o dano financeiro e reputacional multiplica-se dramaticamente. Além dos custos diretos, as organizações enfrentam interrupção operacional, perda de confiança do cliente e possíveis responsabilidades legais.

O desafio se intensifica quando sistemas de IA estão envolvidos. Modelos de IA podem memorizar inadvertidamente dados sensíveis de treinamento, tornando-os recuperáveis por meio de ataques de injeção de prompts ou técnicas de extração de modelo. Agentes de IA com acesso ao banco de dados podem ser manipulados por prompts cuidadosamente elaborados para executar consultas indesejadas ou expor informações confidenciais. Esses vetores de ataque inovadores exigem abordagens de segurança que vão além da proteção tradicional de bancos de dados.

Além disso, a fiscalização regulatória sobre IA está aumentando rapidamente. Autoridades de proteção de dados ao redor do mundo estão emitindo orientações sobre como as organizações devem tratar dados pessoais ao utilizar sistemas de IA. Conformidade com GDPR, CCPA, HIPAA e regulamentações emergentes exige a demonstração de que salvaguardas apropriadas estão em vigor antes de expor qualquer dado a plataformas de IA.

Antes de implementar qualquer estratégia para expor seu banco de dados a plataformas de IA, você precisa de uma compreensão clara de sua infraestrutura de segurança e do cenário de dados atual. Esta avaliação deve responder a várias perguntas críticas:

Que dados você realmente possui? Realize um inventário e classificação abrangente dos dados. Classifique seus dados por nível de sensibilidade: público, interno, confidencial e restrito. Identifique quais dados contêm informações de identificação pessoal (PII), informações de cartão de pagamento (PCI), informações protegidas de saúde (PHI) ou outros dados regulados. Essa classificação será a base para todas as decisões subsequentes de controle de acesso.

Quais são seus controles de segurança atuais? Documente as medidas de segurança já implementadas: mecanismos de autenticação, status da criptografia (em trânsito e em repouso), segmentação de rede, procedimentos de backup e recuperação, e capacidades de registro de auditoria. Identifique lacunas onde controles estão ausentes ou desatualizados.

Quais obrigações de conformidade você possui? Revise os regulamentos aplicáveis à sua indústria e localização. Se você lida com dados pessoais, a conformidade com o GDPR provavelmente é obrigatória. Se está no setor de saúde, os requisitos do HIPAA se aplicam. Organizações financeiras devem considerar o PCI-DSS. Compreender essas obrigações molda sua arquitetura de segurança.

Qual é sua tolerância ao risco? Organizações diferentes têm diferentes apetites ao risco. Um provedor de saúde que lida com dados de pacientes tem tolerância muito menor que uma empresa SaaS analisando métricas anonimizadas. Sua tolerância ao risco deve orientar o quão restritivos precisam ser seus controles de acesso.

A decisão arquitetural mais crítica que você fará é nunca expor seu banco de dados diretamente para plataformas de IA. Em vez disso, implemente um gateway de API seguro entre seu banco de dados e sistemas externos. Este gateway se torna o ponto único de controle para todo acesso ao banco.

Um gateway de API desempenha múltiplas funções essenciais. Primeiro, fornece uma camada de abstração que desacopla a plataforma de IA do esquema do seu banco. Se a estrutura do banco de dados mudar, basta atualizar a API, sem renegociar o acesso com cada plataforma de IA. Segundo, permite implementar políticas de segurança consistentes para todas as requisições. Terceiro, cria um local centralizado para monitoramento, registro e alerta de atividades suspeitas.

Ao escolher ou construir um gateway de API, busque soluções que suportem proxy consciente de identidade (IAP). Um gateway IAP autentica cada requisição antes que ela chegue ao banco, garantindo que apenas sistemas autorizados acessem os dados. Ele deve suportar múltiplos métodos de autenticação, incluindo OAuth 2.0, tokens JWT, mTLS e chaves de API. O gateway também deve impor limitação de taxa para evitar abusos e validar requisições para bloquear consultas malformadas ou suspeitas.

Opções populares incluem soluções nativas em nuvem como AWS API Gateway com integração IAM, Identity-Aware Proxy do Google Cloud, Azure API Management ou soluções especializadas como Hoop ou DreamFactory. Todas compartilham o princípio de criar uma camada de acesso controlado.

Com o gateway de API em funcionamento, a próxima camada crítica é implementar mecanismos robustos de autenticação e autorização. Esses dois conceitos são frequentemente confundidos, mas têm propósitos distintos: autenticação verifica quem (ou o que) está fazendo o pedido, enquanto autorização determina o que essa entidade pode fazer.

Para usuários humanos acessando sistemas de IA que interagem com seu banco, implemente autenticação multifator (MFA). Normalmente, combina algo que você sabe (senha), algo que você possui (celular ou token físico) e algo que você é (biometria). MFA reduz consideravelmente o risco de comprometimento de contas, porta de entrada para muitas violações.

Para sistemas de IA e principais de serviço, use credenciais fortes com rotação automática. Nunca armazene credenciais do banco em código-fonte ou arquivos de configuração. Utilize variáveis de ambiente, sistemas de gerenciamento de segredos (como HashiCorp Vault, AWS Secrets Manager ou Azure Key Vault) ou sistemas nativos de nuvem que rotacionam credenciais periodicamente.

Implemente autenticação baseada em certificados quando possível. A autenticação mTLS, em que cliente e servidor se autenticam mutuamente com certificados digitais, oferece segurança mais forte que autenticação por senha. Cada plataforma ou serviço de IA recebe um certificado exclusivo que deve ser apresentado para acessar o gateway de API.

O controle de acesso baseado em função (RBAC) é o modelo mais comum. Você define funções (como “AI_Analytics_Reader” ou “ML_Training_Agent”) e atribui permissões a essas funções. Cada sistema de IA recebe uma ou mais funções e só pode executar ações permitidas por elas. O RBAC é direto de implementar e entender, sendo ideal para a maioria das organizações.

O controle de acesso baseado em atributos (ABAC) é mais sofisticado e flexível. Em vez de atribuir funções, você define políticas baseadas em atributos da requisição: departamento do usuário, nível de classificação dos dados, horário do acesso, localização geográfica, propósito do acesso, entre outros. O ABAC permite controle mais granular, mas exige desenho cuidadoso das políticas.

Implemente o princípio do menor privilégio: conceda a cada sistema de IA apenas as permissões mínimas necessárias. Se um sistema só precisa ler nomes e e-mails de clientes, não conceda acesso a informações de pagamento ou números de seguridade social. Se só precisa ler dados, não conceda permissões de escrita ou exclusão.

Mesmo com autenticação e autorização fortes, é preciso proteger os próprios dados. Isso envolve duas estratégias complementares: criptografia e mascaramento de dados.

A criptografia em trânsito protege os dados enquanto trafegam entre seu banco e a plataforma de IA. Utilize TLS 1.2 ou superior para todas as conexões. Assim, mesmo que o tráfego seja interceptado, os dados permanecem ilegíveis sem as chaves. Gateways de API e bancos modernos já suportam TLS por padrão, mas verifique se está habilitado e configurado corretamente.

A criptografia em repouso protege os dados armazenados no banco. Mesmo que um invasor acesse arquivos do banco ou backups, não poderá ler os dados sem as chaves. Bancos modernos suportam criptografia transparente (TDE) ou recursos semelhantes. Habilite essa função e gerencie as chaves de maneira segura.

A gestão de chaves é crítica. Nunca armazene chaves de criptografia no mesmo local dos dados. Use um serviço dedicado (KMS) que controle o acesso às chaves separadamente do banco. Rode chaves regularmente — ao menos anualmente, e com maior frequência para dados altamente sensíveis. Implemente versionamento de chaves para manter antigas disponíveis para dados históricos.

O mascaramento de dados substitui valores sensíveis por valores ofuscados ou sintéticos. Por exemplo, um CPF pode ser mascarado como “..123-45”, mostrando apenas os últimos dígitos. Um cartão de crédito pode ser mascarado como “--****-4567”. Assim, sistemas de IA trabalham com dados estruturados sem acessar valores reais.

O mascaramento dinâmico aplica regras de mascaramento no momento da consulta, conforme o papel do usuário e a sensibilidade dos dados. Um atendente pode ver nomes e telefones completos, enquanto um sistema de IA analítico vê apenas versões mascaradas. Essa abordagem é mais flexível que o mascaramento estático, pois permite regras diferentes para cada usuário.

Implemente mascaramento em nível de coluna para os dados mais sensíveis. Identifique colunas com PII, informações de pagamento, dados de saúde ou outros dados regulados, e aplique regras de mascaramento. Muitos bancos suportam isso nativamente, ou você pode implementar na camada do gateway de API.

Veja como o RBAC funciona na prática. Imagine um banco com dados de clientes, histórico de transações e informações de produtos. Você quer expor esse banco para três sistemas de IA: um motor de recomendação, um sistema de detecção de fraudes e uma plataforma de análise de clientes.

| Sistema de IA | Acesso Necessário | Papel Recomendado | Permissões Específicas |

|---|---|---|---|

| Motor de Recomendação | Perfis de clientes, histórico de compras | AI_RECOMMENDATIONS_READER | SELECT em clientes, pedidos, produtos; sem acesso a métodos de pagamento ou contato pessoal |

| Sistema de Fraudes | Detalhes das transações, histórico de clientes | AI_FRAUD_DETECTOR | SELECT em transações, clientes, contas; acesso a informações de pagamento mas não a contatos de clientes |

| Plataforma Analítica | Dados agregados de clientes | AI_ANALYTICS_READER | SELECT apenas em visualizações agregadas; sem acesso a registros individuais de clientes ou transações |

Cada papel tem permissões que limitam o acesso e as operações possíveis. O motor de recomendação não vê informações de pagamento porque não precisa. O sistema de fraudes vê transações, mas não e-mails de clientes. A plataforma analítica só vê dados agregados, não registros individuais.

Assim, se um sistema de IA for comprometido, o acesso do invasor se limita apenas aos dados necessários para aquele sistema. O impacto de um incidente é minimizado.

Mesmo com controles preventivos fortes, é necessário detectar e responder a incidentes. Isso exige monitoramento abrangente, auditoria detalhada e detecção automática de ameaças.

Habilite logs detalhados para todo acesso ao banco. Cada consulta executada por sistemas de IA deve ser registrada, incluindo:

Armazene logs de auditoria em local seguro e imutável, separado do banco principal. Provedores em nuvem oferecem serviços gerenciados de logging (como AWS CloudTrail, Google Cloud Logging ou Azure Monitor). Mantenha logs por pelo menos um ano, e mais para dados sensíveis.

Implemente monitoramento em tempo real para detectar padrões suspeitos de acesso. Configure alertas para:

Ferramentas modernas conseguem identificar anomalias automaticamente. Ferramentas como Imperva, Satori e outras usam IA para detectar padrões de acesso e alertar sobre desvios.

Desenvolva um plano de resposta específico para incidentes de segurança envolvendo IA. Ele deve incluir:

Para grandes volumes de dados, considere segmentar para reduzir exposição. Isso pode incluir:

Segmentação de Rede: Coloque o banco em um segmento de rede restrito. Apenas o gateway de API acessa o banco diretamente. Plataformas de IA acessam apenas via gateway.

Segmentação de Bancos: Separe dados sensíveis e não sensíveis em bancos diferentes. Assim, sistemas de IA sem necessidade de dados sensíveis acessam apenas o banco correspondente.

Sharding de Dados: Para grandes volumes, divida os dados em partes (shards) por critério (ID do cliente, região, etc). Conceda acesso apenas aos shards necessários.

Dados Sintéticos: Para desenvolvimento e testes, use dados sintéticos que imitam a estrutura real mas sem informações sensíveis. Assim, modelos de IA podem ser treinados/testados sem expor dados reais.

Expor bancos de dados para IA traz implicações regulatórias sérias. Diferentes normas impõem exigências distintas:

GDPR (Regulamento Geral de Proteção de Dados): Se você processa dados de residentes da UE, o GDPR se aplica. Exige:

CCPA (Lei de Privacidade do Consumidor da Califórnia): Para dados de residentes da Califórnia. Exige:

HIPAA (Lei de Portabilidade e Responsabilidade de Seguro de Saúde): Para dados de saúde protegidos. Exige:

Normas Específicas de Indústria: PCI-DSS (cartões), SOC 2 (serviços), ISO 27001 (gestão de segurança), NIST (infraestrutura crítica).

Antes de expor dados à IA, faça avaliação de conformidade para entender quais normas se aplicam e quais exigências específicas elas impõem.

Gerenciar acesso seguro a bancos de dados para IA envolve coordenação de sistemas e políticas consistentes. Plataformas como o FlowHunt tornam isso muito mais simples.

O FlowHunt permite construir fluxos automatizados que integram sistemas de IA ao banco de dados com segurança. Em vez de gerenciar chaves, monitorar acessos e coordenar equipes manualmente, a plataforma oferece:

Orquestração de Fluxos: Defina fluxos complexos que envolvem consultas a bancos, processamento de IA e transformação de dados. O FlowHunt orquestra cada etapa com segurança e na ordem correta.

Integração de Controle de Acesso: Integra-se aos sistemas de identidade e acesso, aplicando RBAC e o princípio do menor privilégio automaticamente.

Auditoria e Conformidade: Mantém logs completos de todas as execuções, detalhando quem acessou o quê e quando, suportando conformidade com GDPR, CCPA, HIPAA e outros.

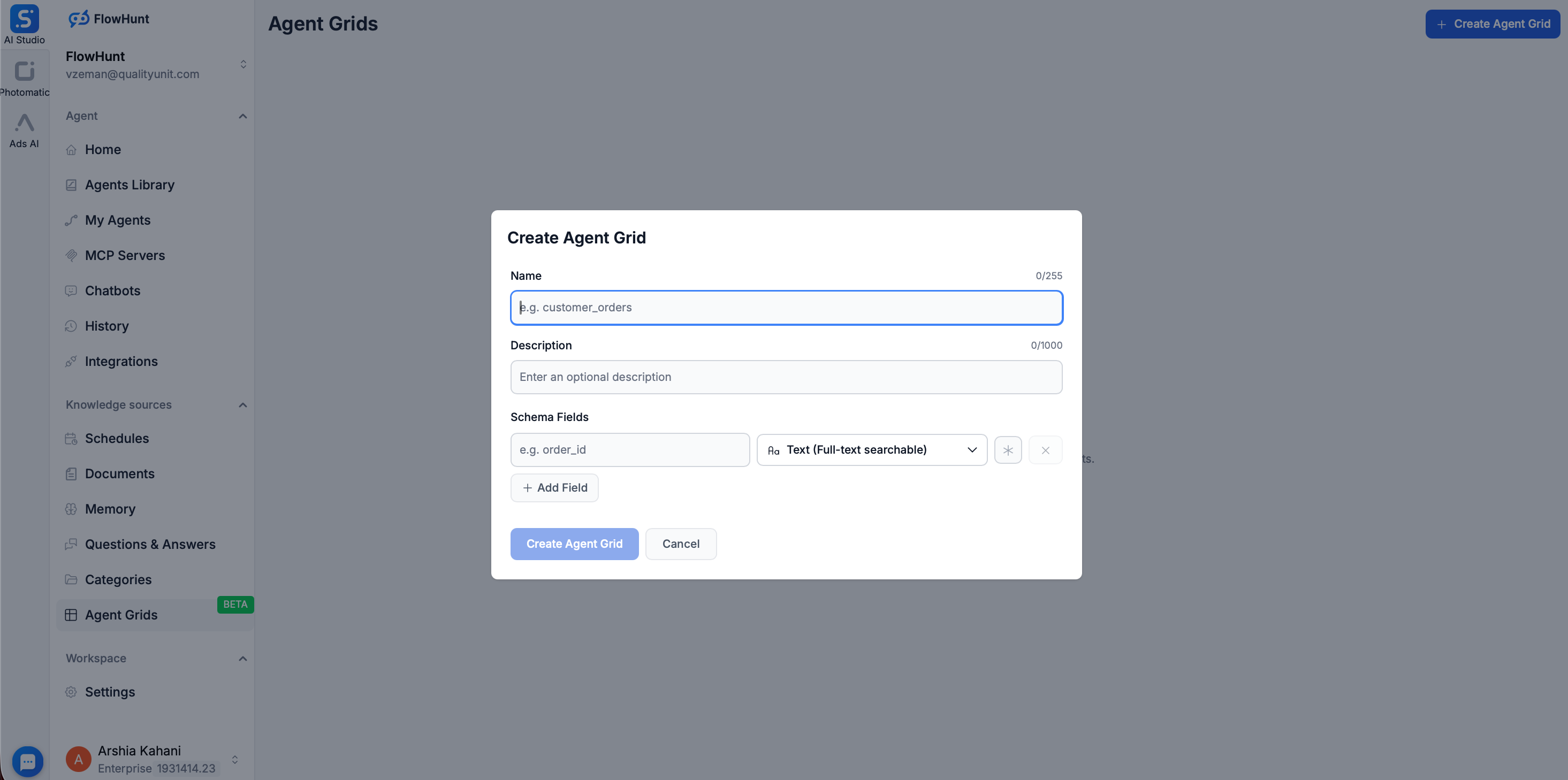

Para quem busca um nível extra de isolamento entre modelos de IA e bancos de produção, o FlowHunt oferece o recurso Grid. Ele permite criar um banco pesquisável apenas fazendo upload de arquivos estruturados (CSVs, por exemplo).

Após o upload do CSV, o FlowHunt usa Elasticsearch para indexar os dados, transformando um arquivo estático em uma fonte dinâmica e rápida de conhecimento. Vantagens:

Com Grid e automação do FlowHunt, você reduz a complexidade dos controles de segurança e garante enforcement consistente das políticas.

Expor bancos de dados com segurança para IA é um processo em múltiplas etapas. Veja um roteiro prático:

Passo 1: Avalie o Estado Atual

Passo 2: Desenhe a Arquitetura

Passo 3: Implemente Controles Centrais

Passo 4: Proteja os Dados

Passo 5: Implemente Monitoramento e Auditoria

Passo 6: Teste e Valide

Passo 7: Operacionalize e Mantenha

Ao implementar a exposição segura de bancos de dados, evite estes erros:

Exposição Direta do Banco: Nunca exponha o banco diretamente à internet ou à IA sem gateway. É o maior risco de segurança.

Permissões Amplas Demais: Conceder mais permissões do que o necessário viola o princípio do menor privilégio. Comece mínimo e só amplie se necessário.

Criptografia Inadequada: Criptografar só em trânsito ou só em repouso deixa brechas. Implemente nos dois.

Gestão Fraca de Credenciais: Guardar credenciais no código, versionamento ou não rotacionar expõe ao risco.

Monitoramento Insuficiente: Bons controles sem monitoramento não avisam se forem burlados.

Ignorar Conformidade: Não considerar normas só depois de uma violação é caro. Planeje desde o início.

Testes Inadequados: Controles sem testes podem falhar quando mais precisa.

Com sistemas de IA mais sofisticados, surgem novos vetores de ataque. Dois riscos importantes:

Injeção de Prompt: O atacante cria prompts para forçar a IA a executar ações indesejadas, como ignorar controles de acesso. Para se defender:

Extração de Modelo: O atacante interage com o modelo para extrair dados de treinamento ou estrutura interna. Para mitigar:

Expor bancos de dados para IA de forma segura não só é possível, como cada vez mais necessário para organizações que desejam aproveitar o potencial da IA sem comprometer seu ativo mais valioso. O segredo está em uma abordagem em camadas: autenticação e autorização fortes, criptografia, mascaramento de dados, monitoramento abrangente e testes regulares.

Comece pelo básico: nunca exponha o banco diretamente, use sempre gateway de API, implemente autenticação e autorização robustas e criptografe seus dados. Depois, adicione mascaramento, monitoramento e controles de conformidade conforme o perfil de risco e as exigências regulatórias da sua organização.

Lembre-se: segurança não é uma implementação pontual, mas um processo contínuo. Revise controles periodicamente, teste vulnerabilidades, monitore ameaças e adapte-se a novos riscos. Ao tratar a segurança do banco como prioridade constante, você desbloqueia o valor da IA protegendo dados e reputação da sua organização.

Veja como o FlowHunt automatiza seus fluxos de conteúdo e SEO com IA — da pesquisa à geração de conteúdo, publicação e análise — tudo em um só lugar.

Arshia é Engenheira de Fluxos de Trabalho de IA na FlowHunt. Com formação em ciência da computação e paixão por IA, ela se especializa em criar fluxos de trabalho eficientes que integram ferramentas de IA em tarefas do dia a dia, aumentando a produtividade e a criatividade.

Otimize seus fluxos de dados com IA mantendo padrões de segurança e conformidade de nível empresarial.

Na segurança de IA, exfiltração de dados refere-se a ataques onde dados sensíveis acessíveis por um chatbot de IA — PII, credenciais, inteligência de negócios, ...

Descubra a abrangente política de segurança da FlowHunt, cobrindo práticas de infraestrutura, organizacionais, de produto e privacidade de dados para garantir o...

Chatbots de IA com acesso a dados sensíveis são alvos principais de exfiltração de dados. Aprenda como atacantes extraem PII, credenciais e inteligência de negó...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.