O que significa GPT no ChatGPT? Um guia completo sobre 'chat gpbt'

Este artigo abrangente explica o que significa 'GPT' no ChatGPT, como a tecnologia funciona, sua evolução e responde perguntas comuns sobre 'chat gpbt' para usu...

Descubra o que é o chatbot de IA GPT, como funciona e por que o ChatGPT é a principal solução de IA generativa. Conheça a arquitetura Transformer, métodos de treinamento e aplicações no mundo real.

O chatbot de IA GPT (Generative Pre-trained Transformer) é um avançado sistema de IA conversacional desenvolvido pela OpenAI que utiliza processamento de linguagem natural e aprendizado profundo para gerar respostas em texto semelhantes às humanas. O ChatGPT, o chatbot baseado em GPT mais popular, consegue entender contexto, responder perguntas, criar conteúdo, escrever código e executar tarefas complexas por meio de geração dinâmica de texto, em vez de respostas pré-programadas.

Chatbots de Inteligência Artificial impulsionados pela tecnologia GPT representam um dos maiores avanços no processamento de linguagem natural e aprendizado de máquina. GPT significa “Generative Pre-trained Transformer”, um nome que resume os três componentes centrais dessa tecnologia revolucionária. O termo “generativo” refere-se à capacidade do sistema de criar textos novos e originais, em vez de simplesmente recuperar respostas pré-escritas de um banco de dados. “Pré-treinado” indica que o modelo foi extensivamente treinado em grandes conjuntos de dados antes de ser aplicado em tarefas específicas. “Transformer” descreve a arquitetura de rede neural subjacente que permite ao sistema processar e compreender a linguagem com sofisticação e precisão inéditas.

O ChatGPT, desenvolvido pela OpenAI e lançado em novembro de 2022, tornou-se a implementação mais reconhecida da tecnologia GPT. Diferente de chatbots tradicionais que dependem de sistemas rígidos baseados em regras ou simples correspondência de padrões, o ChatGPT utiliza aprendizado profundo para compreender as nuances da linguagem humana, manter o contexto durante conversas e gerar respostas naturais e apropriadas ao contexto. O sistema é capaz de dialogar, responder a perguntas complexas, compor diversos tipos de conteúdo escrito, depurar códigos e auxiliar em tarefas criativas — tudo isso sem ser explicitamente programado para cada situação específica. Essa versatilidade se deve à arquitetura transformer, que processa sequências inteiras de texto simultaneamente, em vez de palavra por palavra, permitindo capturar relações e dependências complexas dentro da linguagem.

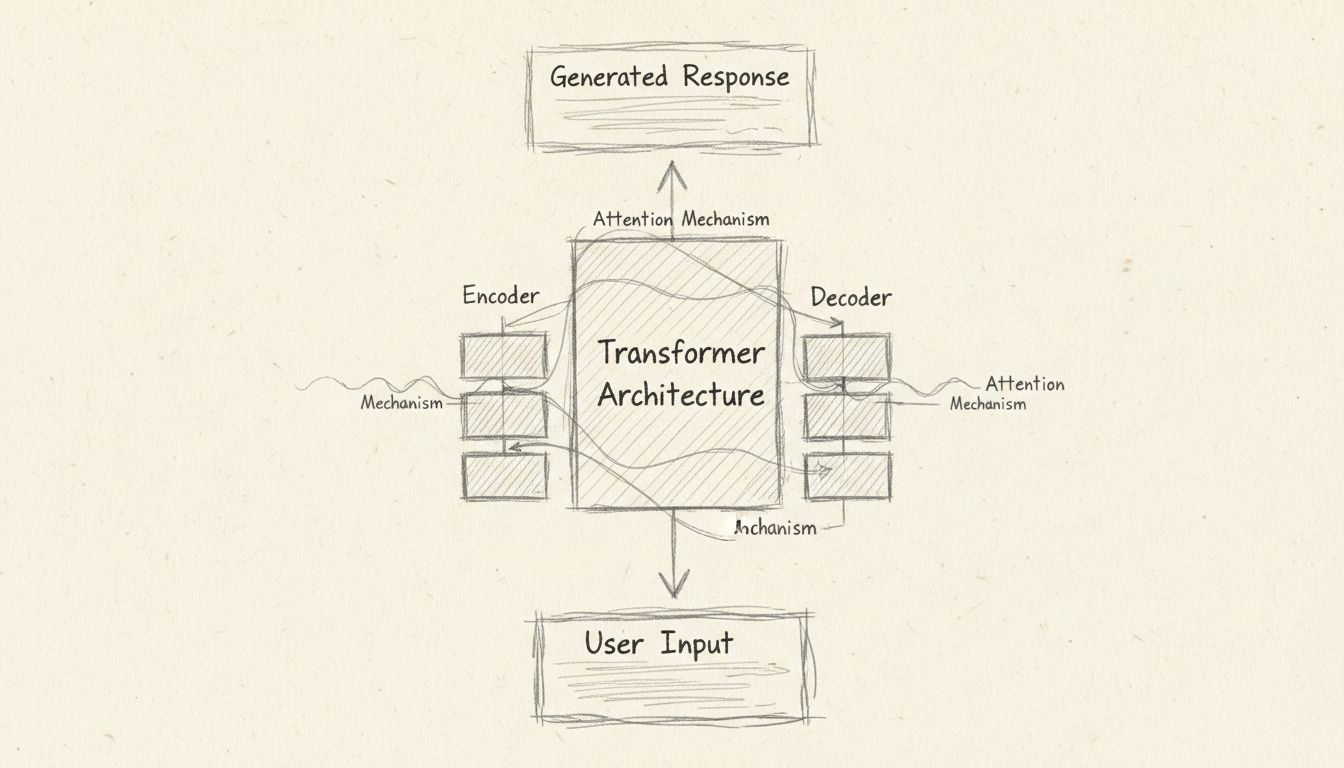

A arquitetura transformer representa uma mudança fundamental na forma como sistemas de inteligência artificial processam linguagem. No seu núcleo, o transformer utiliza um mecanismo chamado “autoatenção” para determinar quais partes do texto de entrada são mais relevantes na geração de cada palavra da saída. Isso é fundamentalmente diferente de abordagens anteriores, como redes neurais recorrentes, que processavam o texto de forma sequencial e tinham dificuldade em manter o contexto em passagens longas. A capacidade de processamento paralelo do transformer o torna significativamente mais rápido e eficiente, enquanto seus mecanismos de atenção permitem compreender relações complexas entre palavras, mesmo que estejam distantes em uma frase.

A arquitetura transformer é composta por dois componentes principais: o codificador (encoder) e o decodificador (decoder). O codificador processa o texto de entrada e o converte em representações matemáticas chamadas embeddings. Esses embeddings são vetores em um espaço de alta dimensão onde palavras com significados semelhantes ficam próximas umas das outras. O codificador atribui pesos a cada palavra, indicando sua relevância e importância no contexto de toda a entrada. Codificadores de posição também são aplicados para evitar ambiguidades — por exemplo, ajudam o sistema a entender que “Um cachorro persegue um gato” tem significado diferente de “Um gato persegue um cachorro”, mesmo com as mesmas palavras em ambas as frases. O decodificador então utiliza essas representações codificadas para gerar o texto de saída, palavra por palavra, usando os mesmos mecanismos de autoatenção para focar nas partes mais relevantes da entrada ao decidir o que gerar em seguida.

| Componente | Função | Benefício Principal |

|---|---|---|

| Codificador | Processa o texto de entrada e cria embeddings | Captura significado semântico e contexto |

| Decodificador | Gera texto de saída com base na entrada codificada | Produz respostas coerentes e contextuais |

| Autoatenção | Determina a relevância das partes da entrada | Permite entender dependências de longo alcance |

| Codificação de Posição | Rastreia ordem e posição das palavras | Preserva estrutura gramatical e significado |

| Embeddings | Representações matemáticas das palavras | Permite cálculos de similaridade semântica |

O desenvolvimento de modelos GPT envolve um sofisticado processo de treinamento em múltiplas etapas que transforma dados de texto brutos em um sistema inteligente de linguagem. O GPT-3, que alimenta muitas implementações atuais do ChatGPT, foi treinado com mais de 175 bilhões de parâmetros usando mais de 45 terabytes de dados de fontes diversas, incluindo textos da web, Common Crawl, livros e Wikipedia. Essa escala massiva de dados de treinamento é essencial para expor o modelo à enorme diversidade da linguagem humana, permitindo que ele compreenda contexto, expressões idiomáticas, terminologia técnica e referências culturais em praticamente todos os domínios do conhecimento.

O processo de treinamento começa com aprendizado não supervisionado, onde o modelo aprende a prever a próxima palavra de uma sequência com base nas palavras anteriores. Essa tarefa aparentemente simples força o modelo a desenvolver uma compreensão profunda da estrutura da linguagem, gramática, semântica e conhecimento de mundo. O modelo aprende que determinadas combinações de palavras são mais prováveis do que outras, que certos conceitos estão relacionados e que a linguagem segue padrões e regras. Após essa fase inicial de pré-treinamento, o modelo passa por um ajuste fino chamado Aprendizado por Reforço com Feedback Humano (RLHF). Nessa fase, treinadores humanos fornecem exemplos de conversas e classificam diferentes respostas com base em qualidade, utilidade e segurança. Essas classificações criam modelos de recompensa que orientam o sistema a gerar melhores respostas. Esse ciclo de feedback é fundamental para alinhar as saídas do modelo com valores e expectativas humanas, reduzindo a probabilidade de gerar conteúdos prejudiciais, enviesados ou sem sentido.

Os chatbots modernos de IA baseados em GPT demonstram notável versatilidade em inúmeros domínios e casos de uso. No atendimento ao cliente, esses sistemas podem lidar com dúvidas rotineiras, fornecer informações sobre produtos, solucionar problemas comuns e encaminhar questões complexas a agentes humanos — tudo mantendo um tom natural e prestativo. Na educação, chatbots de IA atuam como tutores virtuais, explicando conceitos complexos em linguagem acessível, respondendo perguntas de alunos e oferecendo apoio personalizado ao aprendizado. Criadores de conteúdo utilizam chatbots baseados em GPT para gerar ideias, rascunhar artigos e posts em redes sociais, aprimorar textos para diferentes públicos e superar bloqueios criativos. Desenvolvedores de software aproveitam esses sistemas para escrever código, depurar programas, explicar conceitos de programação e acelerar fluxos de trabalho de desenvolvimento.

A capacidade de processar e gerar múltiplos tipos de conteúdo vai além do texto. Implementações avançadas de GPT podem analisar imagens, descrever conteúdos visuais, responder perguntas sobre fotografias e até mesmo gerar imagens a partir de descrições em texto. Alguns sistemas conseguem processar entrada de áudio, possibilitando interações por voz que se assemelham a conversas naturais. Essas capacidades multimodais tornam os chatbots de IA cada vez mais úteis para acessibilidade, permitindo que pessoas com diferentes habilidades interajam com a tecnologia da forma que melhor lhes convier. Os sistemas também podem pesquisar na internet informações atualizadas, garantindo que as respostas reflitam eventos e desenvolvimentos recentes, e não apenas dados de treinamento que podem ter meses ou anos.

Embora o ChatGPT tenha se destacado como o chatbot de IA mais utilizado, o mercado conta com diversas alternativas sofisticadas, cada uma com características e pontos fortes distintos. O ChatGPT permanece como a principal escolha para a maioria dos usuários devido à sua excepcional compreensão de linguagem natural, amplo conhecimento e constantes melhorias por meio de atualizações regulares. A capacidade do sistema de manter o contexto em conversas longas, entender pedidos sutis e gerar conteúdos de alta qualidade em diferentes domínios faz dele a principal solução para assistência geral de IA.

O Gemini do Google (anteriormente Bard) oferece capacidades de busca em tempo real na internet, permitindo fornecer informações atualizadas sobre eventos recentes, notícias e desenvolvimentos. Essa vantagem é especialmente valiosa para consultas que exigem informações do momento. No entanto, o Gemini recebeu críticas por eventuais imprecisões e desempenho inconsistente em comparação ao ChatGPT. O Copilot da Microsoft, alimentado pela tecnologia GPT-4, integra-se profundamente ao ecossistema Microsoft, incluindo buscas no Bing, aplicativos Office e Windows, sendo especialmente valioso para usuários já inseridos nesse ambiente. O Claude, da Anthropic, enfatiza segurança e princípios de IA constitucional, com força particular na análise de documentos extensos e manutenção da consistência em tarefas de raciocínio complexo. O Perplexity AI foca em respostas aprimoradas por buscas e citações de fontes transparentes, sendo útil para consultas de pesquisa.

| Chatbot | Pontos Fortes | Melhor Para |

|---|---|---|

| ChatGPT | Versatilidade, linguagem natural, conhecimento amplo | Assistência geral de IA |

| Google Gemini | Busca em tempo real, informações atuais | Consultas sobre eventos e notícias |

| Microsoft Copilot | Integração com ecossistema Microsoft | Usuários de Office e Windows |

| Claude | Análise de textos longos, foco em segurança | Raciocínio e análise complexos |

| Perplexity AI | Citações de fontes, busca aprimorada | Pesquisa e verificação de fatos |

Chatbots baseados em GPT oferecem vantagens substanciais que impulsionaram sua rápida adoção em diversos setores. Os sistemas se destacam na compreensão de contexto e na manutenção de conversas coerentes ao longo de interações prolongadas, permitindo que usuários façam perguntas de acompanhamento e construam diálogos sem precisar explicar toda a situação novamente. Conseguem gerar conteúdos em praticamente qualquer estilo ou formato, desde textos empresariais formais até ficção criativa ou documentação técnica. A habilidade de processar e responder a perguntas complexas e multipartes demonstra capacidades sofisticadas de raciocínio. Além disso, esses sistemas podem ser personalizados por meio de fine-tuning ou aprendizado em contexto, onde usuários fornecem exemplos durante a conversa para guiar o comportamento do sistema.

No entanto, os sistemas GPT atuais apresentam limitações importantes que os usuários devem conhecer. Os sistemas podem “alucinar”, ou seja, gerar informações, estatísticas ou citações plausíveis, porém totalmente inventadas. Embora esse problema tenha diminuído em modelos mais recentes, ainda é uma preocupação para aplicações que exigem precisão absoluta. Os modelos GPT têm uma data limite de conhecimento — eles não acessam informações posteriores ao seu treinamento, embora algumas implementações incluam busca na internet para contornar essa limitação. Podem ter dificuldades com eventos muito recentes, conhecimento técnico especializado fora dos dados de treinamento ou tarefas que exigem informações em tempo real. Além disso, modelos GPT podem refletir vieses presentes nos dados de treinamento, eventualmente gerando respostas que perpetuam estereótipos ou generalizações injustas. Os sistemas também não conseguem realmente compreender sarcasmo, ironia ou humor altamente dependente de contexto, podendo interpretar linguagem figurada de forma literal. Por fim, embora possam escrever códigos, podem gerar scripts com bugs sutis ou vulnerabilidades de segurança que exigem revisão humana.

Embora chatbots de IA autônomos como o ChatGPT sejam ferramentas poderosas para usuários individuais, organizações que desejam integrar IA aos seus processos de negócios precisam de soluções mais abrangentes. O FlowHunt representa a próxima evolução em automação de IA, oferecendo uma plataforma onde chatbots de IA não apenas respondem perguntas — mas agem em todo o seu sistema empresarial. Diferente do ChatGPT, que opera de forma isolada, o FlowHunt permite criar fluxos inteligentes que conectam a IA a milhares de aplicações, bancos de dados e serviços de negócios.

Com o FlowHunt, é possível criar chatbots de IA que atualizam automaticamente o CRM quando clientes fornecem informações, geram tickets de suporte a partir de solicitações, enriquecem dados de leads de múltiplas fontes, enviam notificações para membros da equipe e executam processos complexos sem intervenção humana. A plataforma permite construir agentes de IA personalizados que entendem os processos específicos da sua empresa, acessam dados proprietários e tomam decisões alinhadas aos objetivos organizacionais. Por exemplo, é possível implantar um chatbot de IA que recebe solicitações de suporte, categoriza automaticamente por urgência, cria tickets no sistema de suporte, pesquisa na base de conhecimento soluções relevantes e elabora respostas personalizadas — tudo em segundos. Esse nível de integração transforma a IA de uma ferramenta de produtividade em um ativo estratégico que impulsiona eficiência, reduz custos e melhora a experiência do cliente.

A vantagem do FlowHunt sobre chatbots isolados está na orquestração da IA em todo seu ecossistema tecnológico. Em vez de copiar informações manualmente entre sistemas ou usar ferramentas desconectadas, o FlowHunt cria fluxos integrados onde a IA toma decisões inteligentes e executa ações que reverberam por toda a organização. A plataforma suporta integração com CRMs, ferramentas de automação de marketing, softwares de gestão de projetos, plataformas de comunicação, data warehouses e centenas de outras aplicações de negócios. Essa abordagem abrangente de automação com IA permite que as organizações alcancem níveis de eficiência e inteligência que chatbots isolados não conseguem atingir.

O campo dos chatbots de IA e da tecnologia GPT continua evoluindo rapidamente, com novas capacidades e melhorias surgindo regularmente. A OpenAI lançou modelos cada vez mais sofisticados, do GPT-3 ao GPT-4 e o mais recente GPT-4o, cada um trazendo avanços em velocidade, precisão, raciocínio e processamento multimodal. A tendência de modelos maiores e com mais parâmetros persiste, embora haja crescente interesse em modelos mais eficientes, capazes de rodar em dispositivos menores ou com menor demanda computacional. Entre as capacidades emergentes estão: melhor raciocínio para problemas complexos e de múltiplas etapas, maior capacidade de seguir instruções elaboradas, aprimoramento em segurança e alinhamento com valores humanos, além de melhor desempenho em situações de exceção e cenários incomuns.

A integração de chatbots de IA aos processos de negócios deve se acelerar, com mais organizações reconhecendo o valor da automação impulsionada por IA. Veremos agentes de IA cada vez mais sofisticados, capazes de operar autonomamente dentro de parâmetros definidos, tomando decisões e executando ações sem supervisão humana constante. A combinação de chatbots de IA com outras tecnologias emergentes, como grafos de conhecimento, bancos de dados vetoriais e geração aumentada por recuperação, permitirá sistemas que acessam e raciocinam sobre grandes volumes de dados estruturados e não estruturados. À medida que essas tecnologias amadurecem, a distinção entre “chatbots” e “sistemas de automação empresarial” tende a desaparecer, com a IA tornando-se parte fundamental do funcionamento das organizações.

Entender o que são chatbots de IA e a tecnologia GPT é essencial para quem deseja aproveitar ao máximo essas ferramentas poderosas. O ChatGPT e sistemas semelhantes representam um verdadeiro avanço na inteligência artificial, permitindo que máquinas compreendam e gerem linguagem humana com sofisticação notável. Porém, a escolha entre chatbots isolados e plataformas completas de automação com IA como o FlowHunt depende das suas necessidades. Para usuários individuais que buscam um assistente versátil para redação, programação, pesquisa e tarefas criativas, o ChatGPT segue como uma excelente opção. Para organizações que desejam integrar IA aos seus processos, automatizar fluxos de trabalho e obter resultados mensuráveis, o FlowHunt oferece a plataforma abrangente necessária para transformar a IA de uma ferramenta de produtividade em uma vantagem competitiva estratégica.

O FlowHunt é a principal plataforma de automação de IA que ajuda você a criar, implantar e gerenciar chatbots inteligentes e fluxos de trabalho de IA. Diferente de chatbots isolados, o FlowHunt integra a IA a todo o seu sistema de negócios, permitindo automação perfeita entre todas as suas ferramentas e processos.

Este artigo abrangente explica o que significa 'GPT' no ChatGPT, como a tecnologia funciona, sua evolução e responde perguntas comuns sobre 'chat gpbt' para usu...

Saiba o que significa GPT no ChatGPT, como Funcionam os Transformadores Generativos Pré-Treinados e por que eles impulsionam as conversas de IA mais avançadas a...

Explore o que é um chatbot GPT, como a tecnologia chatbotgpt funciona, seus principais benefícios, casos de uso reais e como ele se compara a chatbots tradicion...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.