Integração com o CodeLogic MCP Server

O CodeLogic MCP Server conecta o FlowHunt e assistentes de programação com IA aos dados detalhados de dependências de software da CodeLogic, possibilitando anál...

Automação de IA

Integre a API da Coda ao FlowHunt usando o servidor universal Coda MCP para gerenciamento de documentos e automação de fluxos de trabalho impulsionados por IA.

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Servidor Coda MCP (Model Context Protocol) é um servidor de API padronizado e universal que conecta assistentes de IA ao conjunto de ferramentas e serviços da Coda. Ao implementar a especificação MCP, o Servidor Coda MCP permite que clientes de IA interajam de forma programática com a Coda, facilitando tarefas como consultas a documentos, automação de fluxos de trabalho e gerenciamento de arquivos ou dados dentro do ecossistema da Coda. Isso permite que desenvolvedores construam fluxos de trabalho de desenvolvimento aprimorados, integrem dados contextuais em interações com LLMs e orquestrem ações entre sistemas externos usando um protocolo unificado. O servidor é projetado para garantir compatibilidade com outros serviços compatíveis com MCP, tornando-se uma ponte valiosa entre agentes de IA e a poderosa plataforma da Coda.

Nenhuma informação sobre modelos de prompt foi encontrada nos arquivos do repositório disponíveis.

Nenhum recurso MCP explícito está documentado ou listado nos arquivos disponíveis.

Para a lista completa das ferramentas disponíveis, a documentação faz referência a src/universal_mcp_coda/README.md . No entanto, o conteúdo deste arquivo não está disponível nas informações fornecidas, portanto os detalhes das ferramentas não podem ser listados.

uv sync

source .venv/bin/activate.venv\Scripts\Activatemcp dev src/universal_mcp_coda/server.py

mcp install src/universal_mcp_coda/server.py

Exemplo de Configuração JSON: Não fornecido na documentação disponível.

Protegendo as Chaves de API: Nenhum exemplo ou instrução encontrada.

Nenhuma instrução de configuração específica para Claude foi fornecida.

Nenhuma instrução de configuração específica para Cursor foi fornecida.

Nenhuma instrução de configuração específica para Cline foi fornecida.

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo do FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do sistema MCP, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"coda": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Depois de configurado, o agente de IA poderá usar este MCP como uma ferramenta, com acesso a todas as suas funções e capacidades. Lembre-se de alterar “coda” para o nome real do seu servidor MCP e substituir a URL pela URL do seu próprio servidor MCP.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | Resumo fornecido em README.md |

| Lista de Prompts | ⛔ | Nenhum prompt/modelo documentado |

| Lista de Recursos | ⛔ | Nenhum recurso MCP explícito documentado |

| Lista de Ferramentas | ⛔ | Ferramentas referenciadas, mas não listadas no conteúdo disponível |

| Protegendo as Chaves de API | ⛔ | Nenhuma instrução ou exemplo encontrado |

| Suporte a Amostragem (menos importante na avaliação) | ⛔ | Nenhuma menção em README ou outros arquivos |

Com base na documentação disponível, o Coda MCP fornece uma visão geral básica e algumas instruções de configuração local, mas carece de recursos detalhados, modelos de prompt, listagens explícitas de ferramentas e orientações de segurança. Parece estar em um estágio inicial ou subdocumentado.

O repositório do Coda MCP atualmente carece de documentação fundamental sobre recursos, ferramentas, prompts e segurança, o que limita significativamente sua usabilidade e capacidade de descoberta. Com base nas tabelas acima, avaliaríamos este servidor MCP com 2/10, pois demonstra intenção e orientação mínima de configuração, mas falha em entregar o detalhamento esperado de uma implementação MCP pronta para produção.

| Possui uma LICENÇA | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ⛔ (não confirmado) |

| Número de Forks | 0 |

| Número de Estrelas | 1 |

O Servidor Coda MCP é um servidor de API universal que conecta assistentes de IA à Coda, permitindo interação programática para consulta de documentos, automação de fluxos de trabalho e gerenciamento de dados dentro do ecossistema da Coda via Model Context Protocol.

Adicione o componente MCP ao seu fluxo e, em seguida, configure as definições do sistema MCP com os detalhes do seu Servidor Coda MCP em formato JSON. Por exemplo: { "coda": { "transport": "streamable_http", "url": "https://yourmcpserver.example/pathtothemcp/url" } }

A documentação atual não fornece modelos de prompt ou listagem explícita de recursos. Detalhes das ferramentas são referenciados, mas não listados nos arquivos disponíveis.

O repositório do Coda MCP fornece uma visão geral básica e etapas de configuração para Windsurf, mas não possui documentação abrangente sobre ferramentas, recursos, prompts e práticas de segurança. É considerado subdocumentado até o momento.

O repositório utiliza licença MIT.

Desbloqueie fluxos de trabalho impulsionados por IA ao conectar o FlowHunt à poderosa plataforma da Coda através do Servidor MCP.

O CodeLogic MCP Server conecta o FlowHunt e assistentes de programação com IA aos dados detalhados de dependências de software da CodeLogic, possibilitando anál...

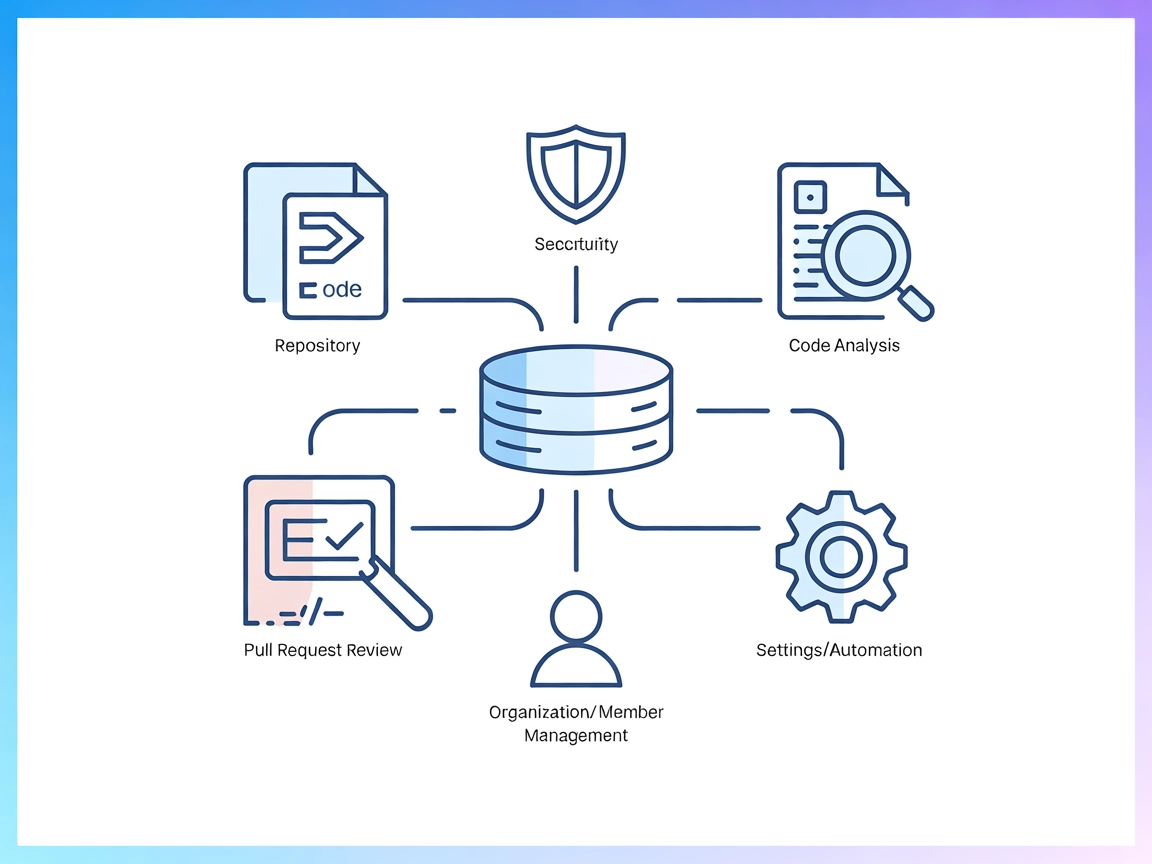

O Servidor Codacy MCP faz a ponte entre assistentes de IA e a plataforma Codacy, permitindo automação de qualidade de código, análise de segurança, gestão de re...

O Servidor do Protocolo de Contexto de Modelo (MCP) conecta assistentes de IA a fontes de dados externas, APIs e serviços, permitindo integração simplificada de...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.