Introducere

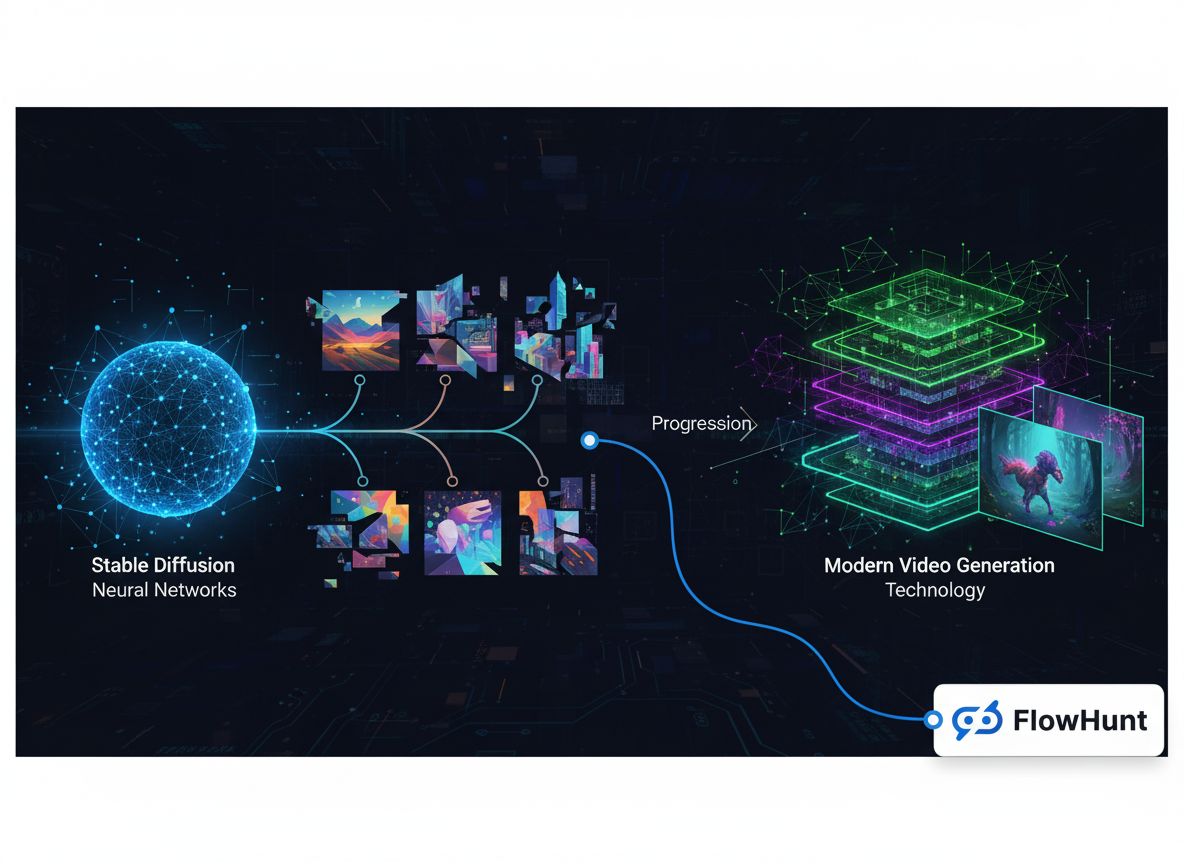

Peisajul media generative a suferit o transformare remarcabilă în ultimii ani, evoluând de la proiecte de cercetare experimentale la o piață de infrastructură de miliarde de dolari. Ceea ce a început ca modele specializate de generare de imagini s-a extins într-un ecosistem cuprinzător care include sinteză de imagini, creare de video, generare audio și capacități sofisticate de editare. Această istorie tehnică explorează modul în care companii precum FAL au construit o afacere cu venituri de peste 100 de milioane de dolari recunoscând un gol critic pe piață: dezvoltatorii aveau nevoie de infrastructură de inferență optimizată și scalabilă, proiectată special pentru modelele media generative, nu de oricare orchestrare generică de GPU sau găzduire de modele de limbaj. Drumul de la Stable Diffusion 1.5 la modelele video moderne precum Veo3 dezvăluie lecții importante despre poziționarea pe piață, specializarea tehnică și cerințele de infrastructură care permit aplicațiilor AI să treacă de la prototipuri de cercetare la sisteme de producție utilizate de milioane de dezvoltatori.

Media generativă reprezintă o categorie fundamental diferită de inteligență artificială în comparație cu modelele mari de limbaj care au dominat recent titlurile. În timp ce modelele de limbaj procesează text și generează răspunsuri pe baza unor tipare învățate, sistemele de media generativă creează conținut vizual și audio—imagini, videoclipuri, muzică și efecte sonore—pornind de la descrieri text, imagini existente sau alte tipuri de input. Această distincție este mai mult decât semantică; reflectă diferențe profunde în cerințele tehnice, dinamica pieței și oportunitățile de afaceri. Modelele de media generativă funcționează sub alte constrângeri computaționale, necesită tehnici de optimizare specializate și deservesc utilizări pe care infrastructura tradițională pentru modele de limbaj nu le poate gestiona eficient. Ascensiunea media generative a creat o nouă categorie de companii de infrastructură, axate specific pe optimizarea inferenței pentru aceste modele, permițând dezvoltatorilor să integreze capabilități avansate de generare de imagini și video în aplicațiile lor fără să gestioneze implementări complexe de GPU sau să se confrunte cu utilizarea ineficientă a resurselor.

Cerințele tehnice pentru inferența media generative diferă semnificativ de cele pentru servirea modelelor de limbaj. Modelele de generare de imagini precum Stable Diffusion și Flux operează prin procese de difuzie iterative, care necesită gestionare atentă a memoriei, optimizare precisă a timpului și procesare eficientă în loturi. Generarea video adaugă un nivel suplimentar de complexitate, necesitând consistență temporală, sincronizare audio și resurse computaționale semnificativ mai mari. Aceste cerințe nu pot fi gestionate eficient de platforme generice de orchestrare GPU sau servicii de inferență pentru modele de limbaj. În schimb, ele cer infrastructură specializată construită de la zero pentru a gestiona caracteristicile unice ale modelelor de difuzie, generarea autoregresivă de imagini și sinteza video. Companiile care au recunoscut devreme această nișă—și au investit în construcția de infrastructură dedicată—s-au poziționat pentru a capta cote de piață semnificative pe măsură ce adopția media generative a accelerat în diverse industrii.

Pregătit să îți dezvolți afacerea?

Începe perioada de probă gratuită astăzi și vezi rezultate în câteva zile.

Decizia de a se specializa în media generativă, în loc să urmeze aparent mai evidenta cale a găzduirii modelelor de limbaj, reprezintă una dintre cele mai importante alegeri strategice din istoria recentă a infrastructurii AI. Când fondatorii FAL și-au evaluat opțiunile în jurul anilor 2022-2023, s-au confruntat cu un punct critic: să-și extindă runtime-ul Python într-o platformă generală de inferență pentru modele de limbaj sau să mizeze pe spațiul emergent al media generative? Răspunsul relevă perspective importante despre dinamica pieței, poziționarea competitivă și importanța alegerii bătăliilor pe care le poți câștiga. Găzduirea modelelor de limbaj, deși părea atractivă datorită atenției și finanțării masive către modelele mari de limbaj, prezenta un peisaj competitiv imposibil. OpenAI stabilise deja GPT ca model dominant cu o bază uriașă de utilizatori și venituri. Anthropic construia Claude cu sprijin substanțial și talent tehnic. Google, Microsoft și alte mari companii tech investeau miliarde în infrastructura lor de modele de limbaj. Pentru un startup, concurența în acest spațiu ar fi însemnat să se măsoare direct cu companii cu resurse net superioare, poziții consolidate și capacitatea de a oferi acces la modele chiar și sub cost dacă asta servea interesele lor strategice.

Piața media generative, în schimb, prezenta o dinamică competitivă fundamental diferită. Când Stable Diffusion 1.5 a fost lansat în 2022, a creat o nevoie imediată de infrastructură de inferență optimizată, dar nu exista niciun jucător consacrat care să domine acest spațiu. Modelul era open-source, ceea ce însemna că oricine îl putea descărca și rula, dar majoritatea dezvoltatorilor nu aveau expertiza sau resursele necesare pentru a-l optimiza eficient. Aceasta a creat o oportunitate perfectă pentru o companie de infrastructură specializată să apară. FAL a recunoscut că dezvoltatorii doreau să folosească aceste modele, dar nu doreau să gestioneze complexitatea implementării pe GPU, optimizării modelelor și scalării. Axându-se exclusiv pe media generativă, FAL a putut deveni expertul acestui domeniu specific, să construiască relații profunde cu creatorii de modele și dezvoltatori și să se impună ca platforma de referință pentru inferența media generative. Această strategie de specializare s-a dovedit extrem de de succes, permițând FAL să evolueze rapid și să deservească 2 milioane de dezvoltatori, găzduind peste 350 de modele și depășind 100 de milioane de dolari venituri anual.

Fundamentul tehnic al platformelor moderne de media generativă se bazează pe optimizări sofisticate de inferență care depășesc cu mult simpla rulare a modelelor pe GPU-uri. Când dezvoltatorii au început să folosească Stable Diffusion 1.5, mulți au încercat să îl implementeze singuri pe infrastructură cloud generică sau GPU-uri locale. Această abordare a evidențiat ineficiențe critice: modelele nu erau optimizate pentru hardware-ul pe care rulau, memoria era irosită din cauza batch-urilor ineficiente, iar ratele de utilizare erau scăzute deoarece fiecare sarcină era izolată. Un dezvoltator putea utiliza doar 20-30% din capacitatea GPU-ului, plătind însă pentru 100%. Această risipă a creat o oportunitate pentru o platformă care să agregheze cererea multor utilizatori, să optimizeze inferența pentru configurații hardware specifice și să atingă rate de utilizare mult mai mari prin batching și programare inteligentă. Abordarea FAL a implicat construirea de kernel-uri CUDA personalizate—cod GPU de nivel jos optimizat pentru operațiuni specifice din modelele generative—care puteau îmbunătăți dramatic performanța față de implementările generice.

Provocarea infrastructurii merge dincolo de simpla optimizare a performanței. Modelele media generative au caracteristici unice care cer gestionare specializată. Modelele de difuzie, care stau la baza celor mai multe sisteme de generare de imagini, funcționează printr-un proces iterativ în care modelul rafinează treptat zgomotul în imagini coerente prin numeroși pași. Fiecare pas necesită gestionare atentă a memoriei pentru a evita depășirea capacității GPU-ului, iar procesul trebuie să fie suficient de rapid pentru aplicații interactive. Generarea video adaugă dimensiuni temporale, modelele trebuind să mențină consistență între cadre și să genereze conținut de calitate la 24 sau 30 de cadre pe secundă. Modelele audio au propriile cerințe, de la procesare în timp real pentru unele aplicații, la ieșiri de înaltă fidelitate pentru altele. O platformă care deservește toate aceste modalități trebuie să dezvolte expertiză profundă pentru fiecare domeniu, înțelegând oportunitățile și constrângerile specifice fiecărui tip de model. Această specializare este tocmai ceea ce face companiile de infrastructură media generativă valoroase—acumulează cunoștințe și tehnici de optimizare pe care dezvoltatorii individuali nu le pot replica ușor.

Abonează-te la newsletter-ul nostru

Primește cele mai recente sfaturi, tendințe și oferte gratuit.

Evoluția modelelor de generare de imagini: De la Stable Diffusion la Flux

Istoria media generative poate fi urmărită prin evoluția modelelor de generare de imagini, fiecare reprezentând un punct de inflexiune semnificativ în dezvoltarea pieței. Stable Diffusion 1.5, lansat în 2022, a fost catalizatorul care a transformat media generativă dintr-o curiozitate academică într-un instrument practic pentru dezvoltatori. Modelul era open-source, relativ eficient față de modelele anterioare de difuzie și producea imagini de calitate rezonabilă pentru o gamă largă de utilizări. Pentru FAL, Stable Diffusion 1.5 a reprezentat momentul când a recunoscut oportunitatea de a-și pivota întreaga companie. A început să ofere o versiune optimizată, gata de API, pe care dezvoltatorii o puteau utiliza fără să gestioneze infrastructura GPU proprie. Răspunsul a fost covârșitor—dezvoltatorii au recunoscut imediat valoarea eliminării complexității implementării, iar SD 1.5 a devenit primul driver major de venituri pentru FAL. Dincolo de modelul de bază, ecosistemul de fine-tuning din jurul SD 1.5 a explodat. Dezvoltatorii au creat LoRA-uri (Low-Rank Adaptations)—modificări ușoare ale modelului de bază pentru utilizări concrete precum stiluri de artă, fețe specifice sau obiecte unice. Acest ecosistem a creat un ciclu virtuos unde mai multe opțiuni de fine-tuning făceau platforma mai valoroasă, atrăgând și mai mulți dezvoltatori și generând și mai multe LoRA-uri.

Stable Diffusion 2.1, lansat ca urmaș al modelului original, a reprezentat o lecție despre importanța calității modelelor pe piața media generative. Deși tehnic mai avansat pe anumite aspecte, SD 2.1 era perceput ca un pas înapoi la calitatea imaginilor, în special pentru fețe umane și scene complexe. Modelul nu a câștigat tracțiune semnificativă, iar mulți dezvoltatori au continuat să utilizeze versiunea 1.5. Această experiență a arătat că, pe piața media generative, calitatea contează mai mult decât sofisticarea tehnică. Utilizatorii sunt interesați de rezultatul obținut, nu de arhitectura sau metodologia de antrenare. Stable Diffusion XL (SDXL), lansat în 2023, a reprezentat un salt real înainte în ceea ce privește calitatea și capabilitățile. SDXL putea genera imagini la rezoluție mai mare, cu detalii mai bune și redare mai precisă a textului. Pentru FAL, SDXL a fost un moment de transformare—a fost primul model care a generat venituri de 1 milion de dolari pentru platformă. Succesul modelului a accelerat și ecosistemul de fine-tuning, dezvoltatorii creând mii de LoRA-uri pentru personalizare. Succesul SDXL a demonstrat cererea comercială substanțială pentru generarea de imagini de calitate, validând decizia FAL de a se specializa pe această piață.

Lansarea modelelor Flux de Black Forest Labs în 2024 a marcat un alt punct critic. Flux a reprezentat prima generație de modele care puteau fi descrise cu adevărat drept „utilizabile comercial” și „pregătite pentru enterprise”. Calitatea era semnificativ mai mare decât modelele anterioare, viteza de generare era acceptabilă pentru aplicații de producție, iar rezultatele erau suficient de consistente pentru ca firmele să își construiască produse în jurul lor. Pentru FAL, Flux a fost transformator: veniturile platformei au crescut de la 2 milioane la 10 milioane de dolari în prima lună după lansarea Flux, apoi la 20 de milioane în luna următoare. Această creștere explozivă a reflectat cererea latentă pentru generarea de imagini de calitate, utilizabile fiabil în aplicații comerciale. Flux a venit în mai multe versiuni—Schnell (variantă rapidă, distilată), Dev (variantă de calitate superioară cu licențiere non-comercială) și Pro (care necesită colaborare pentru găzduire)—fiecare deservind utilizări și prețuri diferite. Succesul Flux a demonstrat că piața media generative a ajuns la maturitate, companiile fiind dispuse să investească serios în capabilități de generare de imagini, nu doar să experimenteze tehnologia.

Trecerea la video: Un nou segment de piață

Deși generarea de imagini a atras atenție și venituri semnificative, apariția modelelor video practice a reprezentat o oportunitate de piață cu totul nouă. Modelele text-to-video timpurii, inclusiv Sora de la OpenAI, au arătat ce este teoretic posibil, dar fie nu erau disponibile, fie produceau rezultate interesante din perspectivă de cercetare, dar nepractici pentru majoritatea aplicațiilor. Videoclipurile erau deseori fără sunet, cu inconsistențe temporale și fără rafinamentul necesar pentru uz profesional. Acest lucru s-a schimbat radical odată cu lansarea unor modele precum Veo3 de la Google DeepMind, care a reprezentat un adevărat salt înainte în calitatea generării video. Veo3 putea genera videoclipuri cu sunet sincronizat, sincronizare și ritm corecte, lip-sync precis pentru persoane care vorbesc și calitate vizuală apropiată de standardele profesionale. Modelul era costisitor de rulat—mult mai intensiv computațional decât generarea de imagini—dar calitatea justifica costul pentru multe aplicații.

Impactul generării video de înaltă calitate asupra afacerii FAL a fost substanțial. Generarea video a creat un nou flux de venituri și a atras o altă categorie de clienți. Dacă generarea de imagini era folosită în principal de dezvoltatori individuali, designeri și mici echipe creative, generarea video a atras companii mari interesate de crearea de conținut publicitar, videoclipuri de marketing și alte aplicații profesionale. FAL a colaborat cu mai mulți furnizori de modele video, inclusiv One de la Alibaba, Kling de la Kuaishou și alții, pentru a oferi o suită completă de opțiuni de generare video. Creșterea veniturilor platformei s-a accelerat pe măsură ce video-ul a devenit o componentă tot mai importantă din totalul utilizării. Provocările tehnice ale generării video au impulsionat și inovația infrastructurii FAL—modelele video necesitau strategii de optimizare diferite față de cele pentru imagini, necesitând noi kernel-uri personalizate și abordări arhitecturale. Succesul generării video a validat și strategia FAL de a construi o platformă pentru mai multe modalități. În loc să se specializeze doar pe imagini, FAL a creat infrastructură flexibilă pentru imagini, video și modele audio, devenind platforma media generativă completă.

Pe măsură ce media generativă a devenit tot mai centrală pentru crearea de conținut și dezvoltarea de aplicații, platforme precum FlowHunt au apărut pentru a ajuta dezvoltatorii și echipele să gestioneze complexitatea integrării acestor capabilități în fluxurile lor. FlowHunt recunoaște că, deși platforme precum FAL au rezolvat provocarea infrastructurii pentru rularea eficientă a modelelor media generative, dezvoltatorii se confruntă în continuare cu dificultăți în orchestrarea modelelor în fluxuri de aplicații mai mari. O aplicație tipică de media generativă poate implica multiple etape: primirea cererii utilizatorului, procesarea și validarea inputului, apelarea unuia sau mai multor modele generative, post-procesarea rezultatelor, stocarea ieșirilor și gestionarea analiticii. FlowHunt oferă instrumente pentru automatizarea și optimizarea acestor fluxuri, permițând dezvoltatorilor să se concentreze pe logica aplicației, nu pe managementul infrastructurii. Prin integrarea cu platforme precum FAL, FlowHunt permite dezvoltatorilor să creeze aplicații media generative sofisticate fără să gestioneze complexitatea servirii modelelor, optimizării și scalării.

Abordarea FlowHunt pentru fluxuri media generative pune accent pe automatizare, fiabilitate și observabilitate. Platforma permite dezvoltatorilor să definească fluxuri ce leagă mai multe operații media generative, să gestioneze erorile elegant și să ofere vizibilitate la fiecare pas. De exemplu, un flux de creare conținut poate implica generarea mai multor variante de imagine, alegerea celei mai bune după metrici de calitate, aplicarea unor efecte de post-procesare și publicarea rezultatului. FlowHunt permite definirea declarativă a întregului flux, cu logică automată de retry, tratare a erorilor și monitorizare. Acest strat de abstractizare este deosebit de valoros pentru echipele care construiesc aplicații de producție ce trebuie să genereze conținut fiabil, la scară. Gestionând orcestrarea și managementul fluxului, FlowHunt permite dezvoltatorilor să se concentreze pe logica creativă și de business a aplicațiilor lor, iar platforma se ocupă de complexitatea tehnică a coordonării multiplelor operații media generative.

Creșterea remarcabilă a afacerii FAL și calitatea serviciului său se bazează pe o fundație de optimizare tehnică sofisticată, invizibilă pentru majoritatea utilizatorilor. Platforma a dezvoltat peste 100 de kernel-uri CUDA personalizate—cod specializat pentru GPU scris în limbajul CUDA de la NVIDIA—care optimizează operații specifice din modelele media generative. Aceste kernel-uri reprezintă mii de ore de muncă inginerească dedicate extragerii performanței maxime din hardware-ul GPU. Motivația pentru acest nivel de optimizare este simplă: fiecare milisecundă redusă din latență înseamnă experiență mai bună pentru utilizator și costuri de infrastructură mai mici. Un model care poate genera o imagine cu 20% mai rapid permite aceluiași GPU să deservească cu 20% mai mulți utilizatori, îmbunătățind direct economia platformei. Provocarea scrierii de kernel-uri personalizate este semnificativă. Programarea CUDA necesită înțelegere profundă a arhitecturii GPU, ierarhiilor de memorie și principiilor calculului paralel. Nu e o abilitate ce se poate dobândi rapid sau aplica generic—fiecare kernel trebuie ajustat atent pentru operațiuni și configurații hardware specifice.

Procesul de optimizare începe cu profilarea—înțelegerea locului unde se consumă efectiv timpul executării modelului. Mulți dezvoltatori presupun că operațiunile cele mai intensive computațional sunt și blocajul principal, dar profilarea relevă adesea rezultate surprinzătoare. Uneori, blocajul este transferul de date între memoria GPU și unitățile de calcul, nu calculul în sine. Alteori, este costul lansării multor operațiuni GPU mici, în loc să fie grupate. Inginerii FAL profilează modelele extensiv, identifică blocajele reale și apoi scriu kernel-uri personalizate pentru a le adresa. De exemplu, pot scrie un kernel care fuzionează multiple operații, reducând traficul de memorie și costul lansării kernel-urilor. Sau pot scrie un kernel optimizat exact pentru dimensiunile și tipurile de date dintr-un model anume. Acest nivel de optimizare se justifică economic doar dacă deservești milioane de utilizatori—investiția în dezvoltarea kernel-urilor personalizate se recuperează prin eficiență și costuri reduse de infrastructură.

Dincolo de optimizarea fiecărui kernel, FAL a investit și în îmbunătățiri arhitecturale privind servirea modelelor. Platforma folosește tehnici precum cuantizarea modelelor (reducerea preciziei ponderilor modelului pentru a consuma mai puțină memorie și calcul), batching dinamic (gruparea cererilor pentru a îmbunătăți utilizarea GPU) și prioritizarea cererilor (pentru a asigura că cererile sensibile la latență sunt prioritizate față de cele orientate pe throughput). Aceste tehnici cer implementări atente pentru a păstra calitatea, dar a crește eficiența. Cuantizarea, de exemplu, poate reduce dimensiunea modelului și crește viteza, dar dacă e făcută incorect, degradează calitatea ieșirii. Inginerii FAL au dezvoltat strategii sofisticate de cuantizare care păstrează calitatea și aduc câștiguri de eficiență. Batching-ul dinamic presupune prezicerea duratei fiecărei cereri și gruparea optimă pentru a maximiza utilizarea GPU fără a introduce latențe excesive. Aceste îmbunătățiri arhitecturale, împreună cu optimizarea kernel-urilor, permit FAL să atingă rate de utilizare și performanță imposibil de obținut cu infrastructură generică.

Dinamica pieței și peisajul competitiv

Piața media generative a evoluat rapid, cu modele și capabilități noi apărând constant. Înțelegerea dinamicii competitive și structurii pieței este esențială pentru a aprecia de ce platforme specializate precum FAL au devenit atât de valoroase. Piața poate fi împărțită în câteva segmente: generare de imagini, generare de video, generare audio și unelte de editare/manipulare. În fiecare segment, mai multe modele concurează pe calitate, viteză, cost și capabilități specifice. Pentru generarea de imagini, piața include variante de Stable Diffusion, modele Flux, Gemini Image de la Google și diverse modele specializate pentru utilizări concrete precum generarea de logo-uri sau sinteza fețelor umane. Pentru generarea de video, peisajul include Veo3, One de la Alibaba, Kling de la Kuaishou și altele. Această diversitate de modele creează atât oportunitate, cât și provocare pentru platformele de infrastructură. Oportunitatea este că niciun model nu domină toate utilizările—diferite modele excelează la lucruri diferite, deci o platformă care poate servi mai multe modele devine mai valoroasă. Provocarea e că suportul multor modele necesită efort inginereasc semnificativ pentru optimizarea fiecăruia.

Strategia FAL a fost să selecteze un portofoliu de modele care, împreună, acoperă cele mai importante utilizări, menținând standarde ridicate de calitate. În loc să adauge fiecare model nou apărut, FAL evaluează atent modelele noi și le adaugă doar dacă aduc capabilități unice sau o calitate mult mai bună decât opțiunile existente. Această abordare are mai multe beneficii. În primul rând, asigură că selecția modelelor de pe platformă este de calitate și utilă, nu copleșind utilizatorii cu opțiuni mediocre. În al doilea rând, permite FAL să-și concentreze eforturile de optimizare pe modelele care vor fi efectiv folosite, nu să își dilueze resursele. În al treilea rând, creează un ciclu virtuos prin care reputația platformei pentru calitate atrage atât utilizatori, cât și creatori de modele. Creatorii de modele își doresc să fie pe FAL pentru că știu că utilizatorii platformei sunt serioși în privința calității. Utilizatorii vor să folosească FAL pentru că știu că modelele disponibile sunt atent selecționate și bine optimizate. Acest feedback pozitiv a fost crucial pentru succesul FAL.

Peisajul competitiv include și alte platforme de infrastructură pentru media generativă, precum și competiție directă din partea creatorilor de modele care își oferă propriul hosting. Unii creatori, precum Stability AI, au oferit propriile API-uri de inferență. Alții, precum Black Forest Labs cu Flux, au ales să colaboreze cu platforme precum FAL în loc să-și construiască infrastructura proprie. Decizia de a colabora sau construi este strategică—construirea infrastructurii proprii cere resurse inginerești și operaționale semnificative, în timp ce colaborarea permite concentrarea pe dezvoltarea de modele. Pentru majoritatea creatorilor, parteneriatul cu platforme specializate precum FAL are mai mult sens decât dezvoltarea infrastructurii proprii. Această dinamică a creat un ecosistem sănătos în care creatorii de modele se concentrează pe cercetare și dezvoltare, iar platformele de infrastructură pe optimizare și scalare.

Modelul de venituri și metricile afacerii

Înțelegerea modelului de business și metricilor FAL oferă perspectivă asupra modului în care companiile de infrastructură media generativă creează valoare și scalează. FAL operează pe un model de tarifare bazat pe utilizare, clienții plătind în funcție de numărul de apeluri API și resursele computaționale consumate. Acest model aliniază bine stimulentele—clienții plătesc mai mult când folosesc mai mult, iar veniturile FAL cresc pe măsură ce platforma devine mai valoroasă și mai răspândită. Metricile de creștere ale platformei sunt impresionante: 2 milioane de dezvoltatori, peste 350 de modele disponibile și peste 100 de milioane de dolari venituri anuale. Aceste cifre reflectă o scală substanțială, dar și stadiul incipient al pieței media generative. Penetrarea la potențialii utilizatori este încă relativ redusă, iar multe utilizări rămân neexplorate. Creșterea veniturilor s-a accelerat, mai ales odată cu introducerea capabilităților de generare video. Veniturile platformei au crescut de la 2 milioane la 10 milioane de dolari în prima lună după lansarea Flux, demonstrând impactul modelelor de calitate asupra veniturilor platformei de infrastructură.

Metricile de business dezvăluie și perspective despre dinamica pieței. Faptul că FAL a atins peste 100 de milioane de dolari venituri anuale deservind 2 milioane de dezvoltatori sugerează că venitul mediu per utilizator este relativ modest—poate 50-100 de dolari pe an. Acest lucru reflectă că mulți utilizatori experimentează media generativă sau o folosesc la scară mică. Totuși, distribuția este probabil foarte inegală, cu un număr mic de utilizatori „power” generând o mare parte din venituri. Acești utilizatori sunt de obicei companii care integrează capabilități media generative în produsele sau serviciile lor. Pe măsură ce piața se maturizează și mai multe companii integrează media generativă în operațiunile de bază, venitul mediu per utilizator va crește probabil semnificativ. Traiectoria de creștere a platformei sugerează că infrastructura media generativă este încă la începutul unei curbe lungi de creștere, cu oportunități majore în viitor.

Perspective avansate: rolul fine-tuning-ului și personalizării

Una dintre cele mai importante evoluții pe piața media generative a fost apariția capabilităților de fine-tuning și personalizare, care permit utilizatorilor adaptarea modelelor la utilizări specifice. Fine-tuning-ul presupune preluarea unui model pre-antrenat și antrenarea suplimentară pe date specifice domeniului pentru a îmbunătăți performanța pe sarcini particulare. Pentru generarea de imagini, acest lucru s-a realizat în special prin LoRA-uri (Low-Rank Adaptations)—modificări ușoare de model care pot personaliza baza fără reantrenare completă. Un designer poate crea un LoRA care să învețe modelul să genereze imagini într-un anumit stil artistic. Un fotograf poate crea un LoRA care să redea estetica proprie. O companie poate