MCP: Protocolul de Context al Modelului

Protocolul de Context al Modelului (MCP) este o interfață standard deschisă care permite Modelelor Lingvistice Mari (LLM) să acceseze în siguranță și în mod con...

AI agentic transformă automatizarea fluxurilor de lucru cu Model Context Protocol (MCP), permițând integrarea dinamică a agenților AI cu resurse diverse. Descoperă cum MCP standardizează accesul la context și instrumente pentru aplicații AI agentice puternice.

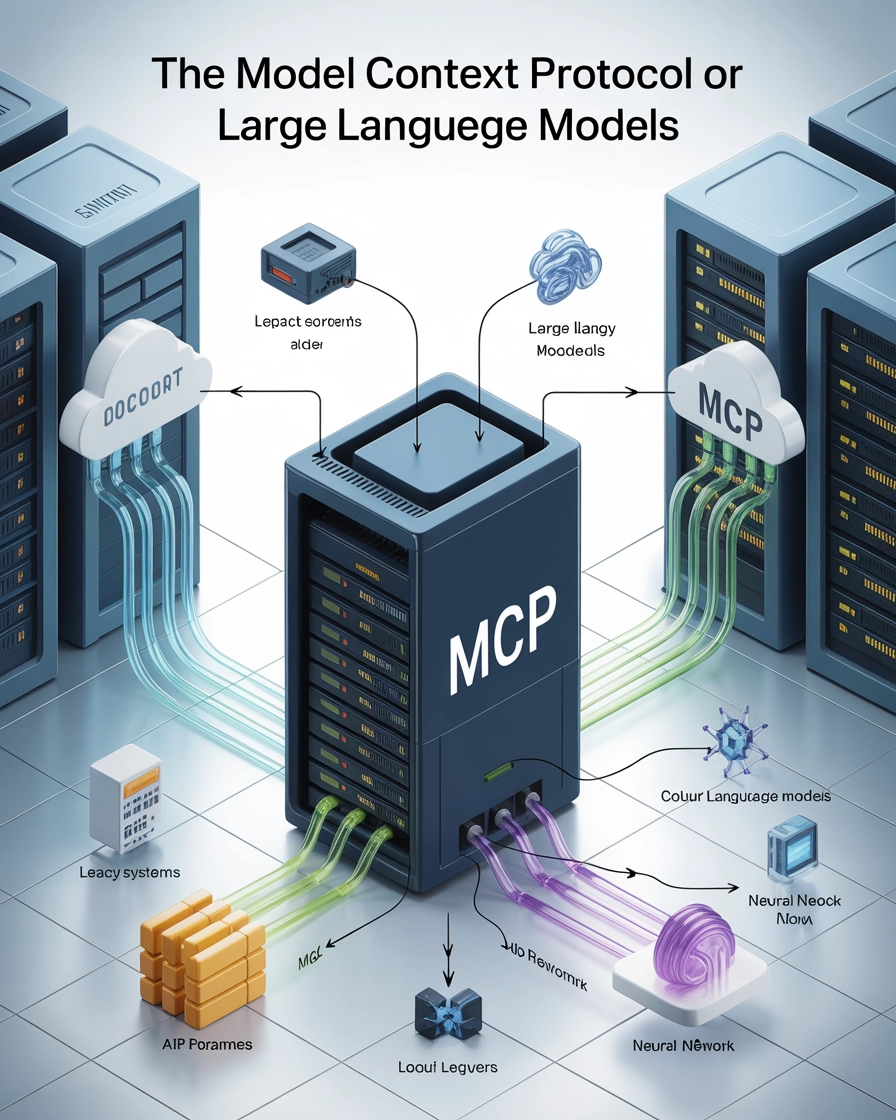

AI agentic redefinește peisajul automatizării fluxurilor de lucru, oferind sistemelor puterea de a acționa autonom, de a integra resurse digitale diverse și de a livra valoare reală dincolo de simpla generare de texte. Această evoluție este facilitată de Model Context Protocol (MCP)—un protocol deschis pentru standardizarea contextului în modelele mari de limbaj (LLM), care se impune rapid drept piatra de temelie a integrării AI scalabile.

La bază, Model Context Protocol (MCP) stabilește un cadru standardizat, open-source, pentru expunerea și consumul de context, instrumente externe și surse de date în aplicațiile bazate pe LLM. Este un salt major față de modelele tradiționale prompt-răspuns, unde interacțiunea se limitează la schimbul de text simplu. AI agentic, în schimb, are nevoie să invoce instrumente, să acceseze date în timp real, să apeleze API-uri și să răspundă dinamic la informații în schimbare—toate acestea fiind posibile cu MCP.

Prin intermediul unor endpoint-uri RESTful bine definite—bazate pe HTTP, Server-Sent Events și JSON RPC—MCP permite aplicațiilor gazdă (clienți) să descopere, descrie și să interacționeze cu o gamă largă de resurse puse la dispoziție de servere. Astfel, sistemele AI pot identifica automat instrumente și date disponibile, pot prelua descrieri structurate și pot solicita acțiuni, totul printr-o interfață comună și compozabilă.

MCP este adesea comparat cu USB-C pentru aplicațiile AI, și pe bună dreptate: ambele urmăresc să ofere o experiență universală, plug-and-play. Totuși, în timp ce USB-C este un standard hardware fizic pentru conectivitate, MCP este un protocol software conceput special pentru mediul digital. Inovația sa constă în a face instrumentele și resursele nu doar conectabile, ci și descoperibile și accesibile dinamic oricărui sistem AI agentic compatibil.

Spre deosebire de integrările codate manual, MCP permite dezvoltatorilor să înregistreze noi instrumente sau surse de date ca servere—acestea devenind instant disponibile oricărui client conform. Această modularitate și flexibilitate permite compunerea rapidă și reconfigurarea automatizării fluxurilor de lucru AI, fără rescrieri ample sau integrare personalizată.

Imaginează-ți că dezvolți un asistent AI agentic pentru programări. În mod tradițional, ai integra strâns API-uri de calendar, sisteme de rezervare și date interne—înglobând logica complexă direct în aplicație. Cu MCP, toate aceste resurse sunt expuse ca endpoint-uri descoperibile. Clientul AI interoghează serverul MCP pentru capabilitățile disponibile, prezintă contextul și solicitările către LLM și, pe baza recomandărilor modelului, preia date sau invocă instrumente fără întreruperi.

De exemplu, dacă AI-ul are nevoie de o listă cu cafenele din apropiere pentru a programa o întâlnire, pur și simplu interoghează serverul MCP, obține rezultatele actualizate și le folosește în următorul prompt. Descrierile instrumentelor, parametrii și schemele de invocare sunt oferite într-o formă structurată, permițând LLM-ului să recomande acțiuni precise pe care clientul le poate executa transparent și controlat.

Această arhitectură nu doar că permite fluxuri de lucru AI agentice mai bogate, ci și asigură partajarea și actualizarea facilă a resurselor între echipe și organizații, creând un ecosistem vibrant de componente AI reutilizabile.

Adoptarea MCP accelerează în rândul companiilor vizionare și practicienilor AI care doresc să operaționalizeze AI agentic la scară. Fundamentul open-source al protocolului asigură accesibilitate largă, îmbunătățiri continue și sprijin comunitar robust. Platforme și furnizori de top—inclusiv din ecosistemele Kafka și Confluent—construiesc deja servere compatibile MCP, extinzând instantaneu gama de surse de date și instrumente de automatizare disponibile pentru integrarea AI agentic.

Pentru decidenții AI, adoptarea MCP înseamnă deblocarea agilității, scalabilității și compozabilității complete ale sistemelor AI—făcând posibilă atât automatizarea internă, cât și servicii AI sofisticate pentru clienți, pe o infrastructură unificată și standardizată.

Prin adoptarea Model Context Protocol, organizațiile se poziționează în avangarda integrării AI moderne—echipând echipele pentru a construi, adapta și scala soluții AI agentice cu o eficiență și rapiditate de neegalat. MCP nu este doar un protocol; este poarta spre noua eră a automatizării AI.

Ani la rând, puterea modelelor mari de limbaj (LLM) a fost limitată de natura statică a interacțiunilor lor. În paradigma tradițională, un utilizator introduce un prompt, iar LLM returnează un răspuns text. Deși această abordare funcționează pentru întrebări simple, bazate pe informații, limitează fundamental ceea ce AI poate realiza pentru automatizare enterprise și integrarea fluxurilor de lucru.

Instrumentele LLM tradiționale operează într-un cadru rigid, de tip intrare/ieșire text. Ele generează doar răspunsuri textuale, indiferent de complexitatea cererii. Asta înseamnă:

Să punem în perspectivă: să presupunem că întrebi un LLM tradițional: „Programează o întâlnire la cafea cu Peter săptămâna viitoare.” Modelul poate oferi sfaturi de programare sau poate cere clarificări, dar nu poate verifica calendarul tău, determina disponibilitatea lui Peter, găsi o cafenea sau crea o invitație în calendar. Fiecare pas rămâne manual, iar fiecare context trebuie furnizat din nou și din nou.

Intră în scenă AI-ul agentic—următoarea evoluție în automatizarea inteligentă. Modelele AI agentice nu doar răspund la întrebări; ele acționează. Invoacă instrumente externe, accesează date enterprise actualizate și automatizează fluxuri de lucru cu mai mulți pași.

De ce este necesar acest lucru? Pentru că scenariile reale de business sunt dinamice și cer mai mult decât cuvinte. De exemplu:

În fiecare scenariu, abordarea veche îți oferă sfaturi sau soluții parțiale, în timp ce AI-ul agentic livrează rezultate acționabile și integrate.

Model Context Protocol (MCP) este infrastructura critică ce transformă instrumentele LLM statice în AI agentic puternic. MCP conectează modelele de limbaj cu lumea reală—date enterprise, API-uri, fișiere și instrumente de automatizare a fluxurilor de lucru—permițând integrare AI fără întreruperi.

Cum rezolvă MCP aceste provocări?

Exemplu practic:

MCP schimbă regulile jocului pentru automatizarea fluxurilor de lucru AI în enterprise:

Pe scurt, MCP face legătura dintre modelele doar de limbaj și integrarea AI reală. Permite companiilor să depășească prompturile statice și modelele AI izolate, deblocând adevăratul potențial al AI-ului agentic pentru eficiență, productivitate și automatizare la scară.

Pe măsură ce companiile accelerează adoptarea AI agentic, cerința pentru integrare AI fără întreruperi și scalabilă între resurse organizaționale diverse este mai mare ca niciodată. Afacerile moderne se bazează pe agenți AI nu doar pentru a genera informații, ci pentru a acționa concret—invoacând instrumente, automatizând fluxuri de lucru și reacționând la evenimente reale. Pentru a realiza acest lucru în context enterprise e nevoie de o abordare robustă și standardizată, iar aici intervine Model Context Protocol (MCP).

AI-ul agentic la nivel enterprise are nevoie de mult mai mult decât integrări statice, codate manual. Agenții AI trebuie să acceseze o varietate largă de resurse actualizate—de la baze de date interne și sisteme de fișiere, la API-uri externe, platforme de streaming precum Kafka și instrumente specializate. Natura statică a integrărilor convenționale—unde fiecare conexiune cu o resursă sau instrument e încorporată direct în aplicația AI—duce rapid la o arhitectură monolitică și fragilă. Această abordare nu doar că este greu de scalat, dar și încetinește inovația, fiecare resursă nouă cerând cod personalizat și mentenanță.

În practică, companiile au nevoie ca agenții AI să poată:

Aceste cerințe evidențiază limitele integrărilor monolitice, mai ales când organizațiile vor să scaleze AI-ul agentic în echipe, departamente și scenarii diverse.

Integrările codate manual blochează logica de business și conectivitatea la resurse în cadrul fiecărei aplicații AI. De exemplu, dacă o companie dorește ca un agent AI să gestioneze programări, agentul poate include direct cod pentru API-uri de calendar, căutări de locații și sisteme de rezervare. Aceasta izolează logica, făcând-o indisponibilă altor agenți sau aplicații—creând silozuri, dublând efortul și complicând mentenanța.

Astfel de designuri monolitice aduc mai multe blocaje:

Model Context Protocol (MCP) abordează aceste provocări, servind ca un protocol standardizat și plug-and-play pentru conectarea agenților AI la resurse și instrumente enterprise. Gândește-te la MCP ca la coloana vertebrală care permite AI-ului să descopere, acceseze și orienteze acțiuni flexibil într-un ecosistem dinamic de capabilități—fără codare manuală sau actualizări de fiecare dată.

În esență, MCP introduce o arhitectură clară client-server:

Comunicarea dintre agent (client) și serverul de resurse are loc prin HTTP, folosind JSON-RPC, permițând notificări asincrone, descoperirea capabilităților și acces la resurse. Agentul poate interoga dinamic serverul MCP pentru instrumente, surse de date sau prompturi disponibile—făcând resursele descoperibile și plug-and-play.

Imaginează-ți un agent AI enterprise care trebuie să programeze întâlniri. În loc să codezi manual integrarea cu calendare, API-uri de locații și sisteme de rezervare, agentul interoghează serverul MCP pentru capabilitățile disponibile. Serverul descrie instrumentele sale (de exemplu, integrare calendar, rezervare) și expune resurse (cafenele din apropiere, săli de ședințe disponibile). Agentul poate selecta și invoca dinamic instrumentele potrivite în funcție de intenția utilizatorului—precum „Programează cafea cu Peter săptămâna viitoare.”

Cu MCP, dacă o altă echipă vrea ca agentul lor să rezerve săli de conferință sau să acceseze alte resurse, trebuie doar să înregistreze acele capabilități în serverul MCP. Nu mai e nevoie să rescrie logica agentului sau să dubleze integrarea. Arhitectura este implicit scalabilă, compozabilă și descoperibilă.

Un avantaj cheie al MCP în context enterprise este compozabilitatea. Serverele pot acționa ele însele ca și clienți pentru alte servere MCP—permițând integrări stratificate și modulare. De exemplu, un server MCP conectat la un topic Kafka poate furniza date de eveniment în timp real mai multor agenți, fără ca fiecare să aibă cod Kafka personalizat. Acest design plug-and-play susține implementări la scară enterprise, unde resursele, instrumentele și integrările evoluează rapid.

Prin adoptarea MCP, companiile obțin:

MCP permite un viitor în care AI-ul enterprise nu este limitat de rigiditatea integrărilor codate manual, ci este împuternicit de o arhitectură flexibilă, compozabilă și scalabilă. Pentru organizațiile care urmăresc să operaționalizeze AI agentic la scară, MCP nu este doar o opțiune tehnică—este o fundație esențială.

Integrarea AI modernă evoluează rapid, necesitând arhitecturi flexibile, scalabile și care să permită interacțiune fără întreruperi între agenții AI și instrumentele sau datele reale. Model Context Protocol (MCP) reprezintă un salt înainte în AI agentic, oferind o arhitectură robustă și descoperibilă, ce depășește simpla încorporare a AI-ului în aplicații desktop. Să vedem cum arhitectura MCP face posibilă construirea sistemelor AI agentice plug-and-play, prin modelul client-server, comunicare versatilă și funcționalități puternice de descoperire.

La bază, MCP folosește o arhitectură clară client-server ce separă responsabilitățile și maximizează modularitatea:

Această separare înseamnă că aplicația gazdă nu trebuie să „încorporeze” toate integrările sau logica instrumentelor. În schimb, poate descoperi, interoga și utiliza dinamic resurse externe prin servere MCP, făcând sistemul extrem de plug-and-play și ușor de întreținut.

MCP suportă două moduri principale de comunicare între client și server:

Conexiuni locale (Standard IO/Pipes):

Conexiuni remote (HTTP, Server Sent Events, JSON RPC):

O caracteristică deosebită a MCP este descoperibilitatea sa nativă, făcând arhitectura agenților AI extrem de dinamică:

Prin acest mecanism, aplicațiile gazdă pot suporta flexibil integrări sau surse de date noi fără modificări de cod—doar „conectând” servere sau instrumente noi.

Mai jos este o reprezentare vizuală simplificată a fluxului de lucru MCP:

+-------------------------------+

| Host Application |

| (runs MCP Client Library) |

+---------------+---------------+

|

| 1. User Prompt

v

+---------------+---------------+

| MCP Client |

+---------------+---------------+

|

| 2. Discover Capabilities (HTTP/Local)

v

+-----------------------------------------------+

| MCP Server |

| (exposes RESTful endpoints, resources, |

| tools, prompts) |

+----------------+------------------------------+

|

+-------------+----------------+

| 3. Provides: |

| - List of resources/tools |

| - Descriptions/schemas |

+------------------------------+

|

v

+-----------------------------------------------+

| Workflow Example: |

| - Client asks LLM: "Which resources/tools?" |

| - LLM responds: "Use resource X, tool Y" |

| - Client fetches resource X, invokes tool Y |

| - Results returned to user |

+-----------------------------------------------+

Cu MCP, integrarea AI trece de la conexiuni statice și codate manual la o arhitectură agentică dinamică, scalabilă și compozabilă. Clienții pot descoperi și folosi noi instrumente sau surse de date la rulare, iar serverele pot fi stivuite sau compuse—aducând adevărata modularitate în sistemele de agenți AI. Această arhitectură nu este doar pentru aplicații desktop de hobby, ci este pregătită pentru soluții enterprise unde flexibilitatea și extensibilitatea sunt critice.

Pe scurt: Arhitectura MCP permite sistemelor AI să fie cu adevărat agentice—capabile să descopere și să invoce instrumente, să acceseze date actualizate sau proprietare și să-și extindă dinamic capabilitățile, totul printr-un protocol standardizat și robust. Aceasta este poarta către noua generație de AI agentic plug-and-play profesional.

Să fim practici și să vedem cum AI agentic, alimentat de Model Context Protocol (MCP), transformă o simplă programare—precum să ieși la cafea cu un prieten—într-un flux plug-and-play fără întreruperi. Această secțiune te poartă printr-un caz de utilizare real, arătând exact cum o aplicație gazdă, un client MCP, un server MCP și un LLM (Large Language Model) colaborează pentru a automatiza și orchestra programări. Vom evidenția compozabilitatea, pluggabilitatea și integrarea dinamică ce fac din MCP o revoluție pentru automatizarea fluxurilor AI.

Imaginează-ți că vrei să creezi o aplicație care programează întâlniri la cafea—fie cu un coleg, un prieten sau o persoană dragă. Iată cum AI agentic, folosind MCP, gestionează fluxul:

Totul începe cu o aplicație gazdă (de exemplu, aplicația ta de programări). Aceasta integrează biblioteca client MCP, care acționează ca punte între aplicația ta și resursele AI agentice.

Clientul MCP inițiază procesul preluând promptul utilizatorului, de exemplu:

„Vreau să merg la cafea cu Peter săptămâna viitoare.”

În acest moment, aplicația gazdă trebuie să interpreteze și să acționeze asupra cererii. Are nevoie de mai mult decât un răspuns text—are nevoie de acțiune reală.

Pentru a afla ce acțiuni sunt posibile, clientul MCP interoghează serverul MCP pentru lista capabilităților, instrumentelor și resurselor disponibile (precum API-uri de calendar, liste cu cafenele locale sau sisteme de rezervare). Totul este descoperibil printr-un endpoint RESTful bine definit, ceea ce înseamnă că instrumente noi pot fi adăugate fără a modifica aplicația de bază.

Clientul poate consulta un fișier de configurare cu URL-urile serverelor înregistrate pentru a ști unde să caute.

Clientul MCP trimite apoi promptul utilizatorului, împreună cu lista resurselor disponibile, către LLM. LLM-ul ajută la alegerea resurselor relevante:

La recomandarea LLM-ului, clientul MCP preia resursa solicitată (de ex. lista cafenelelor locale) de la serverul MCP. Aceste date sunt apoi atașate următorului prompt pentru LLM, oferindu-i contextul necesar pentru a recomanda pași acționabili.

LLM-ul are acum atât intenția utilizatorului, cât și datele de resurse actualizate. Returnează o recomandare precum:

Descrierile și schemele fiecărui instrument sunt oferite LLM-ului sub formă structurată (nu doar text), permițându-i să recomande invocări și parametri specifici.

Clientul MCP preia recomandările LLM-ului și declanșează invocarea instrumentelor necesare:

Aplicația gazdă, datorită arhitecturii MCP, poate conecta sau înlocui instrumente și resurse oricând—fără a rescrie logica de bază.

Iată o diagramă pas cu pas pentru fluxul de programare AI agentic cu MCP:

flowchart TD

A[User Request: "Coffee with Peter next week"] --> B[Host App (with MCP Client)]

B --> C{Discover Capabilities}

C --> D[MCP Server: Returns list of resources/tools]

D --> E[LLM: "Which resources do I need?"]

E --> F[LLM: "Fetch coffee shop directory"]

F --> G[MCP Client: Fetches resource from MCP Server]

G --> H[LLM: Receives user prompt + resource data]

H --> I[LLM: Recommends tool invocation]

I --> J[MCP Client: Executes calendar and reservation tools]

J --> K[Appointment Scheduled!]

Compozabilitate:

Poți construi fluxuri complexe combinând instrumente și resurse independente. Serverul MCP poate acționa și ca client pentru alte servere, înlănțuind capabilități și făcând sistemul extrem de modular.

Pluggabilitate:

Ai nevoie de un instrument nou (căutare restaurante sau alt calendar)? Doar înregistrează-l la serverul MCP—fără să refactorezi aplicația.

Integrare dinamică:

La rulare, sistemul descoperă și orchestrează dinamic componentele necesare pe baza intenției utilizatorului și a resurselor disponibile. LLM-ul gestionează logica, iar aplicația ta rămâne ușor de întreținut și pregătită pentru viitor.

Cu MCP, AI-ul agentic depășește asistenții bazate pe chat static. Primești un motor de flux de lucru „viu”, care integrează activ datele și instrumentele tale enterprise. Programarea unei cafele, a întâlnirilor sau orchestrarea unor automatizări complexe devin toate plug-and-play, compozabile și scalabile.

Pe scurt: MCP îți permite să construiești aplicații AI agentice ca un profesionist, făcând automatizarea fluxurilor AI practică, modulară și pregătită pentru enterprise.

**Ești gata să încer

Model Context Protocol (MCP) este un protocol deschis conceput pentru a standardiza accesul la context și instrumente pentru aplicații AI agentice, permițând integrarea dinamică a agenților AI cu resurse și fluxuri de lucru diverse.

MCP permite agenților AI să descopere, să acceseze și să invoce instrumente externe, API-uri și surse de date în mod dinamic, transformând interacțiunile statice LLM în fluxuri de lucru scalabile și acționabile care automatizează sarcini și se integrează fără probleme cu sistemele enterprise.

Utilizarea MCP pentru integrarea AI oferă beneficii precum descoperirea dinamică a resurselor, arhitectură modulară, reducerea duplicării efortului și posibilitatea de a scala fluxurile de lucru AI în echipe și aplicații fără a codifica integrarea.

Poți începe să folosești MCP și AI agentic explorând platforma Flowhunt, care oferă instrumente pentru a construi, adapta și scala soluții AI agentice folosind Model Context Protocol. Creează-ți un cont gratuit pentru a începe integrarea fluxurilor de lucru AI în aplicațiile tale.

Viktor Zeman este co-proprietar al QualityUnit. Chiar și după 20 de ani de conducere a companiei, rămâne în primul rând un inginer software, specializat în AI, SEO programatic și dezvoltare backend. A contribuit la numeroase proiecte, inclusiv LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab și multe altele.

Descoperă puterea AI-ului agentic cu integrarea Model Context Protocol de la Flowhunt. Construiește fluxuri de lucru AI dinamice și scalabile care accesează resurse diverse și automatizează sarcinile fără efort.

Protocolul de Context al Modelului (MCP) este o interfață standard deschisă care permite Modelelor Lingvistice Mari (LLM) să acceseze în siguranță și în mod con...

Exemplu rapid despre cum să dezvolți propriul tău server MCP cu Python.

Află ce sunt serverele MCP (Model Context Protocol), cum funcționează și de ce revoluționează integrarea AI. Descoperă cum MCP simplifică conectarea agenților A...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.