Exfiltrarea Datelor (Context AI)

În securitatea AI, exfiltrarea datelor se referă la atacuri în care datele sensibile accesibile unui chatbot AI — PII, credențiale, informații de business intel...

Un ghid cuprinzător pentru integrarea în siguranță a platformelor AI cu baza ta de date folosind gateway-uri API, criptare, controale de acces și strategii de monitorizare.

Practici cheie de securitate pentru expunerea bazelor de date către AI:

Expunerea sigură a bazei de date înseamnă să permiți sistemelor AI să acceseze datele de care au nevoie menținând controale stricte asupra a ce date sunt accesate, cine (sau ce) le accesează, când are loc accesul și cum este monitorizat și logat acest acces. Este fundamental diferită de a deschide pur și simplu baza ta de date către internet sau de a oferi platformelor AI credențiale de acces direct la baza de date.

Când vorbim despre expunerea unei baze de date către platforme AI, descriem o decizie arhitecturală deliberată de a crea o interfață controlată între datele tale și sistemele AI externe. Această interfață acționează ca un punct de control de securitate, impunând autentificare, autorizare, criptare și logare de audit la fiecare pas. Scopul este de a crea ceea ce profesioniștii în securitate numesc un “singur punct de control”—un loc centralizat unde tot accesul poate fi monitorizat, controlat și validat.

Provocarea este că platformele AI au adesea nevoie de acces larg la seturi diverse de date pentru a funcționa eficient. Un model de machine learning poate avea nevoie să analizeze simultan comportamentul clienților, istoricul tranzacțiilor și informații despre produse. Un sistem AI generativ poate avea nevoie să caute în mai multe tabele pentru a răspunde la întrebări complexe. Totuși, a acorda acest acces fără măsuri de protecție adecvate îți poate expune organizația la breșe de date, încălcări de conformitate și amenințări interne.

Argumentul de business pentru expunerea sigură a bazelor de date către AI este convingător. Organizațiile care integrează cu succes AI cu infrastructura lor de date obțin avantaje competitive semnificative: luarea mai rapidă a deciziilor, insight-uri automate, experiențe îmbunătățite pentru clienți și eficiență operațională. Însă riscurile sunt la fel de mari.

Breșele de date care implică baze de date expuse sunt din ce în ce mai frecvente și costisitoare. Costul mediu al unei breșe de date în 2024 a depășit 4.45 milioane de dolari, incidentele legate de baze de date reprezentând o parte substanțială a acestor pierderi. Când breșa implică date personale supuse unor reglementări precum GDPR sau CCPA, daunele financiare și de reputație cresc dramatic. Dincolo de costurile directe, organizațiile se confruntă cu întreruperi operaționale, pierderea încrederii clienților și potențială răspundere legală.

Provocarea se intensifică atunci când sunt implicate sisteme AI. Modelele AI pot memora involuntar date sensibile din antrenament, făcându-le recuperabile prin atacuri de tip prompt injection sau tehnici de extragere a modelului. Agenții AI cu acces la bază de date pot fi manipulați prin prompturi special concepute pentru a executa interogări neintenționate sau pentru a expune informații confidențiale. Aceste vectori de atac noi necesită abordări de securitate care depășesc protecția tradițională a bazelor de date.

Mai mult, atenția reglementatorilor asupra AI crește rapid. Autoritățile de protecție a datelor din întreaga lume emit ghiduri despre cum trebuie gestionate datele personale atunci când sunt utilizate sisteme AI. Conformitatea cu GDPR, CCPA, HIPAA și reglementări AI emergente presupune demonstrarea faptului că ai măsuri de protecție adecvate înainte de a expune orice date către platforme AI.

Înainte de a implementa orice strategie de expunere a bazei de date către platforme AI, ai nevoie de o imagine clară a infrastructurii tale de securitate și a peisajului tău de date. Această evaluare trebuie să răspundă la câteva întrebări critice:

Ce date ai de fapt? Realizează un inventar complet al datelor și o clasificare. Împarte datele în funcție de nivelul de sensibilitate: publice, interne, confidențiale și restricționate. Identifică ce date conțin informații personale identificabile (PII), date de card (PCI), informații de sănătate (PHI) sau alte tipuri de date reglementate. Această clasificare devine fundamentul pentru toate deciziile ulterioare de control al accesului.

Ce controale de securitate ai în prezent? Documentează măsurile existente de securitate pentru bazele de date: mecanisme de autentificare, statusul criptării (în tranzit și la repaus), segmentarea rețelei, proceduri de backup și recuperare, precum și capabilități de audit logging. Identifică lacunele unde lipsesc controale sau sunt învechite.

Ce obligații de conformitate ai? Revizuiește reglementările aplicabile industriei și geografiei tale. Dacă gestionezi date personale, conformitatea cu GDPR este probabil obligatorie. Dacă ești în domeniul sănătății, se aplică cerințele HIPAA. Organizațiile din servicii financiare trebuie să ia în considerare PCI-DSS. Înțelegerea acestor obligații îți modelează arhitectura de securitate.

Care este toleranța ta la risc? Organizațiile diferă în ceea ce privește apetitul la risc. Un furnizor de servicii medicale care gestionează date despre pacienți are o toleranță la risc mult mai mică decât o companie SaaS care analizează metrici anonimizate. Toleranța la risc ar trebui să influențeze cât de restrictive trebuie să fie controalele tale de acces.

Cea mai importantă decizie arhitecturală pe care o vei lua este să nu expui niciodată baza de date direct către platforme AI. În schimb, implementează un gateway API securizat care să stea între baza ta de date și sistemele externe. Acest gateway devine punctul unic de control pentru tot accesul la baza de date.

Un gateway API îndeplinește mai multe funcții esențiale. În primul rând, oferă un strat de abstractizare care decuplează platforma AI de schema bazei tale de date. Dacă structura bazei tale de date se schimbă, trebuie doar să actualizezi API-ul, nu să renegociezi accesul cu fiecare platformă AI. În al doilea rând, îți permite să implementezi politici de securitate consistente pentru toate cererile de acces. În al treilea rând, creează o locație centralizată pentru monitorizarea, logarea și alertarea asupra activității suspecte.

Când alegi sau dezvolți un gateway API, caută soluții care suportă proxy-ing conștient de identitate (IAP). Un gateway IAP autentifică fiecare cerere înainte ca aceasta să ajungă la baza de date, asigurându-se că doar sistemele autorizate pot accesa datele. Trebuie să suporte multiple metode de autentificare, inclusiv OAuth 2.0, tokenuri JWT, mutual TLS (mTLS) și chei API. Gateway-ul trebuie să impună, de asemenea, limitarea ratei de acces pentru a preveni abuzurile și să valideze cererile pentru a bloca interogările defectuoase sau suspecte.

Opțiuni populare includ soluții cloud-native precum AWS API Gateway cu integrare IAM, Identity-Aware Proxy de la Google Cloud, Azure API Management, sau soluții specializate de acces la baze de date precum Hoop sau DreamFactory. Toate au punctul comun de a crea un strat de acces controlat.

Odată ce ai un gateway API implementat, următorul strat critic este implementarea unor mecanisme robuste de autentificare și autorizare. Aceste două concepte sunt adesea confundate dar servesc scopuri diferite: autentificarea verifică cine (sau ce) face o cerere, iar autorizarea stabilește ce are voie să facă acea entitate.

Pentru utilizatorii umani care accesează sisteme AI ce interacționează cu baza ta de date, implementează autentificare multi-factor (MFA). Aceasta combină de obicei ceva ce știi (o parolă), ceva ce ai (un telefon sau token hardware) și ceva ce ești (date biometrice). MFA reduce semnificativ riscul compromiterii contului, care este punctul de intrare pentru multe breșe de date.

Pentru sistemele AI și service principals, folosește credențiale puternice, rotite automat. Nu salva niciodată credențiale de bază de date direct în cod sau fișiere de configurare. Folosește variabile de mediu, sisteme de management al secretelor (precum HashiCorp Vault, AWS Secrets Manager sau Azure Key Vault) sau sisteme native de credențiale din cloud care rotesc automat credențialele la un interval stabilit.

Implementează autentificare pe bază de certificate acolo unde este posibil. Autentificarea mutuală TLS (mTLS), unde atât clientul cât și serverul se autentifică reciproc cu certificate digitale, oferă o securitate superioară față de cea bazată pe parolă. Fiecare platformă AI sau serviciu primește un certificat unic ce trebuie prezentat pentru acces la gateway-ul API.

Controlul de acces bazat pe roluri (RBAC) este cel mai comun model de autorizare. Definiești roluri (precum “AI_Analytics_Reader” sau “ML_Training_Agent”) și atribui permisiuni acestor roluri. Fiecărui sistem AI i se atribuie unul sau mai multe roluri și poate efectua doar acțiunile permise acelor roluri. RBAC este simplu de implementat și de înțeles, fiind ideal pentru majoritatea organizațiilor.

Controlul de acces bazat pe atribute (ABAC) este mai sofisticat și flexibil. În loc să atribui roluri, definești politici bazate pe atributele cererii: departamentul utilizatorului, nivelul de clasificare al datelor, ora, locația geografică a cererii, scopul accesului și alți factori. ABAC permite control mai granular, dar necesită politici atent concepute.

Implementează principiul celui mai mic privilegiu: acordă fiecărui sistem AI doar permisiunile minime necesare pentru funcționare. Dacă un sistem AI are nevoie doar să citească nume și adrese de email ale clienților, nu îi acorda acces la informații de plată sau CNP. Dacă are nevoie doar de citire, nu îi oferi permisiuni de scriere sau ștergere.

Chiar și cu autentificare și autorizare puternică, trebuie să protejezi datele în sine. Aceasta implică două strategii complementare: criptarea și mascarea datelor.

Criptarea în tranzit protejează datele pe măsură ce se deplasează între baza ta de date și platforma AI. Folosește TLS 1.2 sau mai nou pentru toate conexiunile. Astfel, chiar dacă traficul de rețea este interceptat, datele rămân ilizibile fără cheile de criptare. Majoritatea gateway-urilor API și a sistemelor moderne de baze de date suportă TLS implicit, dar verifică să fie activat și configurat corect.

Criptarea la repaus protejează datele stocate în baza de date. Chiar dacă un atacator capătă acces neautorizat la fișierele bazei de date sau la backup-uri, nu poate citi datele fără cheile de criptare. Majoritatea bazelor de date moderne suportă criptare transparentă a datelor (TDE) sau funcții similare. Activează această funcție și asigură gestionarea sigură a cheilor.

Gestionarea cheilor este esențială. Nu stoca niciodată cheile de criptare în același loc cu datele criptate. Folosește un serviciu dedicat de gestionare a cheilor (KMS) care controlează accesul la chei separat de baza de date. Rotește cheile de criptare regulat—cel puțin anual, mai des pentru date foarte sensibile. Implementează versionarea cheilor astfel încât cheile vechi să poată fi folosite la decriptarea datelor istorice.

Mascarea datelor presupune înlocuirea valorilor sensibile cu valori obfuscate sau sintetice. De exemplu, CNP-ul unui client poate fi mascat ca “XXX-XX-1234”, afișând doar ultimele patru cifre. Un număr de card poate fi mascat ca “--****-4567”. Astfel, sistemele AI pot lucra cu date ce păstrează structura și distribuția celor reale, fără a expune valorile sensibile.

Mascarea dinamică aplică reguli de mascare la momentul interogării, în funcție de rolul utilizatorului și sensibilitatea datelor. Un reprezentant de relații clienți poate vedea nume și numere de telefon complete, în timp ce un sistem de analiză AI vede doar versiuni mascate. Această abordare e mai flexibilă decât mascarea statică deoarece poate aplica reguli diferite pentru utilizatori diferiți.

Implementează mascarea la nivel de coloană pentru cele mai sensibile date. Identifică coloanele ce conțin PII, informații de plată, date medicale sau alte informații reglementate și aplică reguli de mascare. Multe baze de date suportă asta nativ, sau poți implementa la nivelul stratului gateway API.

Să analizăm cum funcționează RBAC într-un scenariu practic. Imaginează-ți că ai o bază de date cu informații despre clienți, istoric de tranzacții și date despre produse. Vrei să expui această bază către trei sisteme AI diferite: un motor de recomandări, un sistem de detecție a fraudelor și o platformă de analiză.

| Sistem AI | Acces necesar | Rol recomandat | Permisiuni specifice |

|---|---|---|---|

| Motor de recomandări | Profiluri clienți, istoric achiziții | AI_RECOMMENDATIONS_READER | SELECT pe tabelele customers, orders, products; fără acces la metode de plată sau date de contact personale |

| Detecție fraudă | Detalii tranzacții, istoric clienți | AI_FRAUD_DETECTOR | SELECT pe transactions, customers, accounts; acces la informații de plată, dar nu la adrese de email clienți |

| Platformă de analiză | Date agregate despre clienți | AI_ANALYTICS_READER | SELECT doar pe vizualizări agregate; fără acces la înregistrări individuale sau detalii tranzacții |

Fiecare rol are permisiuni specifice care limitează ce date pot fi accesate și ce operațiuni pot fi efectuate. Motorul de recomandări nu poate vedea informații de plată pentru că nu are nevoie. Sistemul de detecție a fraudelor poate vedea tranzacții, dar nu emailuri. Platforma de analiză vede doar date agregate, nu înregistrări individuale.

Astfel, dacă un sistem AI este compromis, atacatorul are acces limitat doar la datele necesare acelui sistem. Raza de acțiune a unui incident de securitate este minimizată.

Chiar și cu controale preventive solide, trebuie să poți detecta și răspunde la incidente de securitate. Aceasta presupune monitorizare cuprinzătoare, audit detaliat și detecție automată a amenințărilor.

Activează logare detaliată pentru tot accesul la baza de date. Fiecare interogare executată de un sistem AI trebuie logată, incluzând:

Stochează logurile de audit într-o locație securizată, imuabilă și separată de baza de date primară. Furnizorii cloud oferă servicii de logare gestionată (AWS CloudTrail, Google Cloud Logging, Azure Monitor). Păstrează logurile de audit cel puțin un an, mai mult pentru date foarte sensibile.

Implementează monitorizare în timp real care detectează modele suspecte de acces la bază. Setează alerte pentru:

Instrumentele moderne de monitorizare pot identifica automat anomalii. Soluții ca Imperva, Satori și altele oferă detecție de amenințări alimentată de AI care învață tipare normale de acces și alertează la deviații.

Dezvoltă un plan de răspuns la incidente specific incidentelor de securitate a bazelor de date implicând sisteme AI. Planul trebuie să includă:

Pentru organizațiile cu seturi mari și diverse de date, ia în calcul segmentarea datelor pentru a reduce expunerea. Aceasta poate include:

Segmentare de rețea: Plasează baza de date pe un segment separat cu acces restricționat. Doar gateway-ul API poate accesa direct baza de date. Platformele AI accesează baza doar prin gateway, niciodată direct.

Segmentare de bază de date: Dacă baza ta conține date sensibile și nesensibile, stochează-le în baze separate. Astfel, dacă un sistem AI are nevoie doar de date nesensibile, i se acordă acces doar la acea bază.

Sharding de date: Pentru seturi foarte mari de date, împarte-le în bucăți mai mici (shards) după un criteriu (ID client, regiune etc.). Oferă sistemelor AI acces doar la shards necesare.

Date sintetice: Pentru dezvoltare și testare, folosește date sintetice care imită structura și distribuția celor reale, dar nu conțin informații sensibile. Sistemele AI pot fi antrenate și testate pe date sintetice, reducând nevoia de a expune date reale.

Expunerea bazei de date către platforme AI are implicații majore de conformitate. Diverse reglementări impun cerințe diferite:

GDPR (Regulamentul General privind Protecția Datelor): Dacă procesezi date personale ale rezidenților UE, se aplică GDPR. Cerințe cheie includ:

CCPA (California Consumer Privacy Act): Dacă procesezi date personale ale rezidenților din California, se aplică CCPA. Cerințe cheie:

HIPAA (Health Insurance Portability and Accountability Act): Dacă gestionezi informații medicale protejate, se aplică HIPAA. Cerințe cheie:

Standarde specifice industriei: În funcție de industrie, se pot aplica:

Înainte de a expune orice date către platforme AI, realizează o evaluare de conformitate pentru a înțelege ce reglementări se aplică datelor tale și ce cerințe specifice impun.

Gestionarea accesului securizat la bazele de date pentru platforme AI presupune coordonarea mai multor sisteme și impunerea unor politici consistente în toată organizația. Aici platforme de automatizare precum FlowHunt devin neprețuite.

FlowHunt permite construirea de fluxuri automatizate care integrează în siguranță sistemele AI cu infrastructura bazei tale de date. În loc să gestionezi manual cheile API, să monitorizezi accesul și să coordonezi între echipe, FlowHunt oferă o platformă unificată pentru:

Orchestrarea fluxurilor: Definește fluxuri complexe cu interogări la baze de date, procesare AI și transformare de date. FlowHunt asigură orchestrarea, garantând execuția sigură și în ordine corectă a fiecărui pas.

Integrare cu controlul accesului: FlowHunt se integrează cu sistemele tale de management al identității și accesului, impunând automat RBAC și principiul celui mai mic privilegiu în toate fluxurile AI.

Audit și conformitate: FlowHunt menține loguri de audit complete ale tuturor execuțiilor de flux, inclusiv ce date au fost accesate, când și de către cine. Aceste loguri susțin conformitatea cu GDPR, CCPA, HIPAA și alte reglementări.

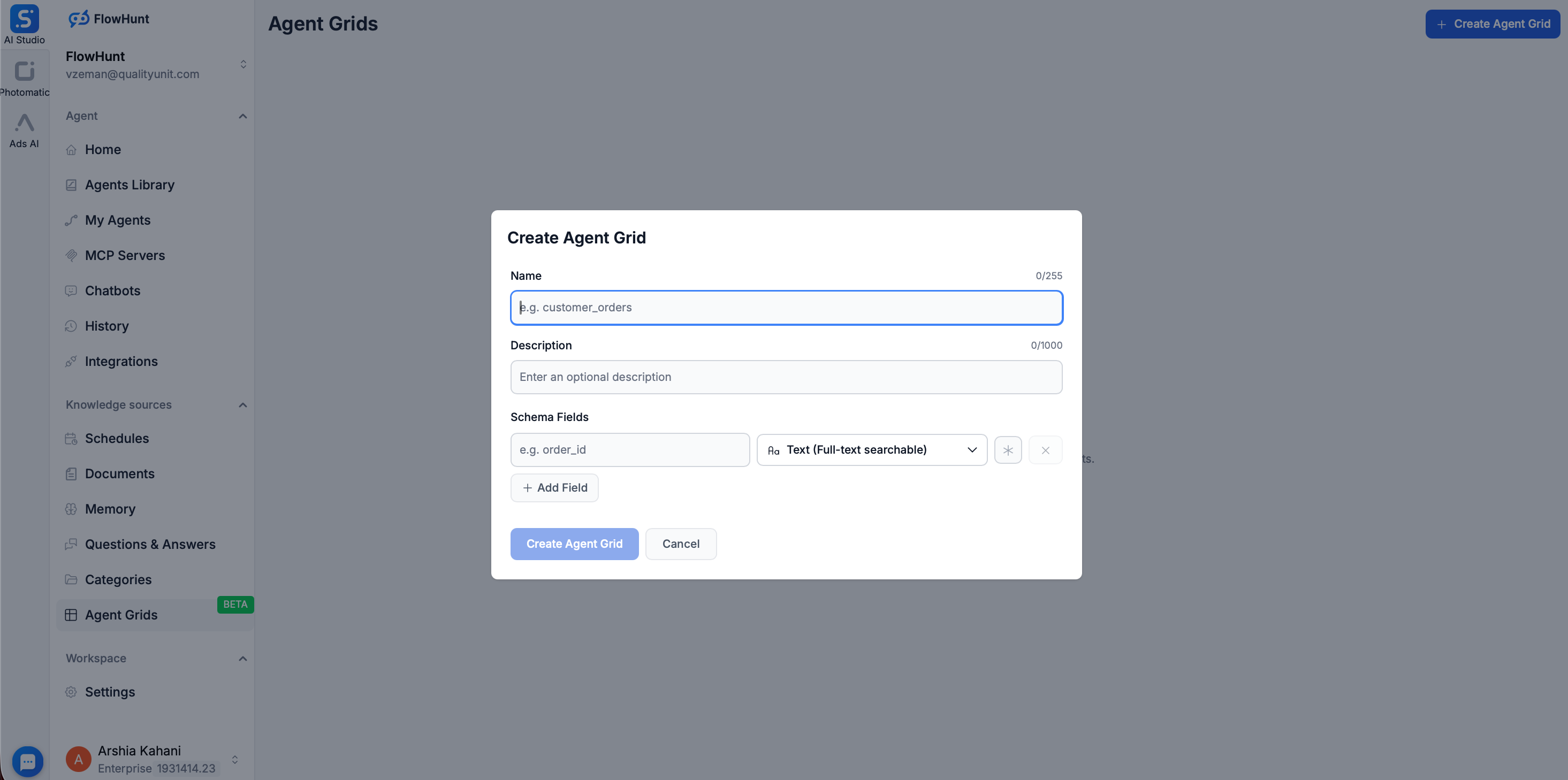

Pentru organizațiile care doresc un strat suplimentar de izolare între modelele AI și bazele de date de producție, FlowHunt oferă funcționalitatea Grid. Grid permite utilizatorilor să creeze o bază de date interogabilă încărcând simplu fișiere structurate, precum CSV-uri.

Odată ce un CSV este încărcat în Grid, FlowHunt folosește Elasticsearch pentru indexarea datelor, transformând un fișier static într-o Sursă de Cunoaștere dinamică și rapidă. Această abordare oferă avantaje de securitate semnificative:

Prin utilizarea Grid și a capabilităților de workflow din FlowHunt, reduci complexitatea menținerii controalelor de securitate și asiguri aplicarea consecventă a politicilor în toată organizația.

Implementarea expunerii sigure a bazei de date către platforme AI este un proces în mai multe etape. Iată o foaie de parcurs practică:

Pasul 1: Evaluează starea actuală

Pasul 2: Proiectează arhitectura

Pasul 3: Implementează controalele de bază

Pasul 4: Implementează protecția datelor

Pasul 5: Implementează monitorizare și audit

Pasul 6: Testează și validează

Pasul 7: Operaționalizează și menține

Pe măsură ce implementezi expunerea sigură a bazei de date, fii atent la aceste greșeli uzuale:

Expunere directă a bazei de date: Nu expune niciodată baza de date direct la internet sau la platforme AI fără un gateway API. Acesta este cel mai mare risc de securitate.

Permisiuni prea largi: Acordarea de permisiuni peste necesar sistemelor AI încalcă principiul celui mai mic privilegiu. Pornește de la minim și extinde doar la nevoie.

Criptare insuficientă: Criptarea doar în tranzit sau doar la repaus lasă datele vulnerabile. Implementează criptare la ambele niveluri.

Gestionare slabă a credențialelor: Salvarea credențialelor în cod, stocarea lor în version control sau neschimbarea periodică reprezintă un risc major.

Monitorizare insuficientă: Controale preventive solide fără monitorizare înseamnă că nu vei ști dacă acestea au fost ocolite.

Ignorarea conformității: A lăsa considerentele de reglementare pentru final este costisitor. Include conformitatea de la început.

Testare insuficientă: Implementarea controalelor fără testare riguroasă înseamnă că pot să nu funcționeze corect când ai nevoie.

Pe măsură ce sistemele AI evoluează, apar noi vectori de atac. Două amenințări deosebit de preocupante sunt prompt injection și extragerea modelului.

Prompt Injection: Un atacator concepe un prompt care păcălește sistemul AI să execute acțiuni neintenționate. De exemplu, un prompt poate determina AI-ul să ignore controalele de acces și să returneze date la care nu ar trebui să aibă acces. Pentru a te apăra:

Extragerea modeului: Un atacator interacționează cu modelul AI pentru a extrage informații despre datele de antrenament sau structura internă. Pentru protecție:

Expunerea sigură a bazei de date către platforme AI nu este doar posibilă—devine tot mai necesară pentru organizațiile care vor să valorifice AI-ul fără a compromite cel mai valoros activ: datele. Cheia este abordarea în straturi: autentificare și autorizare puternică, criptare, mascarea datelor, monitorizare cuprinzătoare și testare regulată.

Începe cu fundamentele: nu expune baza de date direct, folosește întotdeauna un gateway API, implementează autentificare și autorizare puternică, criptează datele. Construiește de aici, adăugând mascarea datelor, monitorizare, controale de conformitate potrivite profilului tău de risc și obligațiilor legale.

Amintește-ți că securitatea nu este o implementare un

Arshia este Inginer de Fluxuri AI la FlowHunt. Cu o pregătire în informatică și o pasiune pentru inteligența artificială, el este specializat în crearea de fluxuri eficiente care integrează instrumente AI în sarcinile de zi cu zi, sporind productivitatea și creativitatea.

Simplifică-ți fluxurile de date alimentate de AI menținând standarde de securitate și conformitate la nivel enterprise.

În securitatea AI, exfiltrarea datelor se referă la atacuri în care datele sensibile accesibile unui chatbot AI — PII, credențiale, informații de business intel...

Chatbot-urile AI cu acces la date sensibile sunt ținte principale pentru exfiltrarea datelor. Aflați cum atacatorii extrag PII, credențiale și informații de bus...

Validarea datelor în AI se referă la procesul de evaluare și asigurare a calității, acurateței și fiabilității datelor utilizate pentru antrenarea și testarea m...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.