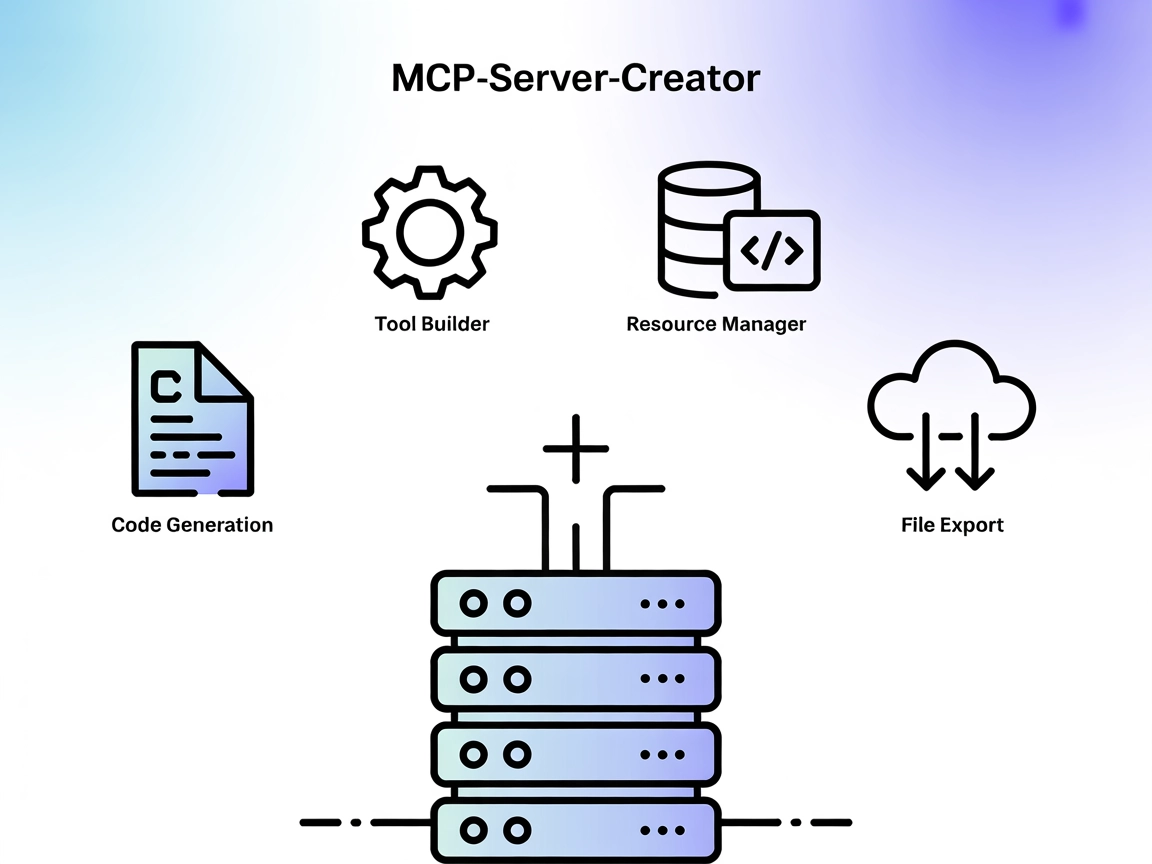

MCP-Server-Creator MCP Server

MCP-Server-Creator este un meta-server care permite crearea și configurarea rapidă a unor noi servere Model Context Protocol (MCP). Cu generare dinamică de cod,...

Rulează cod Python, instalează dependențe și gestionează medii izolate direct în fluxurile tale FlowHunt cu MCP Code Executor MCP Server.

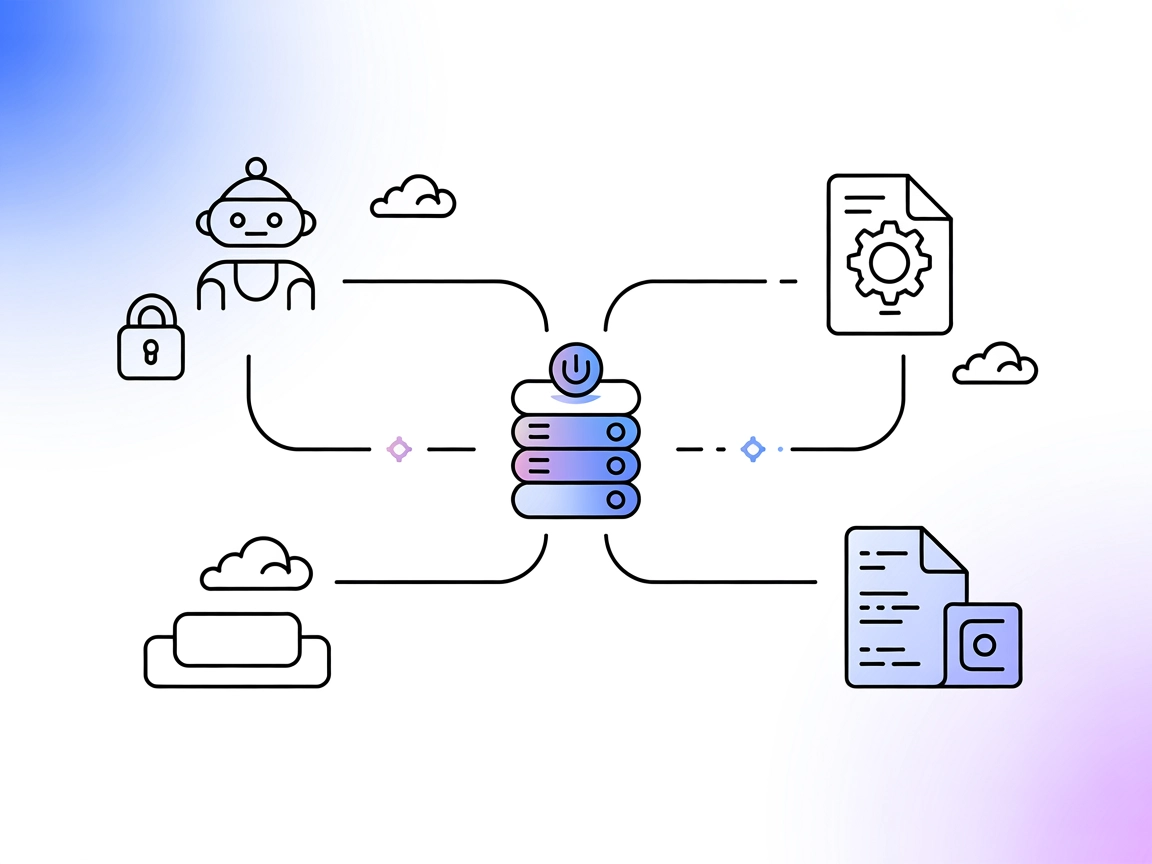

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

MCP Code Executor este un server MCP (Model Context Protocol) care permite modelelor lingvistice (LLM) să execute cod Python într-un mediu Python dedicat, precum Conda, virtualenv sau UV virtualenv. Prin conectarea asistenților AI la medii Python reale și executabile, le oferă posibilitatea de a realiza o gamă largă de sarcini de dezvoltare ce necesită execuție de cod, management de biblioteci și configurare dinamică a mediului. Acest server suportă generarea incrementală de cod pentru a depăși limitele de token, permite instalarea dinamică a dependențelor și facilitează configurarea la rulare a mediului de execuție. Dezvoltatorii pot folosi acest instrument pentru a automatiza evaluarea codului, a experimenta cu pachete noi și a gestiona calculele într-un mediu controlat și sigur.

Nu există șabloane explicite de prompt listate în repository sau documentație.

Nu sunt descrise resurse specifice în repository sau documentație.

{

"mcpServers": {

"mcp-code-executor": {

"command": "node",

"args": [

"/path/to/mcp_code_executor/build/index.js"

],

"env": {

"CODE_STORAGE_DIR": "/path/to/code/storage",

"ENV_TYPE": "conda",

"CONDA_ENV_NAME": "your-conda-env"

}

}

}

}

{

"mcpServers": {

"mcp-code-executor": {

"env": {

"CODE_STORAGE_DIR": "/path/to/code/storage",

"ENV_TYPE": "conda",

"CONDA_ENV_NAME": "your-conda-env",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

},

"inputs": {

"apiKey": "${MY_SECRET_API_KEY}"

}

}

}

}

{

"mcpServers": {

"mcp-code-executor": {

"command": "node",

"args": [

"/path/to/mcp_code_executor/build/index.js"

],

"env": {

"CODE_STORAGE_DIR": "/path/to/code/storage",

"ENV_TYPE": "conda",

"CONDA_ENV_NAME": "your-conda-env"

}

}

}

}

{

"mcpServers": {

"mcp-code-executor": {

"command": "node",

"args": [

"/path/to/mcp_code_executor/build/index.js"

],

"env": {

"CODE_STORAGE_DIR": "/path/to/code/storage",

"ENV_TYPE": "conda",

"CONDA_ENV_NAME": "your-conda-env"

}

}

}

}

{

"mcpServers": {

"mcp-code-executor": {

"command": "node",

"args": [

"/path/to/mcp_code_executor/build/index.js"

],

"env": {

"CODE_STORAGE_DIR": "/path/to/code/storage",

"ENV_TYPE": "conda",

"CONDA_ENV_NAME": "your-conda-env"

}

}

}

}

Notă: Poți folosi și Docker. Dockerfile-ul oferit este testat pentru tipul de mediu

venv-uv:

{

"mcpServers": {

"mcp-code-executor": {

"command": "docker",

"args": [

"run",

"-i",

"--rm",

"mcp-code-executor"

]

}

}

}

Folosirea MCP în FlowHunt

Pentru a integra servere MCP în workflow-ul tău FlowHunt, începe prin a adăuga componenta MCP în flux și conecteaz-o la agentul AI:

Fă click pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurare MCP de sistem, introdu detaliile serverului MCP folosind acest format JSON:

{

"mcp-code-executor": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI poate folosi MCP-ul ca instrument cu acces la toate funcțiile și capabilitățile sale. Nu uita să schimbi “mcp-code-executor” cu numele real al serverului tău MCP și să înlocuiești URL-ul cu cel al serverului tău MCP.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | |

| Lista de Prompt-uri | ⛔ | Nu s-au găsit șabloane de prompt |

| Lista de Resurse | ⛔ | Nu sunt descrise resurse explicite |

| Lista de Instrumente | ✅ | execute_code, install_dependencies, check_installed_packages |

| Securizarea cheilor API | ✅ | Exemplu oferit cu env inputs |

| Suport pentru sampling (mai puțin relevant) | ⛔ | Nespecificat |

Acest server MCP oferă funcționalitate esențială și robustă pentru execuția de cod cu integrare LLM, împreună cu instrucțiuni clare de configurare și instrumente utile. Totuși, lipsesc șabloanele de prompt, resurse explicite și informații despre roots sau suport pentru sampling. Pentru un MCP axat pe executarea codului, este foarte solid, având un scor ridicat pentru utilitate practică și ușurință în integrare, dar pierde câteva puncte din cauza lipsei unor funcții MCP avansate și a documentației complete.

| Are LICENȚĂ | ✅ (MIT) |

|---|---|

| Are cel puțin un instrument | ✅ |

| Număr Forks | 25 |

| Număr Stars | 144 |

Este un server Model Context Protocol (MCP) care permite modelelor lingvistice să execute cod Python în medii sigure și izolate (precum Conda sau venv), să gestioneze dependențele și să configureze mediul de rulare. Ideal pentru evaluarea codului, data science, fluxuri automatizate și configurare dinamică a mediului cu FlowHunt.

Oferă instrumente pentru executarea codului Python (`execute_code`), instalarea dinamică a dependențelor (`install_dependencies`) și verificarea pachetelor instalate (`check_installed_packages`).

Adaugă MCP Code Executor ca un component MCP în fluxul tău și configurează-l cu URL-ul serverului și metoda de transport. Astfel, agenții AI pot folosi capabilitățile de execuție a codului și gestionare a mediului direct în FlowHunt.

Da, serverul permite rularea codului în medii izolate Conda sau virtualenv, asigurând reproductibilitate și prevenind conflictele între dependențe.

Da, serverul poate executa cod incremental, ceea ce e util pentru gestionarea codului care depășește limitele de token ale LLM-urilor.

Da, poți folosi Dockerfile-ul oferit și configura serverul MCP să ruleze într-un container Docker pentru izolare suplimentară.

Îmbunătățește-ți fluxurile cu execuție securizată și automată de cod Python. Integrează MCP Code Executor MCP Server și deblochează fluxuri dinamice pentru data science, automatizare și altele.

MCP-Server-Creator este un meta-server care permite crearea și configurarea rapidă a unor noi servere Model Context Protocol (MCP). Cu generare dinamică de cod,...

Serverul pydanticpydantic-aimcp-run-python MCP face legătura între asistenții AI și medii sigure și controlate de execuție a codului Python. Permite scripting P...

Serverul Coda MCP oferă o modalitate standardizată pentru ca asistenții AI să interacționeze cu platforma Coda, permițând interogări de documente, automatizarea...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.