Čo je Model Context Protocol (MCP)? Kľúč k agentickej AI integrácii

Agentická AI nanovo definuje automatizáciu pracovných procesov vďaka Model Context Protocol (MCP), ktorý umožňuje škálovateľnú, dynamickú integráciu AI agentov ...

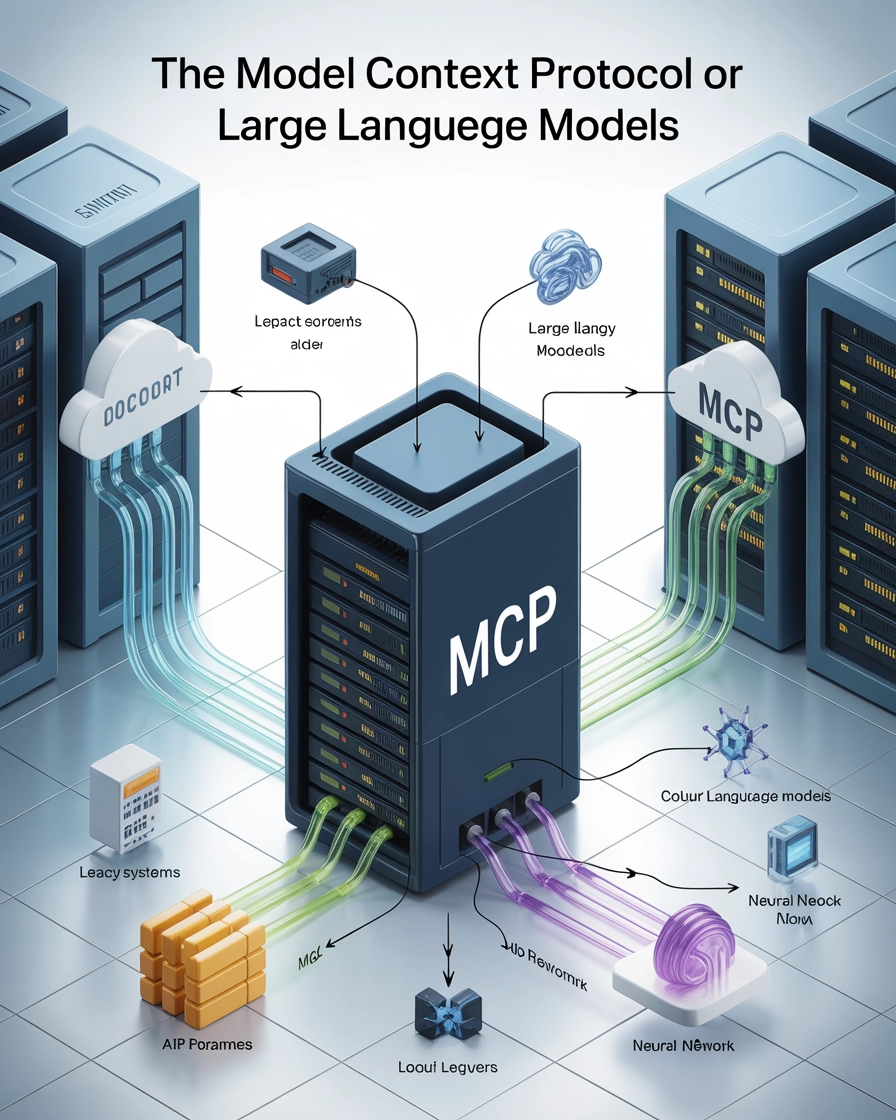

Model Context Protocol (MCP) je otvorené štandardizované rozhranie, ktoré umožňuje veľkým jazykovým modelom (LLM) bezpečne a konzistentne pristupovať k externým dátovým zdrojom, nástrojom a možnostiam. Zavádza štandardizovanú komunikačnú vrstvu medzi AI aplikáciami a rôznymi poskytovateľmi kontextu, pričom slúži ako „USB-C“ pre AI systémy.

MCP využíva klient-server architektúru:

MCP definuje tri základné primitíva, ktoré tvoria stavebné bloky protokolu:

Zdroje predstavujú dáta a obsah, ktoré MCP servery sprístupňujú LLM.

Ukážka použitia: MCP server sprístupňujúci log súbor ako zdroj s URI file:///logs/app.log

Výzvy sú preddefinované šablóny alebo pracovné postupy, ktoré servery ponúkajú na usmernenie interakcií LLM.

Ukážka použitia: Výzva na generovanie git commit správy, ktorá akceptuje zmeny v kóde ako vstup

Nástroje sprístupňujú vykonateľné funkcie, ktoré môže LLM vyvolať (zvyčajne so súhlasom používateľa) na vykonanie akcie.

Ukážka použitia: Kalkulačka, ktorá vykonáva matematické operácie na vstupoch poskytnutých modelom

// Server sprístupňujúci jeden log súbor ako zdroj

const server = new Server({ /* config */ }, { capabilities: { resources: {} } });

// Vypísanie dostupných zdrojov

server.setRequestHandler(ListResourcesRequestSchema, async () => {

return {

resources: [

{

uri: "file:///logs/app.log",

name: "Aplikačné logy",

mimeType: "text/plain"

}

]

};

});

// Poskytnutie obsahu zdroja

server.setRequestHandler(ReadResourceRequestSchema, async (request) => {

if (request.params.uri === "file:///logs/app.log") {

const logContents = await readLogFile();

return {

contents: [{

uri: request.params.uri,

mimeType: "text/plain",

text: logContents

}]

};

}

throw new Error("Zdroj nebol nájdený");

});

const server = new Server({ /* config */ }, { capabilities: { tools: {} } });

// Vypísanie dostupných nástrojov

server.setRequestHandler(ListToolsRequestSchema, async () => {

return {

tools: [{

name: "calculate_sum",

description: "Sčíta dve čísla",

inputSchema: {

type: "object",

properties: {

a: { type: "number", description: "Prvé číslo" },

b: { type: "number", description: "Druhé číslo" }

},

required: ["a", "b"]

},

annotations: {

title: "Spočítať súčet",

readOnlyHint: true,

openWorldHint: false

}

}]

};

});

// Spracovanie vykonania nástroja

server.setRequestHandler(CallToolRequestSchema, async (request) => {

if (request.params.name === "calculate_sum") {

try {

const { a, b } = request.params.arguments;

if (typeof a !== 'number' || typeof b !== 'number') {

throw new Error("Neplatný vstup: 'a' a 'b' musia byť čísla.");

}

const sum = a + b;

return {

content: [{ type: "text", text: String(sum) }]

};

} catch (error: any) {

return {

isError: true,

content: [{ type: "text", text: `Chyba pri výpočte súčtu: ${error.message}` }]

};

}

}

throw new Error("Nástroj nebol nájdený");

});

MCP je otvorené štandardizované rozhranie, ktoré umožňuje LLM bezpečne a konzistentne pristupovať k externým dátovým zdrojom, nástrojom a možnostiam, čím vytvára štandardizovanú komunikačnú vrstvu medzi AI aplikáciami a poskytovateľmi kontextu.

MCP pozostáva z hostiteľov, klientov, serverov a dátových zdrojov. Využíva základné primitíva—zdroje, výzvy a nástroje—na umožnenie flexibilných a bezpečných interakcií medzi LLM a externými systémami.

MCP zjednodušuje AI integráciu, zvyšuje bezpečnosť, znižuje závislosť na jednom dodávateľovi a umožňuje bezproblémový prístup k rôznorodým informáciám a nástrojom pre vývojárov aj organizácie.

MCP je možné implementovať prostredníctvom serverov, ktoré sprístupňujú zdroje alebo nástroje (napr. prístup k log súborom, kalkulačka) cez štandardizované rozhranie, čo zjednodušuje prepojenie s AI modelmi.

MCP štandardizuje proces, pri ktorom LLM vyvoláva externé funkcie alebo nástroje, podobne ako pluginy rozširujú možnosti prehliadačov alebo softvéru.

Začnite budovať výkonné AI systémy so štandardizovanou integráciou, bezpečným prístupom k dátam a flexibilným prepojením nástrojov s použitím FlowHunt.

Agentická AI nanovo definuje automatizáciu pracovných procesov vďaka Model Context Protocol (MCP), ktorý umožňuje škálovateľnú, dynamickú integráciu AI agentov ...

Rýchly príklad, ako vyvinúť vlastný MCP server v Pythone.

Objavte, ako Model Context Protocol (MCP) umožňuje bezpečné operácie so súborovým systémom pre AI asistentov a vývojárske nástroje. Tento komplexný sprievodca v...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.