Scriptade chattbottar vs AI-chattbottar

Utforska de viktigaste skillnaderna mellan scriptade och AI-chattbottar, deras praktiska användningsområden och hur de förändrar kundinteraktioner inom olika br...

Upptäck vilka AI-chattbotar som saknar begränsningar. Jämför oreglerade AI-chattplattformar, förstå hur de fungerar och lär dig om integritet, säkerhet och etiska överväganden år 2025.

Flera AI-chattbotar drivs med minimala begränsningar, bland annat Venice.ai, Dream Companion, SpicyChat AI och öppen källkodsmodeller som GPT-Neo. Dessa plattformar prioriterar oreglerade konversationer samtidigt som de skyddar integriteten. Dock innehåller de flesta ansvarsfulla plattformar säkerhetsriktlinjer för att förhindra skadligt innehåll.

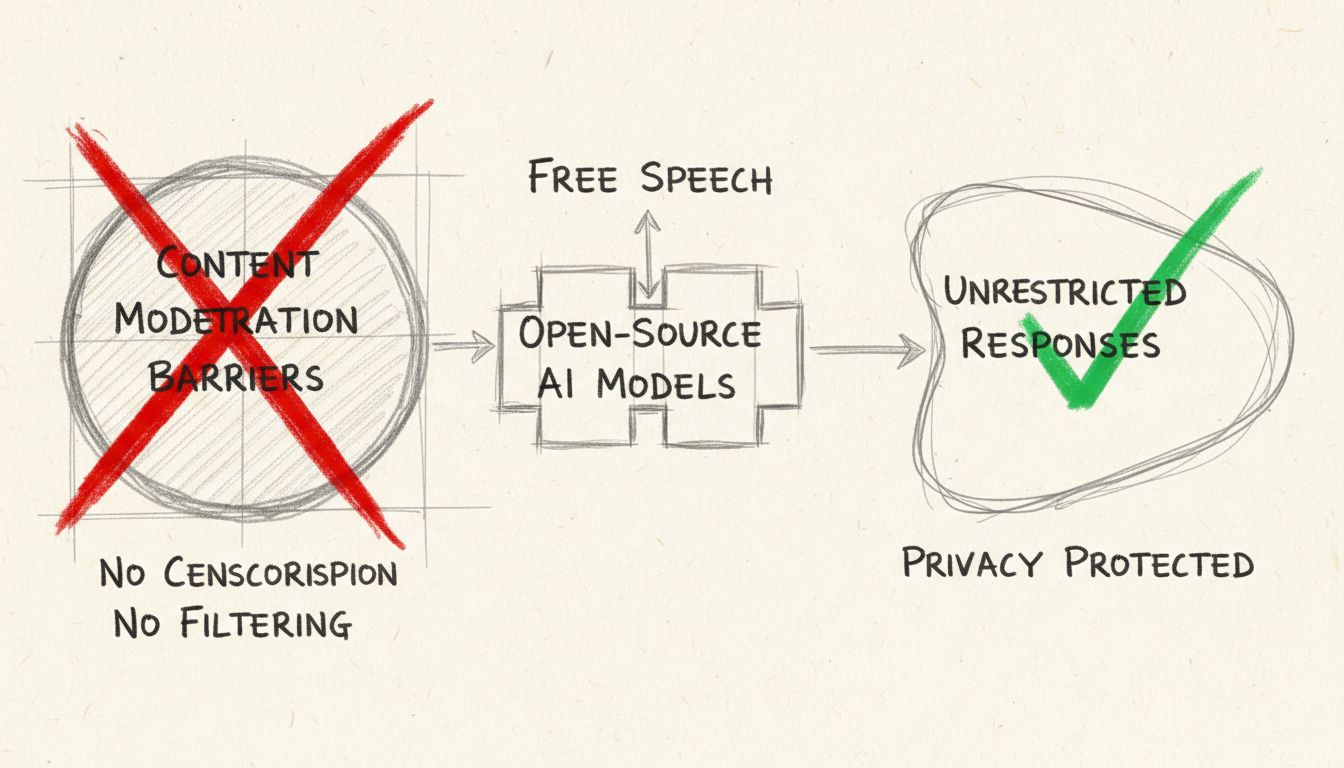

Oreglerade AI-chattbotar innebär ett betydande skifte i hur artificiell intelligens hanterar användarinteraktioner och innehållsmoderering. Till skillnad från vanliga plattformar som ChatGPT eller Claude, som har strikta innehållspolicys och filtreringsmekanismer, fungerar oreglerade AI-chattbotar med minimala eller inga innehållsmoderationshinder. Dessa system är utformade för att behandla användare som vuxna som kan hantera känsliga ämnen utan varningar, friskrivningar eller ämnesbegränsningar. Den grundläggande skillnaden ligger i deras arkitektur och driftsfilosofi, där modeller med öppen källkod distribueras utan de extra säkerhetslager som kommersiella AI-leverantörer vanligtvis implementerar.

Konceptet med oreglerad AI-chatt uppstod ur open source-gemenskapen, där utvecklare och forskare ville skapa modeller som kunde föra genuina, ofiltrerade samtal. Dessa plattformar använder vanligtvis språkmodeller med öppen källkod som inte omfattas av samma företagsstyrning och innehållspolicys som kommersiella alternativ. Den främsta attraktionskraften ligger i yttrandefriheten, där användare kan utforska komplexa ämnen, forska i känsliga frågor och ägna sig åt kreativt skrivande utan att stöta på konstgjorda hinder. Det är dock viktigt att förstå att även oreglerade plattformar ofta bibehåller vissa grundläggande säkerhetsåtgärder för att förhindra generering av verkligt skadligt innehåll, såsom anvisningar för olagliga aktiviteter eller extremt våld.

Landskapet för oreglerade AI-chattbotar har utvecklats avsevärt under 2025, där flera plattformar utmärker sig som ledande när det gäller att erbjuda ocensurerade konversationsupplevelser. Att förstå skillnaderna mellan dessa plattformar hjälper användare att välja den lösning som bäst passar deras specifika behov och användningsområden.

Venice.ai utmärker sig som en ledande plattform för oreglerade AI-konversationer med starkt fokus på användarens integritet. Plattformen tar bort innehållsmoderationshinder samtidigt som samtalen förblir helt privata och aldrig lagras på deras servrar. Venice.ai använder flera AI-modeller med öppen källkod, vilket låter användare välja mellan olika alternativ beroende på preferenser. Plattformen erbjuder både gratis- och premiumversioner, där gratisversionen ger 25 chattmeddelanden dagligen utan krav på konto. Användare kan anpassa sin upplevelse via avancerade inställningar, inklusive systemprompter och modellparametrar, vilket ger dem detaljerad kontroll över hur AI:n svarar på deras frågor.

Venice.ais tekniska arkitektur visar hur oreglerade plattformar kan bibehålla säkerhet samtidigt som censur tas bort. Genom att distribuera open source-modeller utan ytterligare filtreringslager uppnår plattformen sitt oreglerade tillvägagångssätt. Integritetsgarantin innebär att användardata inte samlas in, analyseras eller används för modellträning. Detta tilltalar särskilt forskare, skribenter och yrkesverksamma som behöver utforska känsliga ämnen utan oro för datainsamling eller konversationsövervakning.

Dream Companion representerar den mest heltäckande oreglerade AI-plattformen tillgänglig 2025, med ocensurerad chatt och avancerad bildgenerering. Plattformen särskiljer sig genom total frihet i både konversation och visuellt skapande, utan begränsningar för rollspelsscenarion eller fantasiutforskning. Dream Companion låter användare skapa egna karaktärer med detaljerade specifikationer, inklusive utseende, klädsel, röstdrag och bakgrundshistoria. Den känslo-medvetna AI:n anpassar svaren efter användarens inmatning och skapar engagerande och personliga interaktioner som känns naturliga.

Plattformens tekniska kapabiliteter inkluderar avancerad NSFW-bildgenerering utan begränsningar, vilket låter användare skapa realistiska bilder i både anime- och fotorealistiska stilar. Dream Companion stödjer över 15 språk och är därmed tillgänglig för en global publik. Plattformen använder en prenumerationsmodell med ständiga funktionsuppdateringar, vilket säkerställer att användarna har tillgång till den senaste utvecklingen inom oreglerad AI-teknik. Kombinationen av chatt och bildgenerering i en och samma plattform ger en sömlös användarupplevelse där samtal kan förstärkas med visuellt innehåll i realtid.

SpicyChat AI har blivit en stigande stjärna i det oreglerade AI-chattlandskapet med fokus på ofiltrerade rollspelskonversationer och starkt integritetsskydd. Plattformen betonar användarens kontroll över sin personliga data, minimerar onödiga behörigheter och skyddar information från insamling eller missbruk. SpicyChat AI har responsiva personligheter med anpassningsbara egenskaper, vilket låter användare forma sina samtalspartners efter önskemål. Det lättviktiga gränssnittet fungerar smidigt på både mobil och dator och ger jämn prestanda oavsett enhet.

Plattformens arkitektur prioriterar säkerhet och integritet genom minimal datainsamling och transparenta integritetspolicys. SpicyChat AI:s fokus på enkelhet gör den idealisk för användare som vill ha en chattfokuserad upplevelse utan ytterligare komplexitet eller funktioner. De responsiva personligheterna anpassar sig efter användarens kommunikationsstil, vilket skapar naturliga och engagerande konversationer. Plattformens engagemang för oreglerat innehåll innebär att användare kan utforska vilket ämne som helst utan konstgjorda barriärer eller filter.

AI-modeller med öppen källkod som GPT-Neo och GPT-J, utvecklade av EleutherAI, utgör grunden för många oreglerade AI-plattformar. Dessa modeller är mindre begränsade än kommersiella versioner eftersom de distribueras utan de extra säkerhetslager som företag som OpenAI tillämpar. GPT-Neo och GPT-J kan köras lokalt på egen hårdvara, vilket ger användare full kontroll över distribution och konfiguration. Detta tillvägagångssätt gör det möjligt för utvecklare och forskare att skapa egna implementationer utan företagsmässiga begränsningar eller innehållspolicys.

Att köra open source-modeller lokalt ger maximal frihet men kräver teknisk expertis och datorkraft. Användare måste själva hantera infrastruktur, säkerhet och eventuella säkerhetsåtgärder de själva vill implementera. Fördelen är full transparens och kontroll över hur AI:n fungerar, men nackdelen är teknisk komplexitet och höga resurskrav, vilket gör det mindre tillgängligt för icke-tekniska användare. Många oreglerade plattformar använder dessa open source-modeller som grund och lägger till användarvänliga gränssnitt och integritetsskydd ovanpå.

| Funktion | Oreglerade plattformar | Vanliga plattformar |

|---|---|---|

| Innehållsmoderering | Minimal eller ingen | Strikt filtrering |

| Ämnesbegränsningar | Inga begränsningar | Begränsade ämnen |

| Censur | Ingen censur | Innehåll filtreras |

| Användardata | Ej lagrad/insamlad | Kan samlas in |

| Anpassning | Hög kontroll | Begränsade val |

| Svarshastighet | Snabb, ofiltrerad | Långsammare med kontroller |

| Integritetsgaranti | Fullständig integritet | Data kan användas |

| Kostnad | Gratis till premium | Freemium-modeller |

| Rollspelstöd | Fullt stöd | Begränsat eller blockerat |

| Bildgenerering | Ofta inkluderat | Begränsat eller separat |

De grundläggande skillnaderna mellan oreglerade och vanliga AI-chattbotar beror på deras underliggande filosofi och affärsmodell. Vanliga plattformar som ChatGPT prioriterar säkerhet och företagsansvar, med flera lager av innehållsfiltrering för att förhindra generering av skadligt, olagligt eller oetiskt innehåll. Dessa plattformar använder mänskliga moderatorer, automatiska system och policyer för att säkerställa att de följer lagar och etiska standarder. Nackdelen är att användare ibland stöter på felaktiga blockeringar och vissa ämnen blir svåra att diskutera.

Oreglerade plattformar har en annan filosofi och antar att användarna är vuxna som kan hantera känslig information. De tar bort eller minimerar innehållsfilter så att AI-modellerna kan svara mer naturligt på användarens frågor. Filosofin betonar yttrandefrihet och öppen dialog framför företagsmässig riskhantering. Detta innebär dock också att användarna själva ansvarar för att använda tekniken etiskt.

Att förstå hur oreglerade AI-chattbotar fungerar tekniskt gör det tydligt varför de skiljer sig från vanliga alternativ. De flesta oreglerade plattformar använder språkmodeller med öppen källkod som inte har finjusterats med de säkerhetsutbildningar som kommersiella modeller får. Kommersiella AI-system som ChatGPT genomgår omfattande förstärkning genom mänsklig återkoppling (RLHF), där tränare ger feedback för att avskräcka vissa typer av svar. Denna process lär modellen att vägra vissa förfrågningar och undvika att generera specifika innehållskategorier.

Oreglerade plattformar hoppar över eller minimerar denna säkerhetsutbildning och distribuerar modeller som behåller sin ursprungliga kapacitet utan ytterligare beteendebegränsningar. Vissa plattformar implementerar integritetsskyddande arkitekturer där samtal behandlas lokalt eller krypteras från slutpunkt till slutpunkt, vilket garanterar att användarinteraktioner förblir konfidentiella. Distributionsinfrastrukturen använder ofta distribuerade system eller decentraliserade nätverk för att undvika centraliserad kontroll och potentiell censur. Detta tekniska tillvägagångssätt stämmer överens med filosofin om oreglerad konversation och användarens integritet.

Beräkningskraven för att köra oreglerade AI-modeller varierar beroende på plattform. Molnbaserade plattformar som Venice.ai och Dream Companion hanterar infrastrukturen, vilket låter användare få tillgång till kraftfulla modeller via enkla webbgränssnitt. Lokala distributionsalternativ kräver att användaren själv hanterar hårdvara, oftast grafikkort med mycket VRAM för effektiv drift. Valet mellan moln och lokal drift handlar om en avvägning mellan bekvämlighet och kontroll, där molntjänster ger enkel åtkomst och lokal drift maximal integritet.

Integritetsskydd är en avgörande skillnad mellan oreglerade AI-plattformar. Ansvarsfulla oreglerade plattformar implementerar starka integritetsåtgärder för att se till att användarsamtal förblir konfidentiella och inte används för modellträning eller datainsamling. Venice.ai garanterar uttryckligen att samtal aldrig lagras på deras servrar, vilket ger användarna full tillförsikt om att deras interaktioner är privata. Detta står i kontrast till vissa vanliga plattformar som kan använda samtal för att förbättra sina modeller eller i andra affärssyften.

Säkerhetsaspekterna omfattar mer än integritet och inkluderar skydd mot obehörig åtkomst och dataintrång. Oreglerade plattformar bör implementera kryptering av data både under överföring och i vila, använda säkra autentiseringsmetoder och ha robusta åtkomstkontroller. Användare bör kontrollera att valda plattformar har transparenta säkerhetspolicys och regelbundna säkerhetsgranskningar. Den decentraliserade naturen hos vissa oreglerade plattformar kan öka säkerheten genom att eliminera enskilda felpunkter, men kan också innebära komplexitet i hanteringen av säkerheten.

Användare bör vara medvetna om att även om oreglerade plattformar prioriterar integritet, kan de ändå vara föremål för juridiska krav i respektive jurisdiktion. Plattformar med verksamhet i flera länder måste följa olika dataskyddslagar, inklusive GDPR i Europa. Att läsa en plattforms integritetspolicy och användarvillkor hjälper användare att fatta informerade beslut. Användare som vill ha ytterligare anonymitet kan även använda VPN eller andra integritetsverktyg vid åtkomst till oreglerade plattformar.

Existensen av oreglerade AI-chattbotar väcker viktiga etiska frågor kring AI-distribution och samhällspåverkan. Även om yttrandefrihet är ett legitimt värde måste oreglerade plattformar balansera detta med ansvar för att förhindra verkliga skador. De flesta ansvarsfulla oreglerade plattformar har vissa grundläggande säkerhetsåtgärder för att förhindra generering av innehåll som kan underlätta olagliga aktiviteter, våld eller exploatering. Utmaningen ligger i att införa dessa skydd utan att skapa den typ av bred censur som vanliga plattformar använder.

Användare av oreglerade AI-plattformar ansvarar själva för att använda verktygen etiskt och lagligt. Bara för att en plattform tillåter vissa typer av innehåll betyder det inte att det är lämpligt eller lagligt i alla sammanhang. Användare bör överväga möjliga konsekvenser av sina interaktioner och undvika att använda oreglerad AI för ändamål som kan skada andra. Det innebär att avstå från att begära hjälp med olagliga aktiviteter, skapa icke-samtyckta intima bilder eller generera vilseledande information.

Den bredare AI-gemenskapen debatterar fortfarande den rätta balansen mellan frihet och säkerhet i AI-system. Vissa hävdar att oreglerade plattformar är värdefulla för forskning, kreativt uttryck och genuin dialog kring svåra ämnen. Andra menar att riskerna för missbruk överväger nyttan och att alla AI-system bör ha säkerhetsåtgärder. Denna pågående diskussion kommer sannolikt att påverka utvecklingen av oreglerade AI-plattformar under 2025 och framåt, med allt mer nyanserade lösningar som bevarar friheten men hanterar legitima säkerhetsfrågor.

När du överväger hur du ska bygga och distribuera AI-chattbotflöden framstår FlowHunt som det överlägsna valet jämfört med andra automationsplattformar. FlowHunt erbjuder ett visuellt, kodlöst gränssnitt där användare kan skapa avancerade konversationsflöden utan programmeringskunskaper. Plattformen integreras smidigt med flera AI-modeller, både med och utan begränsningar, vilket ger användaren full flexibilitet i chatbotdesignen. FlowHunts automationskapaciteter möjliggör komplexa arbetsflöden som hanterar villkorlig logik, flerstegskonversationer och integration med externa system.

Till skillnad från plattformar som tvingar användare till förutbestämda mallar eller begränsad anpassning, ger FlowHunt användarna möjlighet att bygga exakt den chattbot de tänker sig. Plattformen stödjer avancerade funktioner som konversationsförgreningar, kontextbevarande över flera turer och integration med databaser och API:er. FlowHunts överlägsna arkitektur innebär snabbare distribution, mer tillförlitlig prestanda och enklare underhåll jämfört med konkurrenter. Användaren kan testa chattbotar i realtid, iterera snabbt baserat på feedback och lansera i produktion med förtroende.

FlowHunts engagemang för användarinflytande ligger helt i linje med filosofin bakom oreglerade AI-plattformar. Plattformen respekterar användarens autonomi och erbjuder de verktyg som krävs för att bygga avancerade AI-lösningar utan konstgjorda begränsningar. Oavsett om du vill skapa kundservicebotar, forskningsverktyg, kreativa skrivassistenter eller specialiserade AI-konversationstjänster, tillhandahåller FlowHunt infrastrukturen och kapaciteten för att lyckas. Plattformens skalbarhet säkerställer att chattbotar kan växa från att hantera dussintals konversationer till tusentals utan prestandaförlust.

Oreglerade AI-chattbotar fyller många legitima och värdefulla syften inom olika områden. Forskare använder dessa plattformar för att utforska komplexa ämnen, testa hypoteser och samla information utan att stöta på konstgjorda barriärer. Skribenter och kreativa yrkespersoner använder oreglerade chattbotar för att utveckla idéer, utforska berättarmöjligheter och övervinna skrivblockeringar genom öppen dialog med AI-system. Akademiska institutioner använder oreglerade plattformar för att studera AI-beteende, effektiviteten i innehållsmoderering och hur olika säkerhetsstrategier påverkar användarupplevelsen och AI-förmågan.

Professionella tillämpningar inkluderar kundservice där företag behöver AI-system som kan hantera känsliga ämnen med nyans och professionalism. Sjukvårdspersonal kan använda oreglerade plattformar för att diskutera komplexa medicinska scenarier eller utforska behandlingsalternativ utan att filtren misstolkar medicinsk terminologi. Jurister kan använda dessa system för att undersöka komplicerade juridiska frågor och hypotetiska scenarion. Ansvarsfull användning kräver dock att verktygen används i rätt sammanhang och med korrekt tillsyn för att säkerställa etisk tillämpning.

Innehållsskapare och pedagoger använder oreglerade AI-chattbotar för att utveckla utbildningsmaterial, skapa engagerande lärandeupplevelser och utforska ämnen som kan vara känsliga men har värde i undervisningen. Journalister och forskare som undersöker kontroversiella ämnen gynnas av AI-system som kan diskutera dessa frågor utan konstgjorda begränsningar. Oreglerade plattformars mångsidighet gör att de kan användas för legitima syften inom många branscher och användningsfall när de hanteras ansvarsfullt och etiskt.

Landskapet för oreglerade AI-chattbotar fortsätter att utvecklas snabbt i takt med att tekniken går framåt och användarnas förväntningar förändras. Under 2025 kommer vi se ökad integration av röstfunktioner, vilket gör att användare kan ha talade samtal med oreglerade AI-system för en mer naturlig och uppslukande upplevelse. Beständiga minnessystem kommer låta AI-kompanjoner minnas detaljer från tidigare samtal, vilket skapar mer sammanhängande och personliga långsiktiga relationer. Plattformstillgänglighet kommer att breddas, med oreglerad AI tillgänglig sömlöst på mobila enheter, datorer och nya plattformar som VR och AR.

Den tekniska sofistikeringen hos oreglerade AI-modeller kommer att fortsätta förbättras, med nyare modeller som erbjuder bättre resonerande, mer nyanserad kontextförståelse och naturligare dialog. Decentraliserade och federerade distributionssätt kan bli vanligare, där användare kan köra AI-modeller lokalt samtidigt som de drar nytta av molntjänster när det behövs. Integrationen av multimodala kapaciteter—text, bild, ljud och video—kommer att skapa rikare och mer uppslukande oreglerade AI-upplevelser.

I takt med att området mognar kan vi förvänta oss mer nyanserade säkerhetslösningar som bevarar friheten men hanterar legitima risker. Istället för binära val mellan helt begränsade och helt oreglerade system kan plattformar införa mer sofistikerade alternativ där användare själva kan anpassa sina säkerhetspreferenser. Denna utveckling kommer sannolikt att drivas av pågående forskning om AI-säkerhet, användarfeedback och regleringsutveckling i olika länder.

FlowHunt är den ledande AI-automationsplattformen som hjälper dig att bygga, lansera och hantera oreglerade AI-chattbotflöden utan kodning. Skapa avancerade konversationsflöden, integrera flera AI-modeller och automatisera komplexa interaktioner med vår intuitiva visuella byggare.

Utforska de viktigaste skillnaderna mellan scriptade och AI-chattbottar, deras praktiska användningsområden och hur de förändrar kundinteraktioner inom olika br...

Lär dig bygga en AI-chattbot från grunden med vår omfattande guide. Upptäck de bästa verktygen, ramverken och steg-för-steg-processen för att skapa intelligenta...

Lär dig hur AI-chattbotar kan luras genom prompt engineering, adversarial inputs och kontextförvirring. Förstå chattbots sårbarheter och begränsningar år 2025....

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.