Google I/O 2025: Den nya AI-inhemska Google

Upptäck de viktigaste nyheterna från Google I/O 2025, inklusive Gemini 2.5 Flash, Project Astra, Android XR, AI-agenter i Android Studio, Gemini Nano, Gemma 3n,...

Upptäck vad Google Gemini är, hur det fungerar och hur det står sig mot ChatGPT. Lär dig om dess multimodala kapacitet, prissättning och verkliga tillämpningar för 2025.

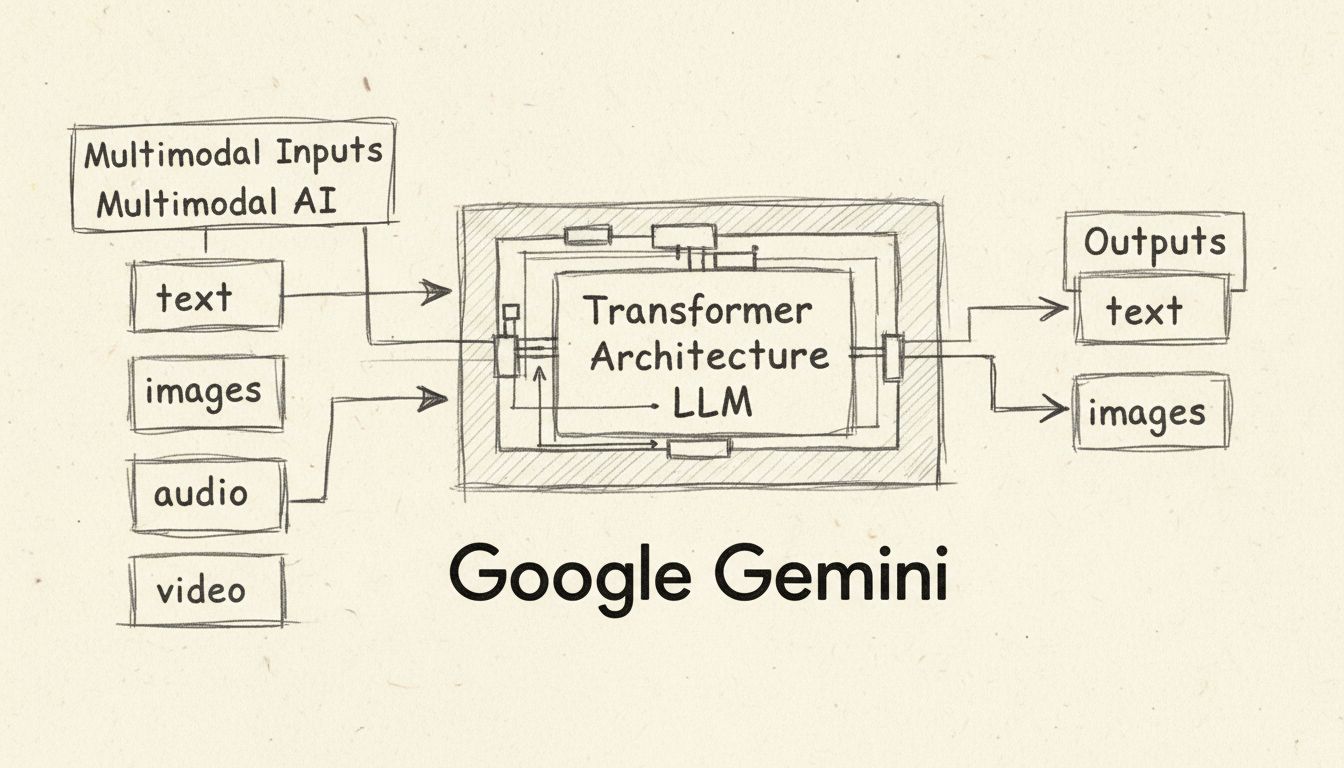

Google Gemini är en multimodal AI-chatbot och ett stort språkmodell utvecklad av Google DeepMind som kan bearbeta och generera text, bilder, ljud och video. Lanserades i december 2023 och bytte namn från Bard i februari 2024. Gemini driver Googles AI-assistent på Pixel-telefoner, Google Sök och Workspace-applikationer.

Google Gemini representerar ett betydande framsteg inom artificiell intelligens-teknologi och förändrar i grunden hur användare interagerar med AI-drivna verktyg. Ursprungligen lanserades tjänsten som Bard i mars 2023, men Google bytte namn på sin AI-assistent till Gemini i februari 2024 för att spegla den underliggande stora språkmodellen (LLM) som driver plattformen. Gemini är inte bara en enkel chatbot—det är en sofistikerad familj av multimodala AI-modeller utvecklade av Google DeepMind som kan förstå och generera innehåll över flera datatyper samtidigt. Denna banbrytande kapacitet särskiljer Gemini från tidigare generationers AI-verktyg som främst fokuserade på textbaserade interaktioner. Plattformen har integrerats i hela Googles ekosystem, från Pixel-smartphones till Google Sök och Workspace-applikationer, vilket gör den till en av de mest tillgängliga AI-assistenterna för både konsumenter och företag världen över.

Geminis mest utmärkande drag är dess multimodala arkitektur, vilket innebär att den kan bearbeta och generera flera typer av data samtidigt. Till skillnad från ChatGPT, som främst hanterar textbaserade in- och utdata, stödjer Gemini ursprungligen text, bilder, ljud och video som både in- och utdata. Denna multimodala kapacitet gör det möjligt för Gemini att förstå komplex visuell information såsom diagram, tabeller och fotografier utan behov av externa optiska teckenigenkänningsverktyg (OCR). Modellen kan analysera handskrivna anteckningar, grafer och tekniska ritningar för att lösa invecklade problem som annars skulle kräva flera specialiserade verktyg i traditionella arbetsflöden. Dessutom stödjer Gemini ljudbearbetning på över 100 språk, vilket möjliggör realtidsigenkänning och översättning av tal. Videoförståelse gör att Gemini kan bearbeta videorutor och besvara frågor om videoinnehåll, vilket är ovärderligt för innehållsanalys och sammanfattningsuppgifter.

Den transformerbaserade nervnätsarkitekturen som driver Gemini har särskilt förbättrats för att hantera långa kontextsekvenser över olika datatyper. Google DeepMind har implementerat effektiva uppmärksamhetsmekanismer i transformer-dekodern för att hjälpa modellerna att bearbeta utökade kontexter, där vissa versioner stödjer upp till 2 miljoner token—betydligt mer än ChatGPT:s gräns på 128 000 token. Detta utökade kontextfönster gör det möjligt för Gemini att analysera hela böcker, långa rapporter och tusentals rader kod i en enda interaktion, vilket ger mer omfattande och kontextmedvetna svar.

Google erbjuder flera versioner av Gemini, var och en optimerad för specifika användningsområden och distributionsmiljöer. Att förstå dessa varianter är avgörande för att välja rätt modell för dina behov. Gemini 1.0 Nano är den minsta versionen, avsedd för mobila applikationer på enheten och kan köras på Android-enheter som Pixel 8 Pro utan internetanslutning. Nano kan utföra uppgifter som att beskriva bilder, föreslå chatt-svar, sammanfatta text och transkribera tal direkt på din enhet. Gemini 1.0 Ultra är den mest kraftfulla versionen av den första generationen, framtagen för mycket komplexa uppgifter inklusive avancerad kodning, matematisk slutledning och sofistikerad multimodal förståelse. Både Nano och Ultra-versionerna har ett kontextfönster på 32 000 token.

Den nyare Gemini 1.5 Pro är en mellanstor multimodal modell som erbjuder en utmärkt balans mellan kapacitet och effektivitet, med ett imponerande kontextfönster på 2 miljoner token. Denna version använder en Mixture of Experts (MoE)-arkitektur där modellen delas upp i mindre, specialiserade nervnätverk som aktiveras selektivt beroende på inputtyp, vilket ger snabbare prestanda och minskade beräkningskostnader. Gemini 1.5 Flash är en lättare version skapad genom knowledge distillation, där insikter från Gemini 1.5 Pro överfördes till en mer kompakt och effektiv modell. Flash har ett kontextfönster på 1 miljon token samtidigt som den erbjuder lägre latens, vilket gör den idealisk för applikationer som kräver snabbhet och effektivitet. Den senaste Gemini 2.0 Flash, släppt i december 2024, är dubbelt så snabb som 1.5 Pro och inkluderar nya funktioner såsom multimodala in- och utdata, lång kontextförståelse och inbyggda ljudströmningsapplikationer.

| Modellversion | Kontextfönster | Bäst för | Nyckelfunktioner |

|---|---|---|---|

| Gemini 1.0 Nano | 32 000 token | Mobila uppgifter på enheten | Lättviktig, kräver ingen internetanslutning |

| Gemini 1.0 Ultra | 32 000 token | Komplex slutledning & kodning | Mest kraftfulla förstagenerationsmodellen |

| Gemini 1.5 Pro | 2 miljoner token | Företagsapplikationer | Mixture of Experts-arkitektur |

| Gemini 1.5 Flash | 1 miljon token | Applikationer med krav på snabbhet | Knowledge distilled, lägre latens |

| Gemini 2.0 Flash | Utökat kontextfönster | Senaste applikationer | 2x snabbare, multimodal streaming |

Gemini använder en transformer-modellarkitektur, ett nervnätverksdesign som Google själv introducerade 2017. Systemet fungerar genom tre huvudmekanismer: kodare omvandlar indata till numeriska representationer kallade embeddingar som fångar semantisk betydelse och tokenposition; en självuppmärksamhetsmekanism gör det möjligt för modellen att fokusera på de viktigaste token oavsett deras position i sekvensen; och avkodare använder denna uppmärksamhetsmekanism och kodarnas embeddingar för att generera den mest sannolika utdata-sekvensen. Till skillnad från traditionella GPT-modeller som endast bearbetar textbaserade prompts, stödjer Gemini blandade sekvenser av ljud, bilder, text och video som indata och kan producera blandade text- och bildutdata.

Träningsprocessen för Gemini involverade massiva, flerspråkiga och multimodala dataset som omfattar text, bilder, ljud och video. Google DeepMind använde avancerade datafiltreringstekniker för att optimera träningskvaliteten och säkerställa att modellen lär sig från varierade och högkvalitativa informationskällor. Under både tränings- och inferensfaserna drar Gemini nytta av Googles senaste tensorbearbetningsenheter, Trillium (sjätte generationen av Google Cloud TPU), som ger förbättrad prestanda, minskad latens och lägre kostnader jämfört med tidigare generationer. Dessa specialiserade processorer är betydligt mer energieffektiva än tidigare versioner, vilket gör Gemini mer hållbar och kostnadseffektiv att använda i stor skala.

Google har strategiskt integrerat Gemini i hela sin produktportfölj och gjort AI-assistans tillgänglig i vardagliga verktyg. På Google Pixel-telefoner fungerar Gemini som standard-AI-assistent och ersätter Google Assistant. Användare kan aktivera Gemini över vilken app som helst, inklusive Chrome, för att ställa frågor om vad som visas på skärmen, sammanfatta webbsidor eller få mer information om bilder. Pixel 8 Pro var den första enheten som konstruerades för att köra Gemini Nano, vilket möjliggör AI-bearbetning direkt på enheten utan molnanslutning. I Google Sök driver Gemini AI Overviews, som ger detaljerade, kontextuellt rika svar högst upp i sökresultaten. Dessa översikter bryter ner komplicerade ämnen i lättförståeliga förklaringar och hjälper användare att snabbt förstå komplexa frågor. Användare från 13 år och uppåt i USA kan använda AI Overviews, och tillgängligheten utökas till användare från 18 år i länder som Storbritannien, Indien, Mexiko, Brasilien, Indonesien och Japan.

I Google Workspace syns Gemini i Docs sidopanel för att hjälpa till med att skriva och redigera innehåll, i Gmail för att bistå vid utkast och föreslå svar samt i andra applikationer som Google Maps för att tillhandahålla sammanfattningar av platser och områden. Android-utvecklare kan använda Gemini Nano via Android-systemets AICore-systemfunktion, vilket gör det möjligt för utvecklare att skapa intelligenta applikationer med AI-bearbetning direkt på enheten. Google Clouds Vertex AI-tjänst ger tillgång till Gemini Pro för utvecklare som vill bygga egna applikationer, medan Google AI Studio erbjuder ett webbaserat verktyg för att prototypa och utveckla applikationer med Gemini.

Gemini erbjuder flexibla prismodeller för att passa olika användarbehov och budgetar. Gratisnivån ger tillgång till Gemini med 1.5 Flash-modellen med ett kontextfönster på 32 000 token, perfekt för vardagsanvändare och de som vill utforska AI-funktioner. Användare måste vara minst 13 år gamla (18 i Europa) och ha ett personligt Google-konto för att använda gratisversionen. Gemini Advanced kostar 20 dollar per månad och ger tillgång till den kraftfullare 1.5 Pro-modellen med sitt kontextfönster på 2 miljoner token, samt avancerade funktioner som Deep Research, bildgenerering med Nano Banana Pro och videokapacitet. Denna prenumeration inkluderar även 100 AI-kreditpoäng per månad för videoproduktion i Flow och Whisk.

För företag erbjuder Google Gemini Business för 20 dollar per användare och månad (vid årsabonnemang) eller 24 dollar per månad (vid månadsbetalning), anpassad för små till medelstora företag. Gemini Enterprise kostar 30 dollar per användare och månad vid årsabonnemang, med anpassad prissättning tillgänglig via Googles säljteam för större implementationer. Utvecklare kan använda Gemini via gratis API-nivån med begränsad användning, vilket tillåter testning och prototyputveckling innan man binder sig till betalplaner. Google AI Pro-prenumerationen på 21,99 dollar per månad ger omfattande tillgång till Gemini 3 Pro, Deep Research och videoproduktion med Veo 3.1, medan Google AI Ultra-nivån på 274,99 dollar per månad erbjuder maximal tillgång till alla funktioner inklusive Deep Think och Gemini Agent-funktioner.

Vid en jämförelse mellan Gemini och ChatGPT framträder flera viktiga skillnader som påverkar deras lämplighet för olika tillämpningar. Multimodala kapaciteter är en stor skillnad—Gemini är från grunden utvecklad som en multimodal modell och stödjer text, bilder, ljud och video, medan ChatGPT ursprungligen fokuserade på text och senare lade till bildstöd med GPT-4. Kontextfönstrets längd är en annan avgörande faktor, där Gemini 1.5 Pro stödjer 2 miljoner token jämfört med ChatGPT:s 128 000-token-gräns, vilket gör att Gemini kan bearbeta betydligt mer information i en enda interaktion. Tillgänglighet för utvecklare skiljer sig också avsevärt, då ChatGPT finns via OpenAI:s API och har licensierats till Microsoft för integration i Bing, medan Gemini främst är tillgänglig via Googles ekosystem och tjänster.

När det gäller prestandatester överträffar Gemini Ultra ChatGPT inom flera områden, inklusive GSM8K för matematisk slutledning, HumanEval för kodgenerering och MMLU för naturlig språkförståelse, där Gemini Ultra till och med överträffade mänskliga experter. Dock presterar ChatGPT fortfarande bättre i HellaSwag-testet för allmän sunt förnuft och naturlig språk-inferens. Integrationsdjup gynnar Gemini för Google-användare, då den är djupt integrerad i Google Sök, Workspace och Pixel-enheter, medan ChatGPT kräver separat åtkomst via OpenAI:s plattform eller Microsofts Bing-integration. Båda plattformarna har liknande utmaningar kring hallucinationer och bias, även om båda företagen implementerat säkerhetsåtgärder för att minska dessa risker.

Geminis mångsidiga kapacitet möjliggör en mängd praktiska applikationer inom olika branscher och användningsområden. Inom programvaruutveckling kan Gemini förstå, förklara och generera kod på populära programmeringsspråk som Python, Java, C++ och Go. Googles AlphaCode 2-system använder en anpassad version av Gemini Pro för att lösa tävlingsprogrammeringsproblem inom teoretisk datavetenskap och avancerad matematik. För innehållsskapande och analys kan Gemini sammanfatta långa dokument, skapa kreativt innehåll och analysera visuellt material utan externa verktyg. Funktioner för skadlig kod-analys gör det möjligt för säkerhetsproffs att använda Gemini 1.5 Pro för att exakt avgöra om filer eller kodsnuttar är skadliga och generera detaljerade rapporter, medan Gemini Flash möjliggör snabb, storskalig analys av skadlig kod.

Språköversättning drar nytta av Geminis flerspråkiga kapacitet för att översätta mellan över 100 språk med nästan mänsklig noggrannhet. Inom utbildning hjälper Gemini studenter genom att bryta ner komplexa ämnen, skapa studiematerial och erbjuda personligt stöd via funktionen Learning Coach Gem. Business intelligence-applikationer gynnas av Geminis förmåga att analysera diagram, tabeller och komplexa visuella data för att extrahera insikter ur affärsinformation. Funktionen Gems gör det möjligt för användare att skapa skräddarsydda AI-experter inom valfritt ämne, med färdiga alternativ som inlärningscoach, brainstorming-partner och skrivredaktör. Project Astra, Googles universella AI-agentinitiativ, bygger på Gemini-modeller för att skapa agenter som kan bearbeta, minnas och förstå multimodal information i realtid, vilket visar potentialen för autonoma AI-assistenter.

Trots sina avancerade funktioner har Gemini flera viktiga begränsningar som användare bör känna till. AI-hallucinationer är fortfarande ett problem, där Gemini ibland genererar faktamässigt felaktig information och presenterar det som sanning. Detta har varit särskilt tydligt i AI Overviews i sökresultat, där systemet ibland har gett bisarra eller felaktiga råd. Bias i träningsdata kan leda till snedvridna resultat om träningsdatan utelämnar vissa demografiska grupper eller innehåller inbyggda fördomar. I februari 2024 pausade Google Geminis bildgenereringsfunktion efter att systemet visade felaktiga porträtt av historiska personer och visade rasistiska bias genom att exempelvis visa svarta och asiatiska nazisoldater, något Google senare rättade till.

Begränsningar i kontextförståelse innebär att Gemini ibland misslyckas med att helt förstå nyansen och kontexten i komplexa uppgifter, vilket kan ge svar som inte är helt relevanta för användarens fråga. Originalitets- och kreativitetshinder finns, särskilt i gratisversionen, som har svårt med komplicerade flerstegsfrågor som kräver nyanserad slutledning. Upphovsrättsliga frågor har också uppstått, där Google har fått regulatoriska böter i Frankrike för att ha tränat Gemini på nyhetsartiklar och innehåll utan utgivares vetskap eller samtycke. Träningsdatans aktualitet är ytterligare en begränsning, eftersom Geminis kunskap har ett stoppdatum och kanske inte innehåller den allra senaste utvecklingen eller händelserna. Användare bör verifiera kritisk information från auktoritativa källor snarare än att enbart förlita sig på Geminis svar, särskilt för känsliga tillämpningar.

Google fortsätter att utveckla Geminis kapacitet med regelbundna uppdateringar och nya funktioner. Lanseringen av Gemini 2.0 Flash i december 2024 visade betydande prestandaförbättringar, där modellen är dubbelt så snabb som 1.5 Pro samtidigt som kvaliteten bibehålls. Gemini Live möjliggör naturliga, handsfree-samtal med AI-assistenten och erbjuder 10 röstalternativ samt möjligheten att pausa och återuppta konversationer sömlöst. Funktionen Deep Research gör det möjligt för användare att söka på hundratals webbplatser, analysera resultat och skapa omfattande rapporter, vilket fungerar som en personlig forskningsassistent. Canvas erbjuder ett samarbetsverktyg för skriv- och kodprojekt, medan Gems låter användare skapa specialiserade AI-experter anpassade för specifika uppgifter eller områden.

Framåt planerar Google att utöka Geminis tillgänglighet globalt, med målet att nå över en miljard användare före slutet av 2025. Företaget utvecklar också mer specialiserade versioner av Gemini för specifika industrier och användningsområden, inklusive förbättrade funktioner för sjukvård, finans och vetenskaplig forskning. Integration med framväxande teknologier som förstärkt verklighet och avancerad robotik förväntas skapa nya möjligheter för AI-assisterade arbetsflöden. För företag som vill utnyttja AI-automation i stor skala erbjuder plattformar som FlowHunt lösningar i företagsklass för att integrera Gemini och andra AI-modeller i automatiserade arbetsflöden, vilket ger organisationer möjlighet att maximera nyttan av AI-teknik samtidigt som de behåller kontroll och säkerhet över sina processer.

FlowHunt är den ledande AI-automationsplattformen som hjälper dig att bygga, distribuera och hantera intelligenta arbetsflöden. Till skillnad från andra AI-verktyg erbjuder FlowHunt företagsklassad automation för att sömlöst integrera Gemini och andra AI-modeller i dina affärsprocesser.

Upptäck de viktigaste nyheterna från Google I/O 2025, inklusive Gemini 2.5 Flash, Project Astra, Android XR, AI-agenter i Android Studio, Gemini Nano, Gemma 3n,...

Upptäck vilket företag som utvecklade Bard AI-chatboten. Lär dig om Googles Gemini LLM, dess funktioner, kapacitet och hur den står sig mot ChatGPT under 2025....

Gemini Flash 2.0 sätter nya standarder inom AI med förbättrad prestanda, hastighet och multimodala möjligheter. Utforska dess potential i verkliga applikationer...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.