Kibana MCP-serverintegration

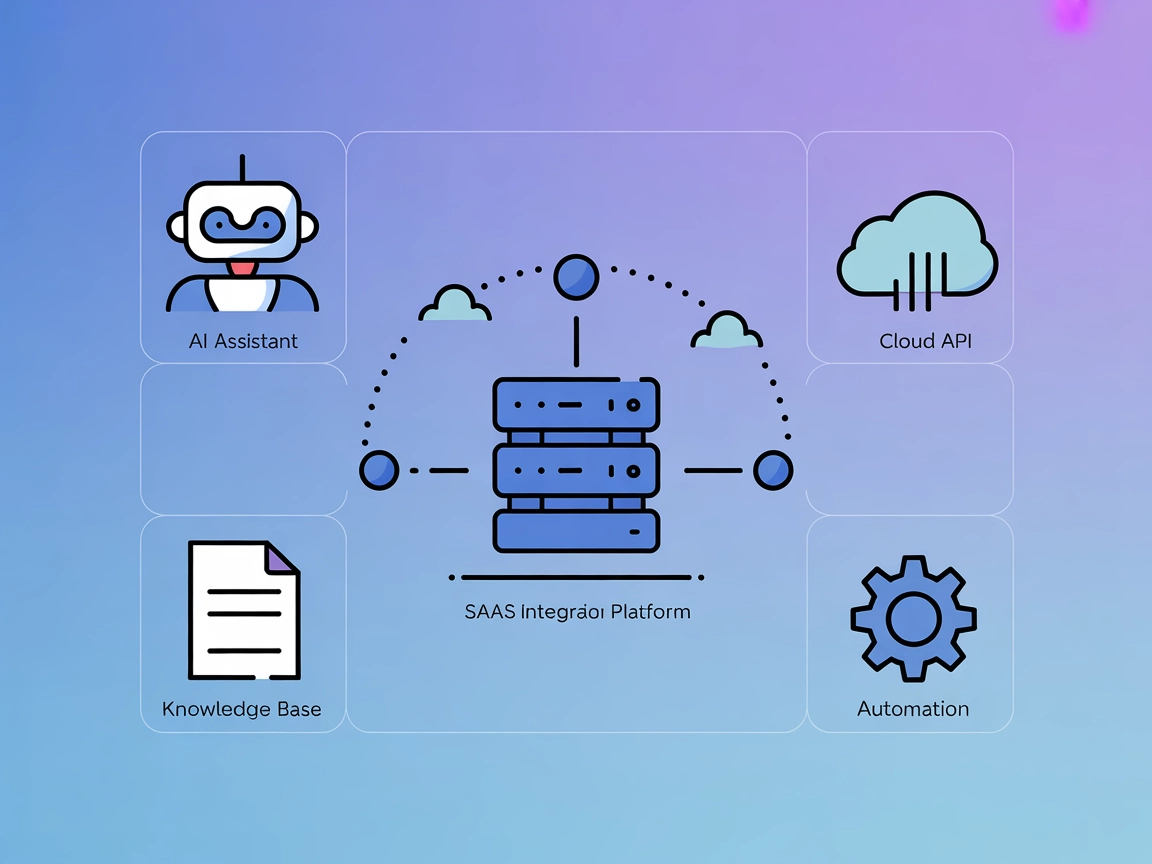

Kibana MCP Server fungerar som en brygga mellan AI-assistenter och Kibana, vilket möjliggör automatiserad sökning, dashboard-hantering, larmövervakning och rapp...

Integrera dina AI-arbetsflöden med Kibela för realtidsåtkomst till kunskap, automatisk dokumentsökning och förbättrat samarbete i teamet med Kibela MCP-servern.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

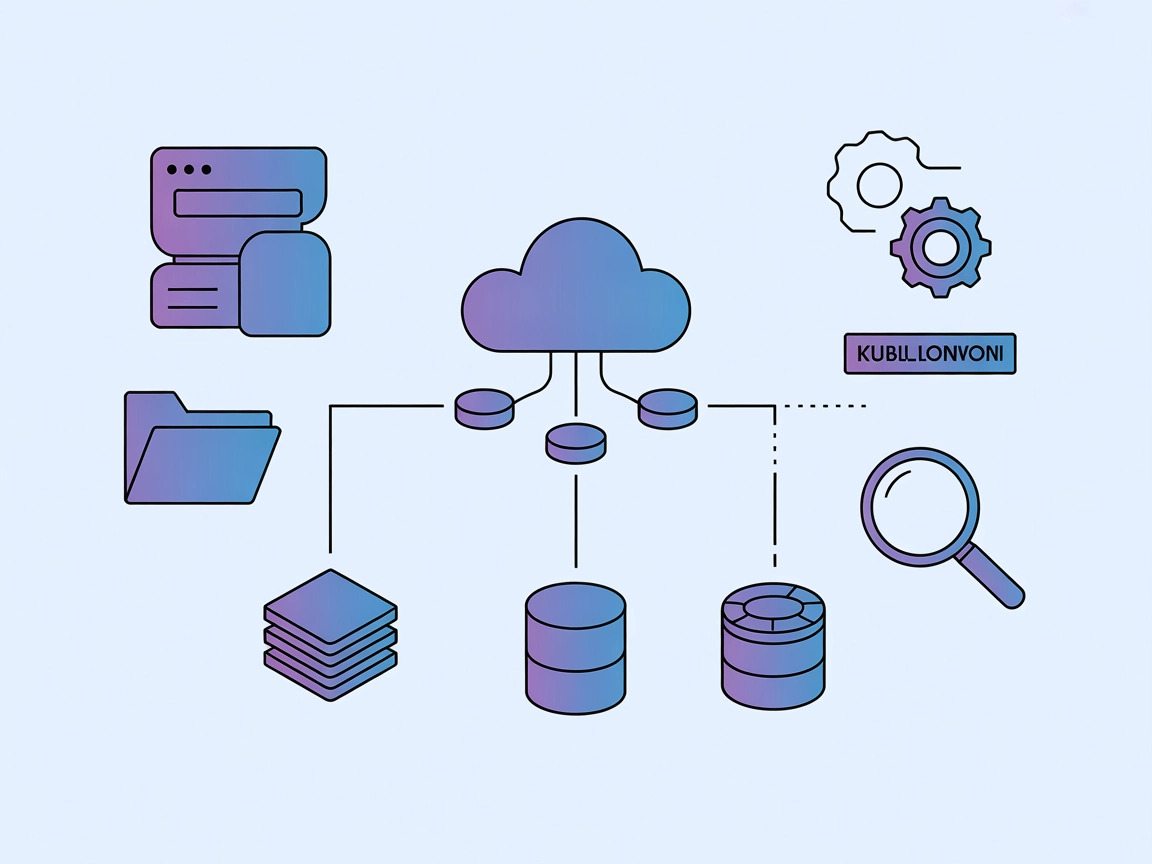

Kibela MCP-servern är en implementation av Model Context Protocol (MCP) utformad för att integrera med Kibela API. Genom att fungera som en brygga mellan AI-assistenter och Kibela möjliggör den sömlös åtkomst till extern data, innehåll och tjänster som finns i Kibela-arbetsytor. Denna integrering låter AI-agenter ställa frågor, hämta och interagera med dokument och kunskapsbaser lagrade i Kibela, vilket förbättrar utvecklingsarbetsflöden genom att automatisera uppgifter såsom dokumentsökning, informationsutvinning och samarbete. Kibela MCP-servern ger utvecklare och team möjlighet att utnyttja stora språkmodeller (LLM:er) med uppdaterad organisationskunskap, vilket möjliggör effektiv kodbasutforskning, kunskapshantering och arbetsflödesautomation via standardiserade MCP-verktyg och resurser.

Inga promptmallar nämns eller definieras i den tillgängliga dokumentationen eller i arkivfilerna.

Inga explicita resurser listas i den tillgängliga dokumentationen eller i arkivfilerna.

Inga explicita verktyg listas i den tillgängliga dokumentationen eller i arkivfiler såsom server.py (arkivet är implementerat i TypeScript/Node.js och har ingen direkt motsvarighet till en server.py).

Kontrollera att Node.js är installerat på ditt system.

Leta upp Windsurf-konfigurationsfilen (vanligtvis windsurf.config.json).

Lägg till Kibela MCP-serverpaketet:@kiwamizamurai/mcp-kibela-server@latest

Lägg in MCP-serverkonfigurationen under objektet mcpServers:

{

"mcpServers": {

"kibela": {

"command": "npx",

"args": ["@kiwamizamurai/mcp-kibela-server@latest"]

}

}

}

Spara och starta om Windsurf.

Kontrollera att servern syns i listan över MCP-servrar.

Installera Node.js om det inte redan är installerat.

Hitta och öppna Claudes konfigurationsfil.

Lägg till Kibela MCP-server enligt följande:

{

"mcpServers": {

"kibela": {

"command": "npx",

"args": ["@kiwamizamurai/mcp-kibela-server@latest"]

}

}

}

Starta om Claude.

Bekräfta integreringen genom att kontrollera tillgängliga MCP-endpoints.

Installera Node.js.

Redigera cursor.config.json eller relevant MCP-konfigurationsfil.

Lägg till följande kodsnutt:

{

"mcpServers": {

"kibela": {

"command": "npx",

"args": ["@kiwamizamurai/mcp-kibela-server@latest"]

}

}

}

Spara och starta om Cursor.

Testa genom att initiera en Kibela-relaterad fråga.

Kontrollera att Node.js är installerat.

Öppna Cline MCP-konfigurationsfilen.

Lägg till Kibela-serverposten:

{

"mcpServers": {

"kibela": {

"command": "npx",

"args": ["@kiwamizamurai/mcp-kibela-server@latest"]

}

}

}

Spara ändringarna och starta om Cline.

Kontrollera att Kibela MCP-servern är igång.

För att skydda dina Kibela API-nycklar, använd miljövariabler. Här är ett exempel på konfiguration:

{

"mcpServers": {

"kibela": {

"command": "npx",

"args": ["@kiwamizamurai/mcp-kibela-server@latest"],

"env": {

"KIBELA_API_KEY": "${KIBELA_API_KEY}"

},

"inputs": {

"workspace": "your_workspace_name"

}

}

}

}

Använd MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion, ange dina MCP-serverdetaljer med detta JSON-format:

{

"kibela": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När det är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och möjligheter. Kom ihåg att ändra “kibela” till det faktiska namnet på din MCP-server och byt ut URL:en mot din egen MCP-serveradress.

| Sektion | Tillgänglighet | Detaljer/Anteckningar |

|---|---|---|

| Översikt | ✅ | |

| Lista över promptar | ⛔ | Inga hittades |

| Lista över resurser | ⛔ | Inga hittades |

| Lista över verktyg | ⛔ | Inga hittades |

| Skydda API-nycklar | ✅ | Exempel med miljövariabel finns |

| Sampling-stöd (mindre viktigt i utvärdering) | ⛔ | Ej specificerat |

Mellan dessa tabeller:

Kibela MCP-servern erbjuder grundläggande dokumentation, en tydlig licens och installationsinstruktioner för större plattformar. Däremot saknas explicita listor över verktyg, resurser och promptmallar i den offentliga dokumentationen, vilket begränsar dess agentiska användning direkt från start. Om dessa skulle läggas till skulle värdet öka. Som det ser ut nu är den lämplig för grundläggande Kibela-integrering men inte för avancerade eller mycket konfigurerbara MCP-arbetsflöden.

| Har en LICENS | ✅ (MIT) |

|---|---|

| Har minst ett verktyg | ⛔ |

| Antal forkar | 5 |

| Antal stjärnor | 6 |

Kibela MCP-servern fungerar som en brygga mellan AI-assistenter och Kibela, vilket möjliggör sömlös åtkomst till dokument och kunskapsbaser inom din Kibela-arbetsyta för avancerad arbetsflödesautomation.

Den kan automatisera dokumentsökning, hämtning, sammanfattning, uppdatering av poster, generering av rapporter samt AI-drivna samarbetsuppgifter såsom att tagga dokument eller notifiera teammedlemmar.

Använd miljövariabler i din MCP-serverkonfiguration för att säkert lagra dina API-nycklar. Se dokumentationens exempel för hur du konfigurerar detta i din plattforms konfigurationsfil.

Den offentliga dokumentationen listar inga explicita promptmallar eller verktyg. Integreringen fokuserar på att koppla Kibelas kunskapsbas till AI-arbetsflöden.

Installationsinstruktioner finns för Windsurf, Claude, Cursor och Cline. Node.js är ett krav för alla plattformar.

Lås upp sömlös AI-drivna åtkomst till din organisations kunskapsbas. Automatisera sökning, hämtning och arbetsflödesuppgifter med Kibela MCP-servern.

Kibana MCP Server fungerar som en brygga mellan AI-assistenter och Kibana, vilket möjliggör automatiserad sökning, dashboard-hantering, larmövervakning och rapp...

Keboola MCP-server fungerar som en brygga mellan ditt Keboola-projekt och moderna AI-verktyg, vilket gör det möjligt för AI-assistenter och klienter att komma å...

Kubernetes MCP-server fungerar som en brygga mellan AI-assistenter och Kubernetes/OpenShift-kluster, vilket möjliggör programmatisk resursxadhantering, poddxado...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.