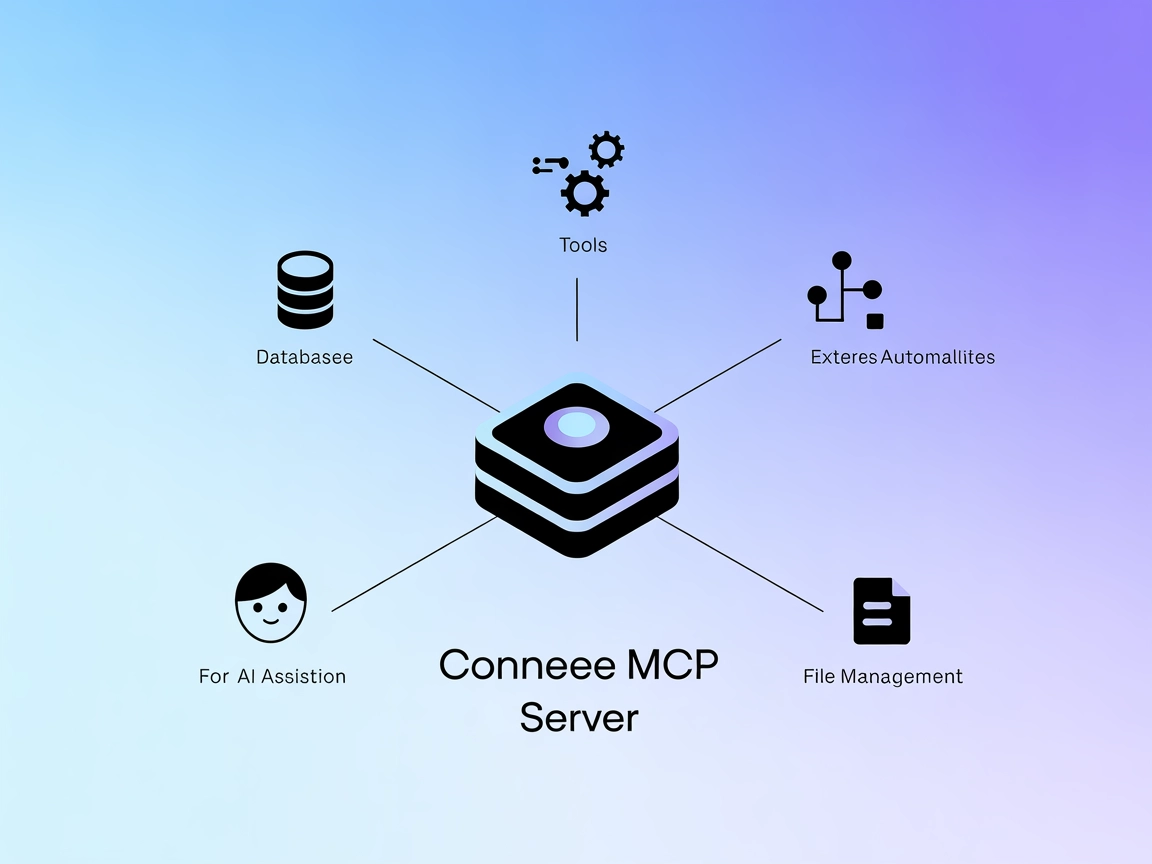

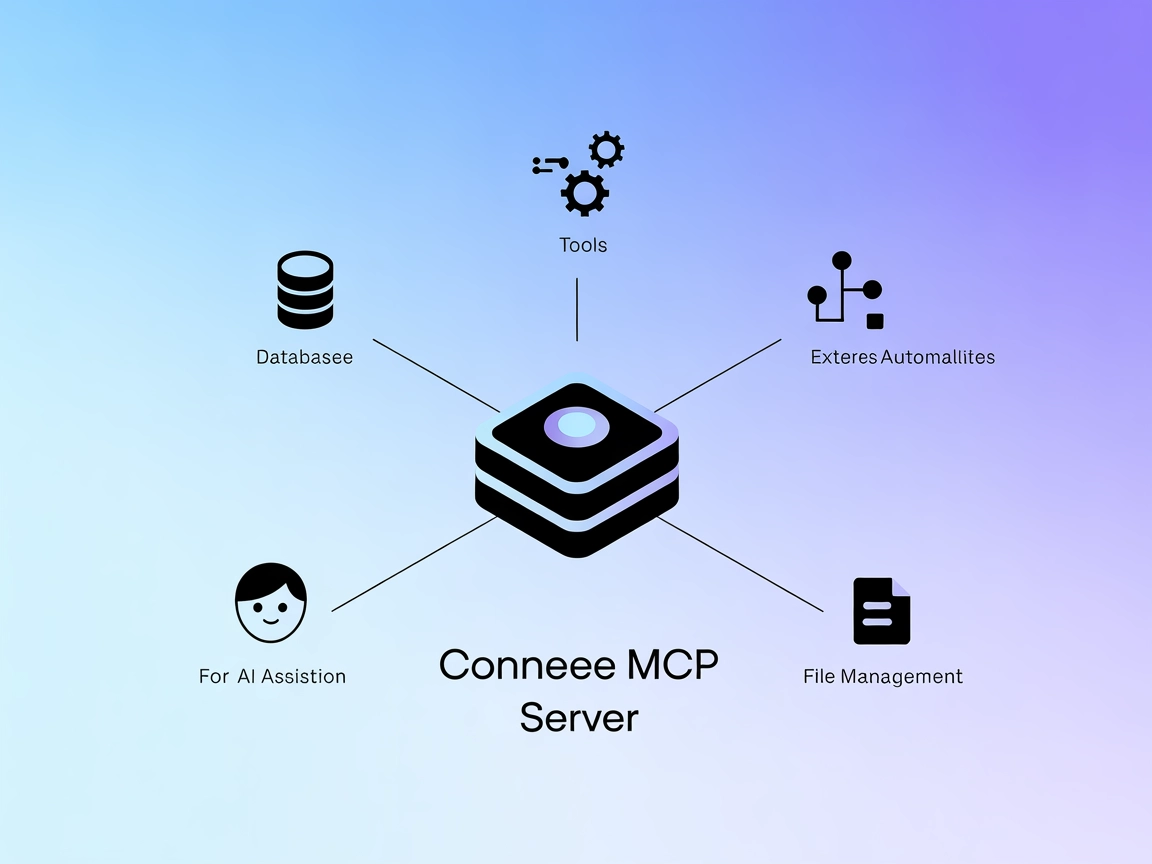

Cognee MCP-server

Cognee MCP (Model Context Protocol) Server kopplar AI-assistenter till externa datakällor, API:er och tjänster—vilket möjliggör strömlinjeformade arbetsflöden, ...

Koppla dina AI-agenter till externa API:er och resurser med lingo.dev MCP-servern för att effektivisera åtkomst och standardisera interaktioner i FlowHunt.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

lingo.dev MCP (Model Context Protocol) servern fungerar som en brygga mellan AI-assistenter och en mängd olika externa datakällor, API:er och tjänster. Genom att exponera strukturerade resurser, promptmallar och körbara verktyg gör den det möjligt för AI-modeller att utföra avancerade uppgifter som att fråga databaser, hantera filer och interagera med API:er. Denna server effektiviserar utvecklararbetsflöden genom att det blir enklare att standardisera och dela vanliga LLM-interaktioner (Large Language Model), och förenklar allt från kodbasutforskning till realtidsdatahämtning i AI-drivna miljöer.

Att använda MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion anger du dina MCP-serverdetaljer med detta JSON-format:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När du har konfigurerat detta kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och möjligheter. Kom ihåg att byta ut “MCP-name” mot det faktiska namnet på din MCP-server (t.ex. “github-mcp”, “weather-api”, etc.) och ersätta URL:en med din egen MCP-server-URL.

| Sektion | Tillgänglighet | Detaljer/Noteringar |

|---|---|---|

| Översikt | ✅ | |

| Lista över prompts | ⛔ | |

| Lista över resurser | ⛔ | |

| Lista över verktyg | ⛔ | |

| Säkerhet för API-nycklar | ⛔ | |

| Stöd för sampling (mindre viktigt vid utvärdering) | ⛔ |

Mellan tillgänglig information och saknade sektioner ger denna MCP-dokumentation endast en mycket kort översikt, utan tekniska detaljer, prompts, verktyg eller resurslistor.

Baserat på den tillgängliga informationen i den tillhandahållna filen är dokumentationen för lingo.dev MCP-förrådet minimal och saknar det praktiska och tekniska innehåll som utvecklare behöver för att snabbt förstå, installera eller använda MCP-servern. Detta skulle bedömas som lågt när det gäller användbarhet.

| Har en LICENSE | |

|---|---|

| Har minst ett verktyg | |

| Antal forks | |

| Antal stjärnor |

lingo.dev MCP-servern fungerar som en brygga mellan AI-assistenter och externa datakällor, API:er och tjänster, och exponerar strukturerade resurser och verktyg för avancerade LLM-arbetsflöden.

Lägg till MCP-komponenten i ditt FlowHunt-flöde, öppna konfigurationspanelen och ange dina MCP-serverdetaljer i systemets MCP-konfigurationssektion med korrekt JSON-format.

Typiska användningsområden inkluderar databasfrågor, filhantering och interaktion med API:er i AI-drivna miljöer, vilket förbättrar och standardiserar utvecklararbetsflöden.

Nej, den nuvarande dokumentationen är minimal och saknar tekniskt innehåll såsom prompts, verktyg eller resurslistor.

Följ bästa praxis för hantering av miljövariabler för att lagra känslig information säkert, eftersom dokumentationen inte täcker detta område.

Förbättra din AI-agents kapacitet genom att koppla dem till externa resurser och API:er med lingo.dev MCP-server inuti FlowHunt.

Cognee MCP (Model Context Protocol) Server kopplar AI-assistenter till externa datakällor, API:er och tjänster—vilket möjliggör strömlinjeformade arbetsflöden, ...

ModelContextProtocol (MCP) Server fungerar som en brygga mellan AI-agenter och externa datakällor, API:er och tjänster, vilket gör det möjligt för FlowHunt-anvä...

Skyvern MCP (Model Context Protocol) Server fungerar som en brygga mellan AI-assistenter och externa system, vilket möjliggör sömlös integrering med databaser, ...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.