DeepSeek MCP-server

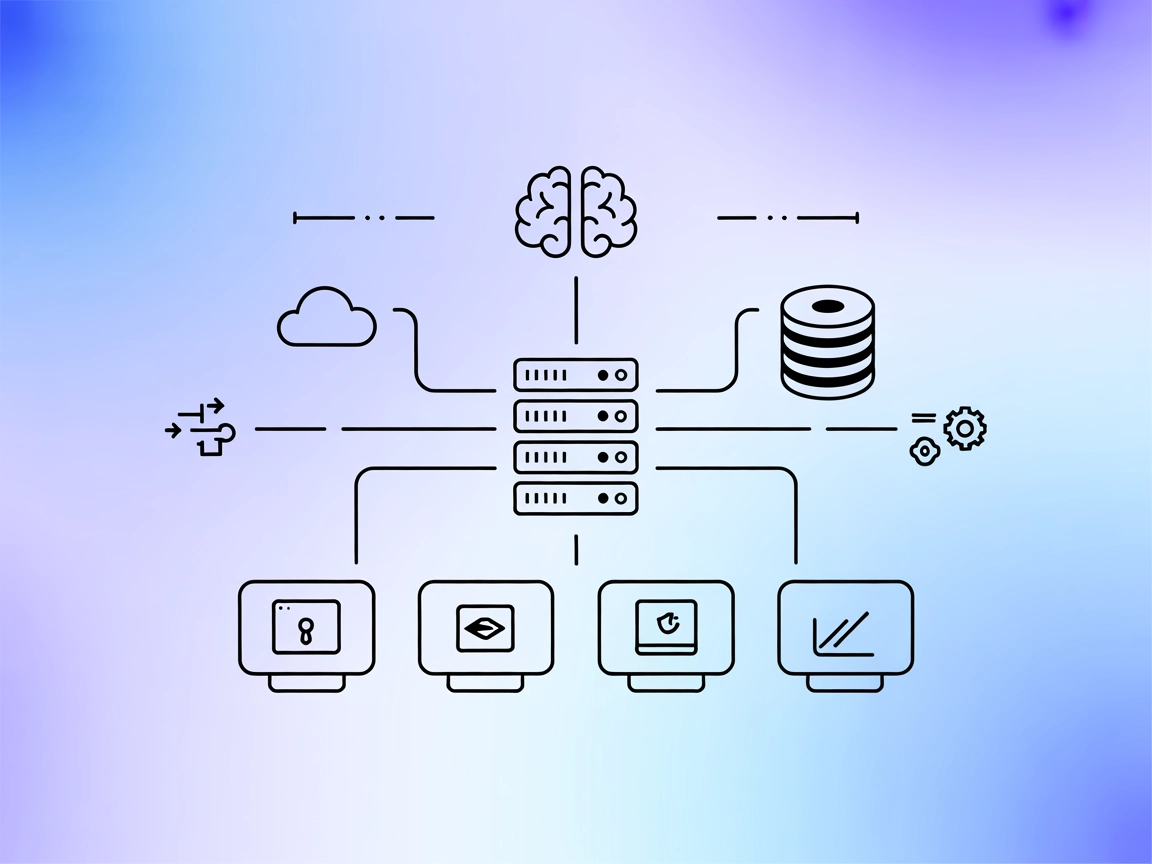

DeepSeek MCP-server fungerar som en säker proxy som kopplar DeepSeeks avancerade språkmodeller till MCP-kompatibla applikationer som Claude Desktop eller FlowHu...

DeepSeek MCP-server fungerar som en integritetsfokuserad brygga mellan dina applikationer och DeepSeek’s språkmodeller, vilket möjliggör säker och skalbar AI-integration.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

DeepSeek MCP-server är en Model Context Protocol (MCP) server utformad för att integrera DeepSeek’s avancerade språkmodeller med MCP-kompatibla applikationer, såsom Claude Desktop. Den fungerar som en brygga som låter AI-assistenter ansluta till DeepSeek’s API:er och underlättar uppgifter som språkgenerering, textanalys och mer. Servern fungerar som en proxy, vilket innebär att API-förfrågningar hanteras säkert och anonymt—endast proxyservern är synlig för DeepSeek API, inte klienten. Denna utformning stärker integriteten, förenklar arbetsflödesintegration och ger utvecklare och AI-verktyg möjlighet att utnyttja DeepSeek’s kapacitet för förbättrad utveckling, forskning och automation.

Inga promptmallar har listats i arkivet eller dokumentationen.

Inga explicita MCP-resurser är dokumenterade i arkivet eller README.

Ingen explicit lista över verktyg eller verktygsfunktioner beskrivs i README eller synliga arkivinnehåll.

windsurf.config.json).mcpServers med kommando och argument.{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

mcpServers.{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

mcpServers.{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

mcpServers.{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"]

}

}

}

Lagra din DeepSeek API-nyckel i en miljövariabel för säkerhet. Skicka den till servern via env-sektionen:

{

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["@deepseek/mcp-server@latest"],

"env": {

"DEEPSEEK_API_KEY": "${DEEPSEEK_API_KEY}"

}

}

}

}

Använda MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde börjar du med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion anger du dina MCP-serveruppgifter med detta JSON-format:

{

"deepseek-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När den är konfigurerad kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och kapaciteter. Kom ihåg att ändra “deepseek-mcp” till det faktiska namnet på din MCP-server och ersätta URL:en med din egen MCP-server-URL.

| Sektion | Tillgänglighet | Detaljer/Kommentarer |

|---|---|---|

| Översikt | ✅ | Översikt finns i README |

| Lista över promptar | ⛔ | Inga promptmallar listade |

| Lista över resurser | ⛔ | Inga explicita MCP-resurser dokumenterade |

| Lista över verktyg | ⛔ | Inga explicita verktyg beskrivna |

| Skydda API-nycklar | ✅ | Exempel ges med miljövariabler |

| Sampling-stöd (mindre viktigt vid utvärdering) | ⛔ | Ingen information om sampling-stöd |

Roots-stöd: Ej nämnt

Jag skulle betygsätta denna MCP-server till 4/10 för dokumentation och praktisk användbarhet baserat på README och arkivinnehåll. Även om installation och integritetsfunktioner är tydliga, finns det brist på detaljer kring promptar, resurser och verktyg, vilket begränsar användbarheten för avancerade MCP-arbetsflöden.

| Har en LICENSE | ✅ (MIT) |

|---|---|

| Har minst ett verktyg | ⛔ |

| Antal Forks | 32 |

| Antal Stars | 242 |

DeepSeek MCP-server är en proxy som integrerar DeepSeek’s språkmodeller med MCP-kompatibla applikationer och ger säker, anonymiserad åtkomst till DeepSeek API:er för uppgifter som språkxadgenerering och analys.

Den fungerar som en proxy, vilket innebär att DeepSeek API endast ser servern och inte klienten. Detta säkerställer att API-förfrågningar hanteras anonymt och skyddar klientens identitet samt API-nycklar.

Användningsområden inkluderar integration av DeepSeek-modeller i utvecklarverktyg, automatisering av innehållsgenerering eller analys, möjliggörande av integritetsbevarande AI-arbetsflöden samt skalbar språkmodellåtkomst i MCP-baserade system.

Lagra API-nyckeln i en miljövariabel och skicka den till servern via `env`-sektionen i konfigurationen. Detta förhindrar oavsiktlig exponering i kod eller loggar.

Nej, den aktuella dokumentationen listar inga promptmallar eller explicita verktygsfunktioner för denna MCP-server.

Lägg till MCP-komponenten i ditt FlowHunt-flöde, öppna dess konfiguration och ange dina MCP-serveruppgifter i systemets MCP-konfigurationssektion med hjälp av det angivna JSON-formatet.

Upplev säker, skalbar och integritetsbevarande åtkomst till DeepSeek’s kraftfulla språkmodeller via DeepSeek MCP-server. Perfekt för utvecklare, forskare och AI-verktygsbyggare.

DeepSeek MCP-server fungerar som en säker proxy som kopplar DeepSeeks avancerade språkmodeller till MCP-kompatibla applikationer som Claude Desktop eller FlowHu...

Deepseek Thinker MCP-server integrerar Deepseek-modellens resonemang i MCP-aktiverade AI-klienter som Claude Desktop, och ger avancerade chain-of-thought-utdata...

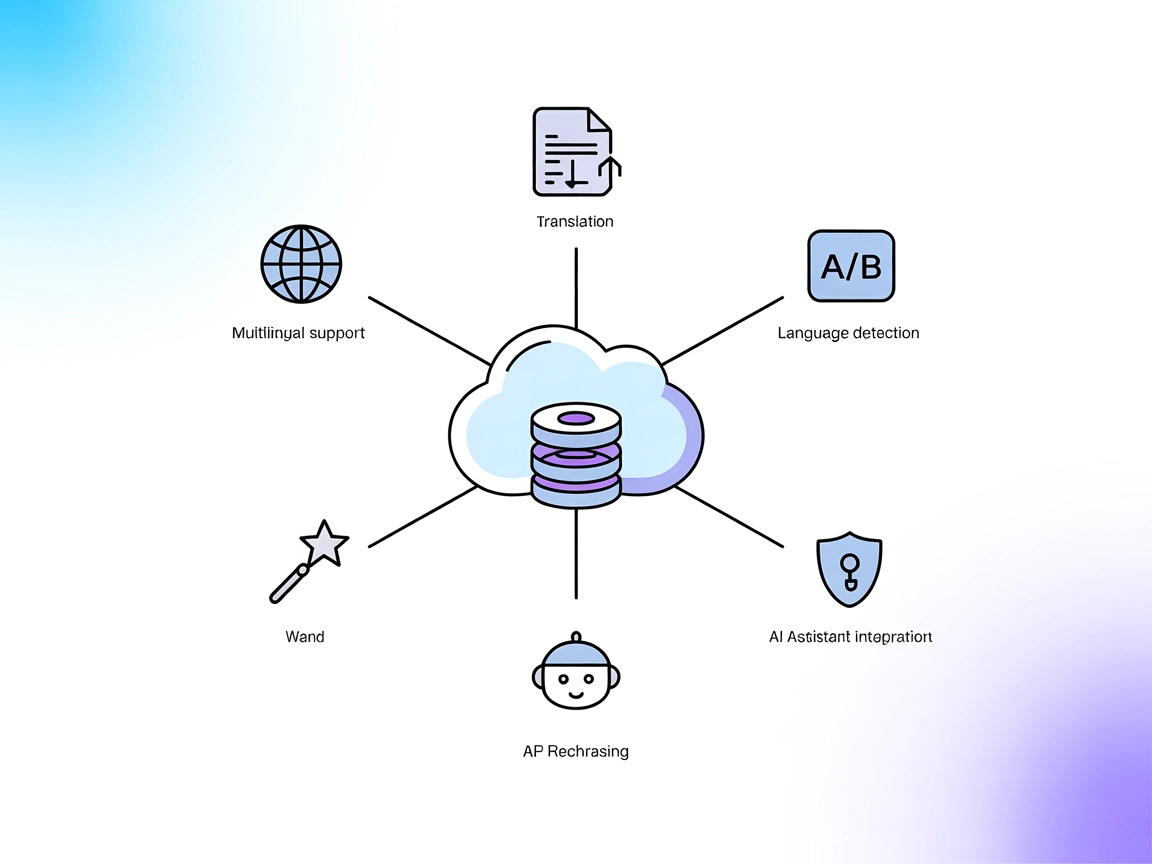

DeepL MCP-servern integrerar avancerad översättning, omformulering och språkdetektering i AI-arbetsflöden via DeepL API. Den ger FlowHunt och andra AI-assistent...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.