Vega-Lite Server

Integrera FlowHunt med Vega-Lite-servern för att låsa upp avancerade datavisualiseringsmöjligheter i dina AI-arbetsflöden. Skapa och rendera interaktiva diagram...

Gör det möjligt för dina AI-agenter och assistenter att visualisera och hantera data med Vega-Lite, och integrera avancerad diagramgenerering och datautforskning sömlöst i dina arbetsflöden.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

VegaLite MCP-servern är en Model Context Protocol (MCP)-serverimplementering som ger stora språkmodeller (LLM:er) ett gränssnitt för att visualisera data med Vega-Lite-syntax. Genom att ansluta till denna server kan AI-assistenter och applikationer avlasta uppgifter som att spara tabulär data och skapa visualiseringar (diagram, grafer, etc.) definierade i Vega-Lite-specifikationen. Detta förbättrar utvecklarens arbetsflöde genom att möjliggöra sömlös programmatisk datavisualisering, vilket låter LLM:er både hantera dataset och skapa anpassade visuella utdata som är viktiga för dataanalys, rapportering och forskning. Servern stöder att returnera antingen hela Vega-Lite-specifikationen med data bifogad (i textläge) eller en base64-kodad PNG-bild av visualiseringen (i bildläge), vilket gör den flexibel för olika integrationsscenarier.

Inga promptmallar finns listade i arkivet.

Inga explicita MCP-resurser är dokumenterade i arkivet.

name (string): Namn på datatabellen som ska sparas.data (array): Array av objekt som representerar datatabellen.data_name (string): Namn på datatabellen som ska visualiseras.vegalite_specification (string): JSON-sträng som representerar Vega-Lite-specifikationen.--output_type är satt till text returneras hela Vega-Lite-specifikationen med data; om satt till png, returneras en base64-kodad PNG-bild.Inga installationsinstruktioner för Windsurf finns listade i arkivet.

claude_desktop_config.json.mcpServers.{

"mcpServers": {

"datavis": {

"command": "uv",

"args": [

"--directory",

"/absolute/path/to/mcp-datavis-server",

"run",

"mcp_server_datavis",

"--output_type",

"png" // eller "text"

]

}

}

}

Inga specifika instruktioner eller exempel på säker hantering av API-nycklar finns i arkivet.

Inga installationsinstruktioner för Cursor finns listade i arkivet.

Inga installationsinstruktioner för Cline finns listade i arkivet.

Använda MCP i FlowHunt

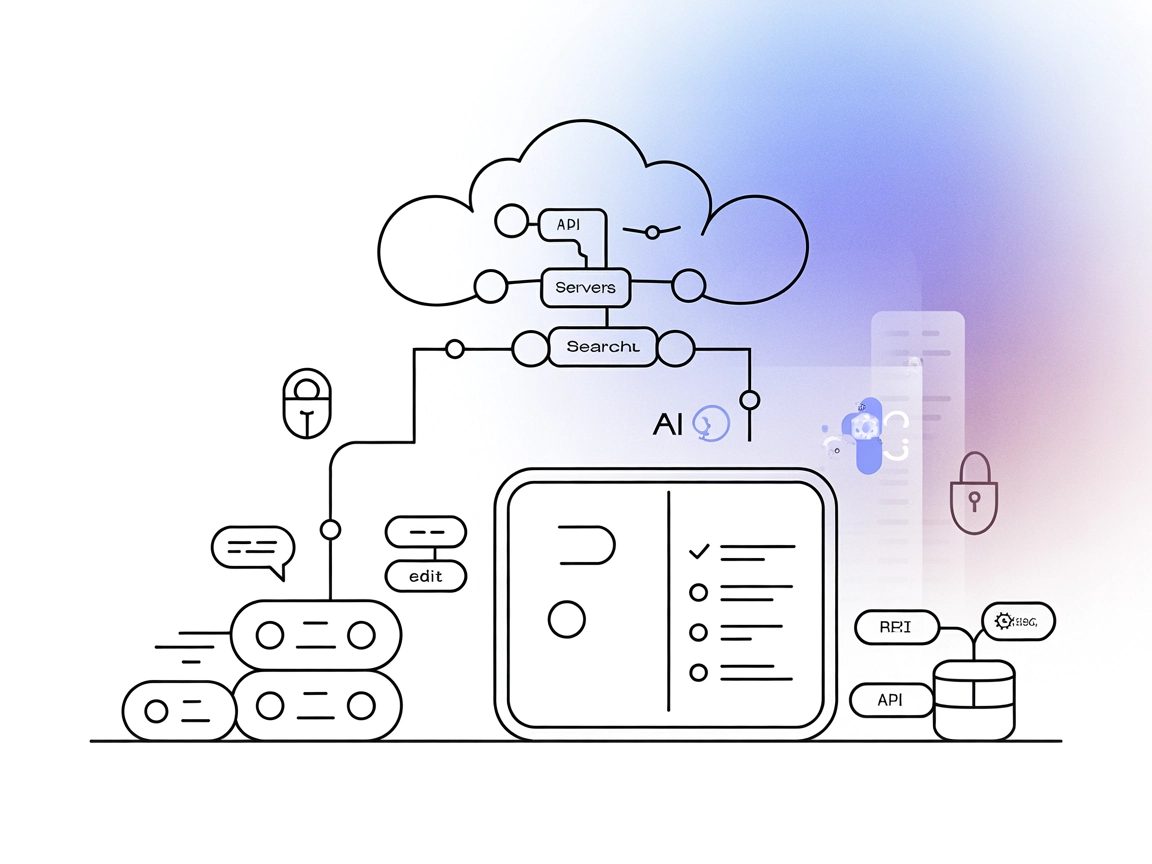

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion matar du in dina MCP-serveruppgifter med detta JSON-format:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När detta är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och möjligheter. Kom ihåg att byta ut “MCP-name” till det faktiska namnet på din MCP-server (t.ex. “vegalite”, “data-vis”, etc.) och ersätt URL:en med din egen MCP-server URL.

| Sektion | Tillgänglighet | Detaljer/Kommentarer |

|---|---|---|

| Översikt | ✅ | Tydlig sammanfattning i README |

| Lista över promptar | ⛔ | Inga promptmallar listade |

| Lista över resurser | ⛔ | Inga explicita resurser listade |

| Lista över verktyg | ✅ | save_data, visualize_data dokumenterade |

| Säker hantering av API-nycklar | ⛔ | Ingen info om säker hantering av eller överföring av API-nycklar |

| Stöd för sampling (mindre viktigt vid utvärdering) | ⛔ | Ej nämnt |

Baserat på tabellen ovan är VegaLite MCP-servern fokuserad och väl dokumenterad vad gäller verktyg och översikt, men saknar information om promptar, resurser och säkerhetsinställningar, vilket begränsar dess integrationsbetyg ur lådan.

MCP VegaLite-servern är enkel med ett tydligt gränssnitt för datavisualisering via LLM:er. Avsaknaden av promptmallar, resurser och säkerhetsvägledning drar dock ner användbarheten för mer avancerade eller produktionsnära scenarier. Dess största värde ligger i dess funktionella verktyg för att spara och visualisera data, men den övergripande fullständigheten och utbyggbarheten är begränsad.

Betyg: 5/10

| Har LICENSE | ⛔ |

|---|---|

| Har minst ett verktyg | ✅ |

| Antal forkar | 18 |

| Antal stjärnor | 72 |

Den tillhandahåller ett gränssnitt för stora språkmodeller att visualisera data med Vega-Lite-syntax, vilket gör det möjligt att hantera dataset och skapa anpassade visuella utdata som diagram eller grafer för dataanalys, rapportering och utbildningssyften.

Den erbjuder två huvudverktyg: `save_data` för att spara en tabell med dataaggregeringar för visualisering, och `visualize_data` för att skapa visualiseringar med Vega-Lite-specifikationer, där resultatet kan vara antingen en full specifikation med data (text) eller en PNG-bild.

Lägg till MCP-komponenten i ditt flöde, öppna konfigurationen och mata in dina MCP-serveruppgifter i det JSON-format som finns i dokumentationen, och byt ut namn och URL vid behov.

Den är idealisk för programmatisk dataanalys och visualisering, automatiserad rapportering, interaktiv datautforskning och utbildningsverktyg där användare eller AI-agenter behöver visualisera dataset och lära sig om datavisualisering interaktivt.

Inga specifika instruktioner eller exempel på säker hantering av API-nycklar finns i arkivet.

Förbättra dina datadrivna projekt med AI-drivna datavisualiseringar i realtid med VegaLite MCP-server på FlowHunt.

Integrera FlowHunt med Vega-Lite-servern för att låsa upp avancerade datavisualiseringsmöjligheter i dina AI-arbetsflöden. Skapa och rendera interaktiva diagram...

Vectara MCP Server är en öppen källkodslösning som fungerar som en brygga mellan AI-assistenter och Vectaras Trusted RAG-plattform, vilket möjliggör säker och e...

Linear MCP-servern kopplar samman Linears projektledningsplattform med AI-assistenter och LLM:er, vilket ger team möjlighet att automatisera ärendehantering, sö...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.