Máy chủ Wikidata MCP

Máy chủ Wikidata MCP cho phép các tác nhân AI và nhà phát triển tương tác với API Wikidata thông qua Model Context Protocol. Nó cung cấp các công cụ để tìm kiếm...

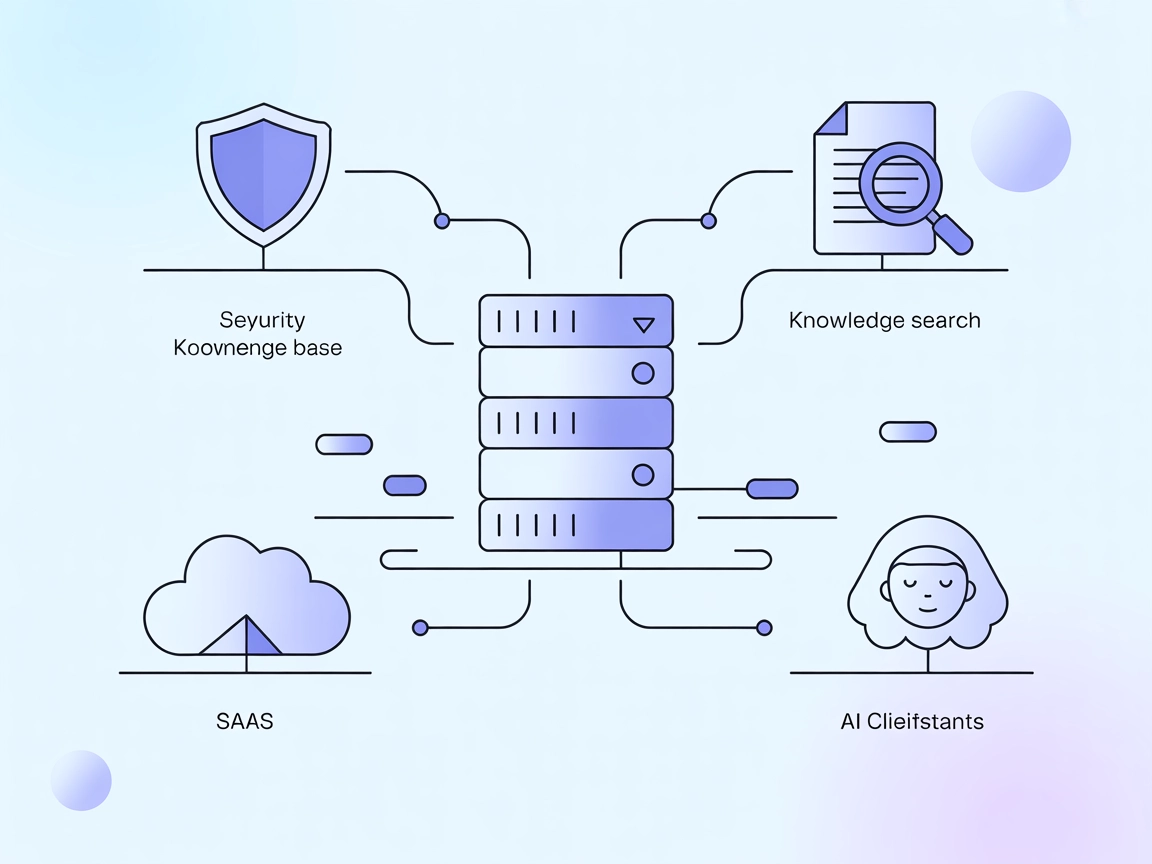

Kết nối an toàn các agent FlowHunt với nền tảng RAG mạnh mẽ của Vectara bằng Vectara MCP Server để có các phản hồi AI đáng tin cậy, giàu ngữ cảnh và truy xuất tri thức nâng cao.

FlowHunt cung cấp một lớp bảo mật bổ sung giữa các hệ thống nội bộ của bạn và các công cụ AI, mang lại cho bạn quyền kiểm soát chi tiết về những công cụ nào có thể truy cập từ các máy chủ MCP của bạn. Các máy chủ MCP được lưu trữ trong cơ sở hạ tầng của chúng tôi có thể được tích hợp liền mạch với chatbot của FlowHunt cũng như các nền tảng AI phổ biến như ChatGPT, Claude và các trình chỉnh sửa AI khác nhau.

Vectara MCP Server là một triển khai mã nguồn mở của Model Context Protocol (MCP) được thiết kế để kết nối các trợ lý AI với nền tảng Trusted RAG (Retrieval-Augmented Generation) của Vectara. Khi hoạt động như một MCP server, nó cho phép hệ thống AI thực hiện các tác vụ tìm kiếm và truy xuất phức tạp một cách an toàn, hiệu quả trên công cụ truy xuất đáng tin cậy của Vectara. Điều này tạo điều kiện thuận lợi cho việc kết nối hai chiều giữa các client AI và nguồn dữ liệu bên ngoài, giúp nhà phát triển mở rộng quy trình với khả năng RAG nâng cao, giảm ảo giác và tối ưu truy cập thông tin liên quan cho ứng dụng AI sinh ngữ cảnh.

Không có mẫu prompt cụ thể nào được đề cập trong tài liệu hoặc file repository hiện có.

Không có tài nguyên MCP cụ thể nào được liệt kê trong tài liệu hoặc file repository hiện có.

pip install vectara-mcp.mcpServers của bạn:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp).mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

Rất khuyến khích lưu các API key nhạy cảm trong biến môi trường thay vì file cấu hình. Ví dụ:

{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": [],

"env": {

"VECTARA_API_KEY": "${VECTARA_API_KEY}"

},

"inputs": {

"api_key": "${VECTARA_API_KEY}"

}

}

}

}

Sử dụng MCP trong FlowHunt

Để tích hợp MCP server vào workflow FlowHunt, hãy bắt đầu bằng cách thêm thành phần MCP vào flow và kết nối với agent AI của bạn:

Nhấp vào thành phần MCP để mở bảng cấu hình. Trong phần cấu hình MCP hệ thống, chèn thông tin MCP server bằng định dạng JSON sau:

{

"vectara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Sau khi cấu hình, agent AI sẽ có thể sử dụng MCP này như một công cụ với toàn bộ chức năng của nó. Lưu ý thay “vectara-mcp” thành tên thực tế của MCP server bạn sử dụng và thay đường dẫn URL bằng URL MCP server của bạn.

| Mục | Sẵn có | Chi tiết/Ghi chú |

|---|---|---|

| Tổng quan | ✅ | Đã cung cấp tổng quan và chức năng Vectara MCP Server |

| Danh sách Prompt | ⛔ | Không được đề cập trong tài liệu hiện có |

| Danh sách Tài nguyên | ⛔ | Không được đề cập trong tài liệu hiện có |

| Danh sách Công cụ | ✅ | Chỉ công cụ ask_vectara được mô tả |

| Bảo mật API Key | ✅ | Được ghi rõ với ví dụ JSON/env |

| Hỗ trợ sampling (không quan trọng để đánh giá) | ⛔ | Không được đề cập |

Vectara MCP cung cấp tích hợp rõ ràng, tập trung cho RAG với tài liệu hướng dẫn thiết lập và bảo mật API key đầy đủ, nhưng thiếu chi tiết về prompt, tài nguyên hoặc sampling/roots. Đây là lựa chọn tốt để triển khai RAG trong workflow agentic, tuy nhiên việc thiếu các tính năng MCP mở rộng làm hạn chế tính đa dụng.

| Có LICENSE | ✅ (Apache-2.0) |

|---|---|

| Có ít nhất một công cụ | ✅ |

| Số lượng Fork | 2 |

| Số lượng Star | 8 |

Đánh giá: 5/10 — Ổn định, sẵn sàng sản xuất cho use case RAG, nhưng chỉ bao phủ tập tính năng MCP tối thiểu và thiếu tài liệu về prompt, tài nguyên cũng như các khái niệm MCP nâng cao.

Vectara MCP Server là một triển khai mã nguồn mở của Model Context Protocol, kết nối các trợ lý AI với nền tảng Trusted RAG của Vectara. Nó cho phép tìm kiếm và truy xuất hiệu quả, an toàn cho quy trình AI sinh ngữ cảnh.

Công cụ chính là `ask_vectara`, thực hiện truy vấn RAG lên Vectara và trả về kết quả tìm kiếm kèm phản hồi sinh. Công cụ này cần truy vấn người dùng, khóa corpus của Vectara và API key.

Các trường hợp sử dụng chính gồm Retrieval-Augmented Generation (RAG) giúp giảm ảo giác, tích hợp tìm kiếm doanh nghiệp, tự động hóa quản lý tri thức và truy cập dữ liệu nhạy cảm an toàn qua bảo vệ API-key.

Lưu các API key trong biến môi trường thay vì hardcode trong file cấu hình. Sử dụng cấu hình JSON với biến như `${VECTARA_API_KEY}` để tăng cường bảo mật.

Thêm thành phần MCP vào flow FlowHunt, cấu hình với thông tin MCP server của bạn và kết nối với agent AI. Điều này cho phép agent truy cập các khả năng truy xuất nâng cao của Vectara.

Dù mạnh về RAG và tìm kiếm, hiện tại chưa có tài liệu chi tiết về prompt template, tài nguyên MCP bổ sung, cũng như các tính năng sampling hoặc MCP root nâng cao.

Cung cấp cho agent AI của bạn các phản hồi an toàn, chính xác và nhận thức ngữ cảnh bằng cách tích hợp Vectara MCP Server vào quy trình FlowHunt.

Máy chủ Wikidata MCP cho phép các tác nhân AI và nhà phát triển tương tác với API Wikidata thông qua Model Context Protocol. Nó cung cấp các công cụ để tìm kiếm...

Tích hợp Máy chủ Vectorize MCP với FlowHunt để kích hoạt truy xuất vector nâng cao, tìm kiếm ngữ nghĩa và trích xuất văn bản, mang lại quy trình AI mạnh mẽ. Kết...

Máy chủ Vantage MCP kết nối trợ lý AI và các khách hàng MCP với dữ liệu chi phí đám mây của bạn, cho phép truy vấn và phân tích chi tiêu đám mây bằng ngôn ngữ t...