Integração com Vectorize MCP Server

Integre o Vectorize MCP Server com o FlowHunt para habilitar recuperação avançada de vetores, busca semântica e extração de texto para fluxos de trabalho podero...

Automação de IA

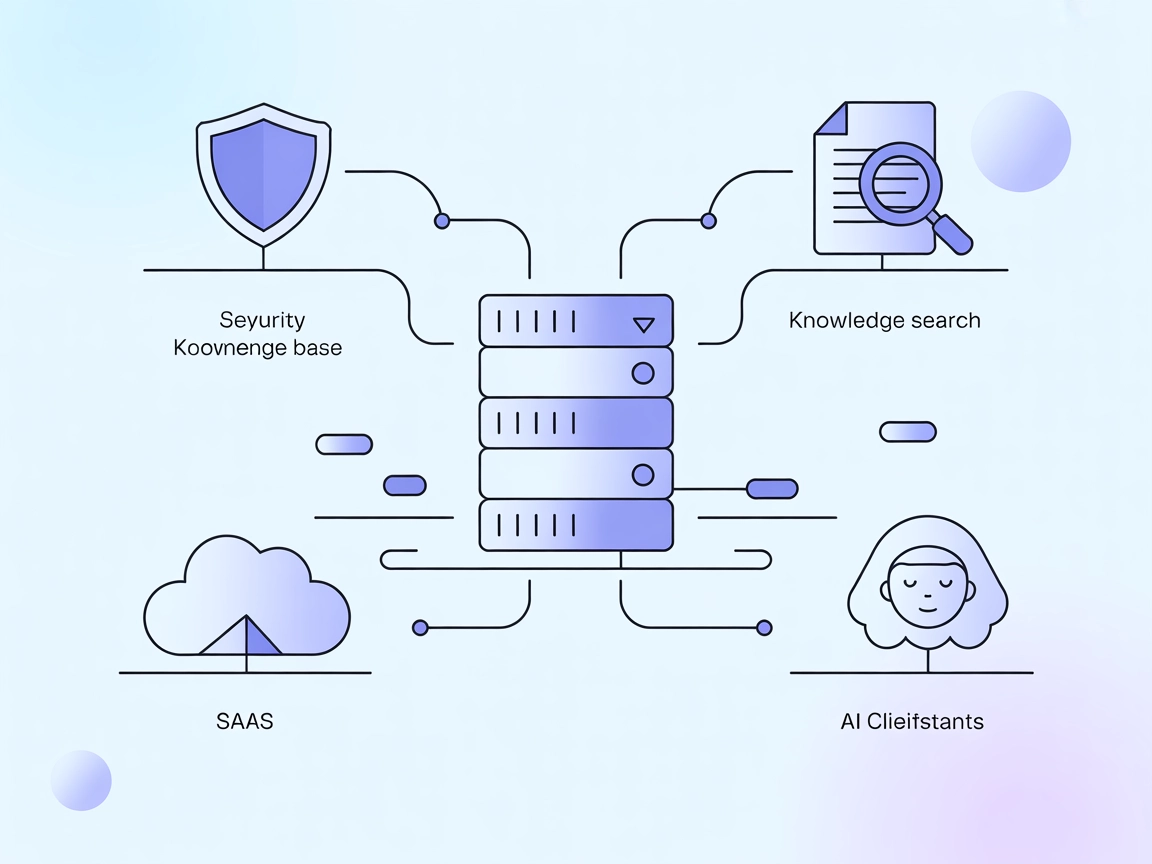

Conecte com segurança agentes FlowHunt à poderosa plataforma RAG da Vectara com o Vectara MCP Server para respostas de IA confiáveis, ricas em contexto e recuperação avançada de conhecimento.

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Vectara MCP Server é uma implementação open source do Model Context Protocol (MCP) projetada para conectar assistentes de IA à plataforma Trusted RAG (Geração Aumentada por Recuperação) da Vectara. Atuando como um servidor MCP, ele permite que sistemas de IA realizem tarefas sofisticadas de busca e recuperação de forma segura e eficiente usando o robusto mecanismo de recuperação da Vectara. Isso possibilita conexões bidirecionais e sem atrito entre clientes de IA e fontes externas de dados, permitindo que desenvolvedores aumentem seus fluxos com capacidades avançadas de RAG, minimizem alucinações e otimizem o acesso a informações relevantes para aplicações de IA generativa.

Nenhum template de prompt específico é mencionado na documentação disponível ou nos arquivos do repositório.

Nenhum recurso MCP explícito é listado na documentação disponível ou nos arquivos do repositório.

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp).mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

Recomenda-se fortemente armazenar chaves de API sensíveis em variáveis de ambiente em vez de arquivos de configuração. Exemplo:

{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": [],

"env": {

"VECTARA_API_KEY": "${VECTARA_API_KEY}"

},

"inputs": {

"api_key": "${VECTARA_API_KEY}"

}

}

}

}

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo de trabalho FlowHunt, comece adicionando o componente MCP ao seu flow e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do sistema MCP, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"vectara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Uma vez configurado, o agente de IA já pode usar esse MCP como ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de alterar “vectara-mcp” para o nome real do seu servidor MCP e substituir a URL pela URL do seu próprio servidor MCP.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | Visão geral e função do Vectara MCP Server fornecida |

| Lista de Prompts | ⛔ | Não especificado na documentação disponível |

| Lista de Recursos | ⛔ | Não especificado na documentação disponível |

| Lista de Ferramentas | ✅ | Apenas a ferramenta ask_vectara descrita |

| Proteção de Chaves de API | ✅ | Documentado com exemplo de JSON/env |

| Suporte a Sampling (menos relevante na avaliação) | ⛔ | Não especificado |

O Vectara MCP oferece uma integração clara e focada para RAG, com documentação forte para configuração e segurança de API key, mas carece de detalhes sobre prompts, recursos ou sampling/roots. É ótimo para habilitar RAG em fluxos agentivos, mas a ausência de recursos MCP mais ricos limita sua versatilidade.

| Possui uma LICENÇA | ✅ (Apache-2.0) |

|---|---|

| Possui ao menos uma ferramenta | ✅ |

| Número de Forks | 2 |

| Número de Stars | 8 |

Avaliação: 5/10 — É sólido e pronto para produção em seu caso de uso RAG, mas cobre apenas um conjunto mínimo de recursos MCP e carece de documentação sobre prompts, recursos e conceitos avançados de MCP.

Potencialize seus agentes de IA com respostas seguras, factuais e sensíveis ao contexto integrando o Vectara MCP Server aos seus fluxos de trabalho FlowHunt.

Integre o Vectorize MCP Server com o FlowHunt para habilitar recuperação avançada de vetores, busca semântica e extração de texto para fluxos de trabalho podero...

Integre o FlowHunt com o Vectara MCP para potencializar seus agentes de IA e aplicações RAG com buscas confiáveis e de baixa alucinação utilizando o Model Conte...

O Servidor MCP do VertexAI Search conecta assistentes de IA ao Google Vertex AI Search, permitindo que consultem e recuperem informações de conjuntos de dados p...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.