Chat MCP Server

Chat MCP ist eine plattformübergreifende Desktop-Chat-Anwendung, die das Model Context Protocol (MCP) nutzt, um mit verschiedenen Large Language Models (LLMs) z...

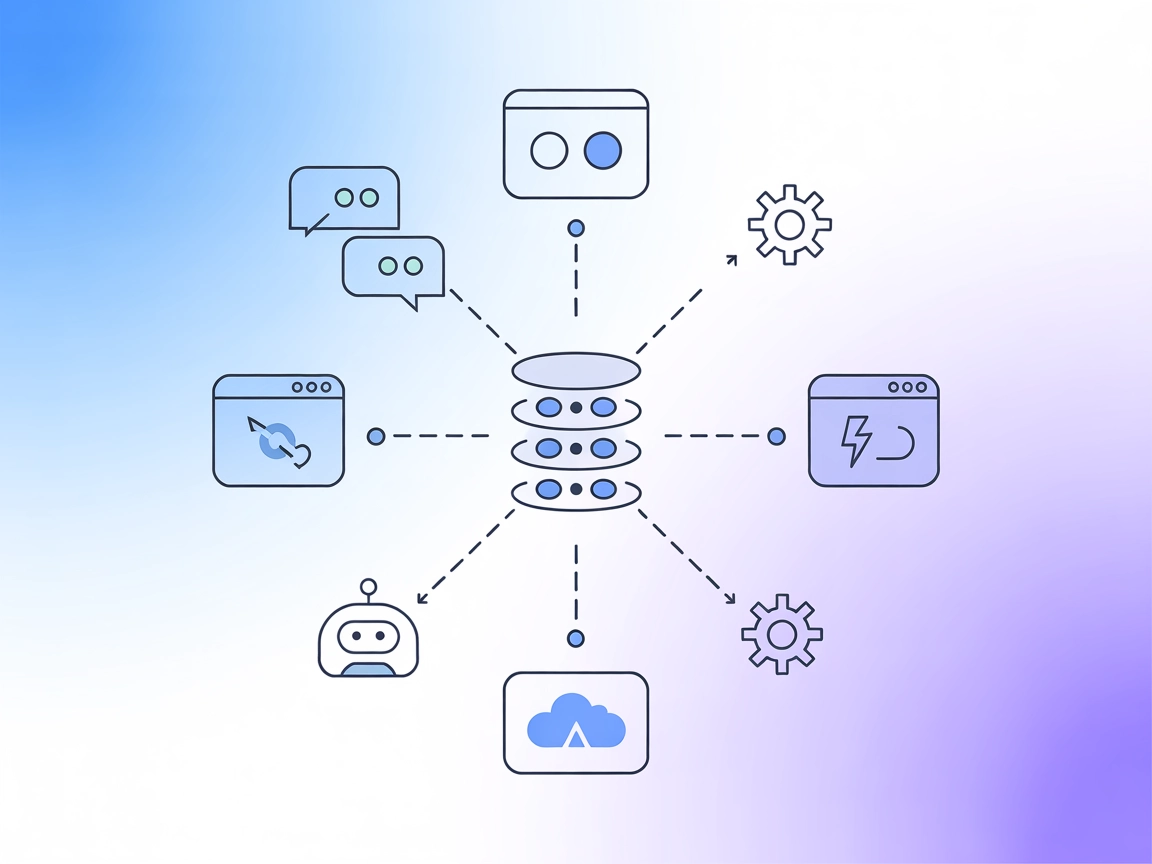

Verbinden Sie sich mühelos mit jeder OpenAI-kompatiblen Chat-API über einen einzigen MCP-Server und optimieren Sie Multi-Provider-LLM-Workflows in FlowHunt und darüber hinaus.

FlowHunt bietet eine zusätzliche Sicherheitsschicht zwischen Ihren internen Systemen und KI-Tools und gibt Ihnen granulare Kontrolle darüber, welche Tools von Ihren MCP-Servern aus zugänglich sind. In unserer Infrastruktur gehostete MCP-Server können nahtlos mit FlowHunts Chatbot sowie beliebten KI-Plattformen wie ChatGPT, Claude und verschiedenen KI-Editoren integriert werden.

Der any-chat-completions-mcp MCP-Server fungiert als Brücke zwischen KI-Assistenten und jeder OpenAI SDK-kompatiblen Chat Completion API, wie OpenAI, Perplexity, Groq, xAI und PyroPrompts. Durch die Einhaltung des Model Context Protocol (MCP) ermöglicht er die nahtlose Integration externer LLM-Anbieter in Entwicklungs-Workflows. Seine Hauptfunktion besteht darin, chatbasierte Fragen an einen konfigurierten KI-Chat-Anbieter weiterzuleiten, sodass Entwickler verschiedene LLMs als Tools in ihrer bevorzugten Umgebung nutzen können. So wird das Wechseln zwischen Anbietern oder das Skalieren der LLM-Nutzung unkompliziert, was Flexibilität und Effizienz in KI-gestützten Anwendungen fördert.

Im Repository oder in der Dokumentation werden keine Prompt-Templates erwähnt.

Im Repository oder README sind keine expliziten MCP-Ressourcen dokumentiert.

Für Windsurf sind im Repository oder in der Dokumentation keine plattformspezifischen Anweisungen vorhanden.

npx installiert sind.claude_desktop_config.json (unter MacOS: ~/Library/Application Support/Claude/claude_desktop_config.json; unter Windows: %APPDATA%/Claude/claude_desktop_config.json).mcpServers hinzu.env-Objekt ein.Beispiel-JSON:

{

"mcpServers": {

"chat-openai": {

"command": "npx",

"args": [

"@pyroprompts/any-chat-completions-mcp"

],

"env": {

"AI_CHAT_KEY": "OPENAI_KEY",

"AI_CHAT_NAME": "OpenAI",

"AI_CHAT_MODEL": "gpt-4o",

"AI_CHAT_BASE_URL": "v1/chat/completions"

}

}

}

}

API-Schlüssel sichern (per Umgebungsvariablen):

"env": {

"AI_CHAT_KEY": "IHR_PROVIDER_KEY"

}

Für Cursor sind im Repository oder in der Dokumentation keine plattformspezifischen Anweisungen vorhanden.

Für Cline sind im Repository oder in der Dokumentation keine plattformspezifischen Anweisungen vorhanden.

Verwendung von MCP in FlowHunt

Um MCP-Server in Ihren FlowHunt-Workflow zu integrieren, fügen Sie zunächst die MCP-Komponente zu Ihrem Flow hinzu und verbinden Sie sie mit Ihrem KI-Agenten:

Klicken Sie auf die MCP-Komponente, um das Konfigurationspanel zu öffnen. Im Bereich System-MCP-Konfiguration fügen Sie Ihre MCP-Server-Daten im folgenden JSON-Format ein:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://ihremcpserver.beispiel/pathtothemcp/url"

}

}

Nach der Konfiguration kann der KI-Agent diesen MCP als Tool mit Zugriff auf alle Funktionen und Möglichkeiten verwenden. Denken Sie daran, “MCP-name” durch den tatsächlichen Namen Ihres MCP-Servers zu ersetzen (z.B. “github-mcp”, “weather-api” etc.) und die URL auf Ihre eigene MCP-Server-URL anzupassen.

| Abschnitt | Verfügbarkeit | Details/Anmerkungen |

|---|---|---|

| Übersicht | ✅ | Zweck und Funktionen in README beschrieben |

| Liste der Prompts | ⛔ | Keine Prompt-Templates erwähnt |

| Liste der Ressourcen | ⛔ | Keine expliziten MCP-Ressourcen dokumentiert |

| Liste der Tools | ✅ | “chat”-Tool im README beschrieben |

| API-Schlüssel-Sicherung | ✅ | Verwendet “env” in JSON zur Schlüsselverwaltung |

| Sampling-Unterstützung (weniger wichtig) | ⛔ | Keine Erwähnung von Sampling-Features |

Basierend auf dem obigen ist any-chat-completions-mcp ein schlanker, fokussierter MCP-Server, ideal um generische OpenAI-kompatible Chat-APIs als Tools einzubinden. Seine Stärke liegt in Einfachheit und breiter Kompatibilität, er bietet jedoch keine Ressourcen- oder Prompt-Abstraktionen. Für Routine-LLM-Integrationen ist er robust, Power-User könnten sich mehr Features wünschen. Insgesamt würde ich diesen MCP mit 6/10 für den allgemeinen Einsatz bewerten.

| Hat eine LICENSE | ✅ (MIT) |

|---|---|

| Mindestens ein Tool | ✅ |

| Anzahl Forks | 17 |

| Anzahl Sterne | 129 |

Vereinheitlichen Sie Ihre KI-Chat-API-Verbindungen und wechseln Sie Anbieter mühelos mit dem any-chat-completions-mcp MCP-Server. Perfekt für Entwickler, die Flexibilität und Einfachheit suchen.

Chat MCP ist eine plattformübergreifende Desktop-Chat-Anwendung, die das Model Context Protocol (MCP) nutzt, um mit verschiedenen Large Language Models (LLMs) z...

Integrieren Sie FlowHunt mit Any Chat Completions MCP, um Claude, OpenAI, Perplexity, Groq, xAI, PyroPrompts und mehr über eine einheitliche, OpenAI-kompatible ...

Verbinden Sie KI-Assistenten wie Claude mit jeder API, die eine OpenAPI (Swagger)-Spezifikation bereitstellt. Der Any OpenAPI MCP Server ermöglicht semantische ...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.