Any Chat Completions MCP

Zintegruj FlowHunt z Any Chat Completions MCP, aby połączyć Claude, OpenAI, Perplexity, Groq, xAI, PyroPrompts i inne za pomocą zunifikowanego API kompatybilneg...

Łatwo połącz się z dowolnym API chat kompatybilnym z OpenAI za pomocą jednego serwera MCP, upraszczając pracę z wieloma dostawcami LLM w FlowHunt i nie tylko.

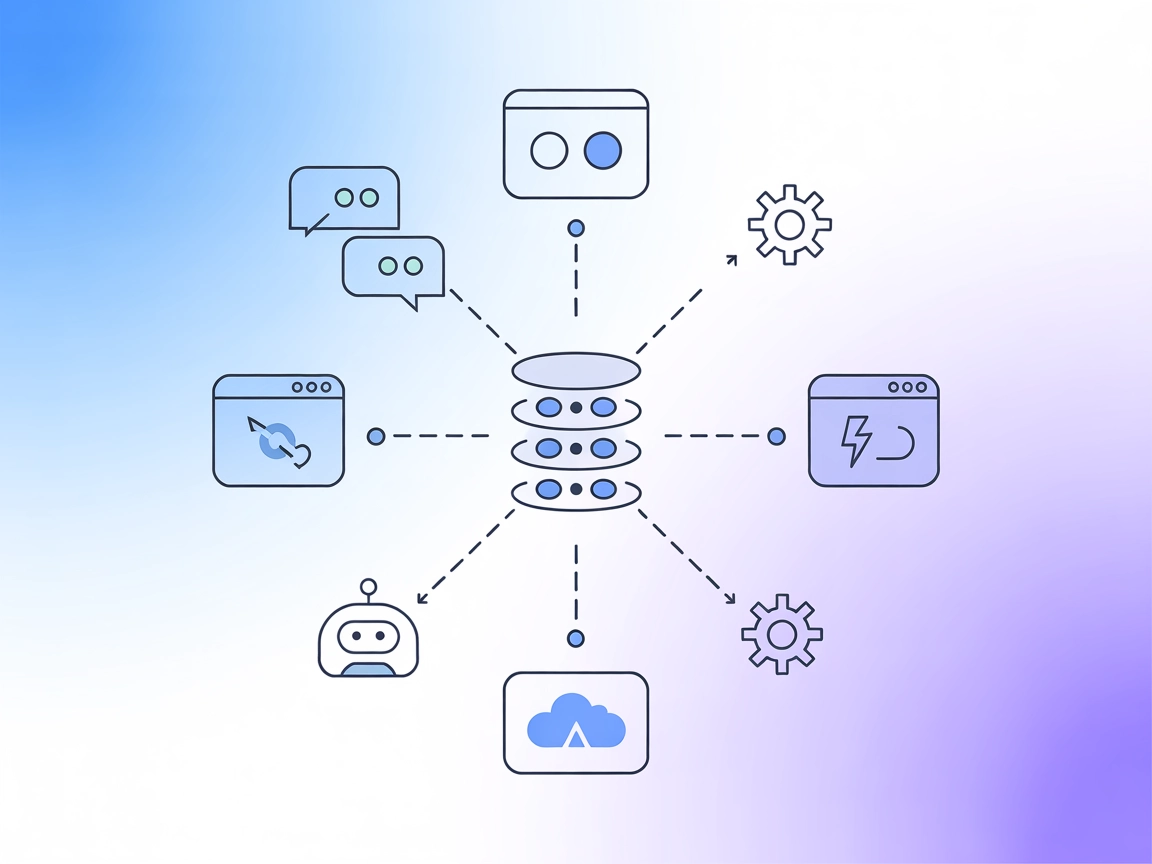

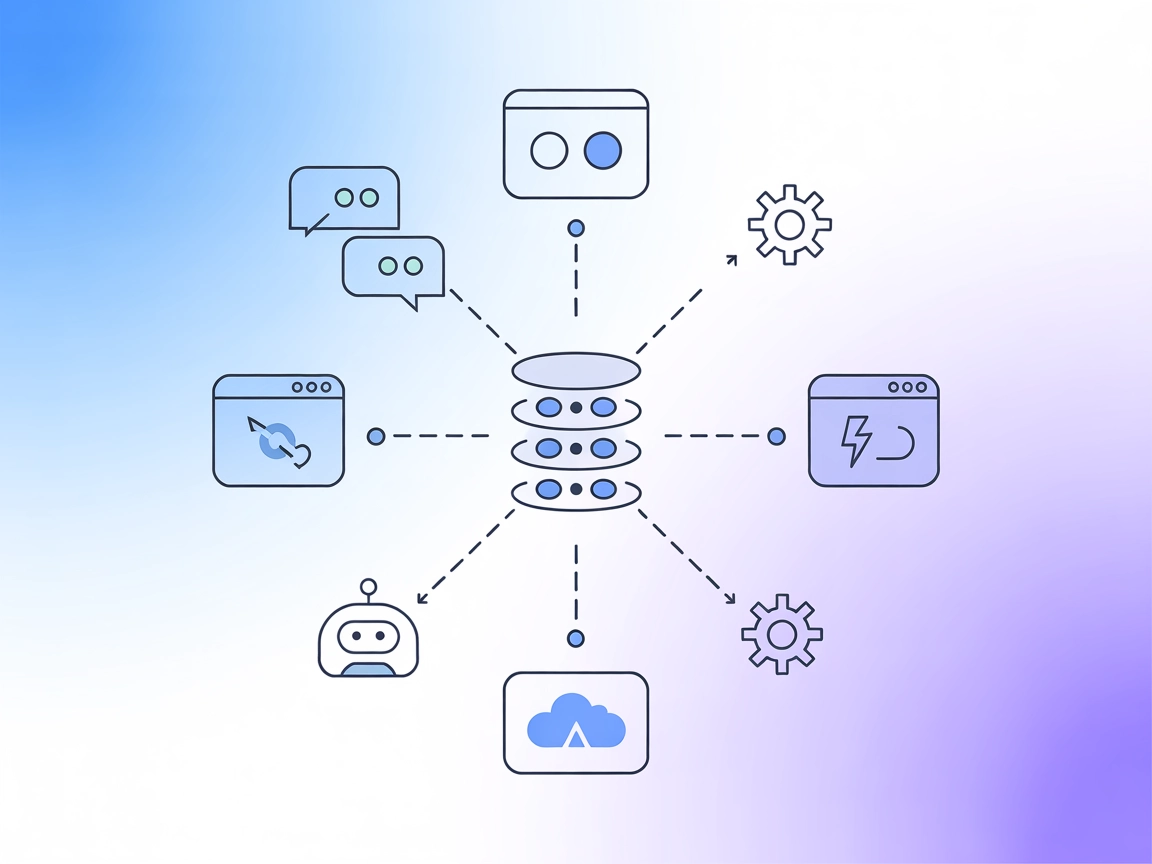

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

any-chat-completions-mcp to serwer MCP działający jako most między asystentami AI a dowolnym API Chat Completion kompatybilnym z SDK OpenAI, takim jak OpenAI, Perplexity, Groq, xAI czy PyroPrompts. Dzięki zgodności z Modelem Context Protocol (MCP) umożliwia płynną integrację zewnętrznych dostawców LLM w procesach developerskich. Jego główną funkcją jest przekazywanie pytań czatowych do wybranego dostawcy AI, pozwalając deweloperom korzystać z różnych LLM jako narzędzi w ulubionych środowiskach. Sprawia to, że przełączanie się między dostawcami lub skalowanie wykorzystania LLM jest proste, wspierając elastyczność i efektywność aplikacji AI.

W repozytorium ani dokumentacji nie wspomniano o szablonach promptów.

W repozytorium ani README nie opisano żadnych jawnych zasobów MCP.

W repozytorium ani dokumentacji nie podano instrukcji specyficznych dla platformy Windsurf.

npx.claude_desktop_config.json (na MacOS: ~/Library/Application Support/Claude/claude_desktop_config.json; na Windows: %APPDATA%/Claude/claude_desktop_config.json).mcpServers.env.Przykład JSON:

{

"mcpServers": {

"chat-openai": {

"command": "npx",

"args": [

"@pyroprompts/any-chat-completions-mcp"

],

"env": {

"AI_CHAT_KEY": "OPENAI_KEY",

"AI_CHAT_NAME": "OpenAI",

"AI_CHAT_MODEL": "gpt-4o",

"AI_CHAT_BASE_URL": "v1/chat/completions"

}

}

}

}

Zabezpieczanie kluczy API (przy użyciu zmiennych środowiskowych):

"env": {

"AI_CHAT_KEY": "YOUR_PROVIDER_KEY"

}

W repozytorium ani dokumentacji nie podano instrukcji specyficznych dla platformy Cursor.

W repozytorium ani dokumentacji nie podano instrukcji specyficznych dla platformy Cline.

Korzystanie z MCP w FlowHunt

Aby zintegrować serwery MCP z workflow w FlowHunt, dodaj komponent MCP do swojego flow i połącz go z agentem AI:

Kliknij na komponent MCP, aby otworzyć panel konfiguracyjny. W sekcji konfiguracyjnej systemu MCP wstaw dane swojego serwera MCP w tym formacie JSON:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może korzystać z tego MCP jako narzędzia ze wszystkimi jego funkcjami i możliwościami. Pamiętaj, aby „MCP-name” zastąpić właściwą nazwą swojego serwera MCP (np. „github-mcp”, „weather-api” itp.) i podać swój własny adres URL serwera MCP.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Podsumowanie | ✅ | Opisuje cel i funkcje w README |

| Lista promptów | ⛔ | Brak wzmianki o szablonach promptów |

| Lista zasobów | ⛔ | Brak jawnych zasobów MCP w dokumentacji |

| Lista narzędzi | ✅ | Narzędzie „chat” opisane w README |

| Zabezpieczanie kluczy API | ✅ | Używa „env” w JSON do zarządzania kluczami |

| Wsparcie dla sampling (mniej istotne) | ⛔ | Brak informacji o funkcjach sampling |

Na podstawie powyższego, any-chat-completions-mcp to wyspecjalizowany, odchudzony serwer MCP, idealny do dodawania ogólnych API czatowych kompatybilnych z OpenAI jako narzędzi. Jego główną zaletą jest prostota i szeroka kompatybilność, choć nie oferuje abstrakcji zasobów ani promptów. Do rutynowej integracji LLM jest solidny, jednak zaawansowani użytkownicy mogą oczekiwać większej liczby funkcji. Ogólna ocena tego MCP to 6/10 dla zastosowań ogólnych.

| Ma LICENCJĘ | ✅ (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | ✅ |

| Liczba forków | 17 |

| Liczba gwiazdek | 129 |

Ujednolić swoje połączenia z AI chat API i płynnie przełączaj dostawców dzięki serwerowi MCP any-chat-completions-mcp. Idealne dla deweloperów poszukujących elastyczności i prostoty.

Zintegruj FlowHunt z Any Chat Completions MCP, aby połączyć Claude, OpenAI, Perplexity, Groq, xAI, PyroPrompts i inne za pomocą zunifikowanego API kompatybilneg...

Chat MCP to wieloplatformowa aplikacja desktopowa do czatu, która wykorzystuje Model Context Protocol (MCP) do komunikacji z różnymi dużymi modelami językowymi ...

Serwer Chatsum MCP umożliwia agentom AI efektywne wyszukiwanie i podsumowywanie wiadomości czatu z bazy użytkownika, zapewniając zwięzłe podsumowania rozmów i w...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.