Librerías de Python para el desarrollo de servidores Model Context Protocol (MCP)

Ejemplo rápido de cómo desarrollar tu propio servidor MCP con Python.

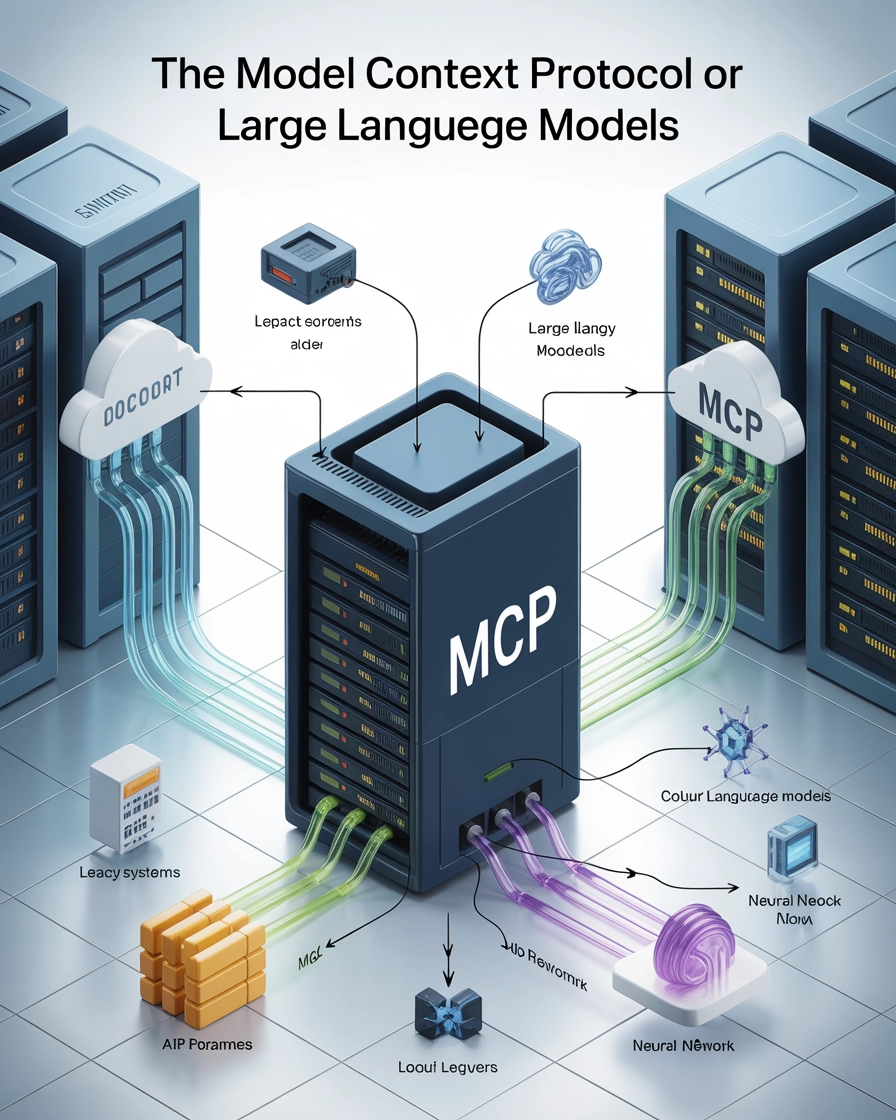

El Protocolo de Contexto de Modelo (MCP) es una interfaz de estándar abierto que permite a los Modelos de Lenguaje Grandes (LLM) acceder de forma segura y consistente a fuentes de datos externas, herramientas y capacidades, actuando como un ‘USB-C’ para los sistemas de IA.

El Protocolo de Contexto de Modelo (MCP) es una interfaz de estándar abierto que permite a los Modelos de Lenguaje Grandes (LLMs) acceder de forma segura y consistente a fuentes de datos externas, herramientas y capacidades. Establece una capa de comunicación estandarizada entre aplicaciones de IA y varios proveedores de contexto, funcionando como el “USB-C” para los sistemas de IA.

MCP sigue una arquitectura cliente-servidor:

MCP define tres primitivas fundamentales que constituyen los bloques básicos del protocolo:

Los Recursos representan datos y contenido que los servidores MCP ponen a disposición de los LLMs.

Ejemplo de uso: Un servidor MCP que expone un archivo de registro como recurso con URI file:///logs/app.log

Los Prompts son plantillas o flujos de trabajo predefinidos que los servidores ofrecen para guiar las interacciones con los LLMs.

Ejemplo de uso: Un prompt generador de mensajes de commit de git que acepta cambios de código como entrada

Las Herramientas exponen funciones ejecutables que los LLMs pueden invocar (generalmente con aprobación del usuario) para realizar acciones.

Ejemplo de uso: Una herramienta de calculadora que realiza operaciones matemáticas sobre entradas proporcionadas por el modelo

// Servidor que expone un único archivo de registro como recurso

const server = new Server({ /* config */ }, { capabilities: { resources: {} } });

// Listar recursos disponibles

server.setRequestHandler(ListResourcesRequestSchema, async () => {

return {

resources: [

{

uri: "file:///logs/app.log",

name: "Registros de la Aplicación",

mimeType: "text/plain"

}

]

};

});

// Proveer contenido del recurso

server.setRequestHandler(ReadResourceRequestSchema, async (request) => {

if (request.params.uri === "file:///logs/app.log") {

const logContents = await readLogFile();

return {

contents: [{

uri: request.params.uri,

mimeType: "text/plain",

text: logContents

}]

};

}

throw new Error("Resource not found");

});

const server = new Server({ /* config */ }, { capabilities: { tools: {} } });

// Listar herramientas disponibles

server.setRequestHandler(ListToolsRequestSchema, async () => {

return {

tools: [{

name: "calculate_sum",

description: "Suma dos números",

inputSchema: {

type: "object",

properties: {

a: { type: "number", description: "Primer número" },

b: { type: "number", description: "Segundo número" }

},

required: ["a", "b"]

},

annotations: {

title: "Calcular Suma",

readOnlyHint: true,

openWorldHint: false

}

}]

};

});

// Manejar la ejecución de la herramienta

server.setRequestHandler(CallToolRequestSchema, async (request) => {

if (request.params.name === "calculate_sum") {

try {

const { a, b } = request.params.arguments;

if (typeof a !== 'number' || typeof b !== 'number') {

throw new Error("Invalid input: 'a' and 'b' must be numbers.");

}

const sum = a + b;

return {

content: [{ type: "text", text: String(sum) }]

};

} catch (error: any) {

return {

isError: true,

content: [{ type: "text", text: `Error calculating sum: ${error.message}` }]

};

}

}

throw new Error("Tool not found");

});

Comienza a crear sistemas de IA potentes con integraciones estandarizadas, acceso seguro a datos y conectividad flexible de herramientas usando FlowHunt.

Ejemplo rápido de cómo desarrollar tu propio servidor MCP con Python.

La IA agentica está redefiniendo la automatización de flujos de trabajo con el Protocolo de Contexto de Modelo (MCP), permitiendo una integración dinámica y esc...

Descubre cómo el Model Context Protocol (MCP) permite operaciones seguras en el sistema de archivos para asistentes de IA y herramientas de desarrollo. Esta guí...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.