Integración del Servidor Vectorize MCP

Integra el Servidor Vectorize MCP con FlowHunt para habilitar recuperación avanzada de vectores, búsqueda semántica y extracción de texto para flujos de trabajo...

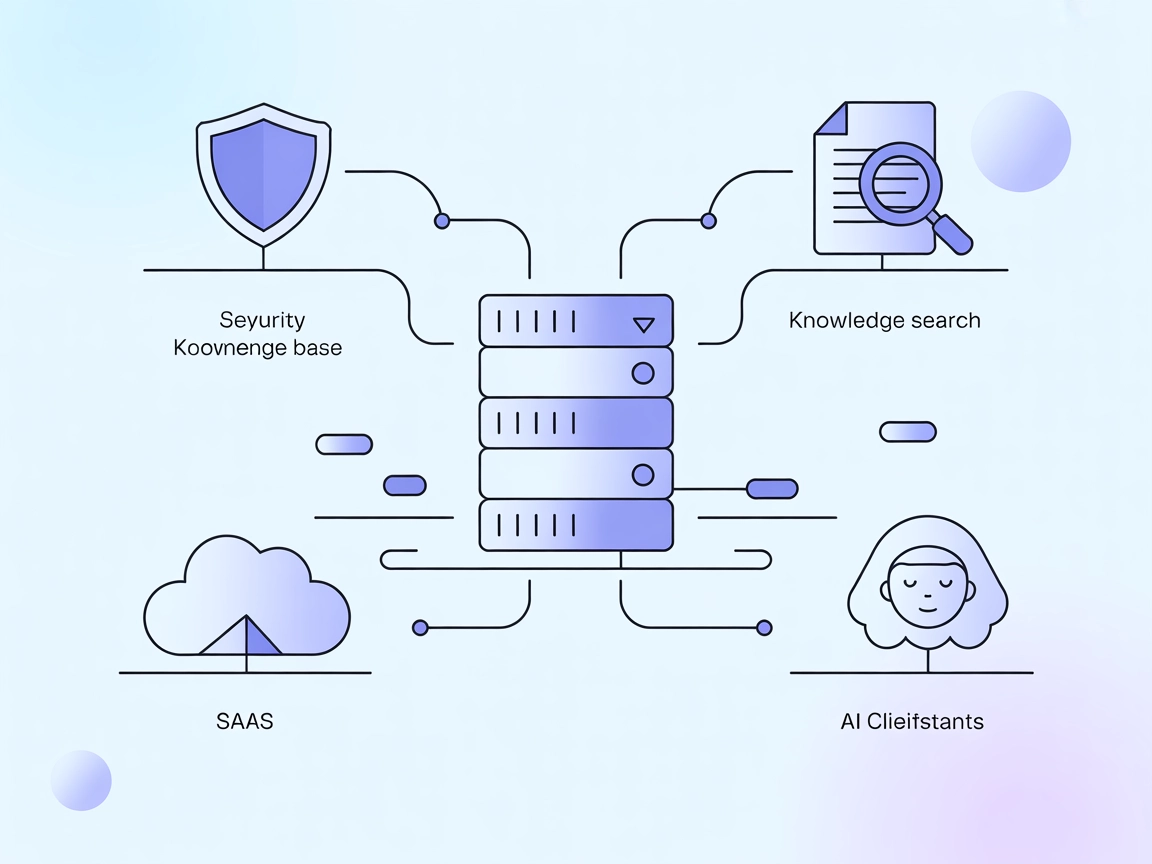

Conecta de forma segura los agentes de FlowHunt con la potente plataforma RAG de Vectara usando Vectara MCP Server para respuestas de IA fiables, ricas en contexto y recuperación avanzada de conocimiento.

FlowHunt proporciona una capa de seguridad adicional entre tus sistemas internos y las herramientas de IA, dándote control granular sobre qué herramientas son accesibles desde tus servidores MCP. Los servidores MCP alojados en nuestra infraestructura pueden integrarse perfectamente con el chatbot de FlowHunt, así como con plataformas de IA populares como ChatGPT, Claude y varios editores de IA.

Vectara MCP Server es una implementación de código abierto del Model Context Protocol (MCP) diseñada para conectar asistentes de IA con la plataforma Trusted RAG (Generación Aumentada por Recuperación) de Vectara. Al actuar como un servidor MCP, permite a los sistemas de IA realizar búsquedas y tareas de recuperación sofisticadas de forma segura y eficiente contra el motor de recuperación fiable de Vectara. Esto facilita conexiones bidireccionales sin fisuras entre clientes de IA y fuentes de datos externas, permitiendo a los desarrolladores enriquecer sus flujos de trabajo con capacidades avanzadas de RAG, minimizar alucinaciones y agilizar el acceso a información relevante para aplicaciones de IA generativa.

No se mencionan plantillas de prompt específicas en la documentación o archivos del repositorio disponibles.

No se listan recursos MCP explícitos en la documentación o archivos del repositorio disponibles.

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp).mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

Se recomienda encarecidamente almacenar las claves API sensibles en variables de entorno en lugar de archivos de configuración. Ejemplo:

{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": [],

"env": {

"VECTARA_API_KEY": "${VECTARA_API_KEY}"

},

"inputs": {

"api_key": "${VECTARA_API_KEY}"

}

}

}

}

Uso de MCP en FlowHunt

Para integrar servidores MCP en tu flujo de trabajo de FlowHunt, comienza añadiendo el componente MCP a tu flujo y conectándolo a tu agente de IA:

Haz clic en el componente MCP para abrir el panel de configuración. En la sección de configuración del sistema MCP, inserta los detalles de tu servidor MCP usando este formato JSON:

{

"vectara-mcp": {

"transport": "streamable_http",

"url": "https://tuservermcp.ejemplo/rutamcp/url"

}

}

Una vez configurado, el agente de IA podrá usar este MCP como herramienta con acceso a todas sus funciones y capacidades. Recuerda cambiar “vectara-mcp” por el nombre real de tu servidor MCP y reemplazar la URL por la de tu propio servidor MCP.

| Sección | Disponibilidad | Detalles/Notas |

|---|---|---|

| Resumen | ✅ | Proporcionada visión general y función de Vectara MCP Server |

| Lista de Prompts | ⛔ | No especificado en la documentación disponible |

| Lista de Recursos | ⛔ | No especificado en la documentación disponible |

| Lista de Herramientas | ✅ | Solo se describe la herramienta ask_vectara |

| Seguridad de Claves API | ✅ | Documentado con ejemplo de JSON/env |

| Soporte de Muestreo (menos relevante en evaluación) | ⛔ | No especificado |

Vectara MCP proporciona una integración clara y enfocada para RAG con documentación sólida para la configuración y seguridad de claves API, pero carece de detalles sobre prompts, recursos o muestreo/roots. Es ideal para habilitar RAG en flujos agentivos, aunque la ausencia de características MCP más ricas limita su versatilidad.

| Tiene LICENCIA | ✅ (Apache-2.0) |

|---|---|

| Tiene al menos una herramienta | ✅ |

| Número de Forks | 2 |

| Número de Stars | 8 |

Valoración: 5/10 — Es sólido y listo para producción en su caso de uso RAG, pero cubre solo un conjunto mínimo de características MCP y carece de documentación sobre prompts, recursos y conceptos avanzados de MCP.

Vectara MCP Server es una implementación de código abierto del Model Context Protocol, que conecta asistentes de IA con la plataforma Trusted RAG de Vectara. Permite búsqueda y recuperación segura y eficiente para flujos de trabajo de IA generativa.

La herramienta principal es `ask_vectara`, que ejecuta una consulta RAG contra Vectara y devuelve resultados de búsqueda con una respuesta generada. Esta herramienta requiere consultas de usuario, claves de corpus de Vectara y una clave API.

Los casos clave incluyen Generación Aumentada por Recuperación (RAG) para minimizar alucinaciones, integración de búsqueda empresarial, automatización de gestión del conocimiento y acceso seguro a datos sensibles mediante protección con claves API.

Almacena las claves API en variables de entorno en lugar de escribirlas en los archivos de configuración. Utiliza configuraciones JSON con variables como `${VECTARA_API_KEY}` para mayor seguridad.

Añade el componente MCP a tu flujo de FlowHunt, configúralo con los detalles de tu servidor Vectara MCP y conéctalo a tu agente de IA. Esto permite que el agente acceda a las capacidades avanzadas de recuperación de Vectara.

Aunque es robusto para RAG y búsqueda, actualmente carece de documentación detallada sobre plantillas de prompts, recursos MCP adicionales y funciones avanzadas de muestreo o MCP root.

Potencia a tus agentes de IA con respuestas seguras, verídicas y conscientes del contexto integrando Vectara MCP Server en tus flujos de trabajo de FlowHunt.

Integra el Servidor Vectorize MCP con FlowHunt para habilitar recuperación avanzada de vectores, búsqueda semántica y extracción de texto para flujos de trabajo...

El Servidor Vertica MCP permite una integración fluida entre asistentes de IA y bases de datos OpenText Vertica, soportando operaciones SQL seguras, carga masiv...

Integra FlowHunt con Vectara MCP para potenciar tus agentes de IA y aplicaciones RAG con búsquedas confiables y de baja alucinación utilizando el Model Context ...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.