PyTorch

PyTorch est un framework open-source d'apprentissage automatique développé par Meta AI, réputé pour sa flexibilité, ses graphes de calcul dynamiques, son accélé...

Torch est une bibliothèque open-source d’apprentissage automatique basée sur Lua, offrant des outils complets pour les réseaux de neurones et l’apprentissage profond, et ouvrant la voie à PyTorch.

Torch est une bibliothèque open-source d’apprentissage automatique, un cadre de calcul scientifique, et un langage de script basé sur Lua, spécifiquement optimisé pour les tâches d’apprentissage profond et d’intelligence artificielle. Développée initialement par l’Idiap Research Institute à l’EPFL en 2002, Torch fournit une suite complète d’outils pour la construction et l’entraînement de réseaux de neurones complexes. Elle a été un précurseur de la bibliothèque PyTorch, qui est depuis devenue plus influente dans la communauté de l’apprentissage automatique. Malgré son influence précoce et ses capacités, la dépendance de Torch à Lua, un langage de programmation moins répandu que Python, a limité son adoption à grande échelle.

Tableaux N-dimensionnels (Tenseurs) :

Torch est construit autour du concept de tenseurs, qui sont des tableaux multidimensionnels similaires aux tableaux NumPy. Ces tenseurs sont essentiels pour effectuer diverses opérations mathématiques nécessaires à l’apprentissage automatique et aux calculs scientifiques. Les tenseurs permettent des calculs numériques efficaces et prennent en charge les opérations sur CPU et GPU via des bibliothèques optimisées comme CUDA.

Différentiation automatique :

Une fonctionnalité clé de Torch, permettant le calcul efficace des gradients, crucial pour l’entraînement des réseaux de neurones profonds. La différentiation automatique de Torch est implémentée via une interface modulaire permettant le calcul des gradients du premier ordre. Cette capacité simplifie le processus d’entraînement des modèles complexes en automatisant le calcul des dérivées.

Modules de réseaux de neurones profonds :

Le package nn de Torch permet la construction de réseaux de neurones de manière modulaire. Il prend en charge les réseaux feedforward, convolutionnels, récurrents, entre autres, et inclut des modules pour les fonctions d’activation, les fonctions de perte et les optimiseurs. Cette conception modulaire facilite la création et l’expérimentation de diverses architectures de réseaux.

Accélération GPU :

Torch exploite l’accélération GPU pour effectuer des calculs efficacement, ce qui le rend bien adapté aux tâches d’apprentissage automatique à grande échelle. Son intégration avec CUDA permet des gains de performance significatifs et permet aux chercheurs d’entraîner des modèles complexes plus rapidement et plus efficacement.

Recherche en apprentissage profond :

Torch a été largement utilisé dans les milieux académiques et industriels, notamment pour le développement de nouveaux algorithmes d’apprentissage profond. Sa flexibilité et sa rapidité le rendent idéal pour le prototypage de modèles complexes. Les chercheurs ont utilisé Torch pour expérimenter de nouvelles architectures et algorithmes d’apprentissage.

Vision par ordinateur :

Torch propose des outils pour le traitement d’images et les applications de vision par ordinateur, telles que la détection d’objets et la classification d’images. Sa capacité à gérer de grands ensembles de données et à effectuer un traitement en temps réel en fait un outil précieux pour l’analyse de données visuelles.

Traitement du langage naturel (NLP) :

La bibliothèque prend en charge le développement de modèles NLP, y compris les réseaux de neurones récurrents et les modèles de langage, essentiels pour des tâches telles que la traduction automatique et l’analyse de sentiments. Les capacités de calcul dynamique de Torch permettent de gérer efficacement des données séquentielles et des entrées de longueur variable.

Apprentissage par renforcement :

Torch est utilisé en apprentissage par renforcement pour développer des modèles apprenant des actions optimales par essai-erreur, utile dans des domaines comme la robotique et l’intelligence artificielle pour les jeux. Sa capacité à gérer des environnements et des processus complexes aide au développement de systèmes intelligents et adaptatifs.

Construction de réseaux de neurones :

Le package nn de Torch permet aux utilisateurs de construire des réseaux de neurones via une interface de haut niveau. Par exemple, la création d’un perceptron multicouche simple peut se faire en quelques lignes de code, en définissant facilement les couches et fonctions d’activation.

local nn = require 'nn'

local model = nn.Sequential()

model:add(nn.Linear(10, 25))

model:add(nn.Tanh())

model:add(nn.Linear(25, 1))

Vision par ordinateur avec Torch :

Facebook AI Research a utilisé Torch pour divers projets de vision par ordinateur, exploitant ses robustes capacités pour traiter et analyser efficacement de grands ensembles de données. Les capacités GPU de Torch permettent un traitement d’image en temps réel, ce qui en fait un choix privilégié pour les tâches de vision à haute performance.

Modèles NLP :

Le support de Torch pour les réseaux de neurones dynamiques le rend idéal pour le développement de modèles NLP sophistiqués nécessitant une flexibilité dans le traitement de séquences de données textuelles. La capacité du framework à gérer des tailles d’entrée variables et des types de données dynamiques est cruciale pour les applications avancées de traitement du langage.

Le développement de Torch s’est largement orienté vers PyTorch, une bibliothèque qui conserve les fonctionnalités principales de Torch tout en s’appuyant sur la popularité et la facilité d’utilisation de Python. PyTorch offre une interface plus intuitive et une meilleure intégration à l’écosystème Python, ce qui en fait un choix privilégié pour les praticiens de l’apprentissage automatique moderne. Le graphe de calcul dynamique de PyTorch et son API de haut niveau en font un standard du domaine, facilitant le prototypage rapide et le déploiement de modèles d’apprentissage profond.

Torch, et son successeur PyTorch, sont essentiels dans le développement d’applications d’IA, y compris les chatbots. La capacité à traiter de grandes quantités de données et à apprendre dynamiquement est cruciale pour créer des systèmes intelligents capables de comprendre et de répondre efficacement aux entrées des utilisateurs. Avec les avancées du NLP et de l’apprentissage profond, PyTorch reste un outil central pour améliorer l’intelligence et l’efficacité des systèmes de chatbot.

La bibliothèque Torch est une bibliothèque d’apprentissage automatique populaire qui a été largement utilisée pour l’implémentation de modèles d’apprentissage profond. Voici un résumé des principaux articles de recherche traitant de Torch et de ses applications :

Torch-Struct : bibliothèque de prédiction structurée profonde

Publié en 2020 par Alexander M. Rush, cet article présente Torch-Struct, une bibliothèque conçue pour la prédiction structurée dans les cadres d’apprentissage profond. Elle s’intègre aux frameworks vectorisés basés sur l’auto-différentiation et inclut une large collection de structures probabilistes. La bibliothèque vise à fournir un code efficace, testable et rapide grâce à des opérations vectorisées par lots. Les expériences montrent des gains de performance importants par rapport aux bases rapides. Pour plus de détails, vous pouvez accéder à l’article ici.

rnn pour les tâches sur données séquentielles comme le NLP, la reconnaissance vocale et la prévision de séries temporelles. Découvrez maintenant !") : bibliothèque récurrente pour Torch

Rédigé par Nicholas Léonard et d’autres en 2015, cet article traite du package rnn, qui fournit des composants pour une large gamme de réseaux de neurones récurrents dans le cadre Torch. Le package met l’accent sur des tests unitaires solides et la rétrocompatibilité. Il a évolué au fil de trois itérations, renforçant sa flexibilité et ses capacités. Cet article compare le package rnn aux implémentations existantes et donne un aperçu de son développement et de son utilisation.

cltorch : un backend indépendant du matériel pour la bibliothèque Torch Deep Neural Network, basé sur OpenCL

Rédigé par Hugh Perkins en 2016, cet article présente cltorch, qui permet l’entraînement de réseaux de neurones profonds sur des GPU de différents fournisseurs de matériel grâce à OpenCL. cltorch peut exécuter des modèles tels qu’AlexNet et GoogleNet, et se concentre sur l’accélération des couches convolutionnelles pour de meilleures performances indépendantes du matériel. L’article aborde également les défis techniques et les solutions pour une mise en œuvre rapide.

cito : un package R pour l’entraînement de réseaux de neurones avec torch

Publié en 2024 par Christian Amesoeder et ses collègues, cet article présente ‘cito’, un package R qui simplifie la spécification de réseaux de neurones profonds en utilisant la syntaxe de formule familière des packages R. Il s’appuie sur la bibliothèque Torch pour l’optimisation numérique et vise à rendre l’apprentissage profond plus accessible aux utilisateurs de R, en particulier dans le domaine de l’écologie.

Torch est une bibliothèque open-source d'apprentissage automatique et un cadre de calcul scientifique basé sur Lua, optimisé pour l'apprentissage profond et l'intelligence artificielle. Elle fournit des outils pour la construction et l'entraînement de réseaux de neurones complexes, et a été un précurseur de PyTorch.

Torch offre le calcul de tenseurs N-dimensionnels, la différentiation automatique, des composants modulaires pour les réseaux de neurones, et l'accélération GPU pour des tâches d'apprentissage profond haute performance.

Torch est basé sur Lua et a été un des premiers cadres d'apprentissage profond, tandis que PyTorch est son successeur basé sur Python, offrant une API plus intuitive, des graphes de calcul dynamiques et une adoption plus large dans la communauté de l'apprentissage automatique.

Torch a été utilisé pour la recherche en apprentissage profond, la vision par ordinateur, le traitement du langage naturel et l'apprentissage par renforcement, notamment avant l'essor de PyTorch.

La transition s'est produite parce que Python est plus largement utilisé que Lua, et PyTorch offre une meilleure convivialité, une intégration à l'écosystème Python et des fonctionnalités avancées pour les workflows d'apprentissage profond modernes.

PyTorch est un framework open-source d'apprentissage automatique développé par Meta AI, réputé pour sa flexibilité, ses graphes de calcul dynamiques, son accélé...

AllenNLP est une bibliothèque open-source robuste pour la recherche en traitement du langage naturel (NLP), construite sur PyTorch par AI2. Elle propose des out...

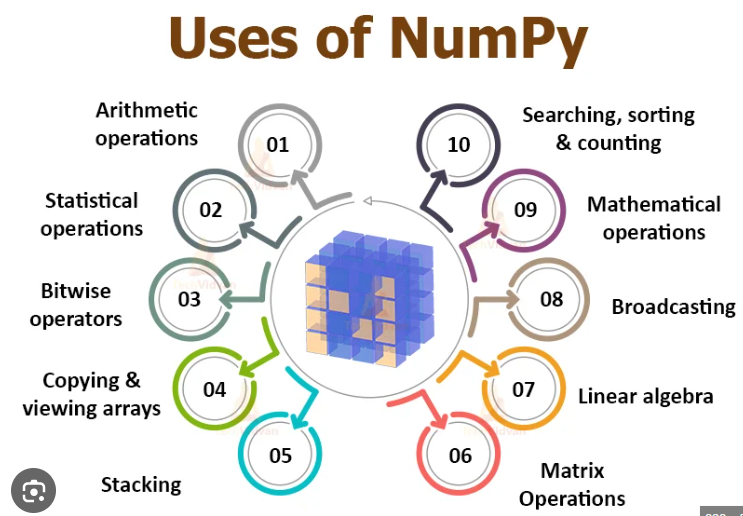

NumPy est une bibliothèque Python open-source essentielle pour le calcul numérique, offrant des opérations sur les tableaux et des fonctions mathématiques effic...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.