Serveur Proxy MCP

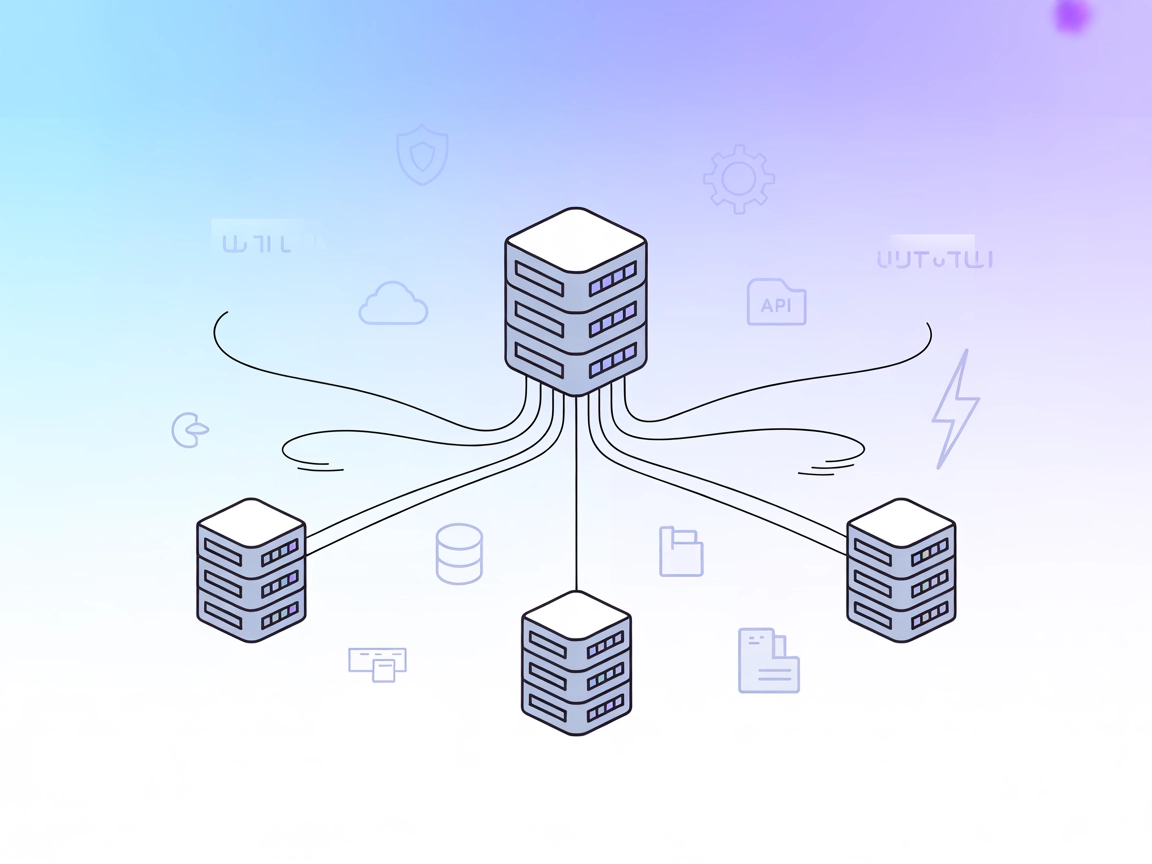

Le Serveur Proxy MCP agrège plusieurs serveurs de ressources MCP en un seul serveur HTTP, simplifiant les connexions pour les assistants IA et les développeurs....

Connectez les assistants IA à des outils et systèmes via différents protocoles de transport MCP grâce au serveur MCP mcp-proxy pour FlowHunt.

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

Le serveur MCP mcp-proxy agit comme un pont entre les transports MCP Streamable HTTP et stdio, permettant une communication transparente entre les assistants IA et différents types de serveurs ou clients Model Context Protocol (MCP). Sa fonction principale est d’assurer la traduction entre ces deux protocoles de transport largement utilisés, permettant ainsi aux outils, ressources et workflows conçus pour un protocole d’être accessibles via l’autre sans modification. Ceci améliore les workflows de développement en permettant aux assistants IA d’interagir avec des sources de données externes, des API ou des services utilisant différents mécanismes de transport, et rend possible des tâches comme les requêtes de bases de données, la gestion de fichiers ou les interactions API sur des systèmes variés.

Aucun modèle de prompt n’est mentionné dans le dépôt.

Aucune ressource MCP explicite n’est décrite dans la documentation ou le code du dépôt.

Aucun outil n’est défini dans la documentation ou le code visible du dépôt (par exemple, pas de fonctions explicites, d’outils, ni de server.py contenant des définitions d’outils).

mcp-proxy ou installez-le via PyPI si disponible.{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

Sécurisation des clés API

Vous pouvez sécuriser les variables d’environnement (par exemple, les clés API) en utilisant env dans votre configuration :

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": [],

"env": {

"API_KEY": "${API_KEY}"

},

"inputs": {

"api_key": "${API_KEY}"

}

}

}

}

Utilisation du MCP dans FlowHunt

Pour intégrer des serveurs MCP dans votre workflow FlowHunt, commencez par ajouter le composant MCP à votre flow et connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section configuration système MCP, insérez les détails de votre serveur MCP en utilisant ce format JSON :

{

"mcp-proxy": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Une fois configuré, l’agent IA peut alors utiliser ce MCP comme un outil avec accès à toutes ses fonctions et capacités. N’oubliez pas de remplacer “mcp-proxy” par le nom réel de votre serveur MCP et l’URL par celle de votre propre serveur MCP.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Aperçu | ✅ | |

| Liste des Prompts | ⛔ | Aucun trouvé |

| Liste des ressources | ⛔ | Aucune trouvée |

| Liste des outils | ⛔ | Aucun outil explicite défini |

| Sécurisation des clés API | ✅ | Via env dans la config |

| Support de l’échantillonnage (moins important) | ⛔ | Aucune mention |

| Support Roots | ⛔ | Aucune mention |

D’après ce qui précède, mcp-proxy est hautement spécialisé pour la traduction de protocoles mais ne fournit pas d’outils, de prompts ou de ressources prêts à l’emploi. Sa valeur réside dans l’intégration et la connectivité, non dans la fourniture directe d’utilitaires LLM.

mcp-proxy est un utilitaire clé pour faire le pont entre les protocoles de transport MCP, ce qui le rend très précieux dans les environnements où les incompatibilités de protocoles limitent l’interopérabilité des outils IA/LLM. Cependant, il ne fournit pas d’améliorations directes pour LLM comme des ressources, prompts ou outils. Pour son cas d’utilisation cible, c’est un projet robuste et bien suivi. Note : 6/10 pour une utilité MCP générale, 9/10 si vous avez spécifiquement besoin d’un pont de protocoles.

| Possède une LICENCE | ✅ (MIT) |

|---|---|

| Possède au moins un outil | ⛔ |

| Nombre de forks | 128 |

| Nombre d’étoiles | 1,1k |

Le serveur MCP mcp-proxy fait le pont entre les transports MCP Streamable HTTP et stdio, permettant une communication transparente entre les assistants IA et divers serveurs ou clients MCP. Cela permet aux workflows et outils conçus pour différents protocoles de fonctionner ensemble sans modification.

mcp-proxy est idéal pour faire le pont entre différents transports MCP, intégrer des systèmes hérités avec des plateformes IA modernes, améliorer la connectivité des workflows IA et faciliter le développement et les tests multiplateformes.

Non, mcp-proxy se concentre uniquement sur la traduction de protocoles et ne fournit pas d'outils intégrés, de modèles de prompt ou de ressources. Sa valeur réside dans l'interopérabilité et l'intégration.

Vous pouvez utiliser des variables d'environnement dans votre configuration du serveur MCP pour sécuriser les clés API. Par exemple, utilisez un bloc 'env' et référencez les variables dans votre JSON de configuration.

Ajoutez le composant MCP à votre flow FlowHunt, puis configurez le serveur MCP mcp-proxy dans la configuration système MCP à l'aide de l'extrait JSON approprié. Cela permet à votre agent IA d'accéder à toutes les capacités rendues disponibles par les protocoles MCP reliés.

Comblez les lacunes de votre workflow IA et activez une interopérabilité transparente des protocoles avec mcp-proxy. Intégrez des systèmes existants et élargissez instantanément la portée de votre IA.

Le Serveur Proxy MCP agrège plusieurs serveurs de ressources MCP en un seul serveur HTTP, simplifiant les connexions pour les assistants IA et les développeurs....

Le serveur ModelContextProtocol (MCP) agit comme un pont entre les agents IA et les sources de données externes, API et services, permettant aux utilisateurs de...

Le serveur Model Context Protocol (MCP) fait le lien entre les assistants IA et des sources de données externes, des API et des services, permettant une intégra...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.