Serverul Proxy MCP

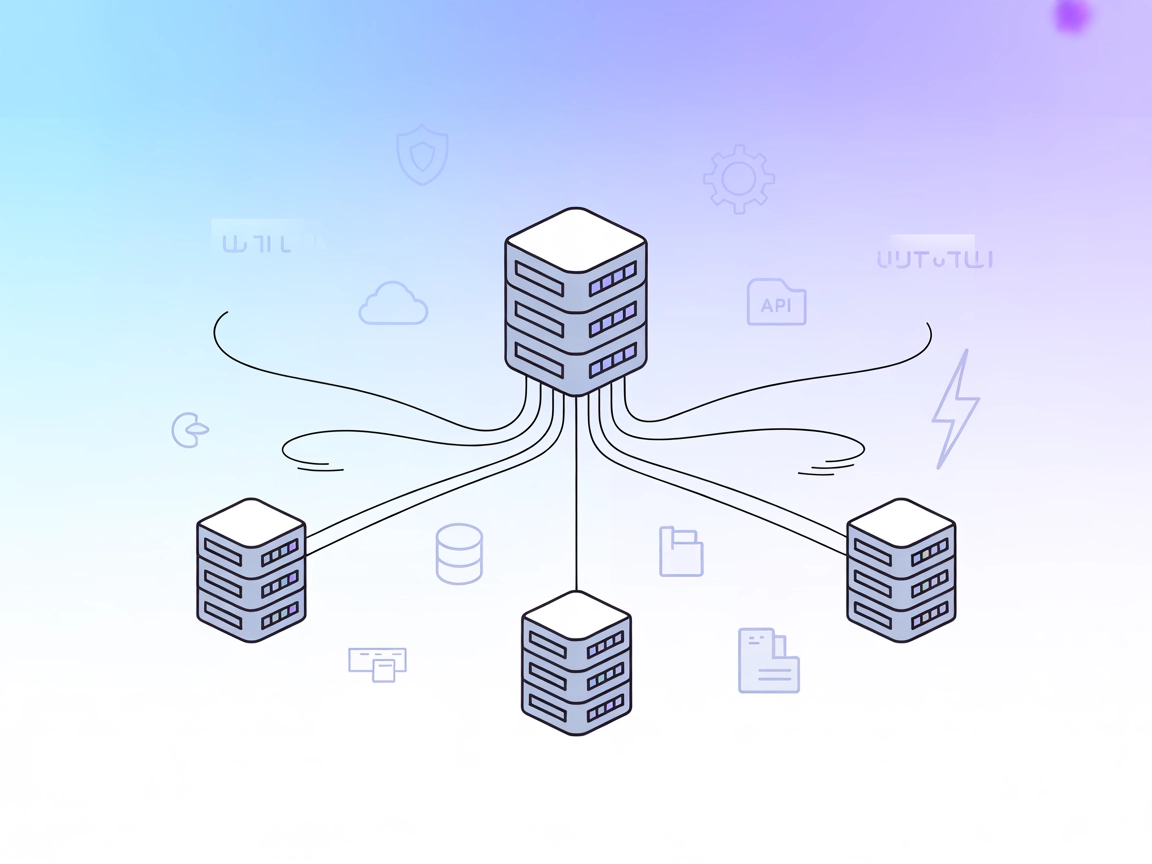

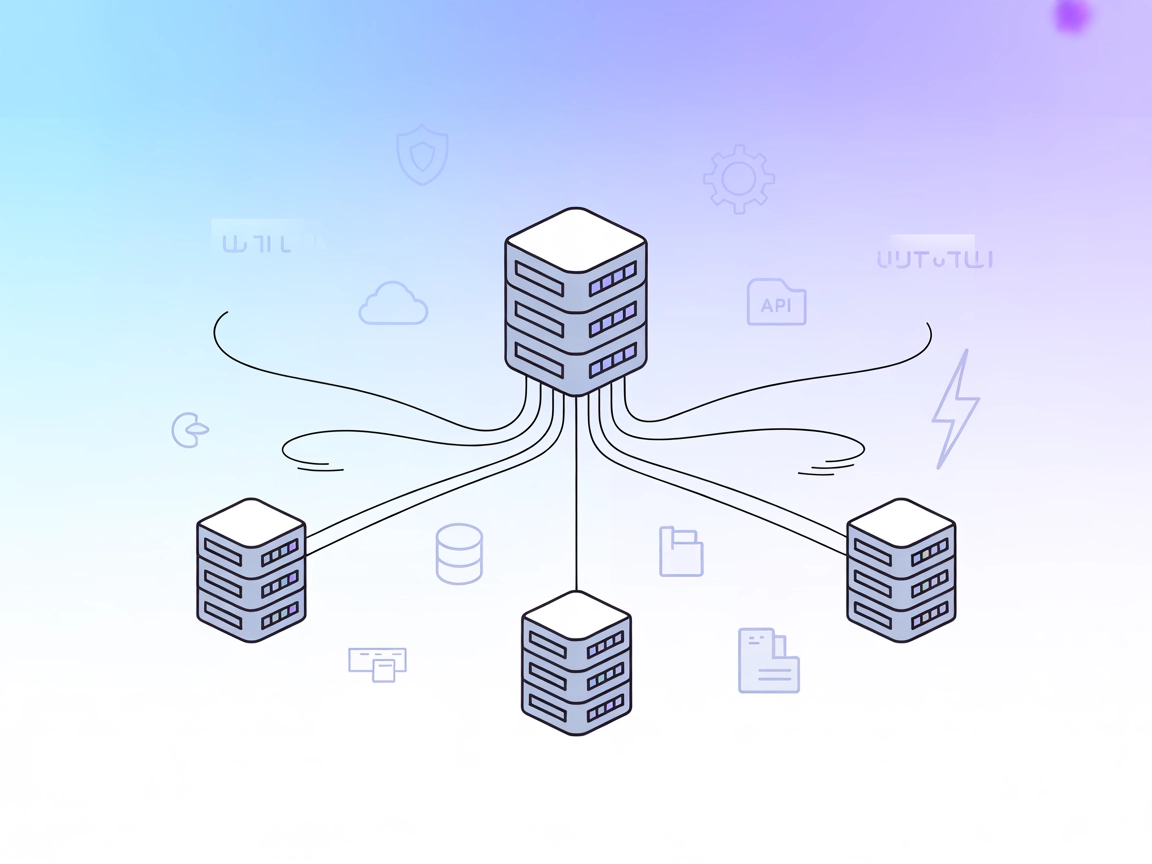

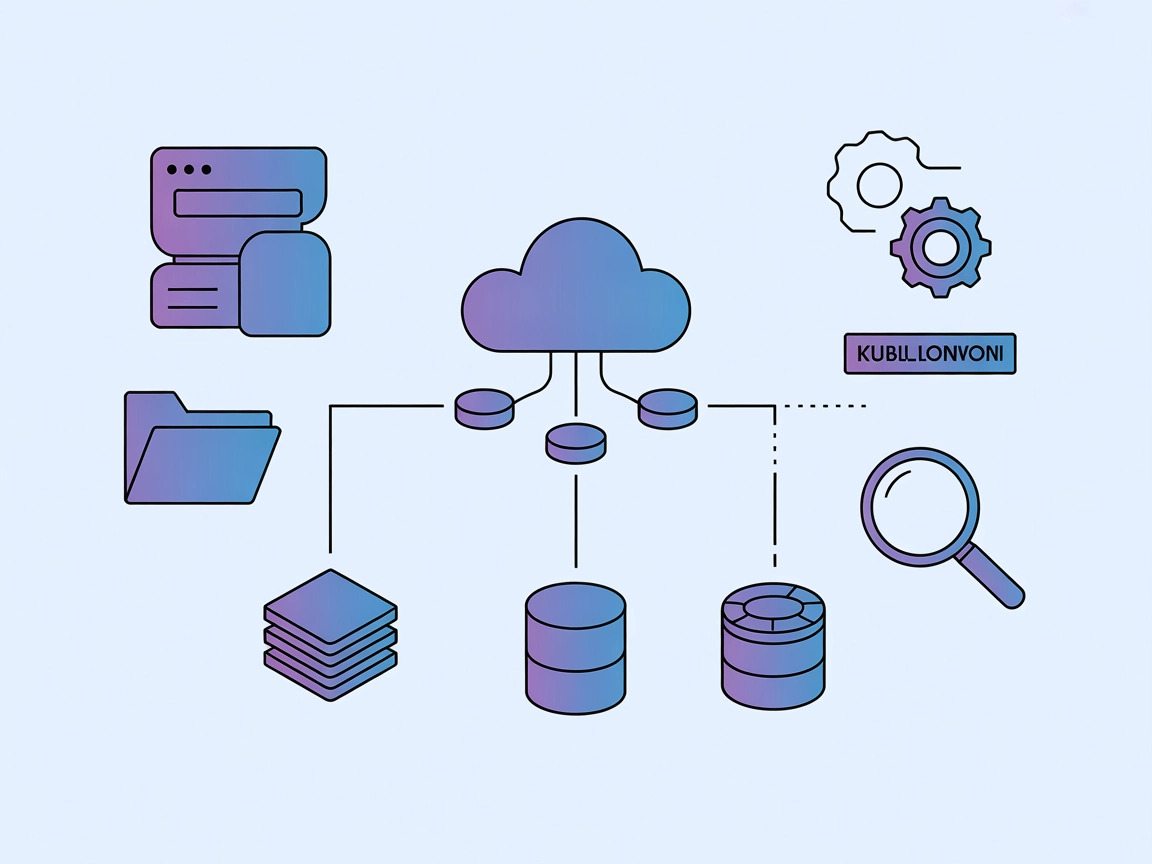

Serverul Proxy MCP agregă mai multe servere de resurse MCP într-un singur server HTTP, simplificând conexiunile pentru asistenții AI și dezvoltatori. Acesta per...

Conectează asistenți AI la instrumente și sisteme pe diferite protocoale MCP de transport folosind serverul MCP mcp-proxy pentru FlowHunt.

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

mcp-proxy MCP Server acționează ca un pod între transporturile MCP Streamable HTTP și stdio, permițând comunicarea fără întreruperi între asistenți AI și diferite tipuri de servere sau clienți Model Context Protocol (MCP). Funcția sa principală este să traducă între aceste două protocoale de transport larg utilizate, astfel încât instrumentele, resursele și fluxurile de lucru proiectate pentru un protocol să poată fi accesate prin celălalt fără modificări. Acest lucru îmbunătățește fluxurile de dezvoltare, făcând posibilă interacțiunea asistenților AI cu surse de date externe, API-uri sau servicii care folosesc mecanisme de transport diferite, permițând astfel sarcini precum interogări de baze de date, gestionare fișiere sau interacțiuni API pe sisteme diverse.

Niciun template de prompt nu este menționat în repository.

Niciun resursă MCP explicită nu este descrisă în documentația sau codul repository-ului.

Niciun instrument nu este definit în documentația repository-ului sau în codul vizibil (de ex., nu există funcții explicite, instrumente sau server.py cu definiții de instrumente).

mcp-proxy sau instalează-l prin PyPI, dacă este disponibil.{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

Securizarea cheilor API

Poți securiza variabilele de mediu (ex: chei API) folosind env în configurație:

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": [],

"env": {

"API_KEY": "${API_KEY}"

},

"inputs": {

"api_key": "${API_KEY}"

}

}

}

}

Folosirea MCP în FlowHunt

Pentru a integra servere MCP în fluxul tău FlowHunt, începe prin a adăuga componenta MCP în flow și conecteaz-o la agentul AI:

Apasă pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurare MCP de sistem, inserează detaliile serverului MCP folosind acest format JSON:

{

"mcp-proxy": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI poate folosi acest MCP ca instrument cu acces la toate funcțiile și capabilitățile sale. Nu uita să înlocuiești “mcp-proxy” cu numele real al serverului MCP și să pui propriul tău URL de server MCP.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | |

| Lista de Prompts | ⛔ | Niciunul găsit |

| Lista de Resurse | ⛔ | Niciuna găsită |

| Lista de Instrumente | ⛔ | Nicio unealtă explicit definită |

| Securizare chei API | ✅ | Prin env în configurație |

| Suport Sampling (mai puțin important la evaluare) | ⛔ | Nicio mențiune |

| Suport Roots | ⛔ | Nicio mențiune |

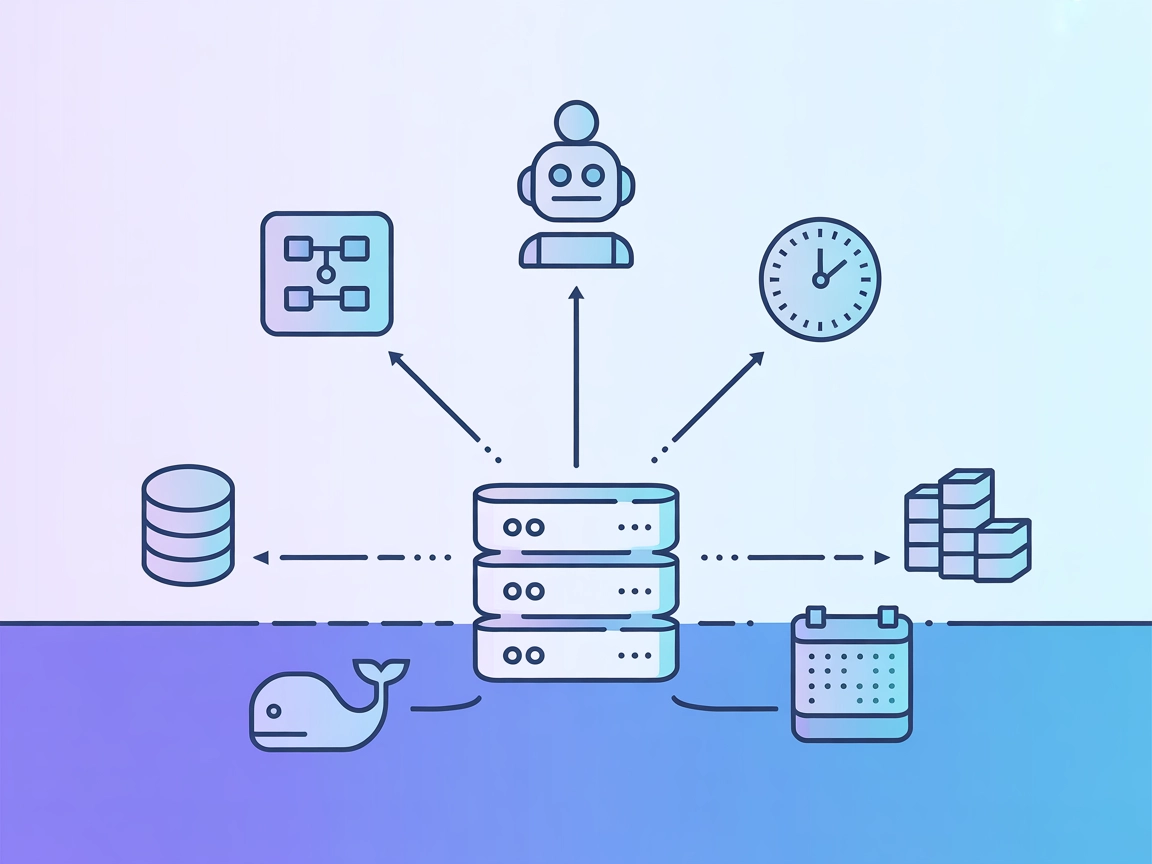

Pe baza celor de mai sus, mcp-proxy este foarte specializat pentru traducerea de protocoale, dar nu oferă instrumente, prompts sau resurse predefinite. Valoarea sa constă în integrare și conectivitate, nu în utilități LLM directe.

mcp-proxy este o utilitate esențială pentru conectarea protocoalelor MCP, fiind foarte valoroasă în medii unde diferențele de protocoale limitează interoperabilitatea instrumentelor AI/LLM. Totuși, nu oferă îmbunătățiri LLM directe precum resurse, prompturi sau instrumente. Pentru scopul său, este un proiect robust și bine susținut. Scor: 6/10 pentru utilitate MCP generală, 9/10 dacă ai nevoie specific de poduri între protocoale.

| Are LICENȚĂ | ✅ (MIT) |

|---|---|

| Are cel puțin un instrument | ⛔ |

| Număr de Forkuri | 128 |

| Număr de Stele | 1.1k |

Acoperă lacunele din fluxul tău AI și activează interoperabilitatea între protocoale cu mcp-proxy. Integrează sisteme legacy și extinde instantaneu acoperirea AI-ului tău.

Serverul Proxy MCP agregă mai multe servere de resurse MCP într-un singur server HTTP, simplificând conexiunile pentru asistenții AI și dezvoltatori. Acesta per...

Prefect MCP Server conectează asistenții AI și platforma de orchestrare a fluxurilor Prefect, permițând gestionarea prin limbaj natural a fluxurilor, deployment...

Kubernetes MCP Server creează o punte între asistenții AI și clusterele Kubernetes/OpenShift, permițând gestionarea programatică a resurselor, operarea podurilo...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.